Kommen wir nun am Schluss in der Zusammenfassung zu den Gewinnern und Verlierern in den beiden getesteten Auflösungen und beim Vergleich von DLSS, FSR und XeSS und betrachten uns die prozentualen Unterschiede. Alle FPS wurden wie immer normiert, kumuliert und dann im geometrischen Mittelwert zusammengefasst. Ich muss noch einmal daran erinnern, dass die von mir verwendete Radeon RX 6950XT Gaming X Trio als einzige Karte keine Referenzkarte ist, da AMD diese nicht zur Verfügung stellen konnte. Das Custom-Modell von MSI ist ca. 5% schneller als die Referenz, jedoch bei deutlich höherer Leistungsaufnahme.

Zusammenfassung der Gaming Performance in FPS und beim P1 Low

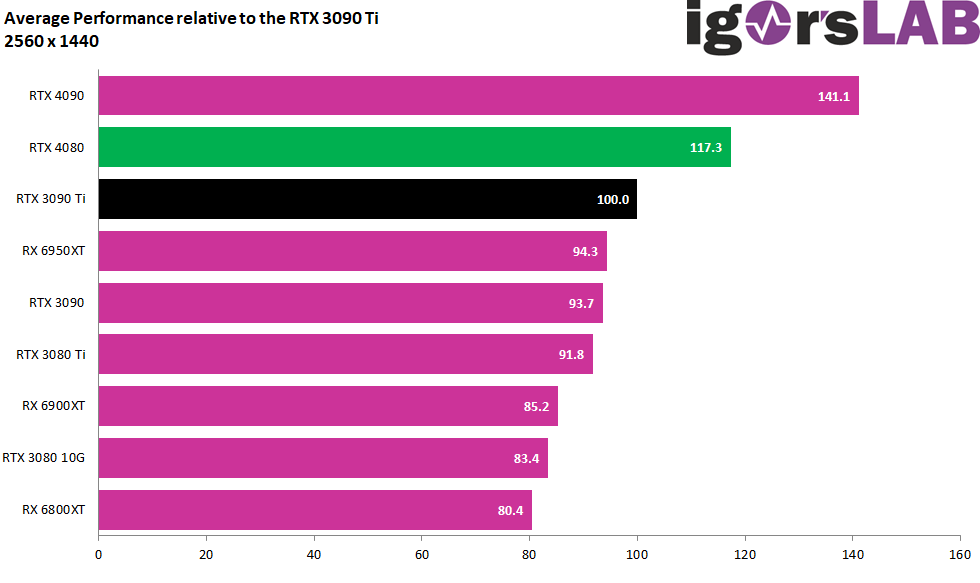

QHD mit 2560 x 1440 Pixeln

In QHD ist die GeForce RTX 4080 reichlich 17 Prozentpunkte schneller als die GeForce RTX 3090 Ti. Der Vergleich ist insofern interessant, da beide Karten auf einem ähnlich hohen Preisniveau agieren. Daher drängt sich die Nutzung der GeForce RTX 3090 Ti als 100%-Marke geradezu, weil es ja der (erst sehr spät nachgereichte) Vollausbau der Ampere-Generation ist. Die (sehr stark werksübertaktete) Radeon RX 6950XT ist in etwa gleich schnell wir die RTX 3090, liegt aber 17 Prozentpunkte hinter der nicht übertakteten GeForce RTX 4080 FE und bis zu 27 Prozentpunkte hinter der maximal übertakteten RTX 4080 FE. Das wären dann ca. 37 bis 40 Prozentpunkte gegenüber der nicht übertakteten Referenzkarte der Radeon RX 6950XT, während sich der Rest wie schon bekannt weiter hinten einsortieren muss und die RTX 4090 an der Spitze einsam ihre Kreise dreht.

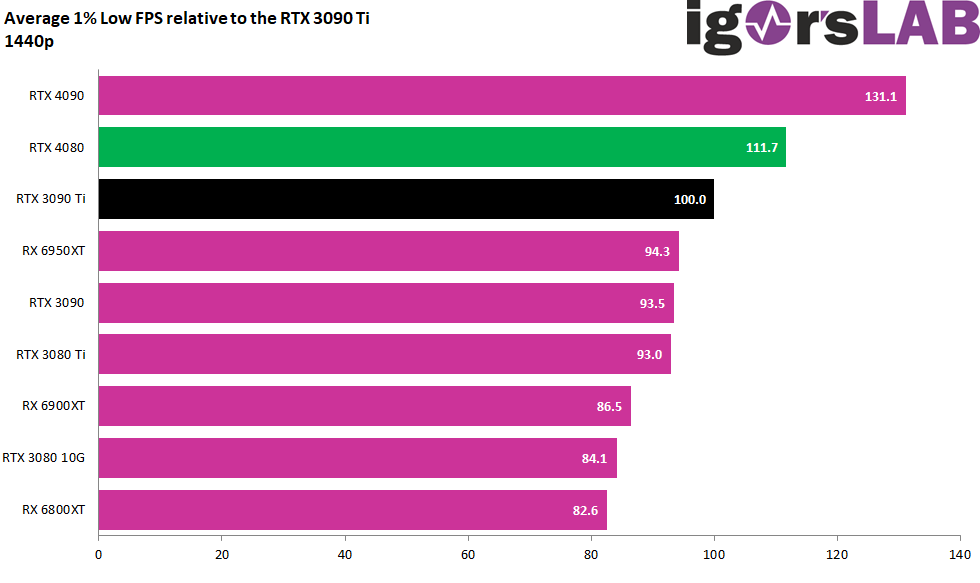

Bei den Min-FPS (P1 Low) fällt der Vorsprung der GeForce RTX 4080 gegenüber der GeForce RTX 3090 Ti ebenfalls sehr deutlich und sogar erstaunlich hoch aus, obwohl hier fast 100 Watt weniger verbraucht werden.

Bei den Min-FPS (P1 Low) fällt der Vorsprung der GeForce RTX 4080 gegenüber der GeForce RTX 3090 Ti ebenfalls sehr deutlich und sogar erstaunlich hoch aus, obwohl hier fast 100 Watt weniger verbraucht werden.

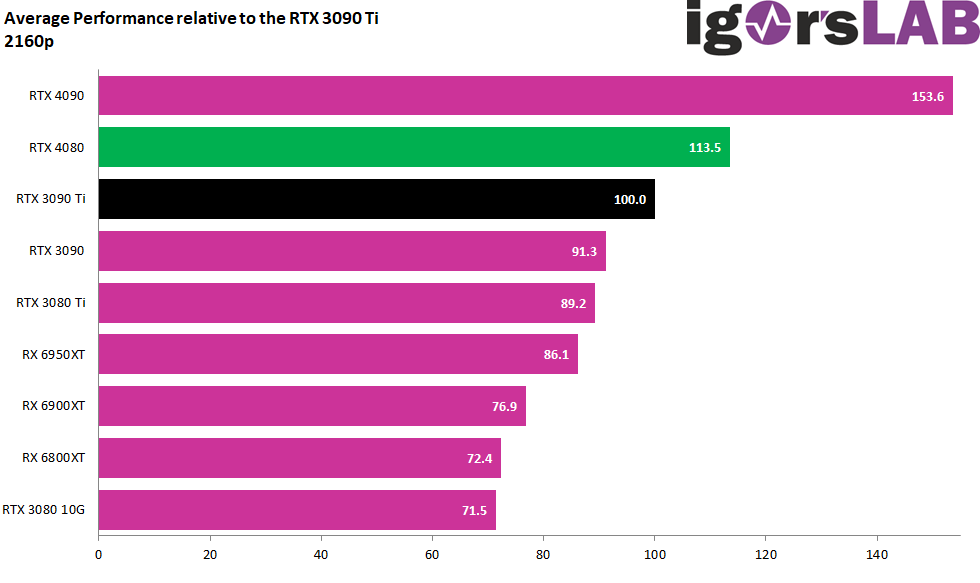

Ultra-HD mit 3840 x 2160 Pixeln

In Ultra-HD liegt die GeForce RTX 4080 nur noch 13,5 Prozentpunkte vor der GeForce RTX 3090 Ti und fast 27 Prozentpunkte vor der stark ab Werk übertakteten RX 6950XT bzw. ca. 33 Prozentpunkte vor einer nicht übertakteten Referenzkarte. Eine kolportierte Radeon RX 7900XTX würde also in jedem Fall deutlich hinter einer GeForce RTX 4090 liegen, eine GeForce RTX 4080 jedoch (vielleicht) um 10 bis 20 Prozentpunkte schlagen können. Reine Spekulation und im Dezember sind wir schlauer. Allerdings verweise ich an dieser Stelle auch noch auf den gleich folgenden Effizienz-Vergleich, denn der hat es in sich. Die tatsächliche Leistungsaufnahme und Performance pro Watt der kommenden RDNA3-Karte wären dann nämlich noch einmal eine komplett andere Geschichte. Da werden wir wirklich abwarten und selbst müssen.

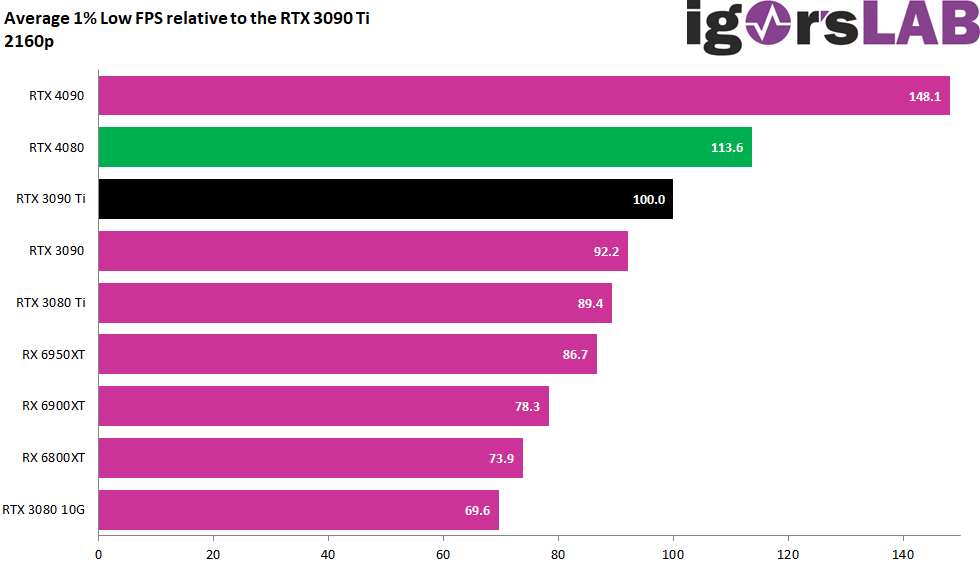

Da die CPU bei der GeForce RTX 4000 im Ultra-HD nur noch sehr selten limitiert, bleibt auch der Vorsprung der Karte beim P1 wieder gleich, weil das partielle CPU-Limit wegfällt.

Da die CPU bei der GeForce RTX 4000 im Ultra-HD nur noch sehr selten limitiert, bleibt auch der Vorsprung der Karte beim P1 wieder gleich, weil das partielle CPU-Limit wegfällt.

Ultra-HD mit 3080 x 2160 Pixeln und DLSS, FSR sowie XeSS

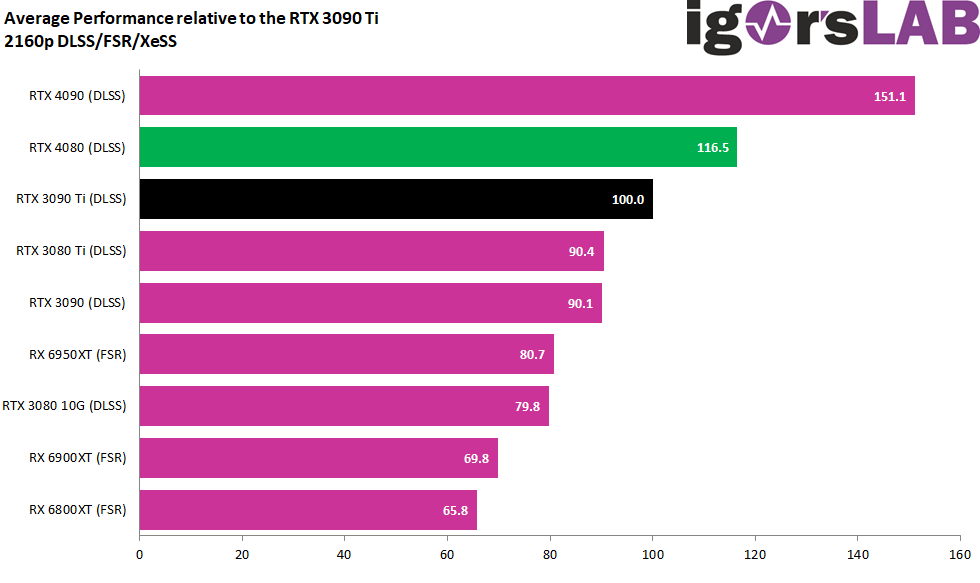

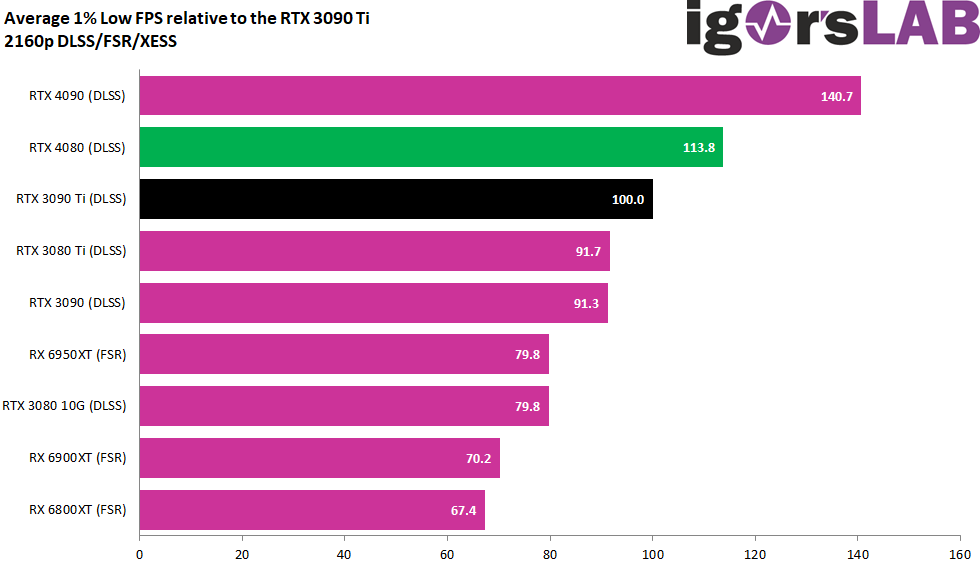

Nimmt man Pixelbeschleuniger wie DLSS, FSR oder XeSS zu Hilfe, dann steigen zwar die Frameraten der Karten zum Teil wieder in sehr gut spielbare Regionen, aber der Abstand ist erneut geradezu verblüffend. Fast 17 Prozentpunkte Vorsprung der GeForce RTX 4080 gegenüber der RTX 3090 Ti sind eine kleine Ansage. Auch hier gibt es für die RX 6950XT eine echte Abfuhr, denn die rund 36 Prozentpunkte Rückstand sind fast schon unglaublich. Mal abgesehen davon, dass auch die Bildqualität bei FSR eigentlich noch ein paar Punkte Abzug bekommen müsste. Intels XeSS sieht etwas besser aus, bringt aber auch etwas weniger Performance. Doch genau zu diesem Punkt verweise ich auf das Follow-Up übermorgen, wo wir unzählige Video-Vergleiche und ergänzende Benchmarks anbieten werden. Man kann ja viel drüber schreiben, aber man muss es auch gesehen haben.

Das P1, also die Min-FPS, liegen hier für die GeForce RTX 4080 wieder in Reichweite der (sehr leichten) CPU-Limitierung.

Effizienzauswertung

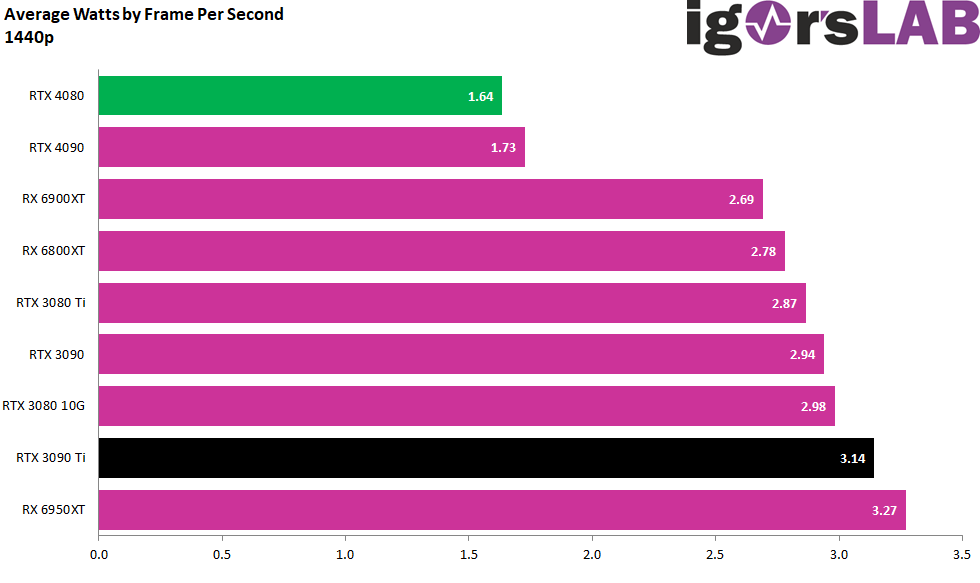

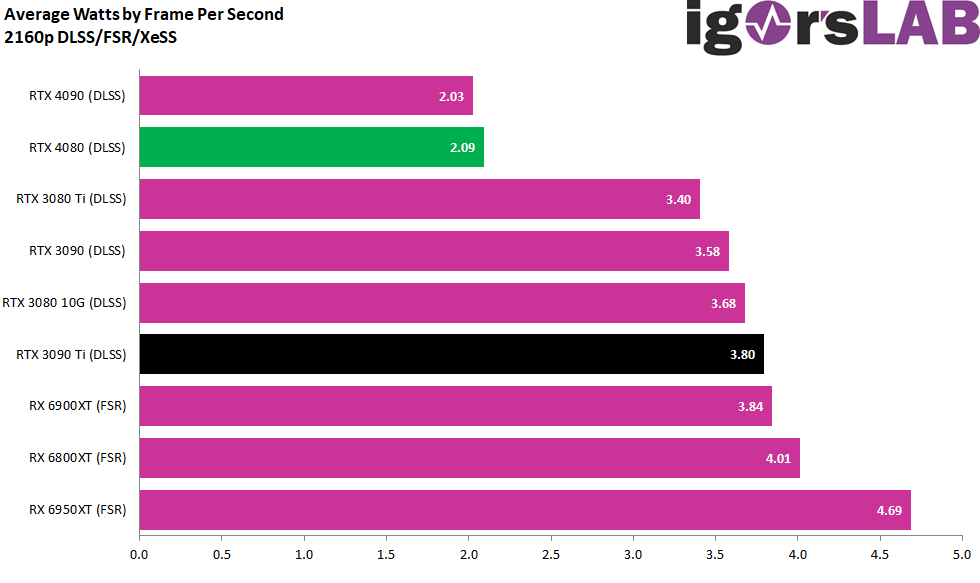

Kommen wir nun zur Effizienzauswertung, als der Menge an Watt, die man für eine bestimmte Gaming-Performance in Form eines FPS benötigt, also der Metrik Watt pro FPS. Das ist zwar umgekehrt zu dem, was die Hersteller nutzen, aber ich denke mal, mit den größeren Zahlen vorm Komma tut man sich deutlich einfacher. Und weil ich Euch nicht zum Taschenrechner zwingen möchte, gibt es die Prozentpunkte jetzt von mir als Rechenservice gleich wieder mit dazu. Beginnen wir in QHD. Die Effizienz der GeForce RTX 4080 steigt gegenüber der GeForce RTX 3090 Ti um sagenhafte 91 Prozentpunkte! Der Effizienzvorsprung gegenüber der (werksübertakteten) Radeon RX 6950XT liegt sogar bei fast 100 (!) Prozentpunkten. Überholen ohne aufzuholen? AMD wird hier eigentlich fast schon zaubern müssen, aber die Hoffnung stirbt ja bekanntlich zuletzt.

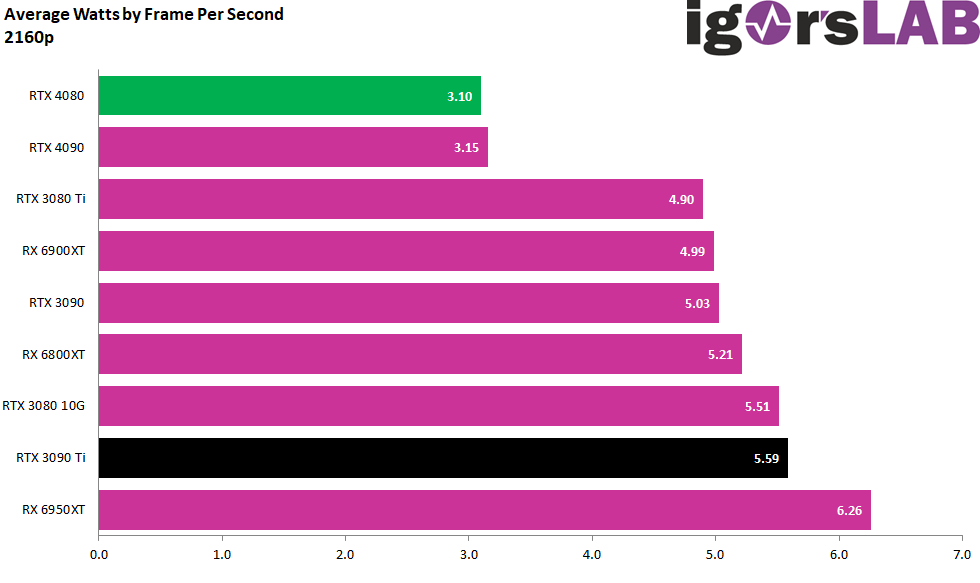

Und was passiert jetzt in Ultra-HD? Die neue GeForce RTX 4080 liegt noch reichlich 80 Prozentpunkte vor der GeForce RTX 3090 Ti, denn Kraft kommt ja von Kraftstoff und in Ultra-HD wird die Karte weniger von der CPU limitiert. Freie Fahrt also. Allerdings steigt hier die Effizienz gegenüber der in UHD etwas schwächelnden Radeon RX 6950XT sogar auf deprimierende 102 Prozentpunkte an! Das ist quasi fast schon eine energetische Hinrichtung.

Mit Hilfe diverser Verfahren kann man auch Ultra-HD spielbarer gestalten, doch wie wirkt sich das auf die Effizienz aus? Hierliegt übrigens erstmals die GeForce RTX 4090 hauchdünn vorn. Aber die GeForce RTX 4080 knöpft der GeForce RTX 3090 Ti dank der neuen Tensor-Cores 87,2 Prozentpunkte ab und das mit den 131 Prozentpunkten Vorsprung auf die Radeon RX 6950XT hätte ich lieber mit rotem Kopf unter den Teppich gekehrt. Hier kann man wirklich nur beten, dass AMD eine adäquate Lösung eingefallen ist und wir bald mehr wissen.

Zusammenfassung und Fazit

Auch wenn der heutige Artikel nur der Beginn ist und wir noch mit einem weiteren Follow-Up interessante Ergebnisse und Auswertungen liefern werden (Danke hier schon mal an Fritz Hunter, der seit Tagen nichts anderes mehr macht!), das erste Bild ist auch bei der GeForce RTX 4080 FE wieder überraschend positiv. Denn NVIDIA bietet seit Langem mal wieder eine neue Generation, die in der Effizienz extrem zulegen konnte. Die Mindestens 80 Prozentpunkte gegenüber einer sogar noch etwas langsameren GeForce RTX 3090 Ti ist geradezu (positiv) erschreckend.

Und es lohnt sich auch, neben den Balken auch das Gesamtpaket zu betrachten und den Preis erst einmal außen vor zu lassen. Neben der deutlichen Performance-Steigerung und der wirklich hervorragenden Effizienz (im Rahmen der erbrachten Gaming-Performance) bietet Ada nämlich weitaus mehr, als nur eine gesteigerte Rasterleistung in den üblichen Pixelorgien! Das gesamte Feature-Set aus extrem gesteigerter Raytracing-Leistung, DLSS 3.0 und Reflex wird begleitet durch andere Hardware-Lösungen wie den dualen Video-Encoder (NvEnc), der sogar parallel Aufgaben übernehmen kann. Zu DLSS 3.0, einer performanten Weiterführung von DLSS auf Basis der neuen Architektur, wird es morgen noch mehr Details geben, denn es zeigt auch, in welche Richtung es noch gehen könnte und dass man am Ende sicher auch mit kleineren Karten und deutlich weniger Energie noch ordentliche Resultate erzielen kann.

Gleichzeitig Streamen und Aufzeichnen sind da nur eine Facette, denn die insgesamt gesteigerte Rechenleistung der GeForce RTX 4080 einschließlich der Tensor-Cores wird man auch im Produktiveinsatz sehr zu schätzen wissen. Blender ist da nur ein Beispiel von vielen, denn viele der CUDA-basierten Plugins der Standard-Software profitieren ungemein von der neuen Leistungsfähigkeit. Auch hier gibt es viele interessante Themen, die geradezu nach einem Nachtest rufen. Wer zudem auf KI-basierte Spielereien steht, findet z.B. mit NVIDIA Broadcast eine nette Lösung für Videokonferenzen oder Video- bzw. Audio-Chats. OBS unterstützt eine ganze Reihe dieser Features und auch der AV1-Encoder ist dort keine schlechte Sache.

Als Reviewer ist man natürlich dazu verpflichtet, emotionslos und objektiv zu testen bzw. zu urteilen. Aber in Anbetracht einer solchen (für Außenstehende eher nicht zu erwartenden) Leistungs- und Effizienzexplosion darf man dann doch schon einmal so etwas wie Begeisterung zeigen. Und nun kommt das ABER. Mit den 1469 Euro UVP für die sogenannten „MSRP-Karten“, die ja jeder Boardpartner liefern muss, liegen wir immer noch in einer Preis-Liga, die für die meisten Käufer komplett unerschwinglich ist, leider.

Es wird also vor allem darauf ankommen, wie die noch folgenden Karten nach unten hin skalieren werden. Die bereits für die CES kolportierte (und bereits fertige) GeForce 4070 Ti 12GB müsste sich für eine echte Akzeptanz preislich der 1000-Euro-Marke nähern oder diese sogar unterschreiten, allein mir fehlt der Glaube. Da wird man abwarten müssen, was AMD im Dezember launcht, wie sich dort die Preise und vor allem auch die Verfügbarkeit entwickeln. Je besser RDNA3 performt, umso höher ist auch die Wahrscheinlichkeit sinkender Preise bei NVIDIA und umgekehrt.

Bis dahin dürfen wir grübeln, warum NVIDIA zwischen der brachialen GeForce RTX 4090 24GB und der 60%-Lösung in Form der GeForce RTX 4080 16GB so eine riesige Lücke lässt. Denn Platz für eine GeForce RTX 4080 Ti wäre da wirklich noch mehr als genug und man könnte auch die Radeon 7900XTX wieder galant deckeln. Aber heute und hier geht es allein um die GeForce RTX 4080, die ich Euch in Form der NVIDIA GeForce RTX 4080 FE 16GB vorgestellt habe. Und diese Karte ist echt eine richtig effiziente Pixelbeschleunigerin. Mehr muss man dazu auch heute nicht mehr schreiben.

Als Vorschau, was da noch in den folgenden Tagen kommt, kann ich schon mal eine sehr umfangreiche Betrachtung zu DLSS 3.0, den Latenzen und Reflex mit sehr vielen Video-Vergleichen anteasern. Übertakten geht natürlich auch, aber ich bin schon mal aufs Forum gespannt, wann einer die erste „unter-200-Watt-Karte“ präsentiert. Ansonsten hoffen wir zunächst mal auf eine breite und gute Verfügbarkeit der neuen Karte und einen etwas zurückhaltenderen Einzelhandel. Und mal so ganz unter uns: bei den aktuellen Ampere-Karten gibt es aktuell sicher immer noch auch das eine oder andere Schnäppchen zu machen, wenn man nicht auf die neuen, kleineren Karten warten möchte.

Die Grafikkarte wurde von NVIDIA für diesen Test zur Verfügung gestellt. Die einzige Bedingung war die Einhaltung der Sperrfrist, eine Einflussnahme oder Vergütung fand nicht statt.

- 1 - Einführung, technische Daten und Technologie

- 2 - Test System im igor'sLAB MIFCOM-PC

- 3 - Teardown: Platine und Kühler

- 4 - Gaming-Performance WQHD (2560 x 1440 Pixel)

- 5 - Gaming-Performance UHD (3840 x 2160 Pixel)

- 6 - Gaming-Performance UHD + DLSS/FSR/XeSS (3840 x 2160 Pixel)

- 7 - DLSS 3.0 und die längsten Balken

- 8 - NVIDIA Reflex und Latenzen

- 9 - Workstation Grafik und Rendering

- 10 - Leistungsaufnahme und Lastverteilung

- 11 - Lastspitzen, Kappung und Netzteilempfehlung

- 12 - Temperaturen, Taktraten, Lüfter und Lautstärke

- 13 - Zusammenfassung und Fazit

168 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Veteran

1

Veteran

Mitglied

Urgestein

Veteran

Moderator

Veteran

Urgestein

Mitglied

Veteran

Urgestein

Veteran

Mitglied

Neuling

Urgestein

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →