Die Balken werden immer länger: NVIDIA DLSS 3.0

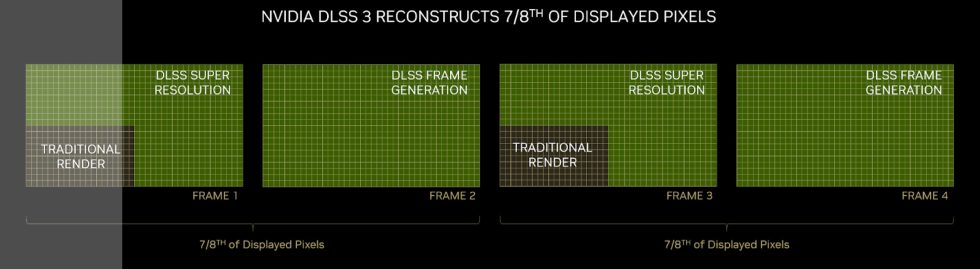

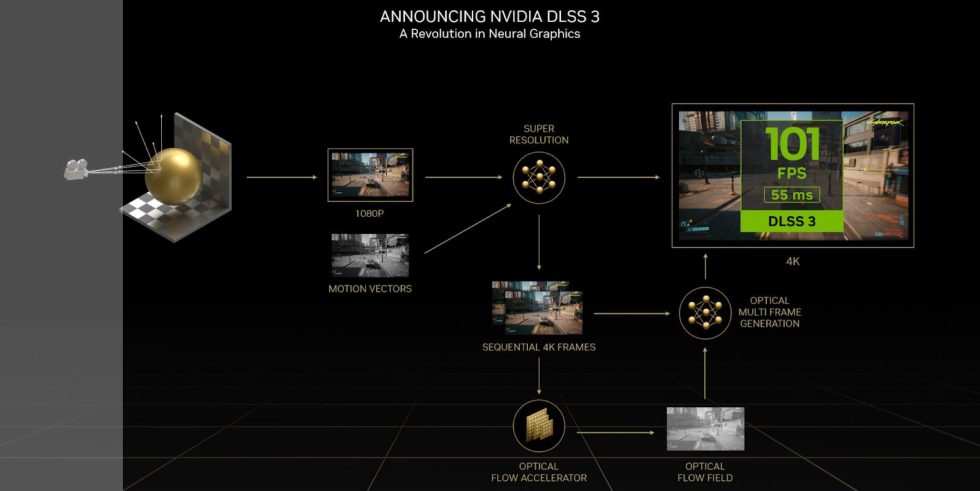

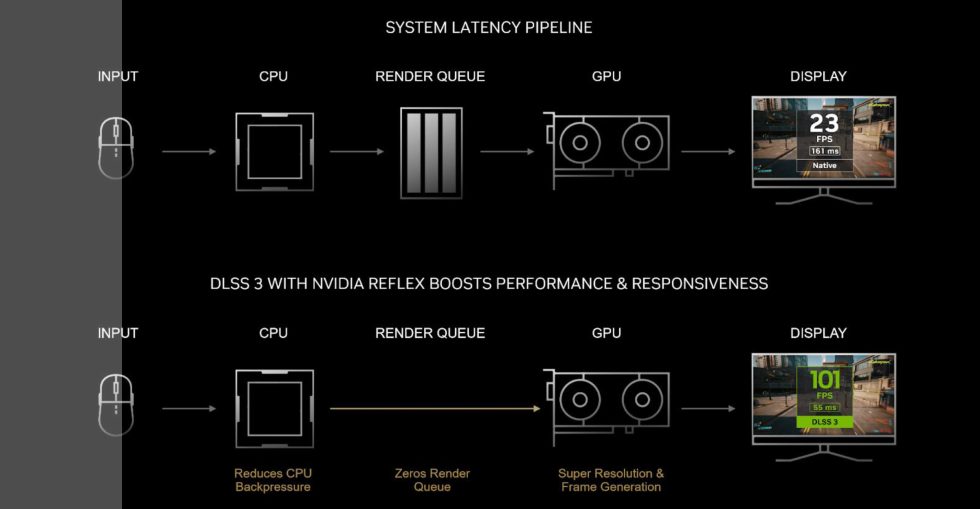

Die Frage ist natürlich: Was ändert bzw. verbessert sich jetzt mit DLSS 3.0? Zusammengefasst besteht DLSS 3.0 ja aus drei Bestandteilen: 1. Super Resolution (Upscaling), 2. der Frame Generation und 3. NVIDIA Reflex (dazu komme ich auf der nächsten Seite noch). Die Besonderheit hierbei ist: die Frame Generation. Wer diese aktiviert, der erhält zusätzlich über den „Ada-Only“ Optical Flow Accelerator eine Art von Zwischenbildberechnung. (alle folgenden Bilder stammen von NVIDIA)

Somit dürfte verständlich sein, dass DLSS 3.0 nur mit ADA-GPUs möglich sein wird. Das ist sehr schade und irgendwie auch nicht gerade kundenfreundlich gegenüber den Käufern einer RTX 3000 Karte aber eine Art Kollateralschaden im Rahmen des technischen Fortschritts. Na ja, immerhin können die Besitzer der 2000er bzw. 3000er Karten DLSS 2.x und NVIDIA Reflex (geht bis Maxwell zurück) nutzen.

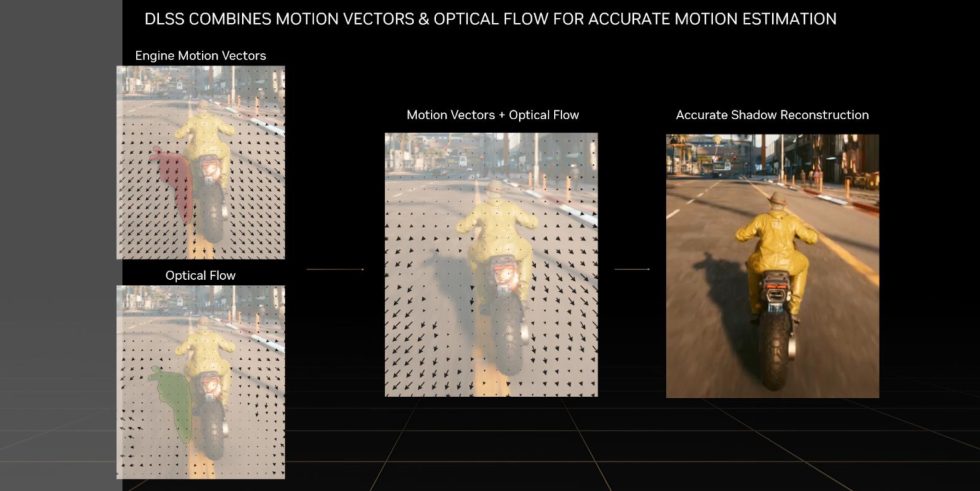

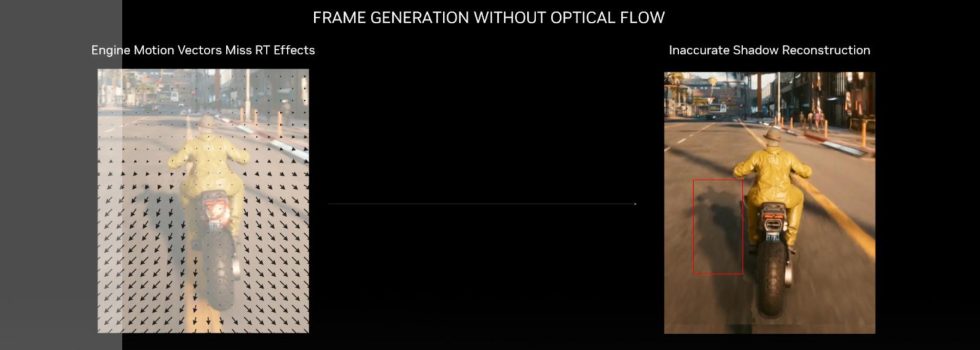

Ab jetzt verfügt der geneigte NVIDIA Kunde einer RTX 4000 mit den Tensor-Kernen der vierten Generation – neben dem AI-Netzwerk (zum Anlernen der Spielegrafik) und der bisher bekannten DLSS 2.3 Features (die die Super Resolution bilden) – auch noch über die neue Frame Generation. Diese besteht letztendlich aus vier Inputs: Dem aktuellen und vorhergehendem Frame, den Motion Vektoren der Game-Engine und der Optical Flow Acceleration. Diese analysiert zwei sequenzielle Frames im Spiel und berechnet daraus ein optisches Bewegungsfeld. Dabei werden sämtliche Informationen (Partikel, Licht, Schatten, Reflektionen usw.) mit berücksichtigt.

Sonst würde man bei schnellen Bewegungen wieder Ghosting-Effekte sehen. Siehe Bild unten…

NVIDIA hat mit DLSS 3.0 – das bisher bekannte DLSS 2.3 – noch erweitert und schafft es mittels „Zwischenbildberechnungen“ – insbesondere im CPU-Limit – noch mehr FPS auf den Monitor zu zaubern. So wird es zumindest von NVIDIA beworben. Doch stopp, geht das am Ende nicht auf die Latenzen? Laut NVIDIA soll das ganze Rechenwerk ja nur 10 ms Latenz kosten (je nach Spiel-Engine und Auflösung auch etwas mehr), weshalb man sich für eine Implementierung von Reflex in alle Spiele mit DLSS 3.0 entschieden hat. Somit ist Reflex jetzt ein fester Bestandteil von DLSS 3.0 geworden. Für mich gehört Reflex eigentlich grundsätzlich in jedes Spiel, aber nicht jeder Publisher wird hier NVIDIA wohl unvoreingenommen folgen.

DLSS 3.0 in der Praxis

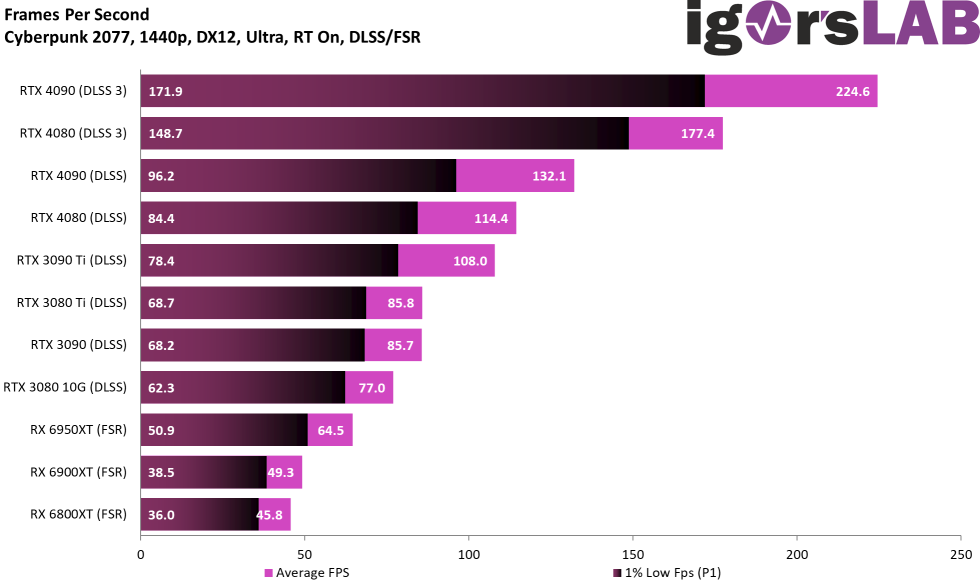

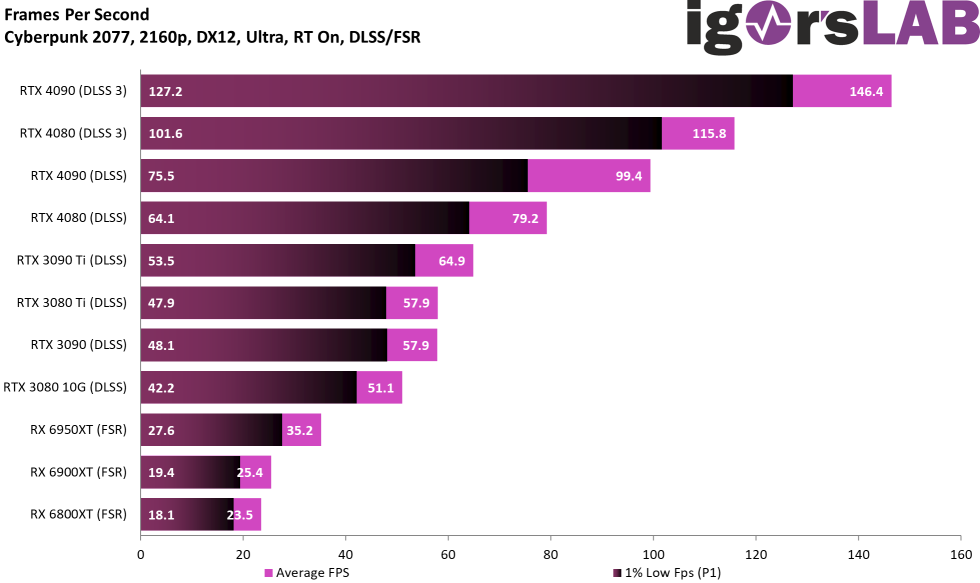

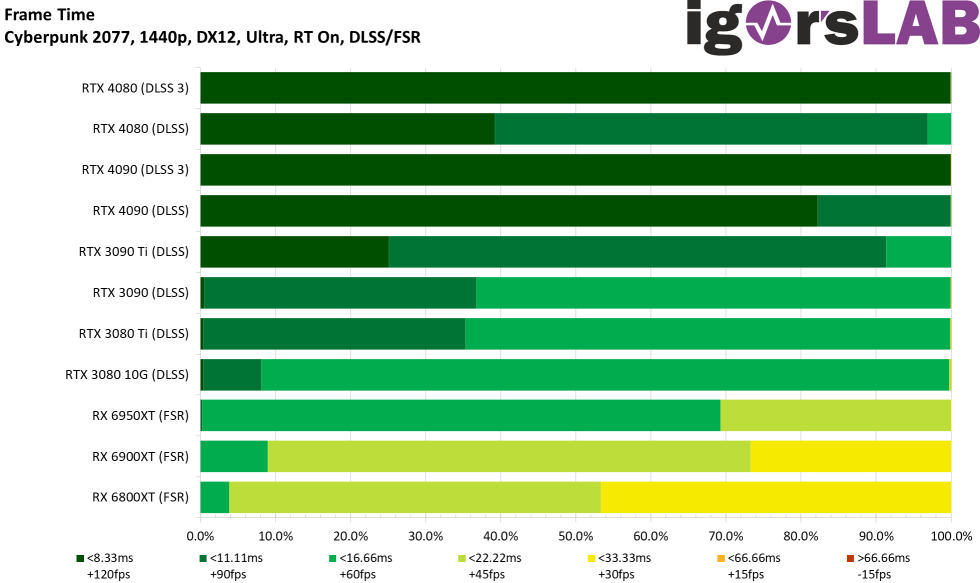

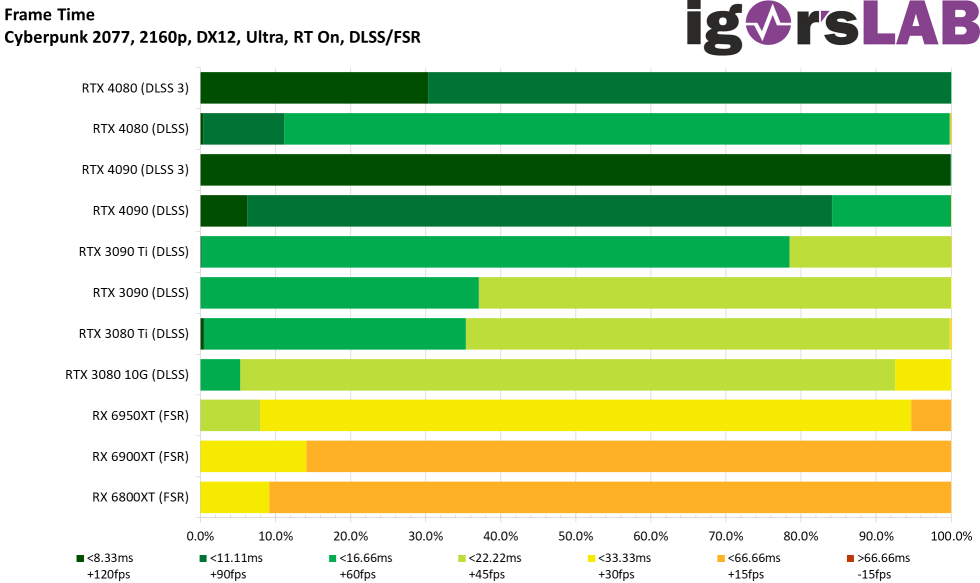

Man kann sicher vieles behaupten, aber man kann es auch messen. Ich nehme einfach einmal einen Teil des nächsten Artikel vorweg und füge hier zumindest die passenden Benchmarks zu Cyberpunk 2077 mit ein, damit wir wissen, worum es in der Praxis eigentlich geht. In QHD erreicht man mit DLSS 3.0 eine erstaunliche FPS-Zunahme im Vergleich zu DLSS 2.3. Über die Latenzen reden wir dann auch den nächsten Seite, denn das ist weniger Overhead als befürchtet. Rein Optisch ist das jedenfalls mehr als ok, denn man sieht den Schmu eigentlich gar nicht. In UHD hat man den Vorteil, dass z.B. ein passendes OLED-Panel wie beim LG mit den ausgelobten 120 Hz syncen kann, was dem Auge durchaus gut tut. Für QHD ist aber sogar noch die GeForce RTX 4080 stark genug, da reicht auch DLSS pur.

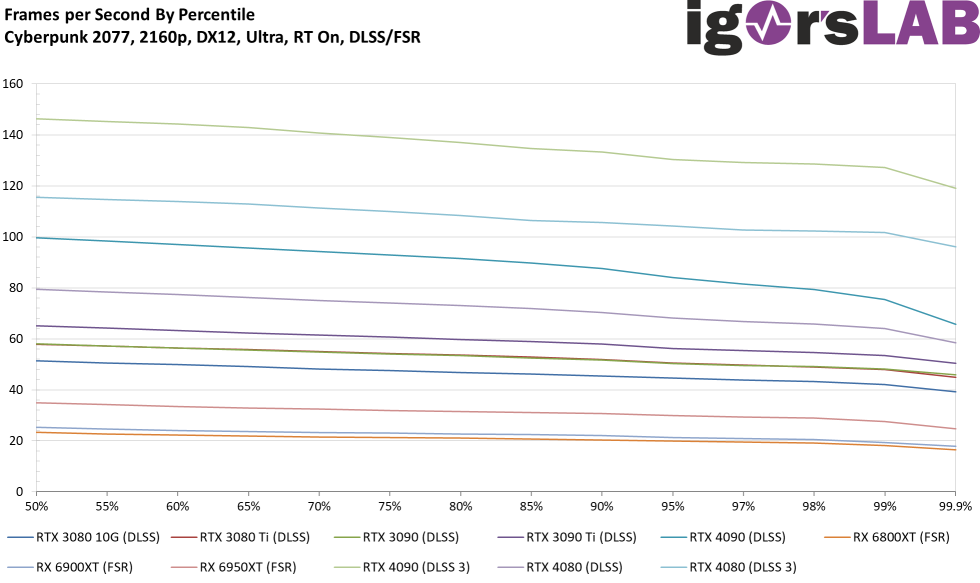

Auch die Perzentile zeigen den immensen FPS-Zuwachs oberhalb des P1, wobei auch hier der Benefit in UHD deutlich höher ausfällt.

Bei den Frame Times liegt die Karte mit DLSS 3.0 ebenfalls deutlich vorn, was nicht verwundert:

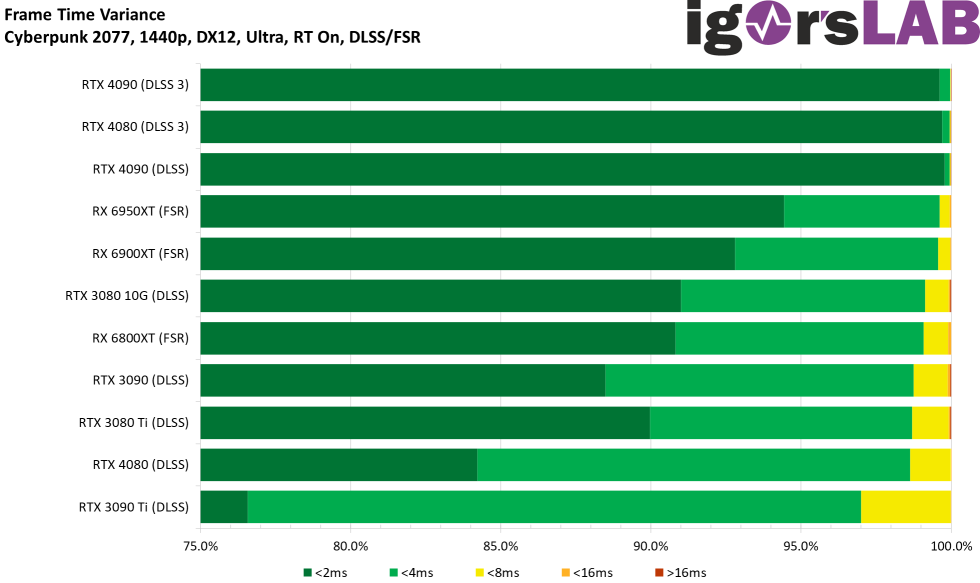

Auch bei den Varianzen kann DLSS 3.0 ordentlich punkten! Betrachten wir einmal die hohe UHD-Auflösung, dann sehen wir, dass sich die RTX 4090 mit DLSS sogar der Radeon RX 6950XT beugen muss, wobei deren Bildqualität mit FSR deutlich schlechter ausfällt. Aber es läuft etwas smoother. Mit DLSS 3.0 stellt sich die Frage nicht, hier läuft alles butterweich. Man liegt dann bei den Latenzen zwar in etwa 10 ms zurück, aber das sehen wir gleich noch. rein subjektiv sieht das Bild samt Verlauf deutlich besser aus als mit nur DLSS 2.3.

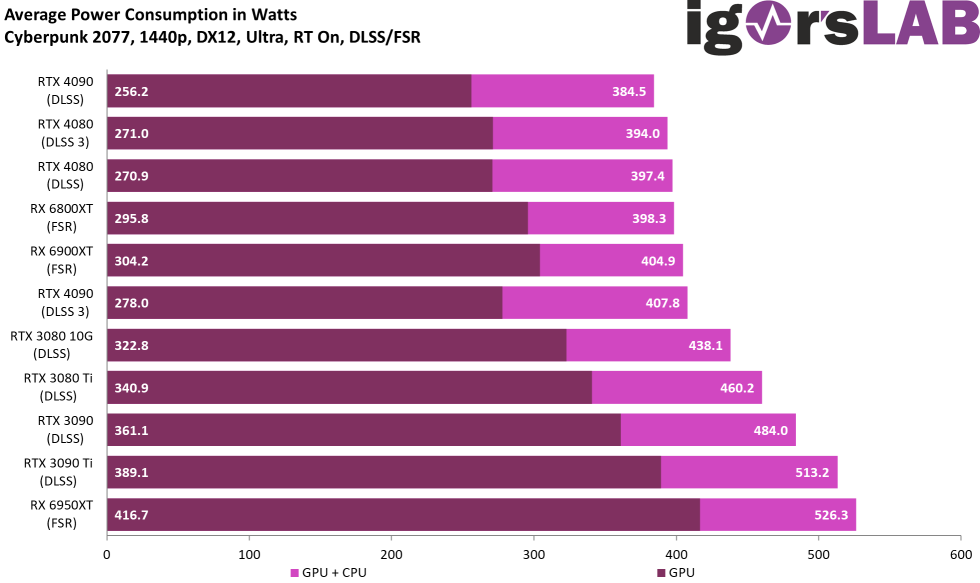

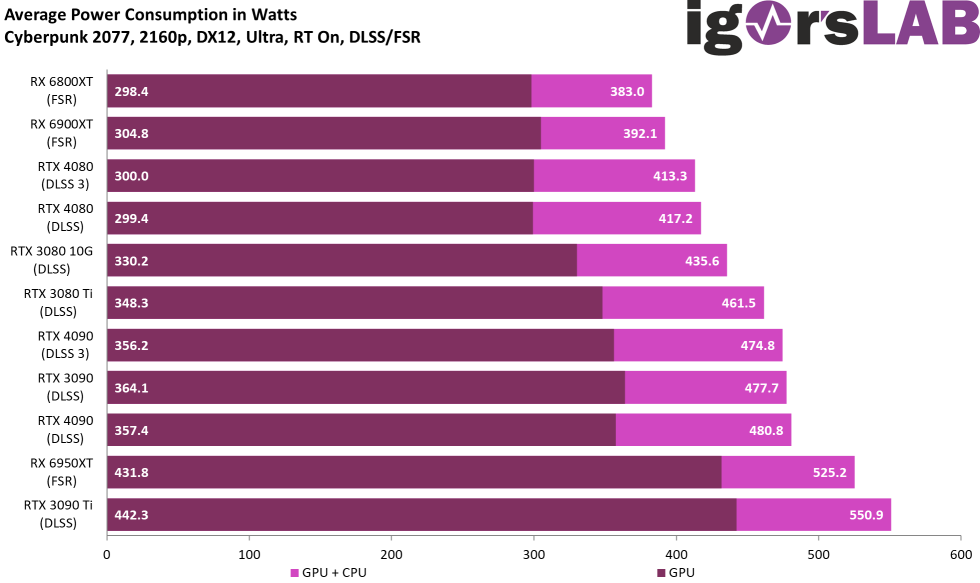

Die GeForce RTX 4000 Karten nehmen mit DLSS meist weniger Leistung auf als mit DLSS 3.0, da auch die Framerate etwas niedriger ausfällt und weniger berechnet werden muss (keine Frame Generation).

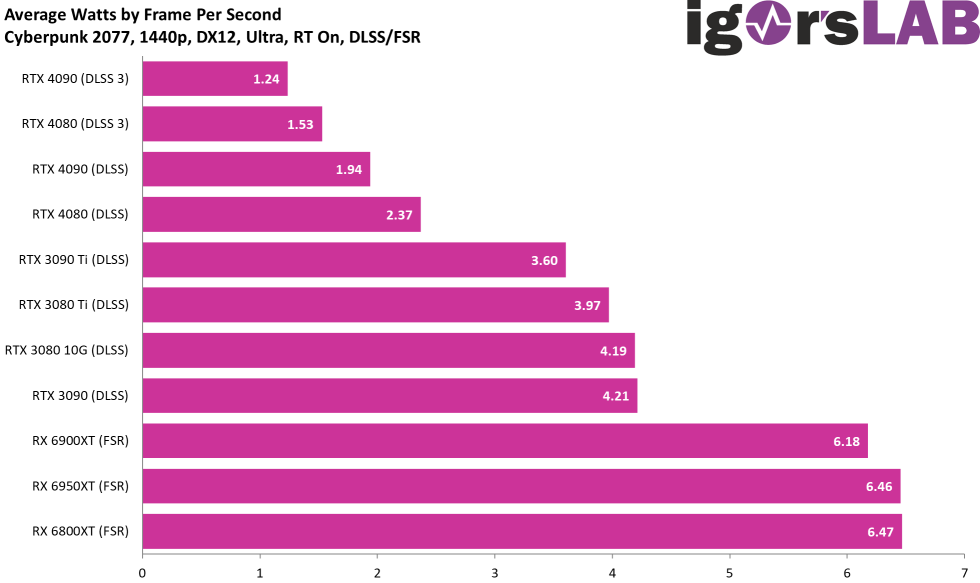

Das merkt man dann natürlich abschließend auch an der Effizienz, die durch DLSS 3.0 noch einmal zulegen kann. Es gewinnt immer die RTX 4090 mit DLSS 3.0, vor der RTX 4080 und dann beiden Karten noch einmal mit DLSS und dem Rest

Und weil ich ja auch ein Augenmensch bin, darf auch die Optik nicht zu kurz kommen. Hier gibt es noch als Teaser einen Ausschnitt aus unserem Special, das übermorgen beginnt. Das Video ist natürlich nur ein kleiner Teil von vielen, aber es lockert jetzt nach so viel Theorie auch mal etwas auf:

Click for full screen in a separate Window

Weiterführende Links

Wie DLSS 2.x funktioniert, dass hatten wir bereits im letzten Jahr lang und breit thematisiert. Daher verlinke ich den Artikel von damals noch einmal am Schluss dieser Seite (auf Seite 2 werdet ihr dort dann komplett fündig).

NVIDIA DLSS und AMD FSR im DIREKTEN Vergleich | Performance-Boost und Qualitätcheck in der Praxis

- 1 - Einführung, technische Daten und Technologie

- 2 - Test System im igor'sLAB MIFCOM-PC

- 3 - Teardown: Platine und Kühler

- 4 - Gaming-Performance WQHD (2560 x 1440 Pixel)

- 5 - Gaming-Performance UHD (3840 x 2160 Pixel)

- 6 - Gaming-Performance UHD + DLSS/FSR/XeSS (3840 x 2160 Pixel)

- 7 - DLSS 3.0 und die längsten Balken

- 8 - NVIDIA Reflex und Latenzen

- 9 - Workstation Grafik und Rendering

- 10 - Leistungsaufnahme und Lastverteilung

- 11 - Lastspitzen, Kappung und Netzteilempfehlung

- 12 - Temperaturen, Taktraten, Lüfter und Lautstärke

- 13 - Zusammenfassung und Fazit

168 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Veteran

1

Veteran

Mitglied

Urgestein

Veteran

Moderator

Veteran

Urgestein

Mitglied

Veteran

Urgestein

Veteran

Mitglied

Neuling

Urgestein

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →