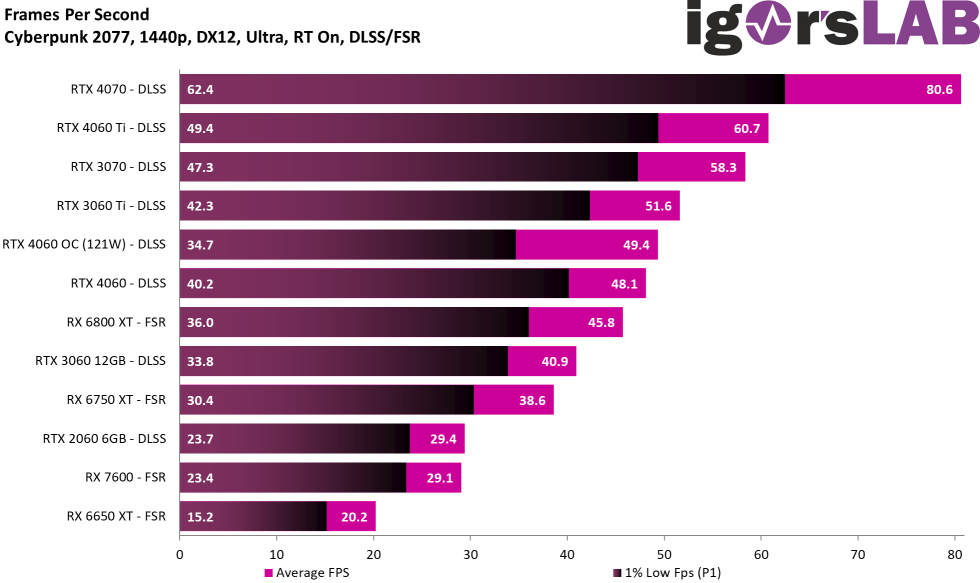

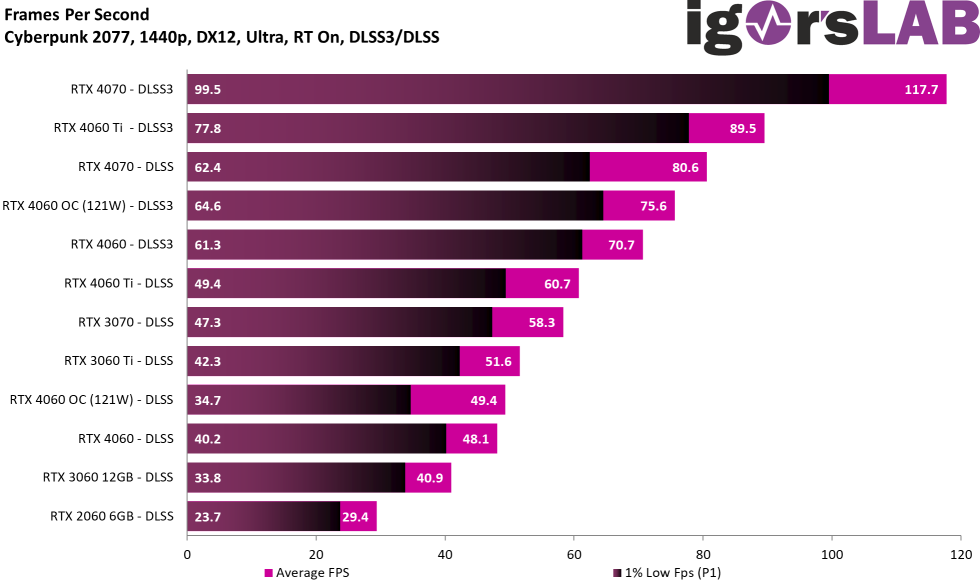

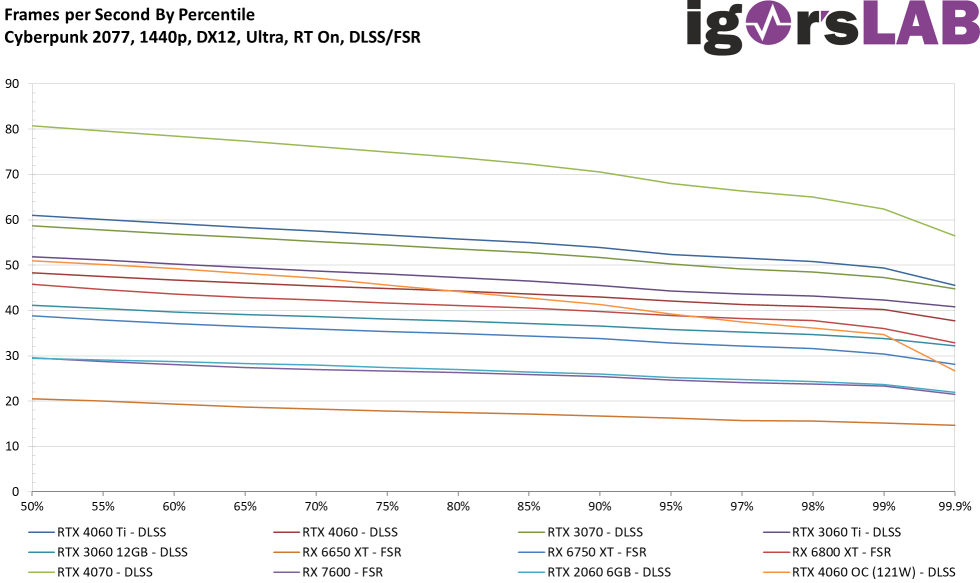

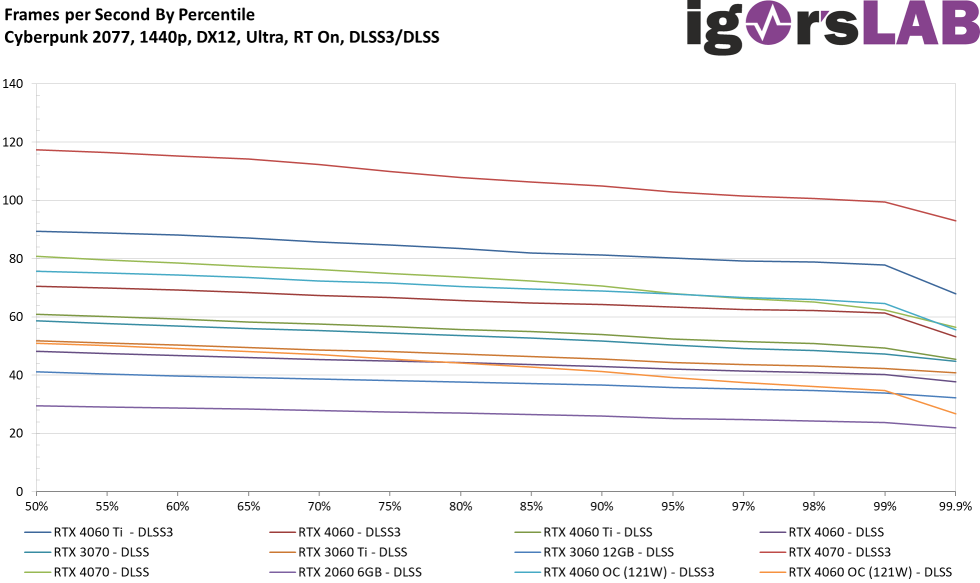

Ich habe aus Zeitgründen und weil auf YouTube bereits alles vorab berichtet wurde zwar nur ein Spiel herausgesucht, aber es bietet DLSS, DLSS3 und FSR, so dass es Vergleiche zwischen DLSS und FSR, sowie DLSS mit und ohne Frame Generation bietet. ich bin so fair, das trotzdem noch zu bringen, auch wenn es Überwindung gekostet hat. Die Balken sprechen wie immer für sich, zum Thema Latenzen komme ich gleich noch gesondert. Betrachten wir zunächst die FPS Zahlen. Und Oops, man betrachte einmal die min FPS und vergleichen zwischen DLSS und DLSS 3.0!

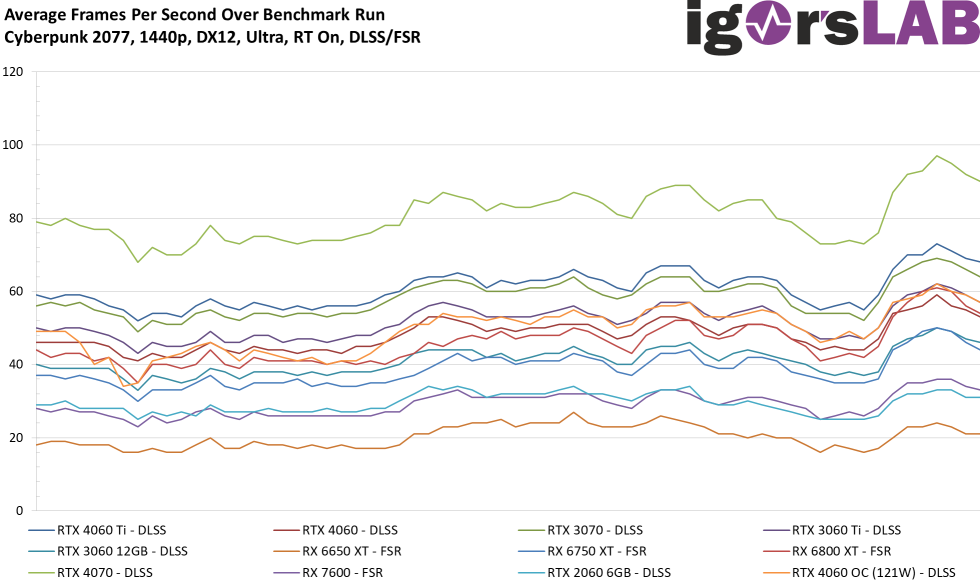

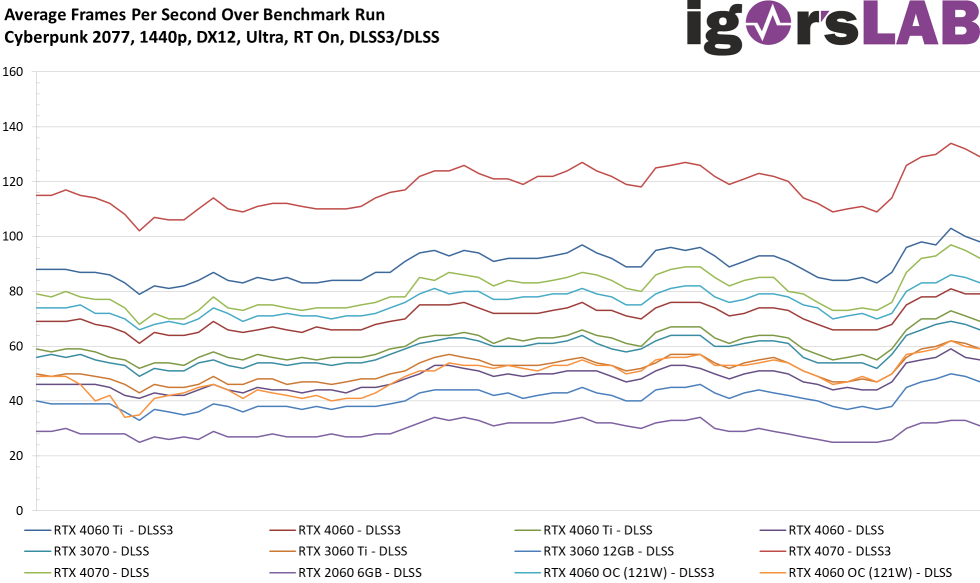

Deshalb schauen wir nun genauer auf beide Vergleiche als Kurvendiagramme:

Perzentile im Verlauf

Die einzelnen Perzentile sind ebenfalls hochinteressant, weil es ja noch mehr abdeckt als nur das P1 Low:

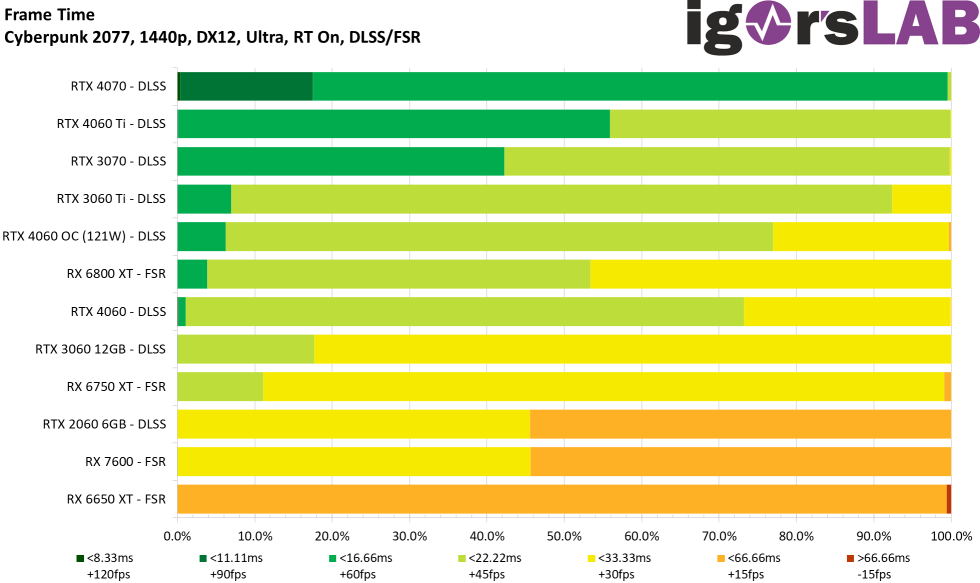

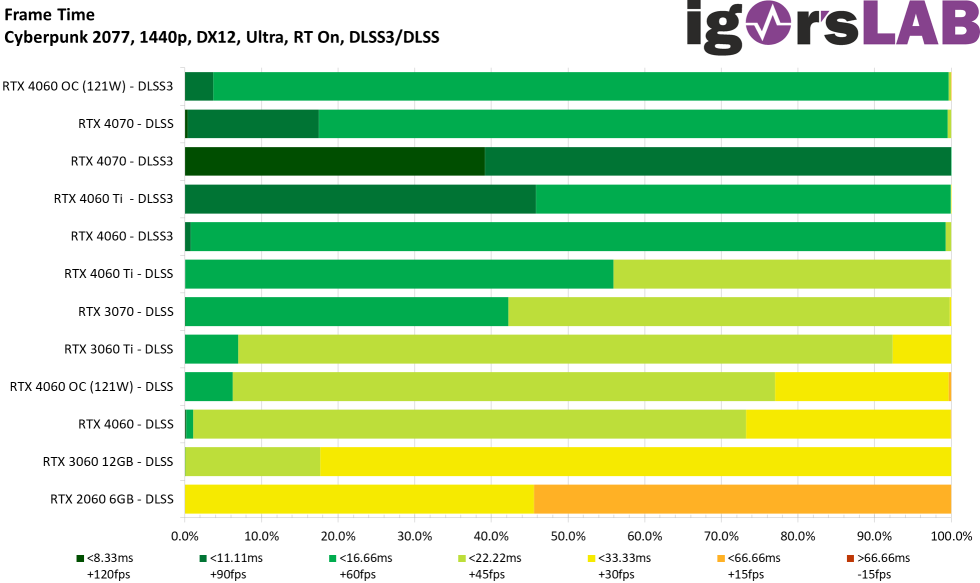

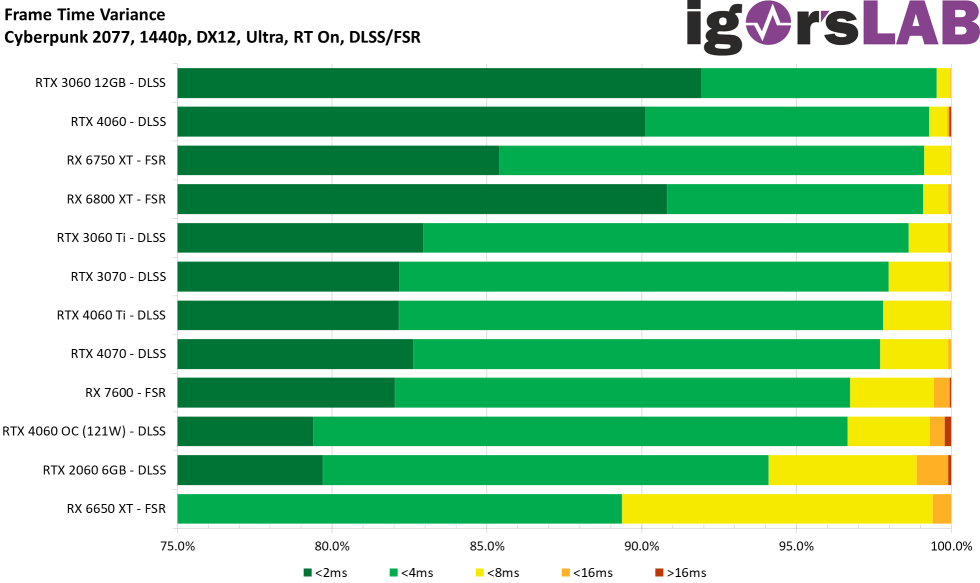

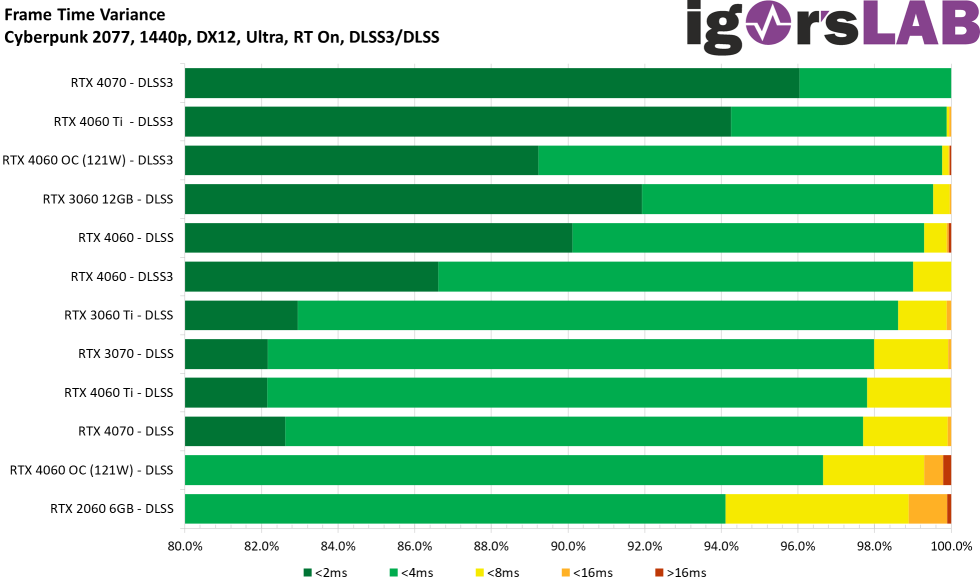

Frame Times als prozentuale Balken

Varianzen im direkten Vergleich

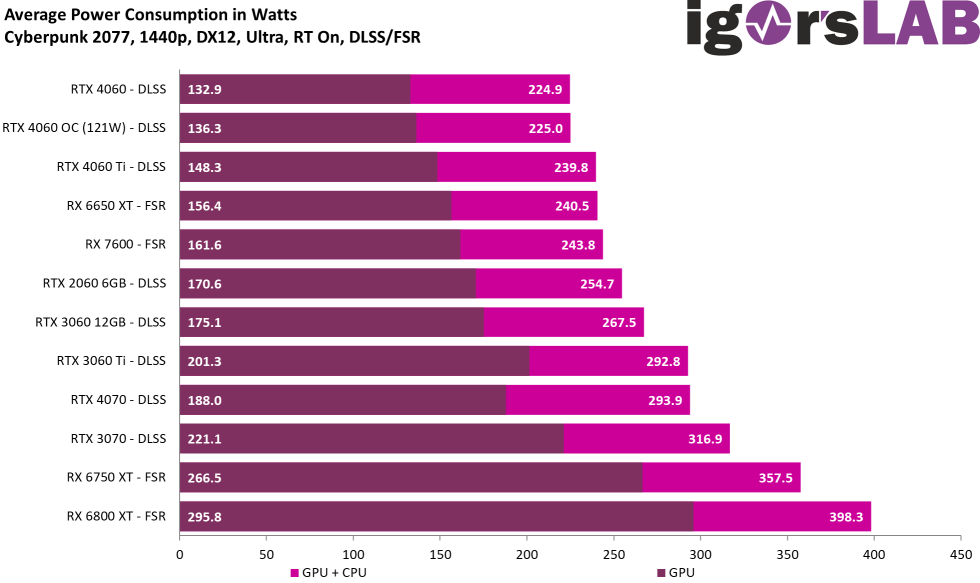

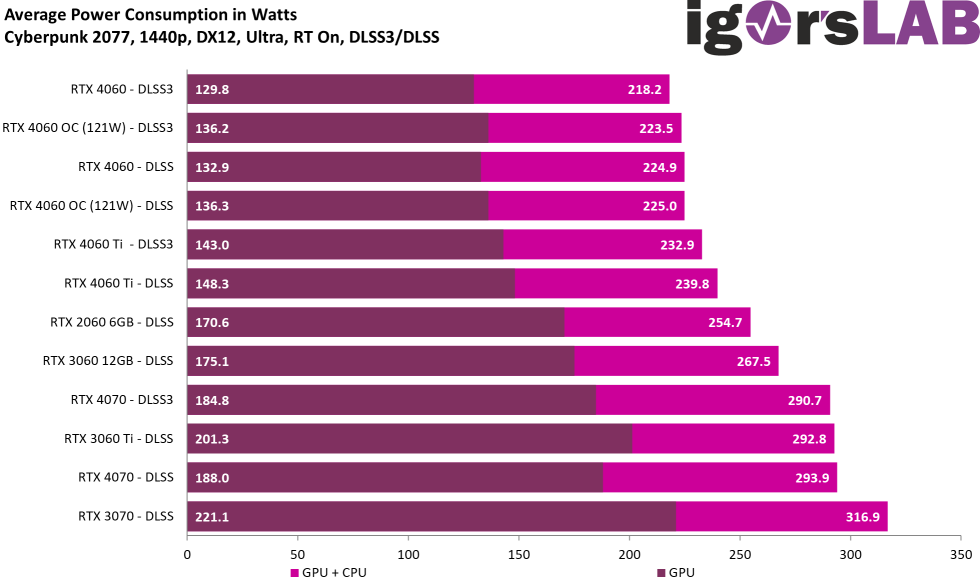

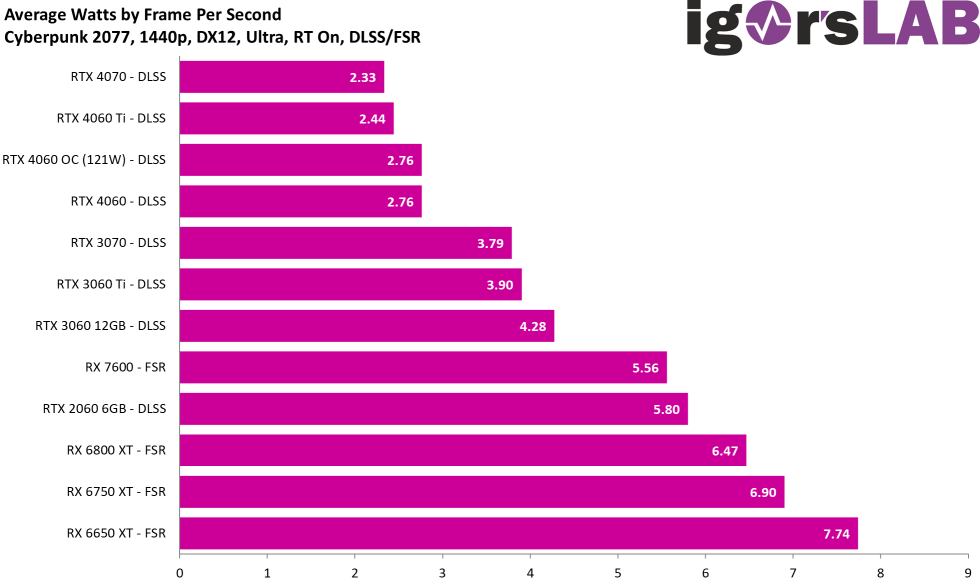

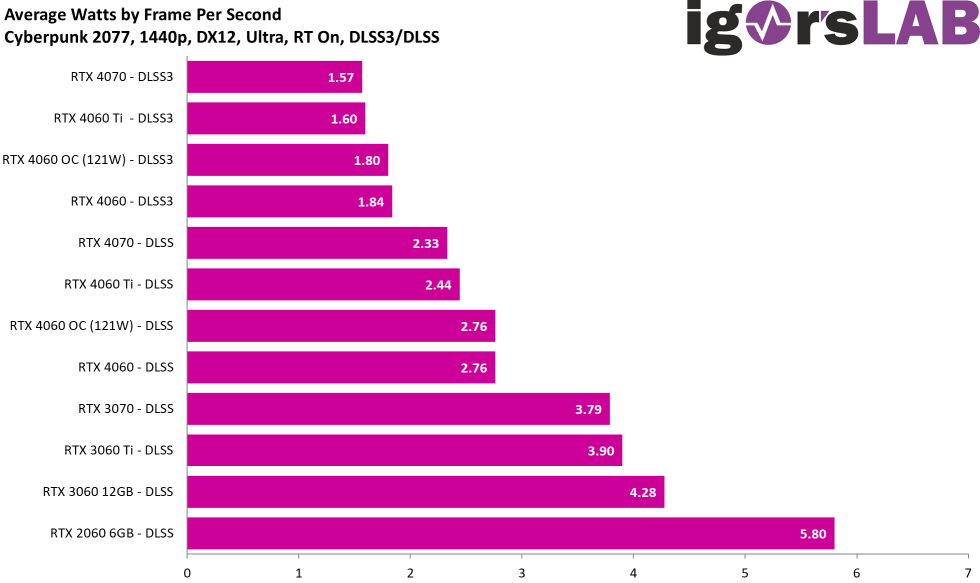

Leistungsaufnahme der einzelnen Karten im Benchmark

Effizienz der einzelnen Karten im Benchmark

Und hier sind abschließend noch zwei weiterführende Links zum Thema DLSS 3.0:

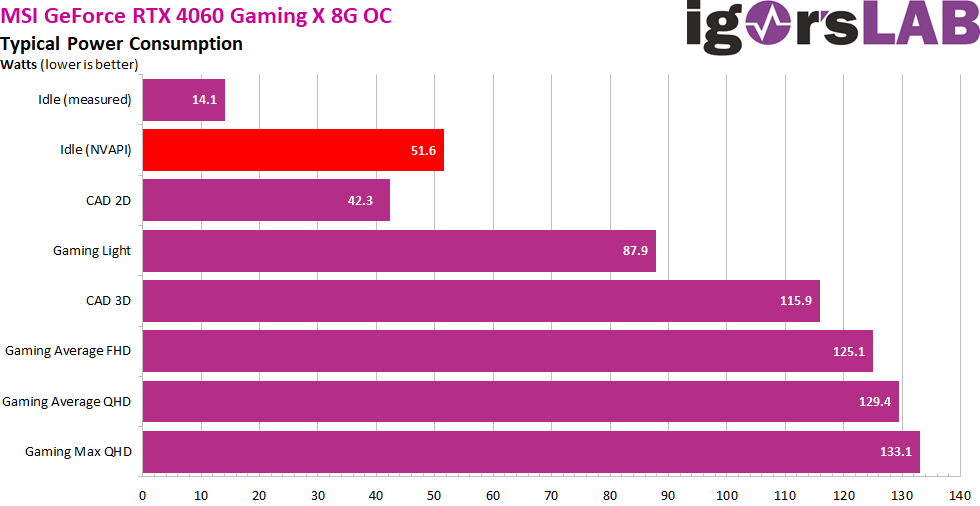

Leistungsaufnahme im Werkszustand als Zusammenfassung

Die rund 52 Watt im Idle sind eine Telemetrie- und Treiber-Luftnummer, aber dazu schrieb ich ja bereits auf Seite Eins eine Vorbemerkung. Ich habe die gesamte Problematik der Leistungsaufnahme unter Last, also sowohl das mit den deutlich höheren Werten im Gaming (bis zu 133 Watt z.B. in Cyberpunk 2077 oder Horizon Zero Dawn) mit der Nicht-OC-Karte als auch die irrsinnig hohen Telemetrie-Werte im Idle, bereits letzte (!) Woche an NVIDIA kommuniziert, jedoch bis heute keine befriedigende Antwort erhalten.

Wir sehen übrigens sehr schön, dass die volle TBP von den freigegebenen 121 Watt fast immer überschritten wird. Selbst die Messwerte von NVIDIAs PCAT und Powenetics V2 bestätigen meine Ergebnisse und widerlegen eindeutig NVIDIAs eigene Werte über die NVAPI Schnittstelle. Wer sich das ausgedacht hat, hätte doch wissen müssen, dass so etwas auffällt. Aber es passt gut zur PR-Folie mit dem lustigen Stromsparplan.

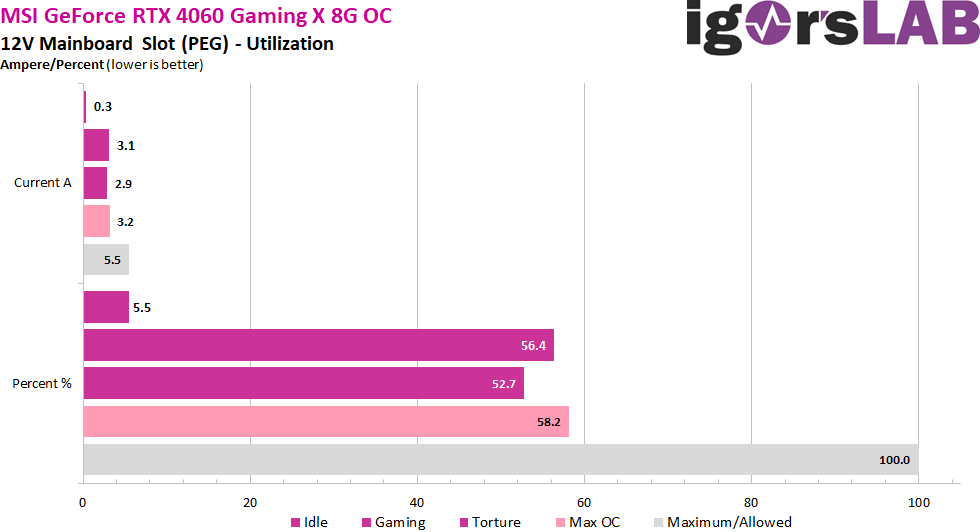

Lastverteilung zwischen PCIe-Slot und den PCIe-Buchsen

NVIDIA nutzt vor allem beim Gaming den PCIe-Slot ein wenig mit. Aber man liegt bei den fließenden Strömen noch weit unter dem, was mit 5.5 Ampere maximal erlaubt ist, auch beim erhöhten Power Limit.

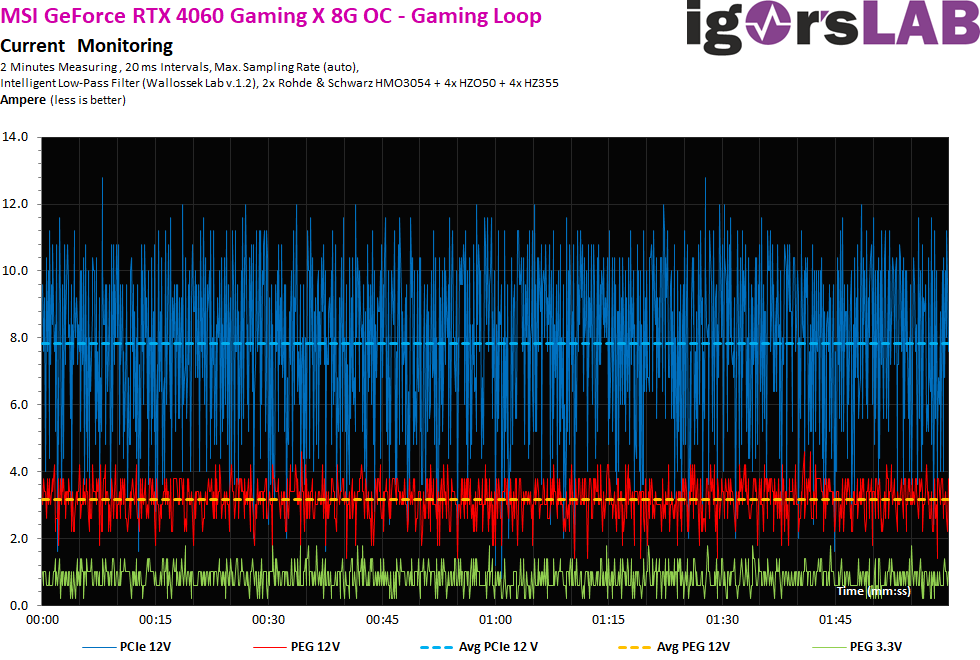

Grobe 20-ms-Intervalle

Schauen wir uns zunächst einmal die fließenden Ströme an. Gemessen wurde in gröberen 20-ms-Intervallen, also rund 50 Mal pro Sekunde, um die Last am Supervisor-Chip der Netzteile zu simulieren (Abschaltung). Wir sehen, dass auch kurze Lastspitzen bei spätestens 13 A abgekappt werden. aber eine wirkliche Begrenzung sieht anders aus.

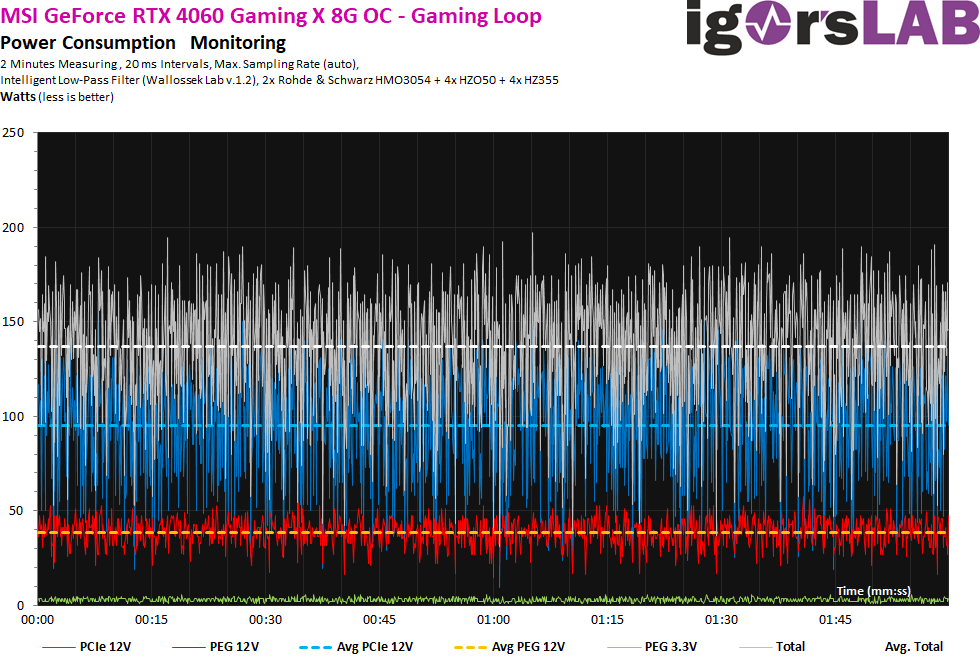

Trotzdem müssen wir noch einen Blick auf die Spannungen werfen, bzw. das Produkt aus Spannung und Stromfluss. Ich schrieb ja bereits, dass ich hier an verschiedenen Netzteilanschlüssen gemessen habe, auch wenn sich am Ende auf der Platine der Grafikkarte alle Anschlüsse wieder irgendwie treffen. Das, was wir hier jetzt als viel deutlichere Schwankungen und Spitzen erkennen können, liegt am partiell ein klein wenig übervoltenden Netzteil und somit an der Spannung und nicht den Strömen. Das ist technisch bedingt, jedoch kein Beinbruch. Wir sehen jedoch auch, dass die wenigen Spitzen bei 200 Watt nicht durch den fließenden Strom bedingt ist (Grafikkarte), sondern eigentlich vom Netzteil her resultieren! Das liegt auch an der Topologie und vor allem dem eher mickrigen Eingangsfilter mit nur einer Spule auf der einzelnen Rail.

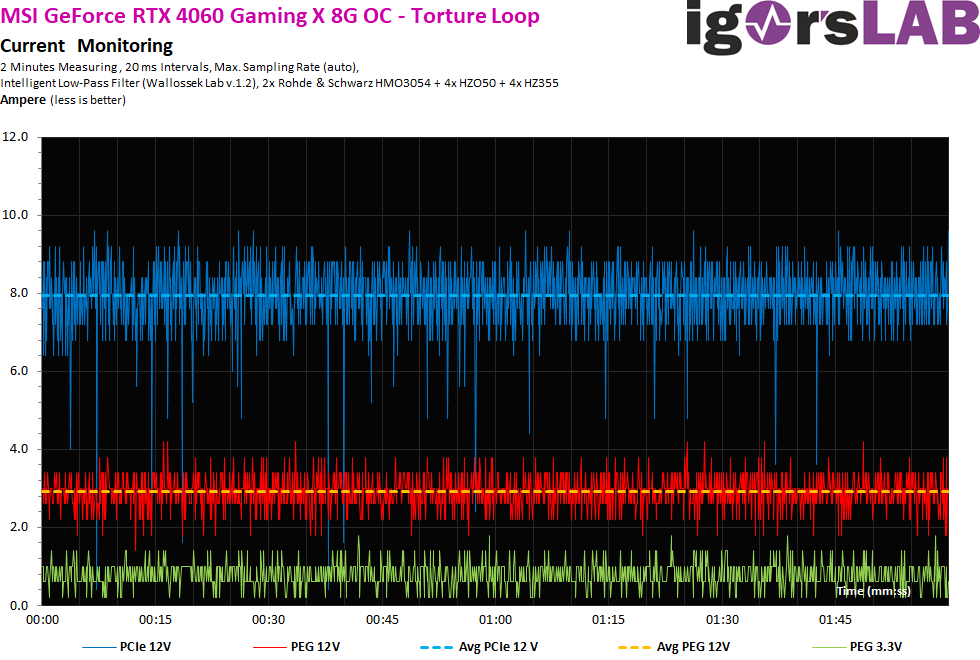

Beim Torture-Test sieht es kaum anders aus.

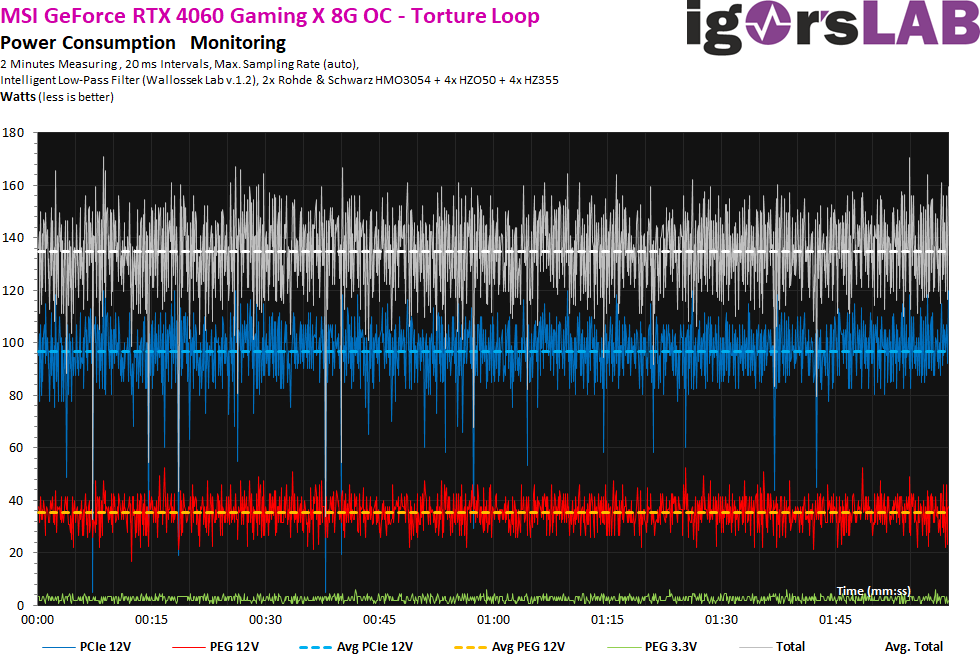

Nimmt man jetzt wieder die Spannung mit hinzu, dann sieht man eine stärkere Welligkeit (Ripple), die sich wiederum aus der etwas hibbeligen Betriebsspannung ergibt. Allerdings muss man zur Ehrenrettung des Netzteils auch sagen, dass dies alle aktuellen Produkte aller Hersteller betrifft und sicher auch kaum zu vermeiden ist.

- 1 - Einführung, technische Daten und Technologie

- 2 - Test System im igor'sLAB MIFCOM-PC

- 3 - Teardown: PCB und Komponenten

- 4 - Gaming Performance FHD (1920 x 1080)

- 5 - Gaming-Performance WQHD (2560 x 1440)

- 6 - Gaming Performance DLSS vs. DLSS3 vs. FSR

- 7 - Lastspitzen, Kappung und Netzteilempfehlung

- 8 - Temperaturen, Taktraten, Lüfter und Geräuschentwicklung

- 9 - Zusammenfassung und Fazit

20 Antworten

Kommentar

Lade neue Kommentare

Urgestein

1

Urgestein

Veteran

Mitglied

Urgestein

Veteran

Veteran

Veteran

Urgestein

Urgestein

Veteran

Mitglied

1

Mitglied

Moderator

Neuling

Neuling

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →