Yesterday we had the review of the MSRP cards, and today we mere mortals finally get to test the somewhat better cards. The fact that there was still a lot of room for improvement, without the test object having to drink itself to a cripple, shows once again that the “entry-level” models, which are sewn to the edge, should once again be viewed with suspicion. Not that there isn’t a target group for them, but creating the first impression with these models is complete psychological nonsense. However, the first impression is somewhat relativized by willing video handlers.

The MSI Gaming X 8G tested today is actually exactly where I would have liked to see a launch card. And because the little Ada wanted to be kicked so willingly and devotedly, I did all benchmarks in the 3 GHz setup right away. The additional performance at the socket was very limited and the chip still ran 250 MHz faster than the one tested yesterday. Obviously, there was again a merciless binning in pure culture. The MSI RTX 4060 Ventus 8G is the complete contrast here and is even slightly worse than the Palit from yesterday in terms of noise development and hot flashes. I already wrote it in my editorial this morning:

So today there is the overtightened screw with the right-hand thread and I have, also because of the deliberate attention span, tightened the content a bit. I’m sure that will do it some good. Of course, there are the benchmarks as usual, the comprehensive teardown (very important!), a very elaborate PCB and cooler analysis with some reverse engineering, and the analysis of power consumption and load peaks including a suitable PSU recommendation (just as interesting). The rest we already had yesterday.

Important preface to the power consumption

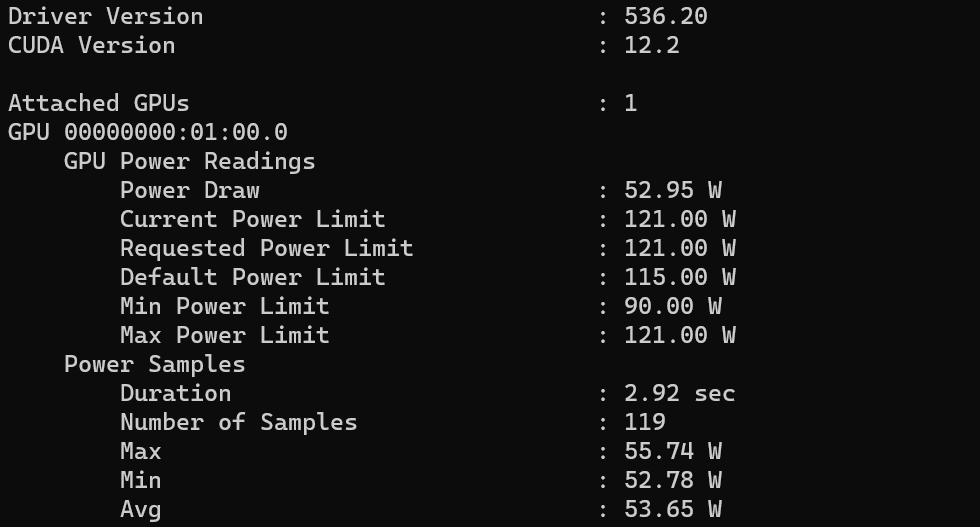

We already read yesterday that NVIDIA has partly completely messed up the telemetry, and I’ll also discuss that again today for a good reason. First, however, I would like to correct a part that I retested yesterday afternoon. This is about the idle power consumption. After further driver uninstallations and reinstallations, the tested card was eventually downclocked. This in turn lowered the power consumption to around 14 watts, with peaks of over 30 watts. Even that is still too much in view of such a tiny card, but already much better. However, the telemetry still remained at over 52 watts, which once again proves that NVIDIA scored a solid own goal by omitting the previous power monitoring. Without external measurement, all output values, no matter which software, simply cannot be taken seriously. These are energetic lyrics, nothing more.

A test with overclocking: OC card taken literally

Now let’s get to the overclocking in today’s test. As you can see in the picture above, I set the power limit to the maximum of 121 watts. At the same time, I raised the offset by 150 MHz. I deliberately did not overclock the memory, as I wanted to test the difference purely for the GPU clock. It doesn’t make much of a difference in the end either. That for a better understanding of today’s article in advance. And for those who didn’t read anything yesterday or want to read along comparatively, here are two more links about the RTX 4060 8G:

The MSI GeForce RTX 4060 Gaming X 8G in detail

The card weighs only 584 grams, which is even lighter than the Palit card tested yesterday with 649 grams, a real one-day flyweight. The length of 24.5 cm is moderate and the height of 12 cm is slightly above normal. On the positive side, the card gets by with a single 6 2-pin further down. The installation depth is 3.8 cm plus the 5 mm for the backplate attachment on the back.

This makes it a true dual-slot card. The dark plastic cover follows MSI’s Gaming-X design language, and the fan and slot bezel aren’t new either. The only thing is that everything doesn’t look quite as cheap as on the cheaper Ventus. MSI also uses a single BIOS and those who want to overclock have to use a suitable tool. The feel is at least ok, because the backplate is made of light metal and RGB is also available.

But you can not only put power into the card, but also video connectors. There are four of them, to be exact: three DisplayPort 1.4a and one HDMI 2.1a. That’s a shame, especially with the DisplayPort, when it comes to the new specifications. A missed opportunity, unfortunately. And with HDMI, you have to trick with the compression from 4K onwards if you want it to go above 120 Hz.

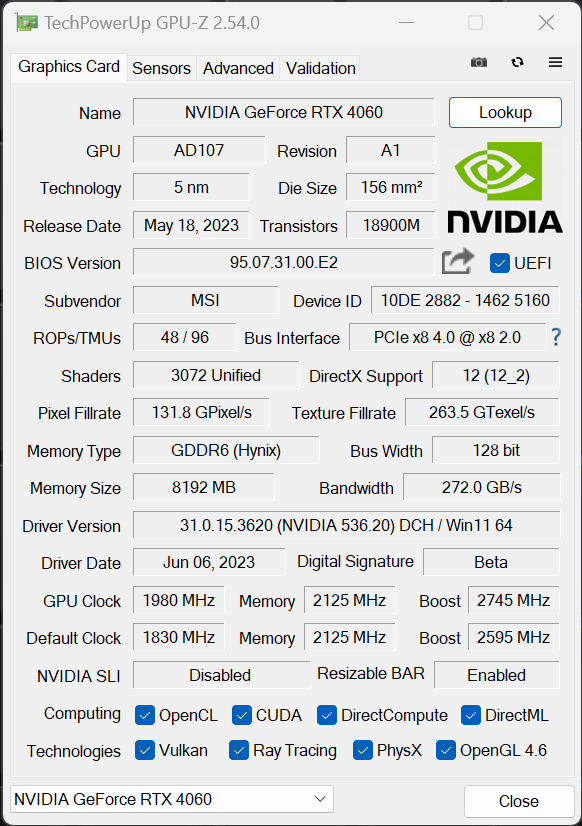

The screenshot from GPU-Z shows us standard specifications of the RTX 4060, which are similar for all OC cards, because there is a bit more boost clock. And if you look very closely, you can also see my 150 MHz offset that I allowed the overclocked card and the consequences for the boost. By the way, it is much higher in reality…

| RTX 4060 Ti | RTX 4060 | RTX 3060 Ti | RTX 3060 | |

| Architecture | Ada Lovelace | Ada Lovelace | Amps | Ampere |

| Process node | TSMC N4 | TSMC N4 | Samsung 8 nm | Samsung 8 nm |

| CUDA cores | 4352 | 3072 | 4864 | 3584 |

| Ray tracing cores | 32 cores (3rd-gen) | 24 (3rd-gen) | 38 cores (2nd-gen) | 28 cores (2nd-gen) |

| Tensor cores | 128 cores (4th-gen) | 96 (4th-gen) | 152 cores (3rd-gen) | 112 cores (3rd-gen) |

| Base clock speed | 2.31 GHz | 1.83 GHz | 1.41 GHz | 1.32 GHz |

| Boost clock speed | 2.54 GHz | 2.46 GHz | 1.76 GHz | 1.78 GHz |

| VRAM | 8 / 16 GB GDDR6 | 8 GB GDDR6 | 8 GB GDDR6/6X | 8 / 12 GB GDDR6 |

| L2 cache | 32 MB | 28 MB | 4 MB | 3 MB |

| Bus width | 128-bit | 128-bit | 256-bit | 192-bit |

| Total Graphics Power (TGP) | 160 W/165 W | 115 W | 200 W | 170 W |

With that, this first page is done and we are slowly getting ready for the test.

- 1 - Einführung, technische Daten und Technologie

- 2 - Test System im igor'sLAB MIFCOM-PC

- 3 - Teardown: PCB und Komponenten

- 4 - Gaming Performance FHD (1920 x 1080)

- 5 - Gaming-Performance WQHD (2560 x 1440)

- 6 - Gaming Performance DLSS vs. DLSS3 vs. FSR

- 7 - Lastspitzen, Kappung und Netzteilempfehlung

- 8 - Temperaturen, Taktraten, Lüfter und Geräuschentwicklung

- 9 - Zusammenfassung und Fazit

20 Antworten

Kommentar

Lade neue Kommentare

Urgestein

1

Urgestein

Veteran

Mitglied

Urgestein

Veteran

Veteran

Veteran

Urgestein

Urgestein

Veteran

Mitglied

1

Mitglied

Moderator

Neuling

Neuling

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →