10 Wasserblöcke je 2 Plattformen je 2 Pumpen-Einstellungen, mit jeweils verschiedenen Montage-Varianten, haben wir im heutigen Artikel für euch getestet. Dabei geht es nicht um theoretische Werte, sondern um echte Performance-Zahlen, die auch jeder Leser bei sich zu Hause mit etwas Aufwand so nachmessen kann. Hintergrund des Ganzen ist natürlich die Aufarbeitung des initialen Alphacool Core 1 Tests hier auf unserer Seite, den wir aufgrund nicht glaubhafter Ergebnisse offline genommen haben. Die Gründe hierfür sollten bekannt sein und, falls nicht, können sie zu Genüge nachgelesen werden.

Vorwort von Igor

Mein persönlicher Dank geht vorab explizit an Xaver, der den heutigen Test entgegen aller Widrigkeiten mit sehr viel zeitlichem Aufwand und persönlichem Einsatz tapfer bis zum Ende durchgezogen hat. Es war für uns alle am Ende ja auch eine Frage der Transparenz und Ehre, den gesamten Scherbenhaufen noch einmal richtig aufzuarbeiten, bzw. in diesem Fall durch einen Dritten unvorbelastet aufarbeiten zu lassen. Denn auch ich war, obwohl ich keinen der Tests persönlich durchgeführt habe, seinerzeit als Kontrollinstanz gefordert und habe diesbezüglich leider versagt. Deshalb fällt der heutige Test auch etwas umfangreicher aus.

Eigenes Vorwort

Nicht nur einmal wurde ich von Bekannten oder Freunden gewarnt, diesen Test zu machen und mich mit meinem Namen als Aufräumer nach dem Shitstorm anzubieten und womöglich persönlich mit hineingezogen zu werden. Denn auch wenn es oft überlesen wird, jeder von uns Testern steht mit seinem eigenen Namen unter den Artikeln, Igor bietet oft nur die Plattform. Wer in einem Artikel einmal unsauber arbeitet und seine Fehler nicht eingesteht, ist potentiell für alle Ewigkeit untragbar in der ganzen Industrie.

Doch als einer der ersten Nutzer des Core 1 hat es mich schon länger interessiert, wie der Block wirklich gegenüber anderen etablierten Wasserblöcken wie Watercool Heatkiller oder EK Velocity abschneidet, nur konnte ich es bisher nicht testen. Mittlerweile kann ich es und wenn man den Tests Anderer nicht vertrauen kann, dann bleibt eben im Zweifel nur selber messen! Mit meinem jetzigen Setup glaube ich auch ein Level an Reproduzierbarkeit und Fairness zu erreichen, mit dem sich eine Veröffentlichung der Ergebnisse durchaus vertreten lässt. Es ist natürlich nicht ganz perfekt und ein gewisses Restrisiko bleibt immer, aber das bin ich bereit einzugehen – zum einen aus Gründen persönlicher Neugier, zum anderen aus Loyalität zu Igor und nicht zuletzt auch, weil alle Hersteller einen fairen Re-Test verdient haben.

Testmethodik

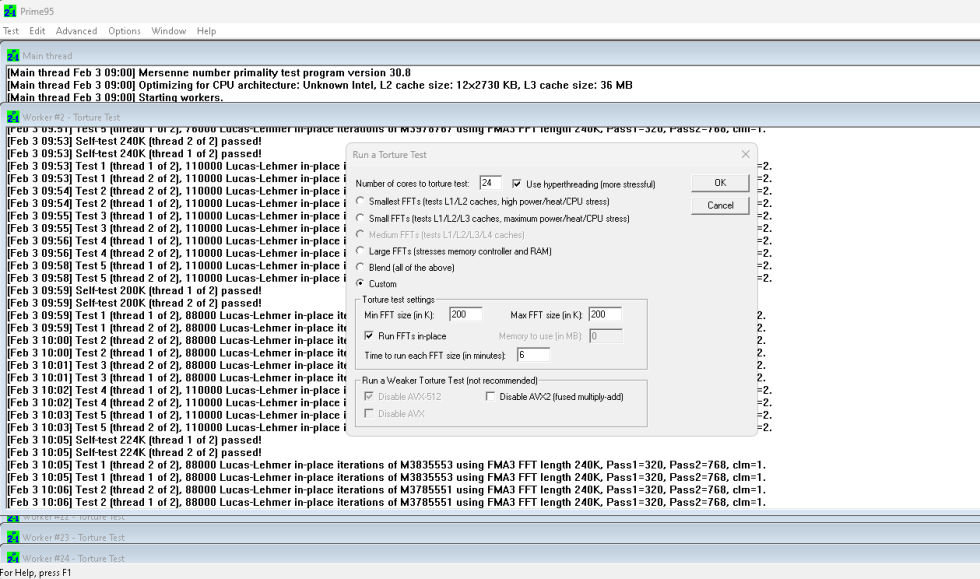

Als Wärme-Erzeuger fungiert ein Intel Core i9-13900KF auf der LGA1700 Plattform und ein Ryzen 9 7950X bei AM5. Die CPUs werden jeweils statisch übertaktet, bei Intel inklusive E-Cores, um eine möglichst konstante Wärmelast zu erzeugen. Die genauen Settings folgen auf der nächsten Seite bei der Test-Hardware. Als Wärmelast dient Prime 95 (p95v308b17.win64) mit einer fixen FFT Size von 200K, in-place. Damit erzeugen wir eine möglichst große, konstante Abwärme und sind zugleich unabhängig vom RAM, da der Benchmark komplett im Cache der CPUs läuft.

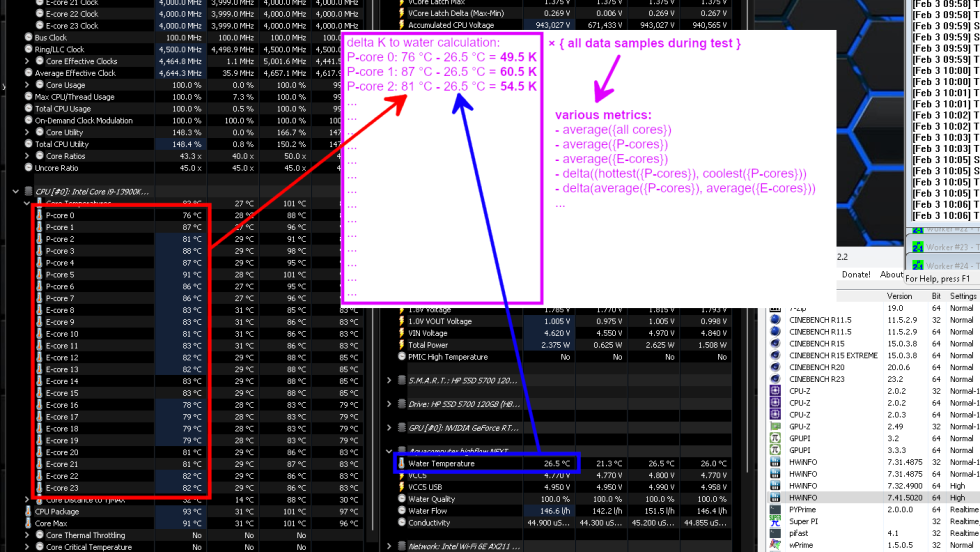

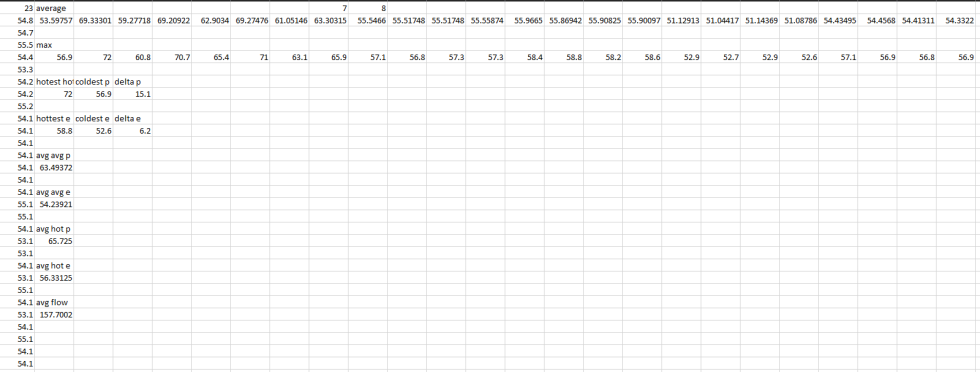

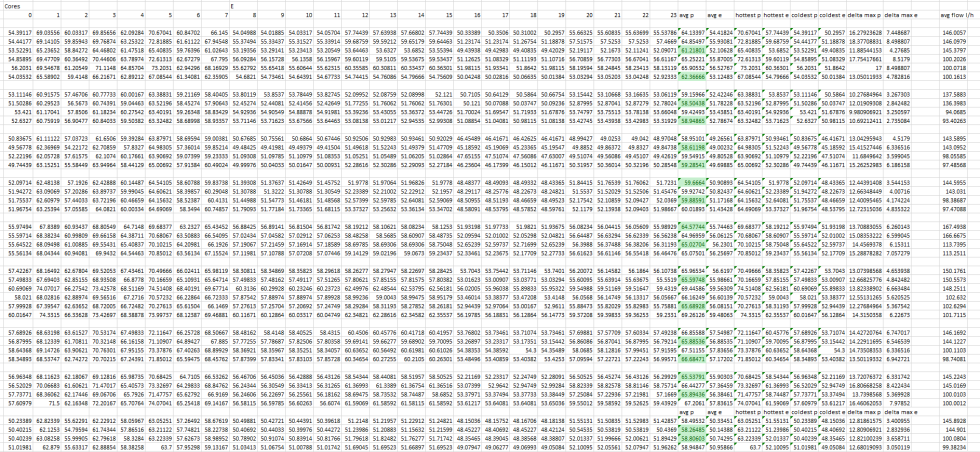

Um die Temperaturen zu ermitteln, werden die einzelnen Kern-Temperaturen und die Wasser-Temperatur über den Benchmark-Lauf von 15 min aufgezeichnet und für jedes Daten-Sample wird für jeden Kern das effektive Delta zur Wasser-Temperatur berechnet. Somit können wir auch ohne Chiller und komplett konstante Wasser-Temperatur die Wasserblöcke ziemlich fair messen. Dabei ist wichtig zu verstehen, dass wir wirklich für jeden Kern, für jeden Datensatz das Delta bilden und erst am Ende werden aus den Datensätzen Metriken generiert, wie z.B. der Durchschnitt aller P-Kerne oder der Unterschied zwischen dem durchschnittlich heißesten und kältesten P-Kern. Die Angabe der Delta-Werte erfolgt in Kelvin, wobei sich diese natürlich 1:1 auf Grad Celsius übertragen lassen.

Natürlich ist dieses Setup nicht ganz perfekt. Denn 1. steigt mit der Temperatur einer CPU auch ihre Abwärme und 2. steigt mit höherer Temperatur des Wassers dessen Wärmeleitfähigkeit. Auch wenn sich diese Faktoren ein Stück weit ausgleichen, achte ich beim Testen darauf, dass die Raum-Temperatur den Bereich 22 – 24 °C nicht verlässt. Von Luftfeuchtigkeit oder Staubablagerungen will ich jetzt gar nicht anfangen. Am Ende ist ein Testaufbau nie zu 100% perfekt, aber man sollte sich der Limitierungen und potentiellen Einflüsse von außen zumindest bewusst sein.

Die Daten-Aufzeichnung erfolgt mit HWInfo (7.41.5020) und hier muss ich gleich eine potentielle unkontrollierte Variable beichten. Denn auch mit Priorität „High“ oder „Realtime“, war es mir nicht möglich, dass HWInfo komplett konstant und verlässlich eine vorhersehbare Anzahl an CSV-Logeinträgen in einem definierten Zeitraum schreibt. Vermutlich liegt das daran, dass die CPU so sehr von Prime95 unter Last ist, dass HWInfo manchmal auf einen freien CPU-Zyklus warten muss. Und auch wenn man das Polling Interval auf z.B. 500 ms konfiguriert, so wird nur ca. alle 2000 ms ein Log-Eintrag im CSV File generiert.

Also habe ich mich dazu entschlossen, immer eine feste Anzahl von Log-Einträgen bzw. Datensätzen je Lauf auszuwerten. 419 Samples entsprechen im best Case exakt 15 Minuten, im worst case ca. 13 Minuten und 30 Sekunden. In jedem Fall schafft Prime95 aber 2 FFT Zyklen und mit einer festen Anzahl an Datensätzen die Durchschnitte zu bilden erschien mir am fairsten und konstantesten. Unterschiede der „Aufwärmdauer“ des Loops sind effektiv zu vernachlässigen, da wir ohnehin nur mit die Delta-Temperatur verwerten.

Die Testprozedur ist wie folgt: Ein Block wird nach Herstellervorgabe und mit der Orientierung des Blocks „aufrecht“ bzw. wie in der Anleitung abgebildet orientiert montiert (z.B. keine Drehung um 90 oder 180 Grad) und anschließend 30 Minuten Last mit Prime95 für den „Burn-In“ erzeugt. In dieser Zeit können Luftblasen aus dem Block lösen und sich die Wärmeleitpaste verflüssigen, verteilen und setzen. Danach wird das System rebootet und der erste Benchmark-Lauf gestartet indem wieder Prime95 mit den o.g. Parametern gestartet wird und parallel HWinfo in ein CSV-File die Daten aufzeichnet, mindestens 15 Minuten. Die erste Messung findet immer mit 2 angeschlossenen Pumpen statt. Dann wird das System rebootet und die Messung mit 1 Pumpe wiederholt. So können wir auch den Einfluss der Durchflussrate auf die Performance des Wasserblocks ermitteln.

Anschließend wird der Block demontiert, Block und CPU gesäubert und dann der Block für einen zweiten Satz an Messungen montiert. Das Prozedere aus dem letzten Absatz wird dabei wiederholt, sodass wir am Ende jeweils 2 Messungen je 2 Pumpen-Konfigurationen haben. Gleichzeitig kann ich so einmalige Fehler bei der Montage des Blocks, wie z.B. ungleichmäßiges Anziehen der Schrauben, aus den Ergebnissen filtern, denn nur der bessere der zwei Läufe je Pumpen-Konfiguration schafft es später in die Diagramme. Anders gesagt, ich müsste mich schon zweimal blöd anstellen, damit ein Block schlechter abschneidet als er könnte.

Die Montage erfolgt dabei immer nach den individuellen Herstellervorgaben sofern spezifiziert und ggf. sogar mit einem Drehmoment-Schlüssel. Ein- und Auslass werden natürlich wie vom Hersteller spezifiziert angeschlossen. Falls eine Messung unplausibel erscheint, z.B. weil zu wenige Datensätze geloggt wurden oder weil die Ergebnisse der beiden Montagen stark unterschiedlich sind, wird zusätzlich eine dritte Montage, wieder mit 2 Pumpen-Konfigurationen getestet.

Die Durchflussrate wird ebenfalls protokolliert, sodass wir ebenfalls bemessen können, wie restriktiv ein Block für den Wasserkreislauf ist. Eine konstante Durchflussrate über variable Pumpen-Einstellungen erscheint vielleicht erstmal fairer, aber in der Praxis schneidet auch ein sehr restriktiver Block mit daraus resultierendem geringen Durchfluss sehr gut ab, und umgekehrt. Mit statischer Pumpen-Geschwindigkeit lässt sich so aber auch der Einfluss auf den Durchfluss im gesamten Loop ableiten.

Die CSV-Daten der einzelnen Test-Läufe stellen wir euch übrigens aus Gründen der Transparenz zur Verfügung, damit wirklich keine Zweifel aufkommen, ob es sich um echte Test-Daten oder Phantasie-Werte aus dem Dragster-Universum handelt: https://drive.google.com/drive/folders/1K_K2ujN6f5csCPO5mlN4BUbVZeXpLmnn?usp=sharing

Da Intel die Kern-Temperaturen nur in ganzen Gradzahlen misst bzw. loggt, sind die Ergebnisse nur bedingt auf ein Zehntel oder Hundertstel Kelvin genau reproduzierbar. Die Wassertemperatur wird zwar auf ein Zehntel Grad Celsius genau erfasst und am Ende bilden wir ja auch einen Durchschnitt aus den 419 individuellen Datenpunkten, aber eine gewisse Messtoleranz bleibt. Diese beläuft sich laut meinen Analysen auf 0,4 bis 0,6 K. AM5 CPUs loggen übrigens auf ein Zehntel Grad Celsius genau, sodass dort die Ergebnisse etwas genauer sind.

Abschließend habe ich mich bei den Durchschnitts-Temperaturwerten für den Durchschnitt des Durchschnitts jedes Kernes entschieden, nicht den Durchschnitt der Maximalwerte jedes Kernes. Quasi die „0.1 % Metrik“, wie wir sie von Frametime-Analysen kennen, erfassen wir so explizit nicht, aber dass ein einzelner Kern für weniger Datenpunkte deutlich heißer läuft als für den Rest des Test-Laufes, dürfte bei dieser Art der Kühlung sehr unwahrscheinlich sein.

- 1 - Einführung und Test-Methodik

- 2 - Test-Hardware und -Systeme

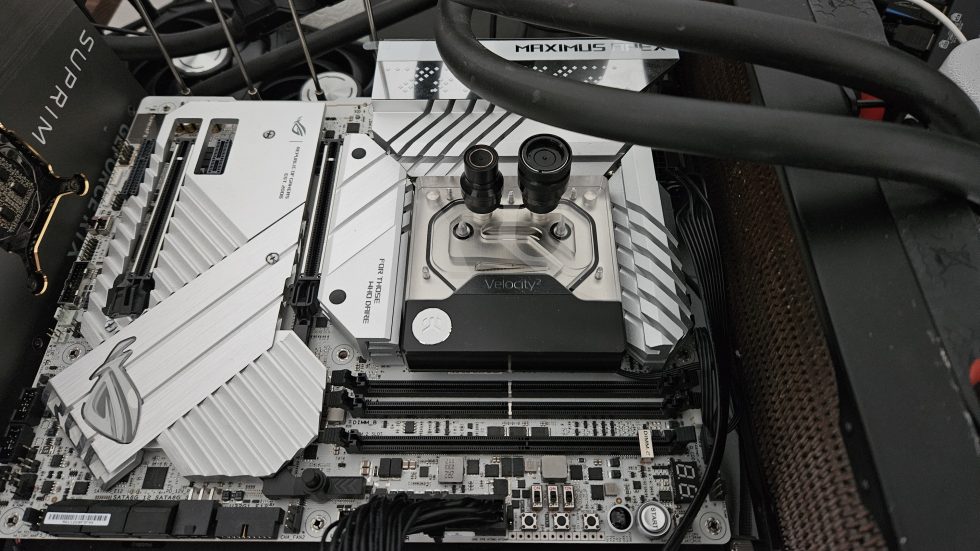

- 3 - EK-Quantum Velocity 2 D-RGB 1700

- 4 - Watercool Heatkiller IV Pro

- 5 - Alphacool Core 1 Aurora

- 6 - Aqua Computer cuplex kryos NEXT

- 7 - Thermaltake Pacific SW1 Plus

- 8 - Liquid Extasy No. Uno

- 9 - EK-Quantum Magnitude

- 10 - Corsair Hydro X XC7 RGB Pro

- 11 - Alphacool Eisblock XPX Aurora und XPX Pro 1U

- 12 - Ergebnisse Intel LGA 1700 – Core i9 13900KF

- 13 - Ergebnisse AMD AM5 – Ryzen 9 7950X

- 14 - Lessons Learned, Zusammenfassung und Fazit

114 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Veteran

Moderator

Urgestein

Veteran

Mitglied

Urgestein

Urgestein

Veteran

Urgestein

Veteran

Veteran

Mitglied

Urgestein

Urgestein

Veteran

Urgestein

Urgestein

Mitglied

Alle Kommentare lesen unter igor´sLAB Community →