AMD stichelt wegen des fast schon homöopathischen Speicherausbaus der NVIDIA-Ada-Mittelklasse und NVIDIA fühlt sich durch ein smartes Speichermanagement sicher genug und am Ende weiß der Kunde nicht mehr, was er denn kaufen soll. Wobei das mit dem zu knapp bemessenen Speicherausbau auch von mir nicht in Frage gestellt wird, denn es ist wie es ist und kann nicht schöngeredet werden. Allerdings kann man auch einmal die Begleiterscheinungen und das Verhalten der Karten beider Hersteller im Grenzbereich abtesten, wo sich Speicherbedarf und Speicherausbau genau treffen. Denn dort könnte das Verhalten der jeweiligen Lösungsansätze nicht unterschiedlicher sein. Und außerdem ist es interessant zu sehen, was bei nur 6 GB in Ultra-HD passiert. Geht nicht? Doch! Aber irgendwie anders als erwartet.

Vorwort und Systemvoraussetzungen

Um das alles überhaupt testen zu können, benötigt man jeweils eine Grafikkarte von AMD und NVIDIA, deren Speicher mindestens 32 GB groß ist. Dafür habe ich sowohl die Radeon Pro W7800 mit 32 GB als auch die RTX 6000 Ada mit 48 GB Speicherausbau. Dazu nehme ich mir mit “The Last of Us Part 1” (TLOU1) ein Spiel vor, in dem beide Karten in identischen Settings mit reichlich 10 GB Speicherbedarf konfrontiert werden und mit auseichend freiem Speicher trotzdem noch spielbare Frameraten abliefern. Es ist zudem kein NVIDIA-Spiel wie Cyberpunk 2077, sondern ein Konsolenport mit leichten Vorteilen für AMD.

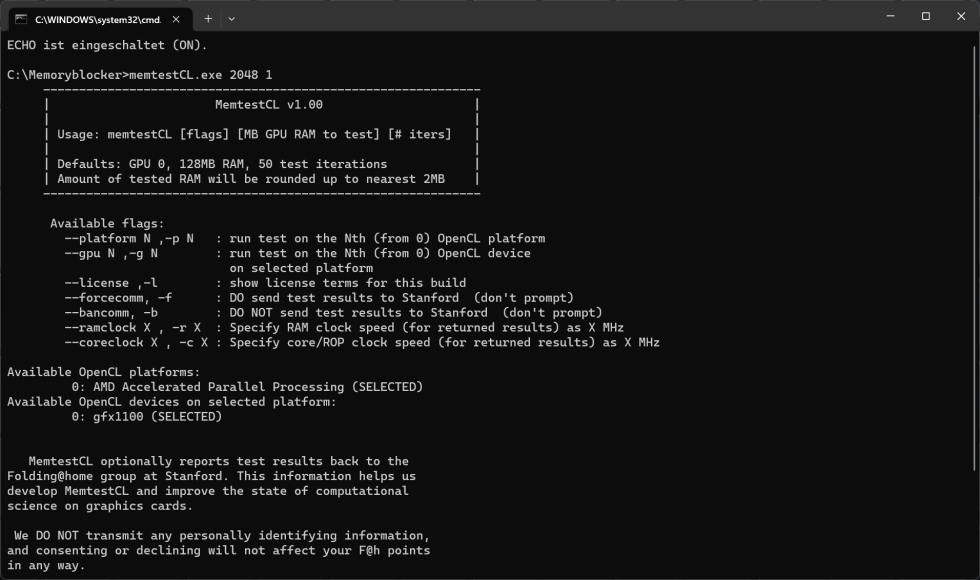

Getestet wurde mit der tagesaktuellen Steam-Version und den jeweils neuesten Treibern von AMD und NVIDIA auf einem MSI X670E Ace samt eines wassergekühlten Ryzen 9 7950X sowie DDR5 6000. Dazu kommen zwei schnelle 2 TB große PCIe 4.0 NVMe SSDs für System und Spiel sowie die beiden bereits erwähnten Workstation-Grafikkarten mit enorm hohem Speicherausbau. Diesen kann ich zwischen jeder Session künstlich reduzieren, indem ich die passenden Blöcke mit memtestcl reserviere (also allokiere). Das ist recht einfach, indem man per Batch-Datei einen einzelnen Run des Kommandozeilenprogramms ausführt und dann beim Pause-Befehl das Fenster einfach zum Symbol macht und in der Task-Leiste ablegt. Bevor man keine Taste im jeweiligen Fenster drückt, wird der Speicher nicht freigegeben. Das kann man dann auch mit beliebig vielen Fenstern wiederholen. Es ist nur wichtig, das Spiel jeweils zu schließen und erst nach dem Erzeugen des neuen “Speicherausbaus” wieder zu starten.

Hier bietet der Ryzen 9 7950X übrigens eine eher unerwartete Hürde, denn eine aktivierte iGP wird immer als Grafikkarten-Device 0 (also der erste) angesehen, was natürlich in einigen Fällen grandios schief gehen muss. Man muss manuell im Programm stets den zweiten Device wählen oder sinnvollerweise die iGP im BIOS einfach deaktivieren (siehe Bild oben). Das vermeidet zudem auch Laufzeitprobleme mit gewissen Programmen, wo die beim Start immer die falsche GPU erkannt wird. Das nur mal am Rande, aber es schien mir wichtig zu erwähnen (z.B. für ältere Solidworks-Programme, die mangels zertifizierter Grafikhardware dann den Start von Komponenten verweigern).

Der richtige Benchmark war nicht ganz einfach zu finden. Ein normales Savegame ist nicht wirklich zu 100% reproduzierbar, wenn man über Varianzen diskutieren will. Ich habe mich am Ende für eine Filmsequenz entschieden, die für statistische Erhebungen auch lang genug ist. Mit der Sequenz “Adios” aus “Tommys Staudamm” hat man satte 163 Sekunden absolut konsistenter Inhalte mit vielen Kameraschnitten, wechselnden Perspektiven und viel Wald, Landschaft und Lichtspielen. Selbst Savegames oder Sequenzen mit Städtepanoramen waren da weniger fordernd und abwechslungsreich. Beide Karten wurden im Menü voll aufgewärmt und erst der zweite Durchlauf der Sequenz wurde final als Benchmark aufgezeichnet. Und übrigens: Das Shader-pre-Caching wurde natürlich berücksichtigt.

Erste Messung und Grund für diesen Artikel

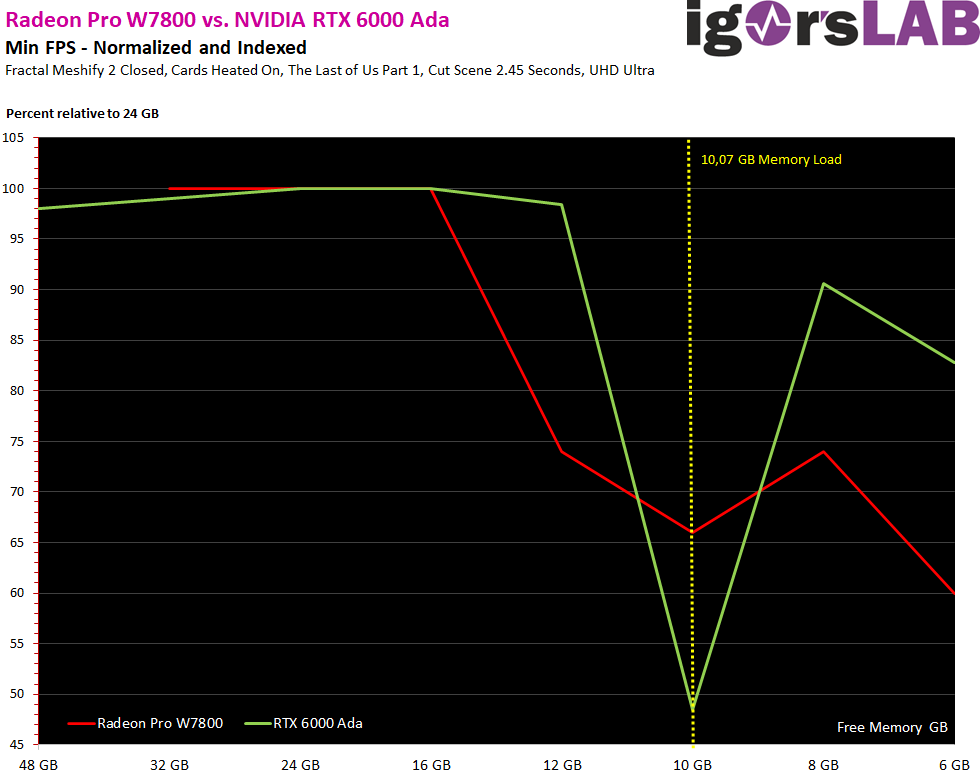

Ich beginne jetzt einfach mal mit einem kumulierten Ergebnis des P1 Low (Min FPS) und taste mich später mit allen Detailmessungen an die Realität heran. Das ist hochinteressant und noch viel spannender als diese erste, eher oberflächliche Zusammenfassung. Da die FPS-Raten beider Karten abweichen, habe ich für den ersten direkten Vergleich eine prozentuale Auswertung vorgenommen, um vergleichbar zu werden. Interessante Nebeninformation: die RTX 6000 Ada wird oberhalb von 24 GB sogar einen Tick langsamer. Ich habe deshalb den Bezugspunkt für meine 100% Marke auf die jeweiligen Messwerte bei 24 GB Speicherausbau gesetzt. Ich hätte auch die etwas schnellere Radeon Pro W7900 nehmen können, aber es hätte am eigentlichen Ergebnis und den Erkenntnissen nichts geändert. Im Übrigen werde ich ALLE Workstation-Karten noch in einem Spezial mit dem testen, wofür sie eigentlich gemacht wurden. Nur ist der Aufwand der Vorbereitung recht hoch und ich kann aktuell wegen meiner immer noch positiven Tests in keine Firma, um mir übers Wochenende mal die Lizenzen der Vollprogramme für die Benchmarks zu borgen.

Das hier genutzte P1 Low (also die neuen Min FPS) zeigt sehr eindrucksvoll, dass die AMD-Karte bereits 2 GB VOR dem Erreichen des Speicherausbaus sehr stark einbricht, um dann bei den 10,07 GB den Tiefststand zu erreichen, während die NVIDIA-Karte erst bei den 10 GB einbricht, dann dafür aber umso mehr. Man sieht auch, dass das von NVIDIA beschworene Speichermanagement immer genau dann versagt, wenn sich Speicherbedarf und Speicherausbau ziemlich genau decken. Dann ist komplett Schicht im Schacht. Erst bei 8 GB läuft des Spiel wieder und selbst mit mickrigen 6 GB ist alles noch smoother und spielbarer als mit 10 GB. Allerdings sieht man dann auch Fehler im Stream, Texturen bleiben matschiger und ab und zu fehlt auch etwas komplett oder ploppt irgendwann mal auf. Flimmern inklusive. Bei der AMD-Karte ist der Einbruch zwar geringer, aber der FPS-Verlauf erholt sich später nicht mehr wirklich. Jetzt kann man natürlich spekulieren, was angenehmer ist, aber mit der NVIDIA-Karte konnte man wenigstens noch spielen. In etwas hässlicher, aber es ging zumindest.

Natürlich ist nur ein einziges Spiel nicht zu 100% repräsentativ, aber man kann diese Effekte bei anderen Spielen genauso beobachten. Bei FarCry 6 ist das Ganze sogar noch krasser (RTX 6000 Ada bei 10 GB nur mit mickrigen 12 FPS), aber die Benchmarks meiner ganzen Savegames sind leider nie wirklich konsistent (so wie der integrierte Benchmark auch). Ähnliche Resultate gibt es auch bei anderen Spielen wie z.B. bei Horizon Zero Dawn, wobei man dann schon beim Rendern hochskalieren muss, um den Speicher vollzubekommen. Aber unterm Strich ist es immer wieder das Gleiche. Wir werden jedoch sehen, wie sich die einzelnen Frameverläufe darstellen, ich habe dazu jede Menge Einzelmetriken erstellt, die man wirklich genau betrachten sollte. Die Perzentile sind nämlich viel zu grob gefasst, so dass man wirklich die Varianzen und Frame Times betrachten muss, um zu verstehen, wo sich AMD und NVIDIA wirklich unterscheiden.

Natürlich ist nur ein einziges Spiel nicht zu 100% repräsentativ, aber man kann diese Effekte bei anderen Spielen genauso beobachten. Bei FarCry 6 ist das Ganze sogar noch krasser (RTX 6000 Ada bei 10 GB nur mit mickrigen 12 FPS), aber die Benchmarks meiner ganzen Savegames sind leider nie wirklich konsistent (so wie der integrierte Benchmark auch). Ähnliche Resultate gibt es auch bei anderen Spielen wie z.B. bei Horizon Zero Dawn, wobei man dann schon beim Rendern hochskalieren muss, um den Speicher vollzubekommen. Aber unterm Strich ist es immer wieder das Gleiche. Wir werden jedoch sehen, wie sich die einzelnen Frameverläufe darstellen, ich habe dazu jede Menge Einzelmetriken erstellt, die man wirklich genau betrachten sollte. Die Perzentile sind nämlich viel zu grob gefasst, so dass man wirklich die Varianzen und Frame Times betrachten muss, um zu verstehen, wo sich AMD und NVIDIA wirklich unterscheiden.

113 Antworten

Kommentar

Lade neue Kommentare

Veteran

Urgestein

1

Veteran

Veteran

1

1

Veteran

Neuling

Urgestein

Mitglied

Urgestein

1

Veteran

Neuling

Urgestein

1

Veteran

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →