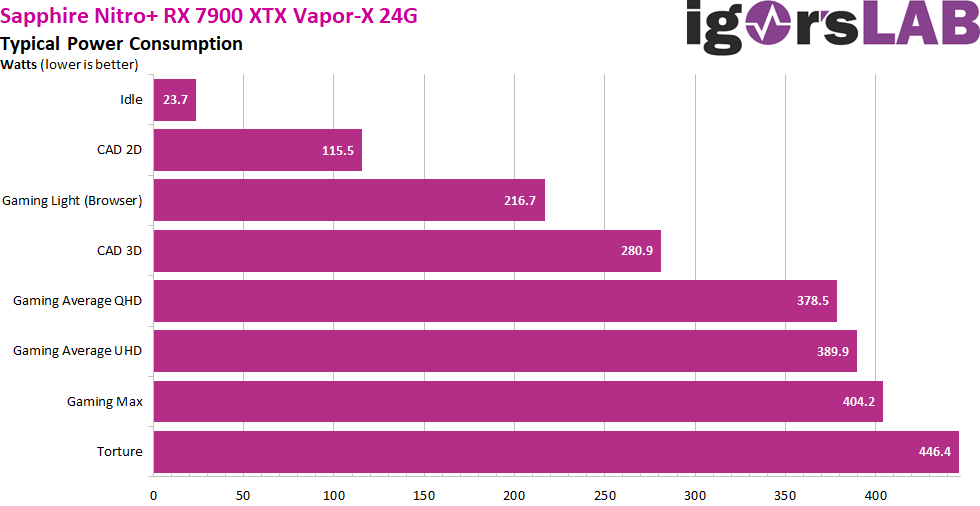

Leistungsaufnahme im Werkszustand als Zusammenfassung

Die 23.7 Watt im Idle sind besser geworden, aber immer noch recht hoch, wobei es zwischen 12 Watt und bis zu 33 Watt schwankt. Mit einem zweiten Monitor werden das schnell mal 50 Watt und mehr (Spitzen über 68 Watt). Hier muss der Treiber immer noch dringend nachgebessert werden, zumal auch der PCIe nicht immer richtig und vollstündig runtertaktet. Wir sehen übrigens sehr schön, dass nicht einmal in Ultra-HD die volle TBP ausgeschöpft wird und der Torture-Loop noch einmal bis zur Kappung zulegt (dazu komme ich gleich noch). Hier wirkt sich AMDs neue Implementierung der Telemetrie für die gesamte Karte dann doch stark begrenzend aus, auch wenn der Wert natürlich immens hoch ist. Ich hatte das ja bereits in mehreren Artikeln thematisiert und AMD auch so kommuniziert.

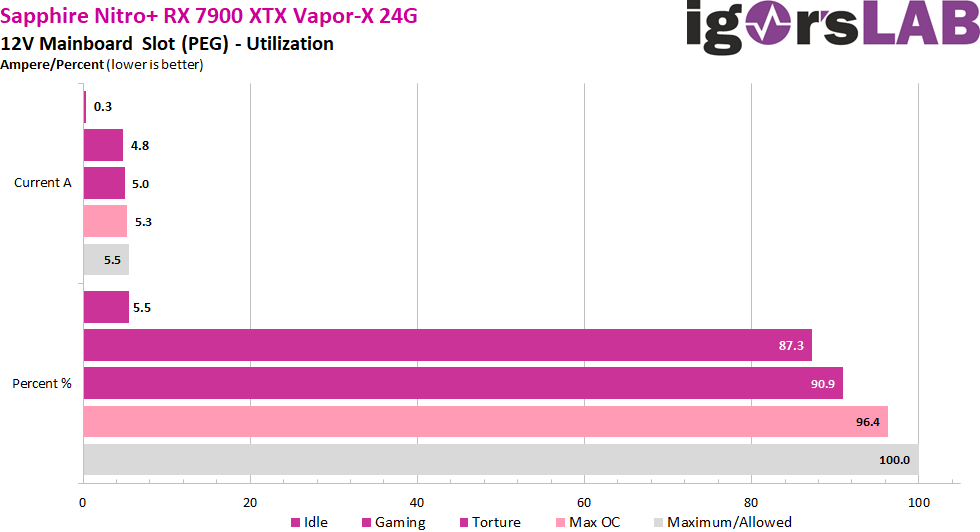

Lastverteilung zwischen PCIe-Slot und den PCIe-Buchsen

Die Aufteilung der Stromversorgung zeigt, dass die Karte kaum noch Reserven besitzt, was die TBP und die Leistungsfähigkeit der Rails betrifft. Während die drei 8-Pin-Anschlüsse noch nicht voll ausgelastet werden, liegt der Mainboard-Slot im Stresstest mit bis zu 5.3 Ampere nur knapp unter den zulässigen 5.5 Ampere. Im Gaming ist das alles noch knapp unterhalb von 5 Ampere.

Alles in allem hat AMD hier die Lastverteilung am PEG schon fast voll ausgenutzt, was eigentlich etwas irritiert. Während NVIDIA die Versorgung über den PEG fast komplett eingestellt hat, nutzt AMD diese Schiene recht exzessiv. In diesem Zusammenhang wirft auch die neue Teilspannung VDDCR_USR einige Fragen auf. Allerdings sind auch in den Unterlagen der Boardpartner keine handfesten Informationen dazu greifbar. Die bis zu 20 Watt, die AMD dort nur über die zwei Phasen bereitstellt, sind leicht verwunderlich, denn dafür hätte ein einziger Spannungsregler wohl mehr als ausgereicht.

- 1 - Einführung, technische Daten und Technologie

- 2 - Teardown: PCB und Komponenten

- 3 - Teardown: Kühler und De-Montage-Tips

- 4 - Gaming Performance Full-HD (1920 x 1080)

- 5 - Gaming Performance WQHD (2560 x 1440)

- 6 - Summe Gaming-Performance Ultra-HD (3840 x 2160)

- 7 - Details: Leistungsaufnahme und Lastverteilung

- 8 - Lastspitzen, Kappung und Netzteilempfehlung

- 9 - Temperaturen, Taktraten und Infrarot-Analyse

- 10 - Lüfterkurven und Lautstärke

- 11 - Zusammenfassung und Fazit

200 Antworten

Kommentar

Lade neue Kommentare

Mitglied

Veteran

Urgestein

Mitglied

Veteran

Urgestein

Urgestein

1

Veteran

Urgestein

1

Urgestein

Veteran

Urgestein

Urgestein

Urgestein

Mitglied

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →