Testsoftware und Workstation

Im Softwarepaket befinden sich 4 große Softwaresuiten von PTC Inc., Dassault Systèmes, Autodesk sowie Adobe und natürlich auch die übliche Standardsoftware wie z.B. Blender. Ich verwende professionelle bzw. standardisiere Workloads und verzichte dafür auf synthetische Benchmarks. Die einzige Ausnahme ist hier der SPECviewperf 2020, den ich bewusst mit aufgenommen habe, weil er zwei Dinge ermöglicht: Erstens sieht man im direkten Vergleich zu den Vollversionen, wo die Grafikkartenhersteller ggf. bei den Treibern gechaetet optimiert haben, um besonders gut dazustehen. Und zweitens kann das jeder auch gern selbst benchmarken, um den direkten Vergleich ziehen zu können.

Auch wenn NVIDIA es sicher gern anders gesehen hätte, hier geht es heute nur bedingt um KI und Computer (aber auch). Wichtig war für mich, dass es Programme im Test sind, die auf allen Architekturen laufen und damit auch einen direkten Vergleich ermöglichen. Außerdem werden wir sehen, dass für manche Aufgaben gar keine ultra-teure High-End-Karte nötig ist. Auch diese Erkenntnisse sind wichtig, wenn es um eine Investitions-Entscheidung geht. Zweckmäßigkeit ist das neue Zauberwort.

Als Workstation dient ein PC mit einem Intel Core i9-13900K auf einem MSI Z790 Godlike (ich weiß, es ist ein Gaming-Board) und 64 GB DDR5 PC6000 CL30, wobei ich den Speicher mit Absicht nur als DDR5 5200 laufen lasse. Der Performance-Unterschied zu DDR5 6000+ ist in diesem Anwendungsbereich bei den meisten Applikationen nur marginal, zumal ich einen Fall hatte, wo nach einem längeren Creo-Run mit 5 Iterationen bei DDR5 6000 kurz vorm Schluss das System freezte. Das ist übrigens auch der Grund, warum ich dem Core i9-13900K nur ein PL1 und PL2 von 125 Watt zugestehe. Es ist kein Gaming-PC und die Stabilität steht wie immer an erster Stelle. Zeit ist pures Geld und ein potentieller Datenverlust ist mit nichts zu entschuldigen. Gekühlt wird das alles mit einer einfachen 360er Silent-Loop 2 AiO von be quiet! und verfrachtet habe ich die Workstation in ein Fractal Meshify XL, so wie die VGA-Teststation auch.

Beim Monitor habe ich mich bewusst für eine Profi-Lösung entschieden. Der fast rahmenlose BenQ PD322020U ist mit seinen 31,5 Zoll Diagonale und 3840 x 2160 Pixeln groß genug, verfügt über ein vorzügliches AHVA-Panel von AU Optronics und deckt mit 10 Bit Farbtiefe (1.07 Mrd. Farben) die benötigten Farbräume fast vollständig ab. Die Ergonomie ist nahezu perfekt und man kann es (bis hin zur Pivot-Funktion) drehen und wenden wie man will – eine Einstellung passt immer. Nicht ganz taufrisch, aber bewährt.

Die Materialprüfung und Vermessung der Karten übernimmt mein neues Keyence VHX 7000 samt EA-300. Damit sind sowohl exakte Messungen als auch recht genaue Massenermittlungen der chemischen Elemente möglich. Die von mir nun genutzte Laser-induzierte Breakdown-Spektroskopie (LIBS) ist eine Art von Atomemissions-Spektroskopie, bei der ein gepulster Laser auf eine Probe gerichtet wird, um einen kleinen Teil davon zu verdampfen und so ein Plasma zu erzeugen. Die emittierte Strahlung aus diesem Plasma wird dann analysiert, um die Elementzusammensetzung der Probe zu bestimmen. LIBS hat viele Vorteile gegenüber anderen analytischen Techniken. Da nur eine winzige Menge der Probe für die Analyse benötigt wird, ist der Schaden an der Probe minimal. Diese Technik erfordert im Allgemeinen keine spezielle Vorbereitung der Proben. Sogar Feststoffe, Flüssigkeiten und Gase können direkt analysiert werden.

LIBS kann mehrere Elemente gleichzeitig in einer Probe detektieren und kann für eine Vielzahl von Proben verwendet werden, einschließlich biologischer, metallischer, mineralischer und anderer Materialien. Und man erhält eine wirkliche Echtzeit-Analyse, was enorm Zeit spart. Da LIBS im Allgemeinen keine Verbrauchsmaterialien oder gefährlichen Reagenzien benötigt, ist es eine natürlich relativ sichere Technik, die auch kein Vakuum benötigt. Wie bei jeder Analysetechnik gibt es auch bei LIBS Einschränkungen und Herausforderungen, aber in vielen meiner Anwendungen, insbesondere wenn Geschwindigkeit, Vielseitigkeit und minimalinvasive Probenentnahme von Vorteil sind, bietet es deutliche Vorteile.

| Test System |

|

| CPU | Intel Core i9-13900K @ 125W (PL2 = PL1) |

| RAM | 64 (2x 32) GB Corsair Dominator Platinum DDR5 PC6000 CL30 @ DDR5 5200 |

| Mainboard | MSI MEG Z790 Godlike |

| Cooler | Be Quiet! Silent Loop 2, 360 mm |

| PSU | Be Quiet! Dark Power 1000 Watt |

| SSD | 2x 2 GB Netac NI7000-t NVMe |

| Case | Fractal Meshify XL |

| Monitor | BenQ PD322020U |

| OS | Windows 11 Professional (all Updates) |

| Drivers | NVIDIA Branch/Studio: R535 U8 (537.70) WHQL AMD Software Pro Edition: |

Benchmarks

Hier verlinke ich jetzt der Einfachheit halber auf die aktualisierte Version der Sammlung aller meiner Workstation-Grafikkarten für 2023, die ich natürlich vorab auch um die Radeon Pro W7700 ergänzt habe. Der Grund dafür, die Charts nicht direkt in diesen Artikel einzubinden, liegt klar auf der Hand: Der Link führt auch nach dem aktuell geplanten Einpflegen von vier weiteren Workstation-Karten auf die dann auch wieder aktualisierten Benchmarks:

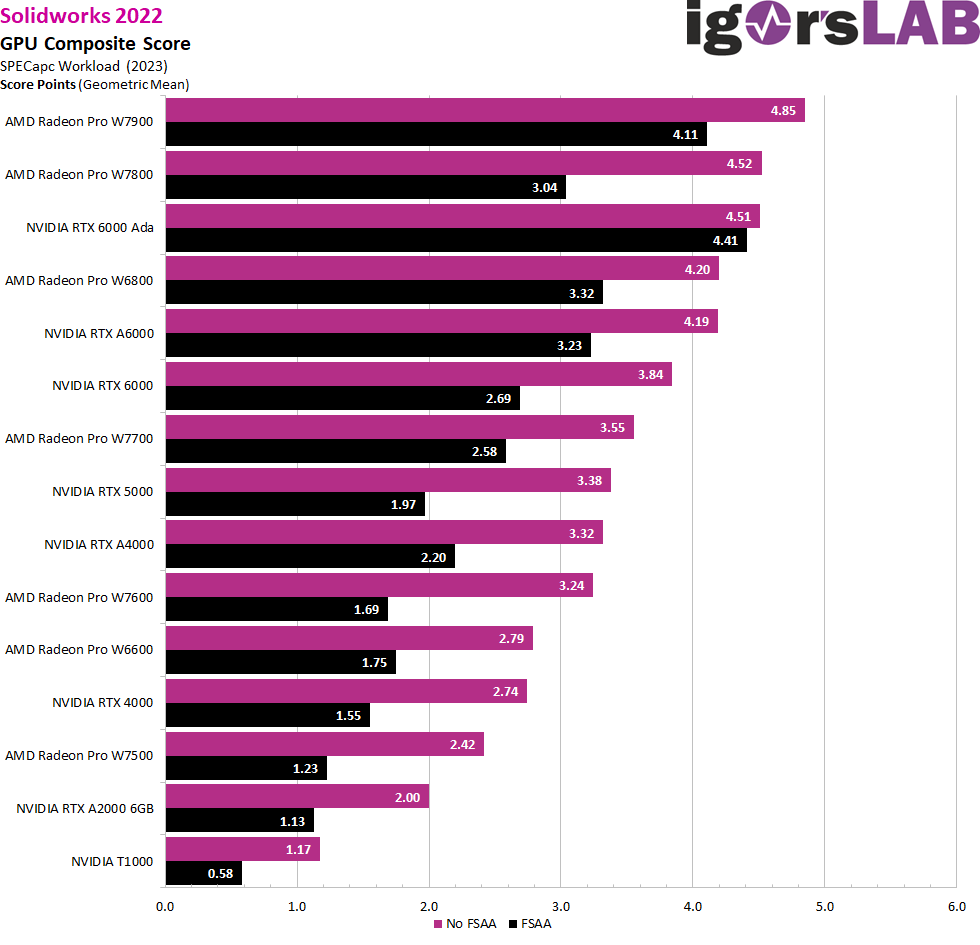

Trotzdem möchte ich die Werbeaussagen natürlich auch noch separat überprüfen. Beginnen wir mit Solidworks 2022, wo ich zunächst die Vollversion in einem standardisierten Workload ohne FSAA getestet habe. Die Radeon Pro W7700 ist hier rund 15.5 Prozentpunkte langsamer als die ältere Radeon Pro W6800. Sie ist jedoch 27.2 Prozentpunkte schneller als die Radeon Pro W6600 und auch 5 Prozentpunkte schneller als eine RTX 5000 mit Turing-Chip und fast 7 Prozentpunkte schneller als eine RTX A4000 mit Ampere Chip.

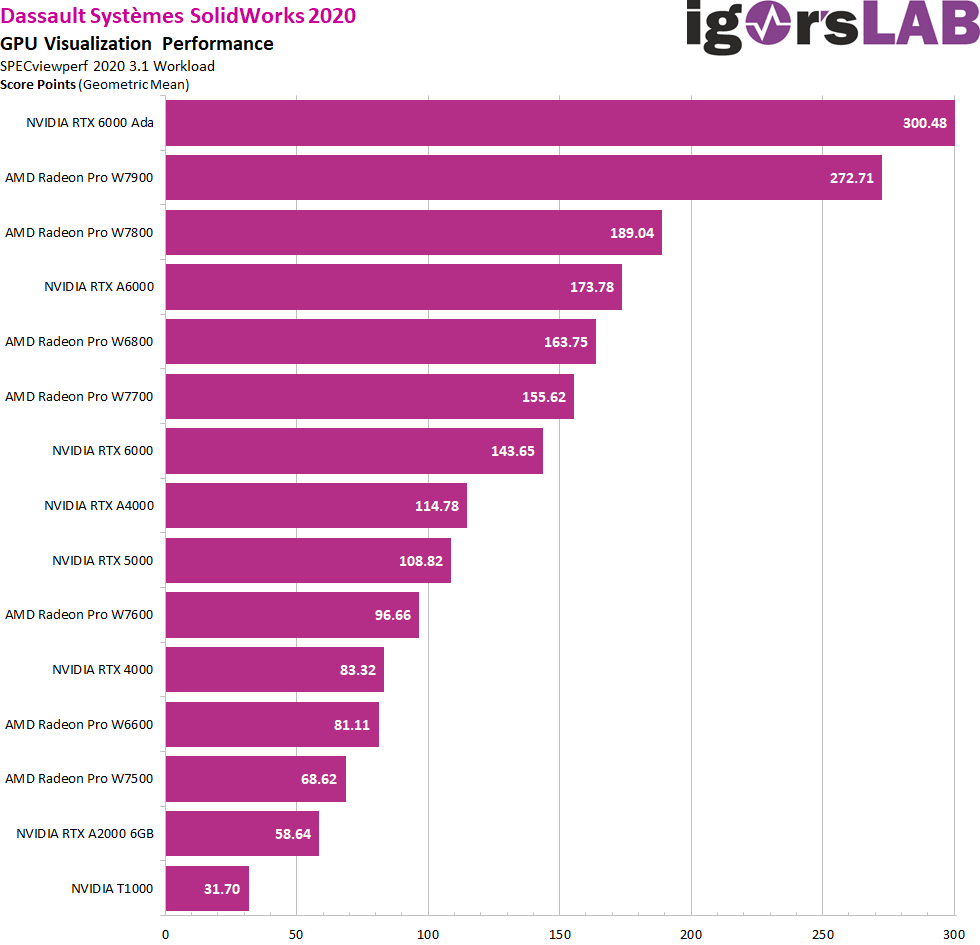

Doch wie sieht es bei SPECviewperf aus, der kostenlosen Suite mit implementierten, älteren Softwareversionen und vorgefertigten Workloads? SPECviewperf ist stets ein leichtes Opfer für spezielle, Anwendungs-bezogene Optimierungen der Treiber durch Grafikkartenhersteller fürs Marketing. Die Radeon Pro W7700 ist hier nur noch rund 5 (statt 15.5) Prozentpunkte langsamer als die ältere Radeon Pro W6800. Was für ein Zufall. Sie ist plötzlich 92 (statt 27.2) Prozentpunkte schneller als die Radeon Pro W6600 und auch statte 43 (statt nur 5) Prozentpunkte schneller als eine RTX 5000 mit Turing-Chip und sie überflügelt plötzlich sogar noch die RTX 6000! Und zum Schluss: sie ist hier fast 36 (statt nur 7) Prozentpunkte schneller als eine RTX A4000 mit Ampere Chip.

Doch wie sieht es bei SPECviewperf aus, der kostenlosen Suite mit implementierten, älteren Softwareversionen und vorgefertigten Workloads? SPECviewperf ist stets ein leichtes Opfer für spezielle, Anwendungs-bezogene Optimierungen der Treiber durch Grafikkartenhersteller fürs Marketing. Die Radeon Pro W7700 ist hier nur noch rund 5 (statt 15.5) Prozentpunkte langsamer als die ältere Radeon Pro W6800. Was für ein Zufall. Sie ist plötzlich 92 (statt 27.2) Prozentpunkte schneller als die Radeon Pro W6600 und auch statte 43 (statt nur 5) Prozentpunkte schneller als eine RTX 5000 mit Turing-Chip und sie überflügelt plötzlich sogar noch die RTX 6000! Und zum Schluss: sie ist hier fast 36 (statt nur 7) Prozentpunkte schneller als eine RTX A4000 mit Ampere Chip.

Diese kurze Stichprobe zeigt deutlich, warum man solche synthetischen, freien Benchmarks mit der nötigen Vorsicht genießen sollte, zumal sich der Abstand zwischen NVIDIA und AMD bei aktiviertem FSAA weiter zugunsten der grünen Karten verschiebt. Ja, AMD performt mit der Radeon Pro W7000 Reihe nicht schlecht, aber man muss wirklich vollwertige Benchmarks hernehmen.

17 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Veteran

Veteran

Veteran

Urgestein

Veteran

Urgestein

Veteran

Veteran

Mitglied

Urgestein

1

Urgestein

Veteran

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →