Leistungsaufnahme und Normeinhaltung

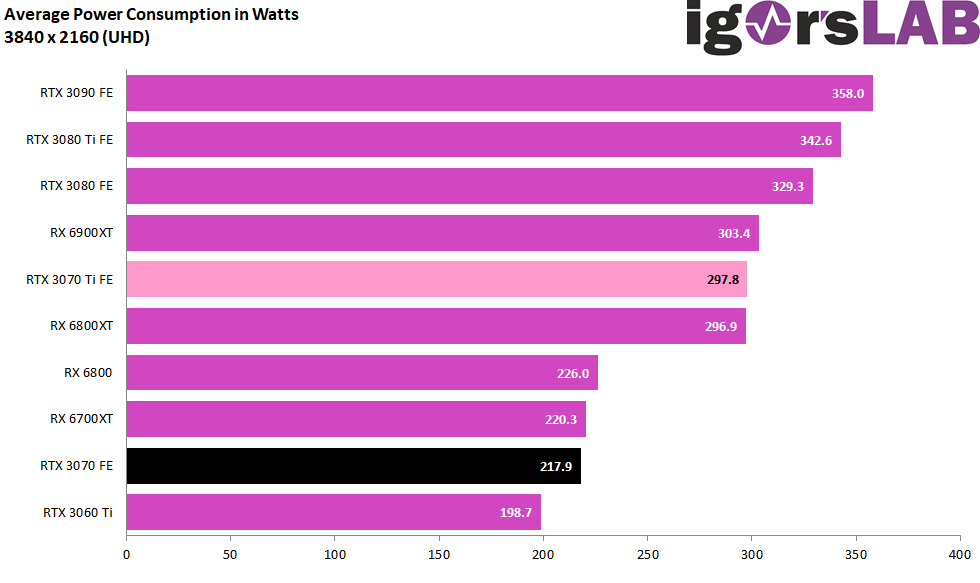

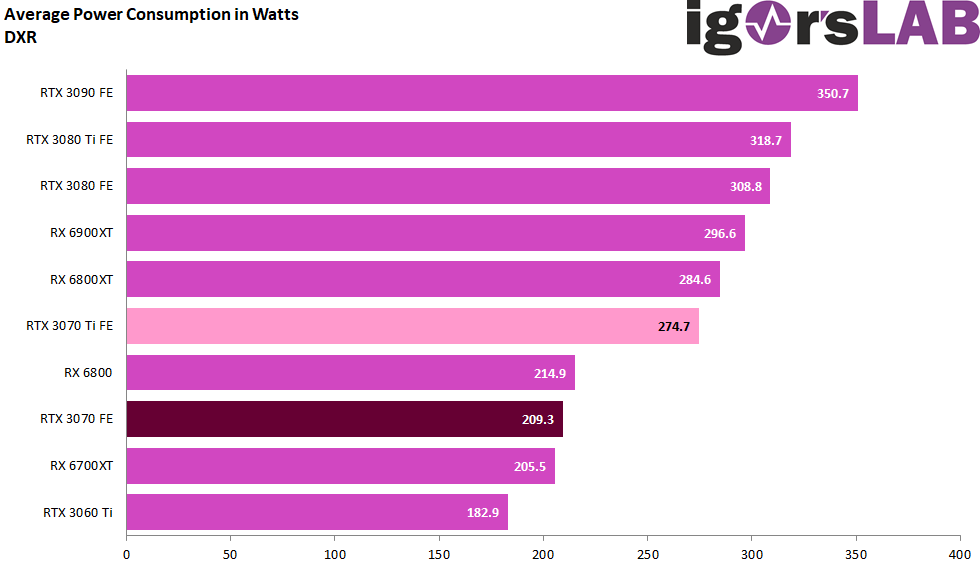

Bei der Leistungsaufnahme gibt es eigentlich keine großen Geheimnisse, denn das, was NVIDIA als TGP vorgibt, wird weitgehend auch eingehalten. Doch das ist nicht die ganze Wahrheit, denn die Leistungsaufnahme ist sehr Auflösungs-abhängig. Rechnet man jedoch die Leistungsaufnahme in Ultra-HD zusammen, die ich in allen Spielen über die gesamte Laufzeit gemessen habe, dann liegt alles wieder bei den befürchteten 280 bis fast 300 Watt für die TGP, Zunächst erst einmal das jeweilige Mittel über alle Auflösungen, Spiele und Grafikkarten:

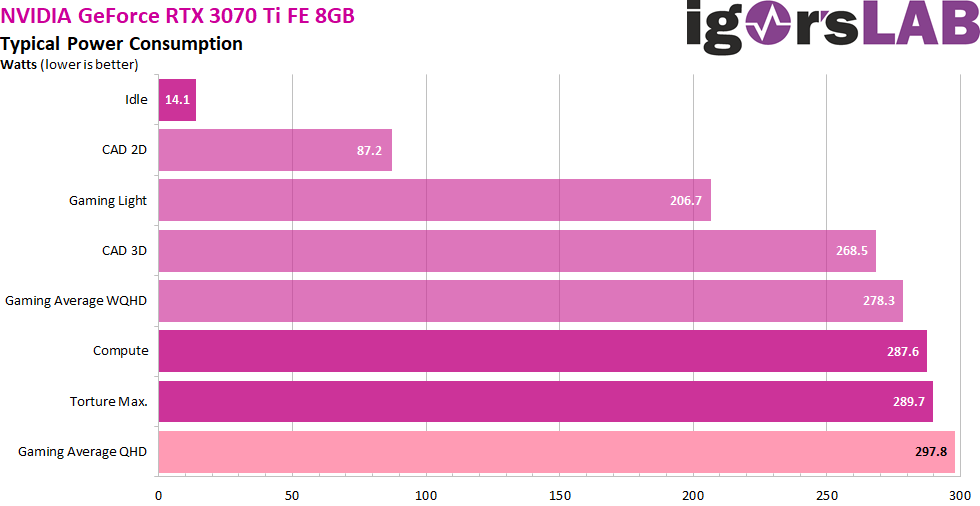

Mit ca. 13 bis 14 Watt im Idle liegt man noch im brauchbaren Bereich, wenn auch relativ hoch, denn das ging auch schon mal niedriger. Die Teillastbereiche werden auch noch relativ sparsam realisiert. Allerdings erreicht die Karte bei echter Volllast und voller Erwärmung dann um die 298 Watt, also 8 Watt mehr als prognostiziert und in den Specs angegeben. Die nachfolgende Tabelle zeigt nun die Maximalwerte der jeweiligen Lastszenarien und die gemittelte Gaminglast. Der Wert für Gaming UHD ist der höchste, in einem Spiel über den ganzen Benchmark gemittelte Wert:

Fakt ist, dass nahezu 300 Watt für eine Karte, die kaum 8% schneller ist als eine GeForce RTX 3070 FE mit 220 Watt eine herbe Enttäuschung. Das ist weder zeitgemäß, noch wirklich konkurrenzfähig. Allerdings wird es wohl die Miner eher abschrecken als die Gamer.

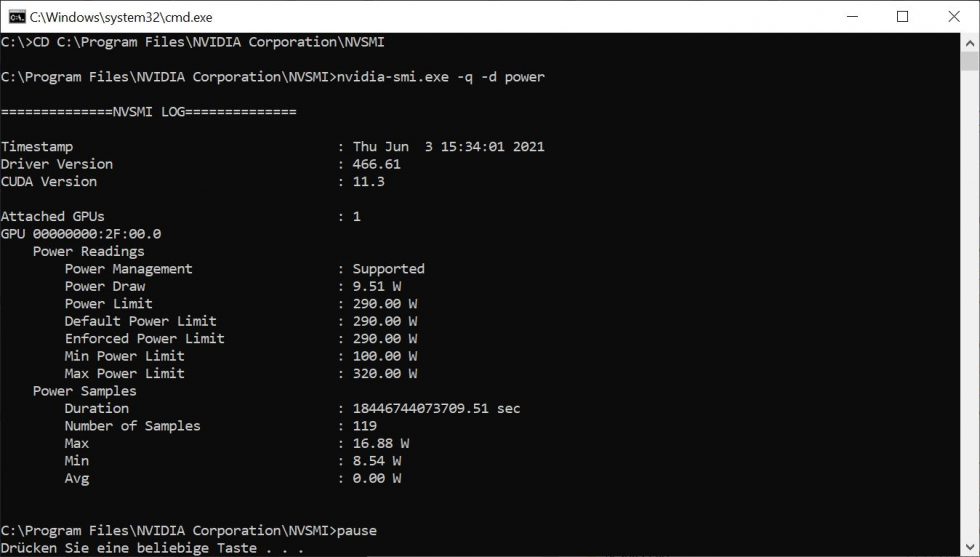

Womit wir bei den Vorgaben wären, denn am Ende ist ja per Firmware klar geregelt, was geht sowie maximal und minimal gehen darf. Maximal 320 Watt sind für die FE erlaubt, was sich mit der geeigneten Software auch abrufen lässt, aber auch komplett sinnlos ist.

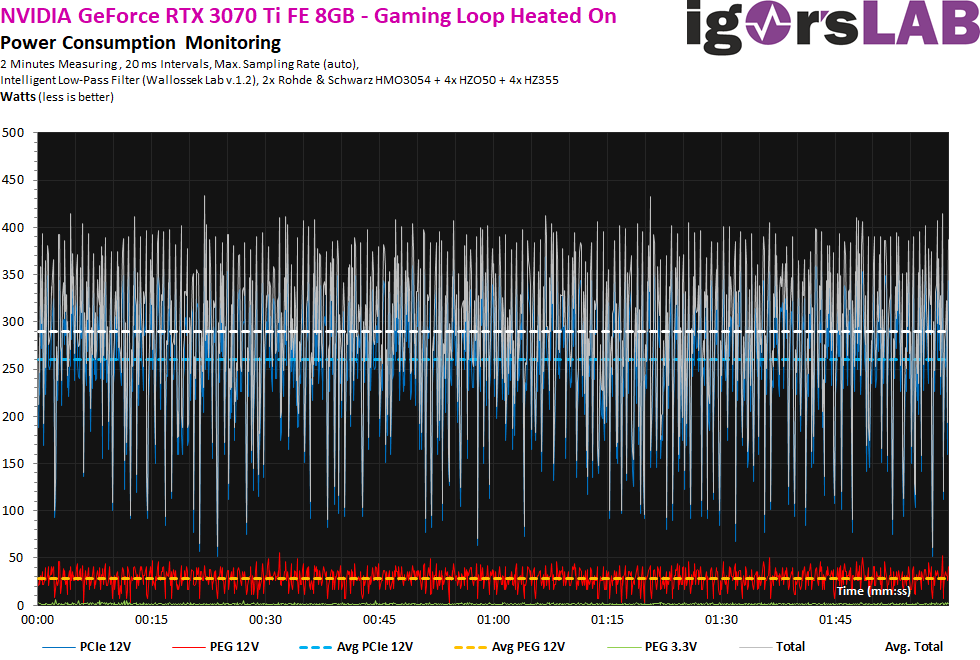

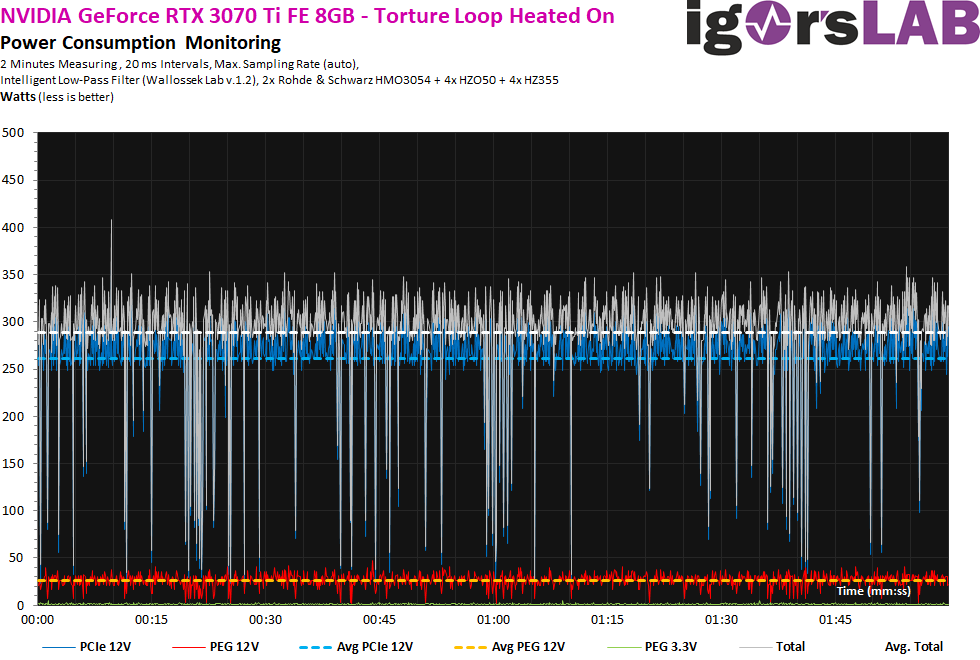

Der etwas detailliertere Kurvenverlauf für Gaming und Torture sieht so aus, wobei die Intervalle mit den langen 20 ms noch sehr granulär sind. Aber zu den ganz kurzen Spikes komme ich gleich im nächsten Kapitel

- 1 - Einführung und Testsystem

- 2 - Teardown, Platinenanalyse und Kühler

- 3 - Gaming Performance WQHD + FHD/RTX

- 4 - Gaming Performance Ultra-HD/DLSS

- 5 - Detailauswertungen alle Spiele

- 6 - Frame Times vs. Power Draw

- 7 - Leistungsaufnahme und Effizienz der Einzelspiele

- 8 - Leistungsaufnahme: Übersicht & Detailansichten

- 9 - PEG, Lastspitzen und Netzteil-Empfehlung

- 10 - Temperaturen und Infrarot-Tests

- 11 - Geräuschemission / Noise

- 12 - Zusammenfassung. Features und Fazit

15 Antworten

Kommentar

Lade neue Kommentare

Veteran

Veteran

Veteran

Mitglied

Urgestein

Mitglied

Veteran

Veteran

Veteran

Mitglied

Urgestein

Urgestein

Urgestein

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →