Mit der GeForce RTX 3050 kontert NVIDIA nicht nur die arg unglücklich geratene AMD Radeon RX 6500XT, sondern rundet das eigene Portfolio noch weiter nach unten hin ab. Die Leistungsdaten sind dabei so clever gewählt, dass es im Gegensatz zur AMD-Karte für Full-HD durchaus reicht, auch wenn die FPS-Junkies hier sicher schon etwas kleinere Brötchen backen müssen. Zumindest muss man nicht wie bei AMDs RX 6500XT alle Qualitätsregler aufs Minimum schieben, um noch spielbare Frameraten zu erhalten. Das mal als kleiner Spoiler vorab, den Rest gibt es natürlich im Review.

Und außerdem ermöglicht es der größere Speicherausbau auch, dass die Karte in WQHD mit einer ausgewogenen und wohlüberlegten Mixtur aus mittleren Einstellungen bei Bild- und DLSS-Qualität durchaus noch passabel performt. Das setzt natürlich eine gewisse optische Kompromissbereitschaft voraus, so ehrlich muss man natürlich auch bleiben. Und da es mir mittlerweile gelungen ist, leihweise auch mal eine AMD Radeon RX 6500XT in Form der Eagle 4GB von Gigabyte zu organisieren, hole ich den ausgefallenen Launchtest quasi nach, indem ich diese Karte ebenfalls mit gebenchmarkt und in die Charts eingefügt habe. Ich habe mich aufgrund der eher mickrigen Resultate der AMD-Karte allerdings gegen ein Extra-Review entschieden, da dieses in einer expliziten Kaufwarnung geendet wäre und ein Auspeitschen mit Ansage keinem weiterhelfen würde. Aber auch dazu später noch mehr.

Eine Founders Edition gibt es diesmal erneut nicht, dafür wollte NVIDIA eigentlich eine Karte von Gigabyte schicken. Diese wiederum klebte gefühlte Ewigkeiten im übermotivierten Zoll und ist bis heute (Montag vormittag) noch nicht hier im Labor angekommen. Da war wiederum übers Wochenende etwas Kreativität gefragt und deshalb teste ich eben mit einer Retail-Karte von Palit. Die wird als OC-Karte zwar schon ab Werk die 279 Euro UVP deutlich sprengen, aber das mit den Preisen ist eh nur wie Vanilleeis um 12 Uhr Mittags in Dubai. Die fast baugleiche Palit RTX 3060 Dual OC liegt aktuell bereits weit über 700 Euro Straßenpreis, sinnlos.

Die Halbwertszeit solcher Preise ist leider kürzer als das Dahinschmelzen süßer Köstlichkeiten und stößt am Ende wohl auch mal wieder extrem sauer auf. Aber sei es drum, wir erfüllen heute einfach erst einmal emotionslos unseren Informations- und Bildungsauftrag. Das mit dem Zeitfenster, das wieder einmal extrem klemmte, sorgte auch dafür, dass ein paar Kleinigkeiten auf der Strecke bleiben mussten. Aber egal, es gibt genug zu lesen und der Tag hat nun einmal nur 24 Stunden. Die anderen Karten kommen dann als Review eben etwas später.

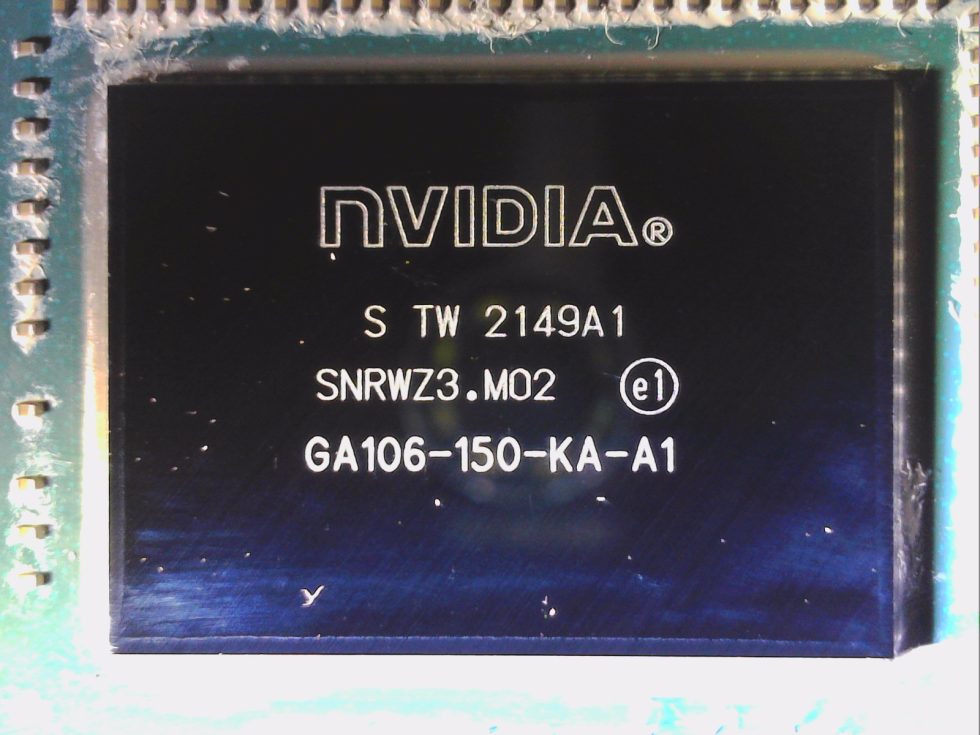

Der beschnittene GA106-150 auf der GeForce RTX 3050

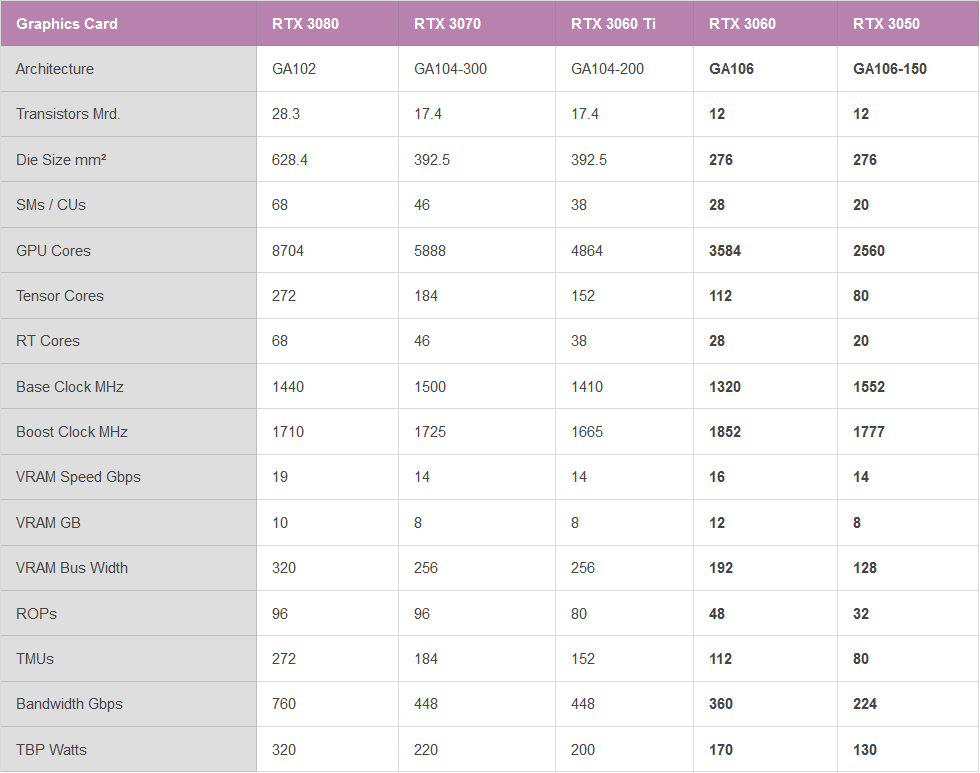

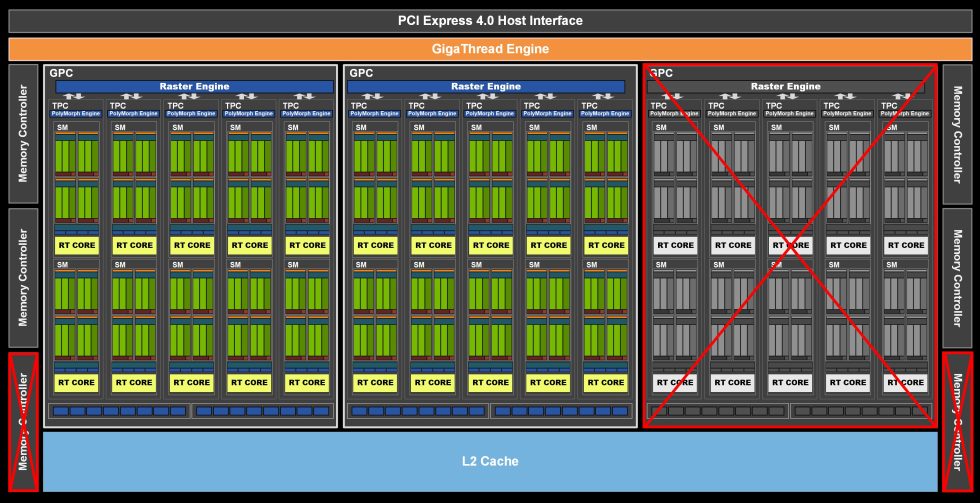

Der Chip der NVIDIA GeForce RTX 3050 basiert ebenfalls auf dem GA106 und wurde noch ein wenig mehr eingekürzt. Die Positionierung mit einer UVP von 279 Euro für die nicht übertakteten Karten liegt hier 50 Euro unter den 329 Euro der GeForce RTX 3060 und 120 Euro unter dem der RTX 3060 Ti. In der Relation kommt das schon fast hin und den fehlenden Rest der Plausibilität verdeckt der allgemeine Chipmangel ja sowieso. Für die GeForce RTX 3050 nutzt NVIDIA insgesamt 20 SM (28 bei der RTX 3060) der maximal 30 Einheiten des GA106 (siehe Schema unten), was zu insgesamt 2560 (3584 bei der RTX 3060) CUDA-Kernen führt. Es ist damit also eine echte 2/3-Karte. Hurra!

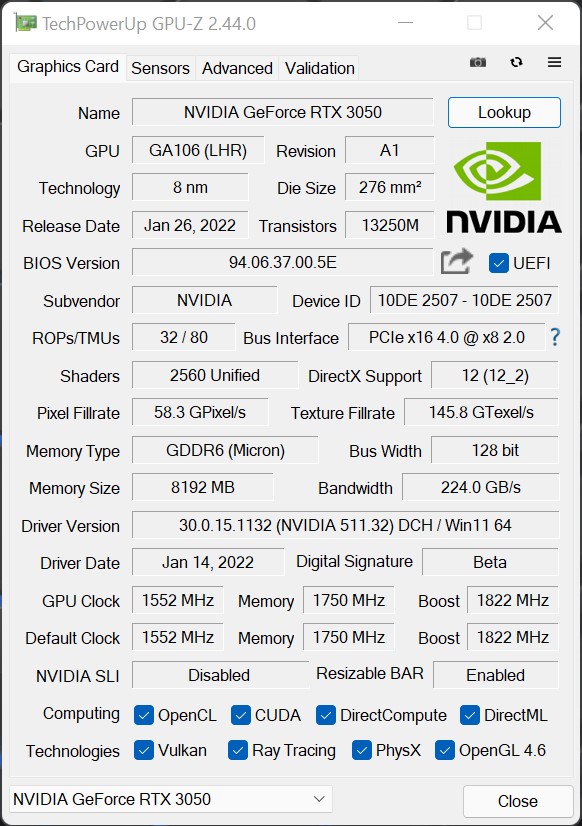

Zusätzlich zu den CUDA-Kernen ist NVIDIAs GeForce RTX 3060 auch mit 20 RT-Kernen der nächsten Generation (Ray-Tracing), 80 Tensor-Kernen, 32 ROPs und 80 TMUs ausgestattet. Was den Speicher betrifft, so verfügt die GeForce RTX 3050 noch über 8 GB GDDR6-Speicher mit einer Geschwindigkeit von 14 Gbps, der am 128 Bit Interface der 4 Speicher-Controller eine kumulative Bandbreite von 224 Gbps besitzt.

Rechnet man nun die verbliebenen 20 SM hoch, ergeben sich die bereits erwähnten 2560 CUDA-Cores. Im Idealfall wohlgemerkt und auch nur, wenn alle Einheiten mit FP32 werkeln dürfen. Der Rückstand zur GeForce RTX 3060 ist vorauszusehen und weniger als 2/3 des Vollausbaus mit 30 SM ergäben letztendlich wohl auch keinen Sinn mehr. So kann man am Ende des Tages seitens NVIDIA die Ausbeute des GA106 erhöhen, was in Anbetracht des extrem hungrigen Marktes gar keine so schlechte Entscheidung ist. Merken wird man die fehlenden 10 SM (8 weniger als die RTX 3060) natürlich schon, aber man taktet dann einfach etwas höher und fertig. Wobei das die Effizienz etwas drücken sollte, wie wir später noch sehen werden.

Resizeable BAR ist zwar hardwareseitig bereits implementiert, allerdings funktioniert diese Implementierung aktuell eher so lala. Es ist also wirklich spannend zu sehen, was NVIDIA jetzt als neues RTX-Einstiegspaket anbietet, denn Karten sind momentan generell knapp und die Zielgruppe der weniger gut betuchten Full-HD-Spieler existiert ja wirklich. Genau diese Eignung werde ich heute genauer untersuchen und dieser Test umfasst natürlich auch noch die elektrische Umsetzung, die Platine, die Leistungsaufnahme und die Kühlung. Für Lesestoff ist somit also schon einmal ausreichend gesorgt.

Die Palit RTX 3050 Dual OC 8GB

Das Gehäuse der Karte folgt der bekannten Dual-Formensprache und ist natürlich als Einsteigermodell eher kein echter Hingucker oder gar Aufreger. Der übliche Mix aus schwarzem ABS, etwas Leichtmetall und Eisenwaren unter der Haube ist somit auch nichts, das irgendwie polarisiert. Dem kann man durchaus auch etwas Positives abgewinnen, denn die Karte wird wohl auch in einigen Jahren noch genauso zeitlos wirken, wie jetzt. Radios in den frühen 1970ern mit den rund gelutschten Ecken (Soft Line) sahen da auch nicht viel anders aus.

Das Design mit den 3.8 cm Einbautiefe zuzüglich der 4 mm für die Backplate aus gebürstetem ABS macht diese Karte zu einem echten Dual-Slot-Design mit allen bekannten Vor- und (in diesem Fall kaum) Nachteilen. Der Kühlerüberhang wird in der Backplate mit großen Wabenöffnungen auf Durchlass getrimmt.

Mit den 555 Gramm ist die Karte zudem ein richtiges Fliegengewicht. Die Länge von 24,4 cm ist kurz (und trotzdem noch viel länger als die viel kürzere Platine) und auch die Einbauhöhe ist mit 11,5 cm ab der Oberkante des PCIe-Slots bei eingebauter Karte bis zur Oberseite der Abdeckung nicht wirklich üppig.

Der einzelne 8-Pin-Anschluss an der Oberseite reicht völlig aus und er markiert optisch auch des Ende der versteckten Platine. Ihr werdet auf der nächsten Seite noch anhand der Platine sehen, dass man hier mit dem überlangen Kühler fast schon mit Kanonen auf Spatzen schießt. Zum Kühlerdesign gibt es dort dann natürlich auch noch weitere Details. Den NVLINK-Anschluss hat man logischerweise weggelassen, denn SLI ist eh tot und hier auch nicht erwünscht. RGB findet sich an der Oberseite als Hintergrundbeleuchtung für den GeForce RTX Schriftzug, immerhin.

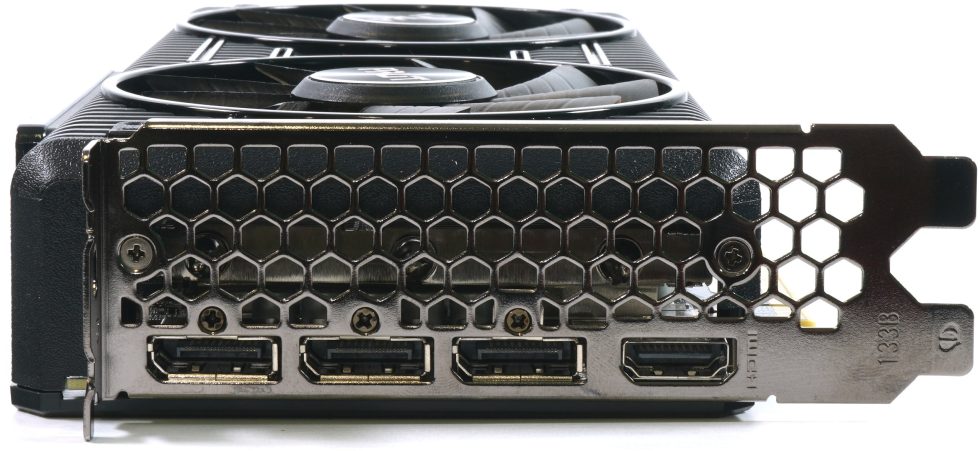

Der neue HDMI-2.1-Anschluss darf nicht fehlen, die drei aktuellen DisplayPorts natürlich auch nicht. Die sehr großen Kühlöffnungen zeigen, woher der Wind (nicht) weht und damit wären wir mit den Äußerlichkeiten auch schon wieder einmal komplett fertig, denn die Lamellen sind vertikal und das Wabendesign besitzt kühltechnisch eher keine echte Funktion.

Die Daten der Palit-Grafikkarte zeigt uns noch einmal der aktuelle GPU-Z Screenshot, den Rest hatte ich ja schon weiter oben aufgeführt. Die 1552 MHz Basistakt entsprechen der Referenzvorgabe von NVIDIA und die 1777 MHz Boost-Takt der Referenz hebt Palit auf 1822 MHz ab Werk an. Die 1750 MHz Speichertakt waren zu erwarten und der Speicherausbau mit 8 GB am 128-Bit Interface logischerweise auch, wenn man an die 4 Speicher-Controller mit je 64 Bit aus dem oben gezeigten Schema denkt.

Auch hier habe ich noch einmal eine Tabelle für alle Statistiker unter Euch, bevor es dann ab der nächsten Seite wirklich voll losgeht.

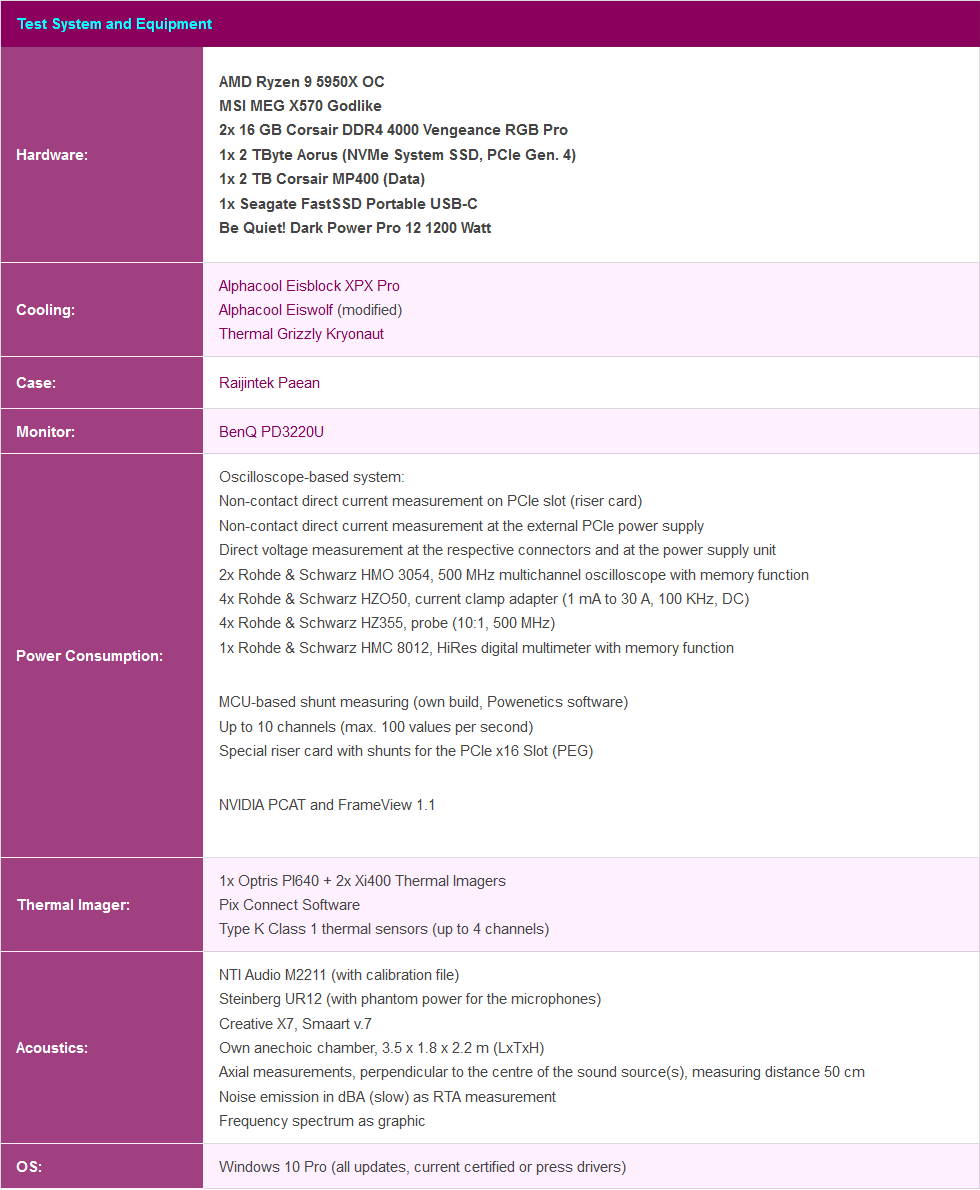

Testsystem und Auswertungssoftware

Das Benchmarksystem ist neu und steht jetzt nicht mehr im Labor, sondern wieder im Redaktionsraum. Ich setze nunmehr auch auf PCIe 4.0, das passende X570 Motherboard in Form eines MSI MEG X570 Godlike und einen selektierten Ryzen 9 5950 X, der wassergekühlt stark übertaktet wurde. Dazu kommt schneller RAM sowie mehrere schnelle NVMe SSDs. Für das direkte Loggen während aller Spiele und Anwendungen nutze ich NVIDIAs PCAD, was den Komfort ungemein erhöht.

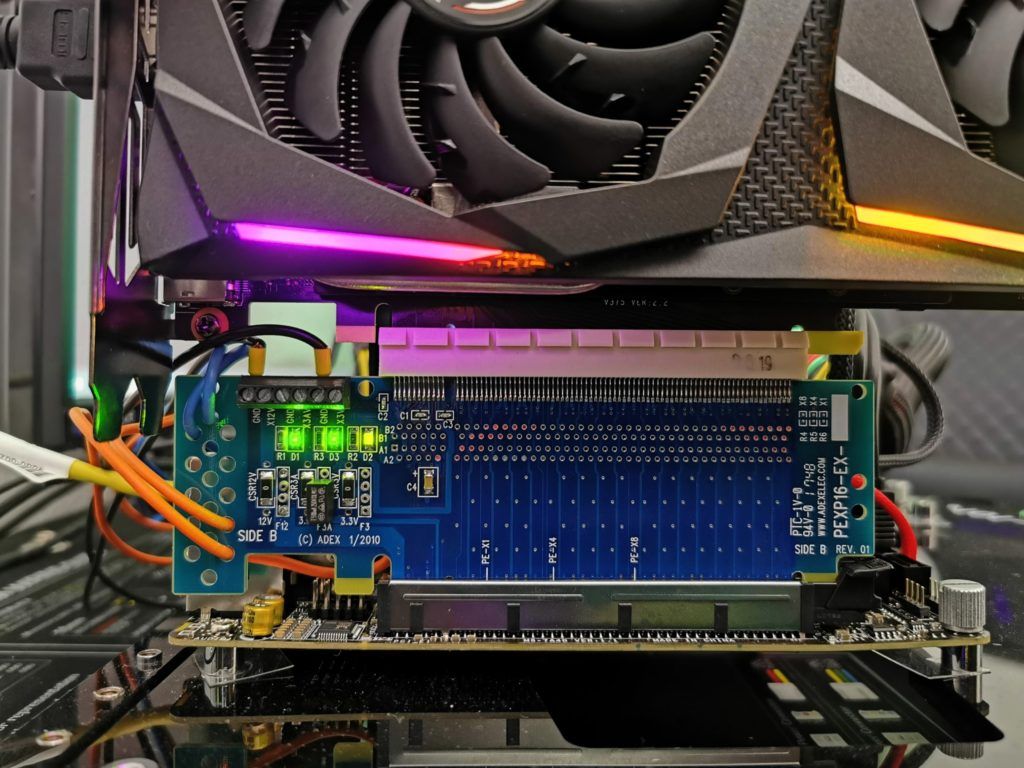

Die Messung der Leistungsaufnahme und anderer Dinge erfolgt hier im Speziallabor auf einem redundanten und bis ins Detail identischem Testsystem dann zweigleisig mittels hochauflösender Oszillographen-Technik…

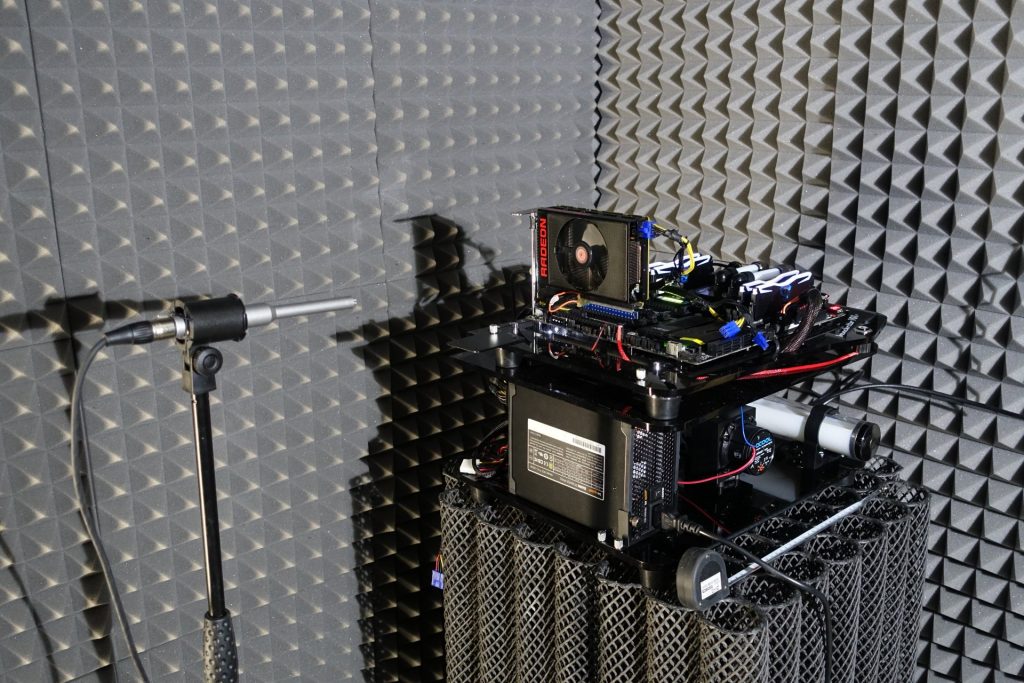

…und dem selbst erschaffenen, MCU-basierten Messaufbau für Motherboards Grafikkarten (Bilder unten), wo am Ende im klimatisierten Raum auch die thermografischen Infrarot-Aufnahmen mit einer hochauflösenden Industrie-Kamera erstellt werden. Die Audio-Messungen erfolgen außerhalb in meiner Chamber.

Die einzelnen Komponenten des Testsystems habe ich auch noch einmal tabellarisch zusammengefasst:

- 1 - Einführung und Testsystem

- 2 - Teardown, Platinenanalyse und Kühler

- 3 - Gaming Performance Full-HD

- 4 - Gaming Performance WQHD

- 5 - Details: Frames per Second (Curve)

- 6 - Details: Percentiles (Curve)

- 7 - Details: Frame Times (Curve)

- 8 - Details: Frame Times (Bar)

- 9 - Details: Variances (Bar)

- 10 - Power Draw von GPU und CPU sowie Effizienz in Spielen

- 11 - Leistungsaufnahme: Übersicht & Netzteil-Empfehlung

- 12 - Temperaturen und Infrarot-Tests

- 13 - Geräuschemission / Noise

- 14 - Zusammenfassung. Features und Fazit

21 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Veteran

Mitglied

Mitglied

Urgestein

Veteran

Mitglied

Urgestein

Urgestein

Urgestein

Veteran

Mitglied

Veteran

Urgestein

Urgestein

Mitglied

Urgestein

Urgestein

Mitglied

Alle Kommentare lesen unter igor´sLAB Community →