But how do I actually do it?

Well, basically it’s all down to trial and error. And if you value your time, you can try to make this trial and error procedure as efficient as possible. In the following I describe how I go about overclocking a kit of RAM, so take that for what it is. First I usually want to figure out the maximum memory clock, before I start bothering with the timings. So I loosen the primary timings, like e.g. XMP timings + 5 for each, set the memory voltage to XMP voltage + 100 mV, leave all other timings on auto and then try to increase the memory clock step by step. From 3600, I might go to 3866, then 4000, then 4266 and so on until it does not post or train anymore.

Once I have found my maximum memory clock, I try to fully boot the system with these settings to the operating system and run a stability test to see if just the memory clock alone without pushing the timings is stable. Often this is indicative of the quality of the memory slots and traces of the used motherboard. Usually I’m a bit in a rush and therefore cut the test short at about 15 minutes in which 0 errors must occur of course. If it fails, walk the memory clock back one step until you found a stable one.

Then I go back to the BIOS and start tweaking the timings. Now you will have to find a compromise between testing accurately, by changing only one timing at a time, but which takes a long time, or testing fast by changing multiple timings at a time and risk not knowing what’s to blame if the settings are not stable. What I like to do here is changing timings one at a time, but only test if they post, not if they are stable. Then once I have tweaked all timings of a given “category”, like all primary timings, for as low as they will post, I boot fully into the OS and run the stability test. If the test passed, fine, onto the next batch of timings. If the test detects an instability, boot back into the bios and loosen timings.

For maximum efficiency, you basically want to alternate between success and failure in stability testing with different settings as fast as possible. You might know the mathematical thought experiment of having to find the lighter one of 12 identically looking spheres by only weighing subsets of them 3 times in total. The solution is to divide the spheres in subsets and weigh them against each other. You can apply the same principal here, basically divide all timings that could be the cause of instability into two halves, change all timings of one half to auto and test again. This way you save time and don’t need to actually test one timing at a time.

Now you can probably see, why memory overclocking is a very time intensive endeavor. Because of that, you might want to save a certain state of settings and return to it later. For that, BIOS profiles are especially handy, so for instance you can switch between your known stable daily setting and work in progress unstable OC setting. Alternatively, you can of course also note down what settings you changed or make screenshots, from the BIOS or from the OS with tools that can readout all timings, which we will also get to. Long story short, it’s highly to keep records of the changes you make, also to avoid getting confused or simply losing progress.

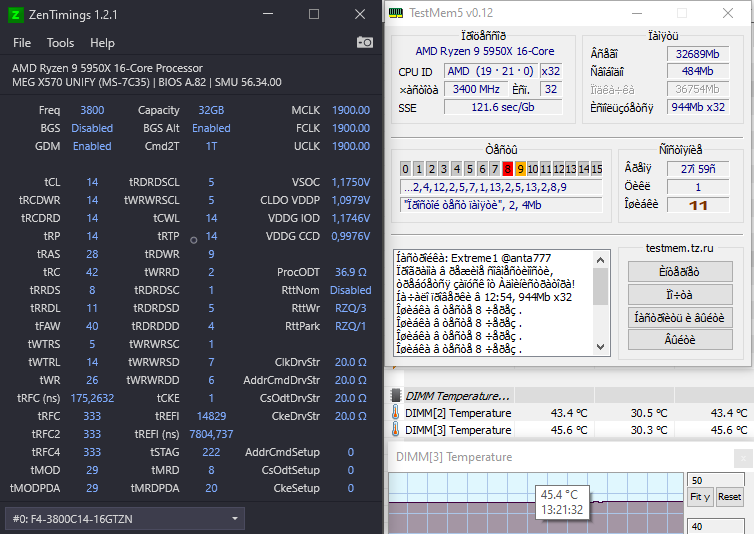

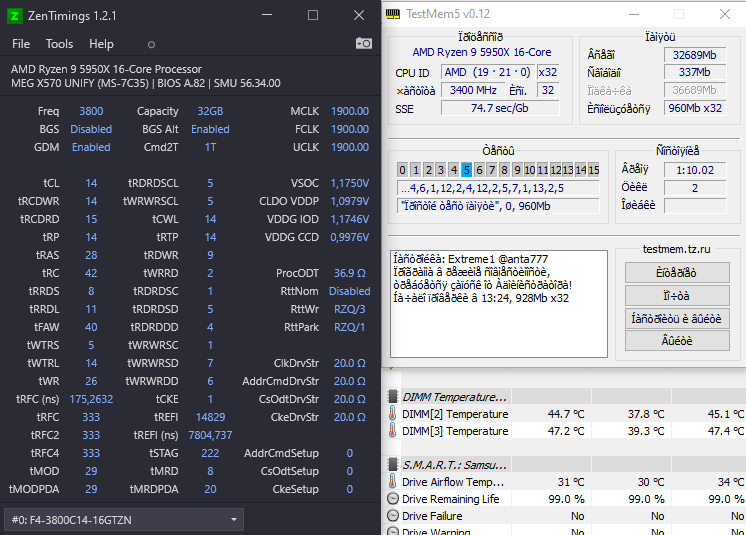

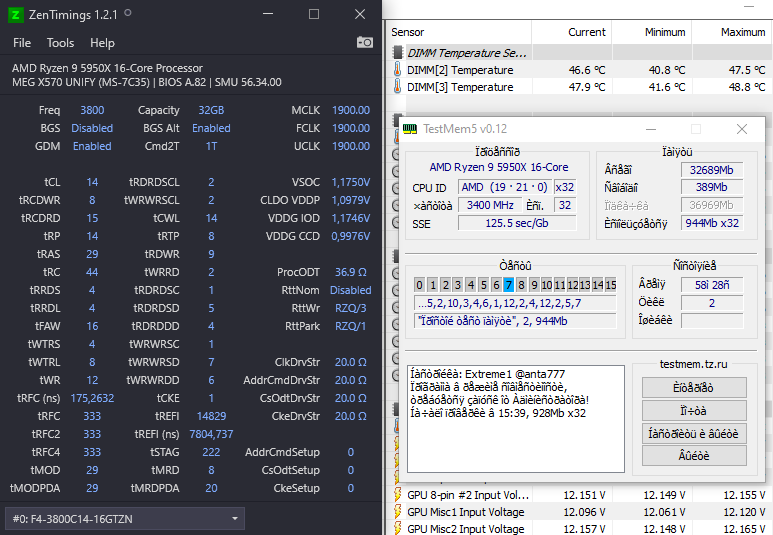

For the same reason, I also recommend “making checkpoints”, so once you have validated stability for a certain set of settings, make a screenshot of all settings, voltages and the successful stability test. This way, you always have a known good state that you can return to later if you find yourself in a situation where nothing seems to work anymore. And this will very likely happen to everyone. So if you don’t make notes or “checkpoints”, you will go insane. Trust me and thank me later. 😀

So that’s basically all that there is to memory overclocking. It’s quite time intensive, but by knowing some tricks and with experience, one will get faster at it. And as we have discussed many times before, depending on the use case, the gain in performance by overclocking your system memory can be very noticeable. If you have any feedback, spotted any errors or would like something to be added, please let me know in the forums. As mentioned already, this is intended to be an evolving document that every community member can chip in for. 😉

63 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Veteran

Urgestein

Mitglied

Urgestein

Urgestein

Urgestein

Mitglied

Veteran

Urgestein

Mitglied

Urgestein

Mitglied

Urgestein

Urgestein

Urgestein

Urgestein

Mitglied

Veteran

Alle Kommentare lesen unter igor´sLAB Community →