Die GPU-Beschleunigung in Adobe Premiere Pro 2021 ermöglicht es Content-Erstellern die Videoschnitt-Workflows zu beschleunigen, so dass man selbst erweiterte Multilayer-Timelines mit anspruchsvollen Effekten (wie z. B. Lumetri-Farbeffekten) in Echtzeit wiedergeben, scrubben und bearbeiten kann, ohne dass Frames verloren gehen. Das zumindest wäre der Idealfall. Die Mercury Playback Engine unterstützt CUDA und OpenCL als zwei Methoden der Hardwarebeschleunigung, wobei einige OpenCL-Implementierungen durchaus auch mal Probleme bereiten können. Es funktionieren allerdings beide, auch wenn sich die Anzahl unterstützter Filter nicht ganz deckt.

Und genau da kommt auch NVIDIA GPU Decode für H.264 und HEVC ins Spiel. Neben NvEnc und den Zeitvorteilen beim Encodieren, wird in Adobe Premiere Pro 2021 auch Decode voll unterstützt, also das Hardware-beschleunigte Abspielen von z.B. mehreren hochauflösenden 4K-Clips in Echtzeit in der Timeline, was nicht nur die CPU extrem entlastet, sondern auch die Abspiel-Rate konstant bei knapp 24 FPS hält. Mal abgesehen davon, dass dies auch bei mehreren parallel zu verarbeiteten Clips recht eindrucksvoll läuft, schiebt die GPU die CPU einmal mehr in den Hintergrund.

Der im Razer Blade Pro 15 verbaute Intel Core i7-10875H ist alles andere als ein Muskelprotz, so dass hier die GPU für gehörig Entlastung sorgen kann. Dazu kommt, dass ich das Notebook für diesen Test mit einer Art Docking-Station nutze, so dass ich den 4K-Content auch nativ am BenQ PD3220U betrachten kann, ohne mir stationär am Schminkspiegel-Display die Augen zu verbiegen.

Der heutige Benchmark setzt auf mehrere Sequenzen, wie z.B. eine 4K-Intro mit diversen Effekten und Sounds auf zwei Videoebenen und einer Ebene mit Titelgrafiken. Zu den angewandten Effekten gehören: Linsenverzerrung, Gaußsche Unschärfe, Mosaik, Suchränder, zusammen mit Videotransformationen (Rotation). Eine weitere Sequenz stellt ein komplett bearbeitetes Musikvideo samt 4K-Upscaling dar, einschließlich Lumakurvenanpassung, schneller Unschärfe, Rauschen, Farbton-Änderungen, RGB-Kurven, Schwarz-Weiß-Effekte, Bildmischung und Videoüberlagerung, die auch für die Echtzeitvorschau auf der Timeline herhalten muss.

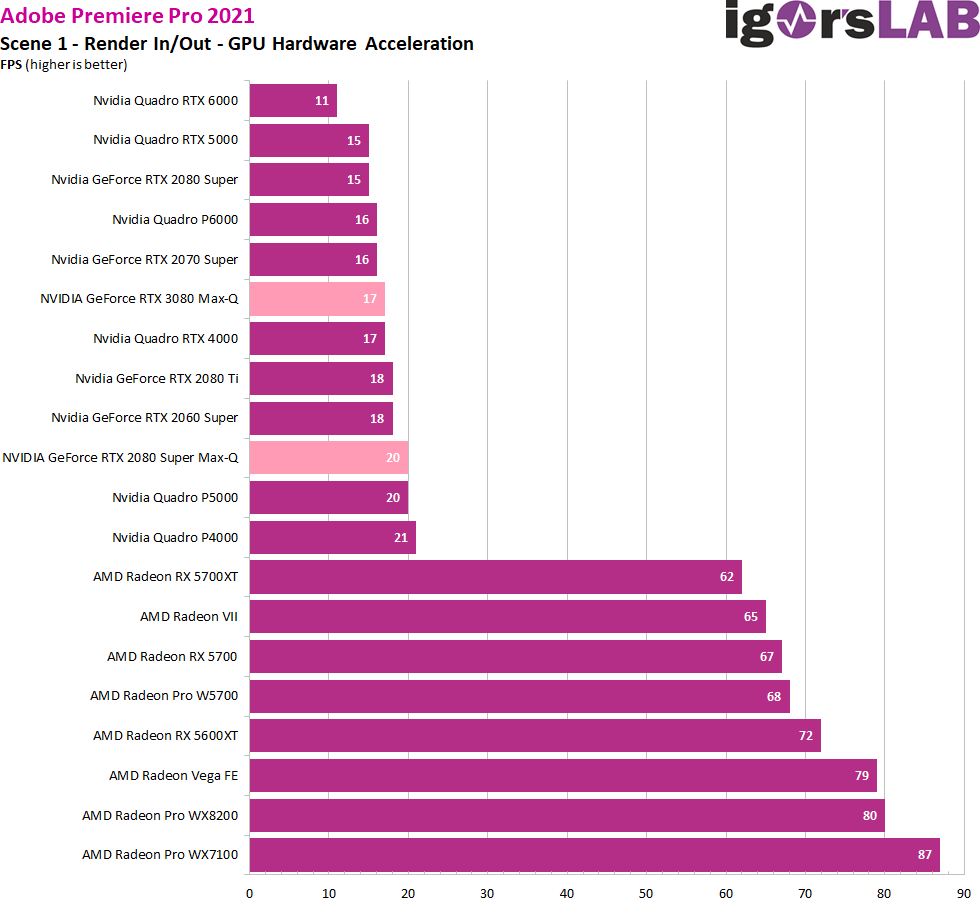

Abschließend zeigt eine weitere Sequenz die gleichzeitige Verarbeitung von insgesamt drei Full-HD-Teilsequenzen innerhalb einer einzigen 4K-Zeitleiste. Es werden drei separate Untersequenzen gezeigt, wobei eine Sequenz zusätzlich noch dupliziert wird. Alle Effekte für die Untersequenzen werden innerhalb der Master-Zeitleiste verarbeitet. In den Benchmarks vergleiche ich zunächst die Performance der Hardware-basierten Echtzeitwiedergabe für die erste Sequenz. Die Echtzeit-Vorschau der Timelines läuft idealerweise mit rund 24 FPS ab, alles was deutlich darunter liegt, ruckelt und stört beim Arbeiten.

Zunächst teste ich die simple Video-Enkodierung mittels mit NvEnc, um eine Ausgangsbasis für alle weiteren Benchmarks zu haben, die über das bloße Encodieren hinaus gehen. Da AMDs AMF eine fürchterliche Bildqualität ergibt und zudem nur über ein Drittanbieter-Plugin läuft, habe ich die Radeon-Karten hierfür einmal ausgeblendet. Das Notebook mit der 2080 Super Max-Q hängt etwas hinterher, was aber auch am begrenzten Power Limit und den Eigenheiten des Max-Q-Designs, sowie dem älteren Encoder liegen durfte. Die neue RTX 3080 Max-Q ist da schon einen Zahn flotter. Die älteren Pascal-Karten laufen aufgrund der schlechteren Bildqualität des veralteten Encoders außer Konkurrenz.

Testen wir nun das Pre-Rendering für die erste Sequenz. Das Vorabrendern vermeidet alle Stockungen im Playback natürlich, kostet aber eben auch erst einmal ordentlich Zeit. Doch auch hier macht das Notebook keine schlechte Figur, da fast alles von der GPU abgedeckt werden kann und die CPU nur Schützenhilfe leisten muss.

Beim 4K Video-Output samt Scaling und diversen Filtern samt Overlays hält sich die Bearbeitungszeit in Grenzen und die Performance des Notebooks sortiert sich im sehr guten Mittelfeld ein.

Beim abschließenden Zusammenführen dreier verschiedener Clips und dem Duplizieren eines dieser Clips zum vollen Quartett merkt man allerdings die Nachteile der eher limitierten Intel-CPU, da Dynamic Boost der GPU die volle Leitung zugesteht und dem Intel einfach schon von Haus aus etwas der Takt fehlt. Trotzdem kann man mit der blauen Bombe leben, weil die GPU ja eh die Hauptarbeit erledigt.

- 1 - Einführung und Übersicht

- 2 - KI-basierte Bildverbesserung und Upscaling

- 3 - NVIDIA Broadcast (API) - Nicht nur ein Spielzeug (aber auch)

- 4 - Adobe Premiere Pro 2021

- 5 - Black Magic Design DaVinci Resolve 17

- 6 - Autodesk Maya 2020 + Arnold, Blender

- 7 - 3ds Max und Inventor Pro

- 8 - Windows Oberfläche, Zusammenfassung und Fazit

21 Antworten

Kommentar

Lade neue Kommentare

1

Mitglied

Veteran

Urgestein

Urgestein

Urgestein

Urgestein

Urgestein

Mitglied

Urgestein

Urgestein

Urgestein

Urgestein

Urgestein

Mitglied

Urgestein

1

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →