Mit RTX Voice hatten wir uns ja schon öfters beschäftig, jetzt gibt es Broadcast, wo NVIDIA einerseits die Bilderfassung der Kamera bearbeiten kann, andererseits auch RTX Voice mit inkludiert. Leider ist das Ganze bisher RTX-exklusiv, da hilft auch im Moment kein Umbiegen des Installations-Paketes. Aber sei es wie es sei, es lohnt sich durchaus, sonst hätte ich mir den Aufwand sicher nicht auch noch angetan. Das mit dem Mikrofon und den Hintergrundgeräuschen kennen wir noch von RTX Voice. Das klappt beim Aufnahmegerät vorzüglich und lässt sich sogar noch mit einem eingebauten Testprogramm aufzeichnen und überprüfen. Man sollte es mit der Stärke nicht übertreiben, sonst clippt es etwas. Aber ansonsten ist das Ganze sicher richtig hilfreich, wenn im Hintergrund Staubsauger, Kaffeemaschine oder Fön lärmen. Das klappt auch bei der Wiedergabe, wenn der Gegenüber so ein Feature nicht besitzt, dann kann man sich diesen Geräuschteppich auf vor der Wiedergabe wieder schonrechnen lassen, AI sei Dank.

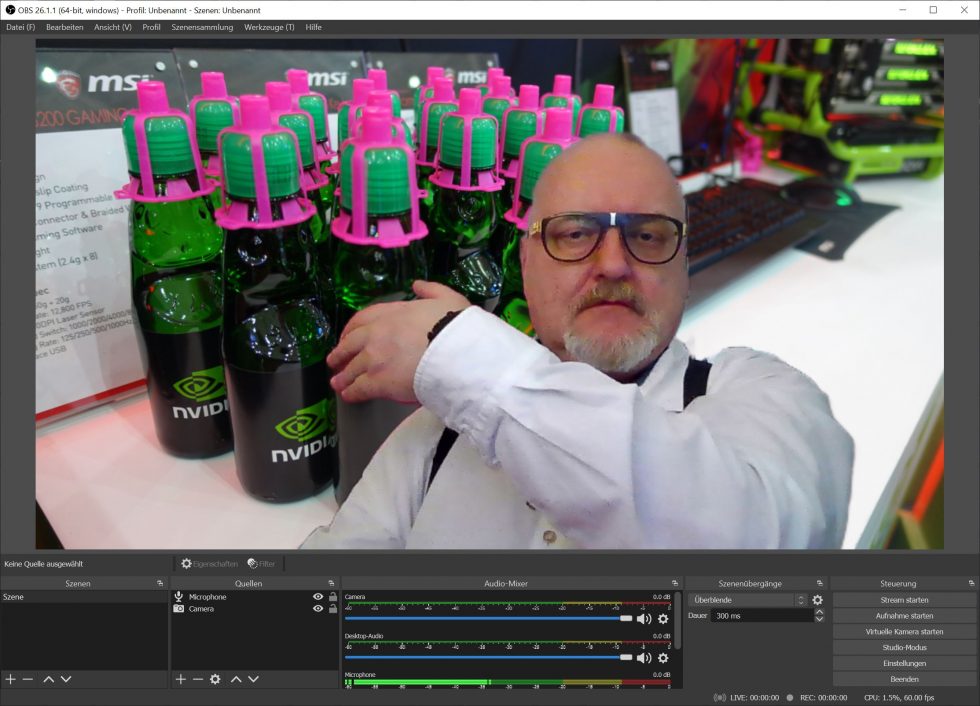

Jetzt aber kommt das eigentliche Highlight, nämlich die KI-basierte Erkennung des Protagonisten vor der Cam und das Manipulieren dessen, was nicht ich bin. Ich habe nicht nur Tausend Euro in mein Green-Wall-Studio investiert und dann kommt das hier zum Nulltarif. Gut, die Kanten sind ein klein wenig ausgefranst und bei schnellen Bewegungen gibt es partial auch schon mal leichte Artefakte (Finder), aber das sind meist provozierte Ausnahmen oder fieses Gegenlicht.

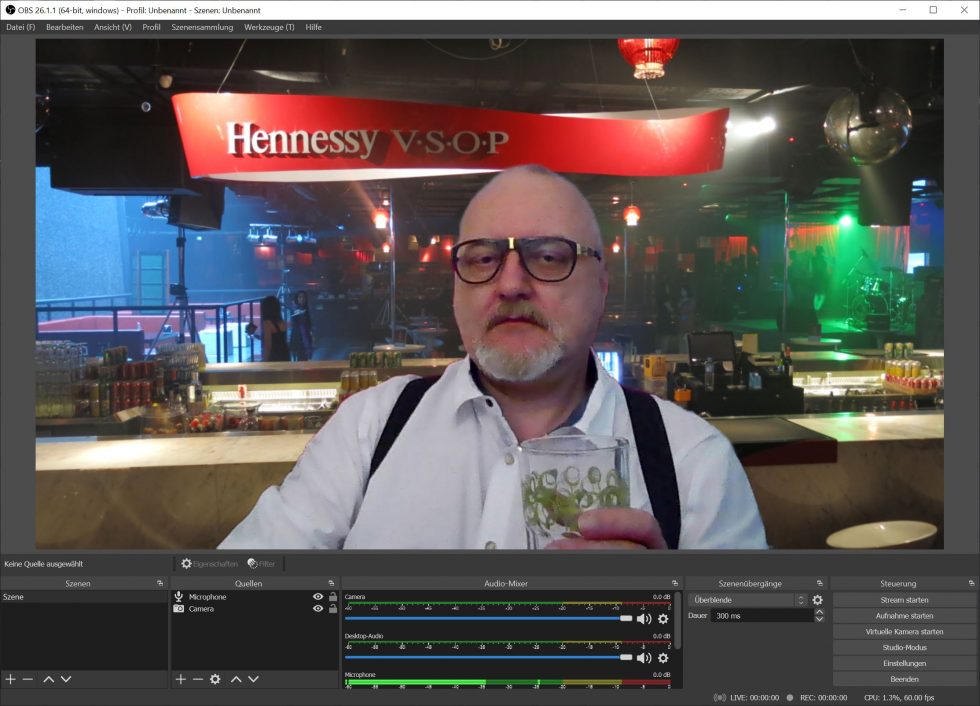

Es geht auch als Auslands-Studio, wie z.B. hier als Korrespondent in Taipeh. Kann man nicht hinfliegen, legt man sich halt eine Konserve in den Hintergrund und dreht die Heizung hoch. Dann sieht sogar die Stirn authentisch aus. Man muss Broadcast zugutehalten, dass Vieles auch mit der Qualität der Kamera steht und fällt. Leider ist die im Razer Blade eher schlecht und lichtschwach, so dass viele Artefakte auch ohne Zusatzprogramm bereits existierten. Was aber gut geht, ist der Echtzeit-Stream, der mit NvEnc deutlich performanter ist als mit der CPU. Netter Nebeneffekt: der Lüfter des Notebooks bleibt dezent im Hintergrund, weil die GPU das deutlich effizienter erledigt.

Insgesamt hat man natürlich auch seinen Spaß, aber gerade für Videokonferenzen ist ein eher offizieller Hintergrund besser als das Chaos im heimischen Home-Office. Oder aber man zeichnet das Ganze als Videodatei auf. MKV-Container oder MP4, auch hier hilft NvEnc bei der Echtzeitencodierung, ohne dass sich die eher fußlahme CPU einen abquälen muss. Ein Test mit zwei Bildschirmen, auf denen zwei verschiedene Apps laufen bringt das Notebook auch nicht ins Stocken, denn die last liegt fast allein auf der GPU.

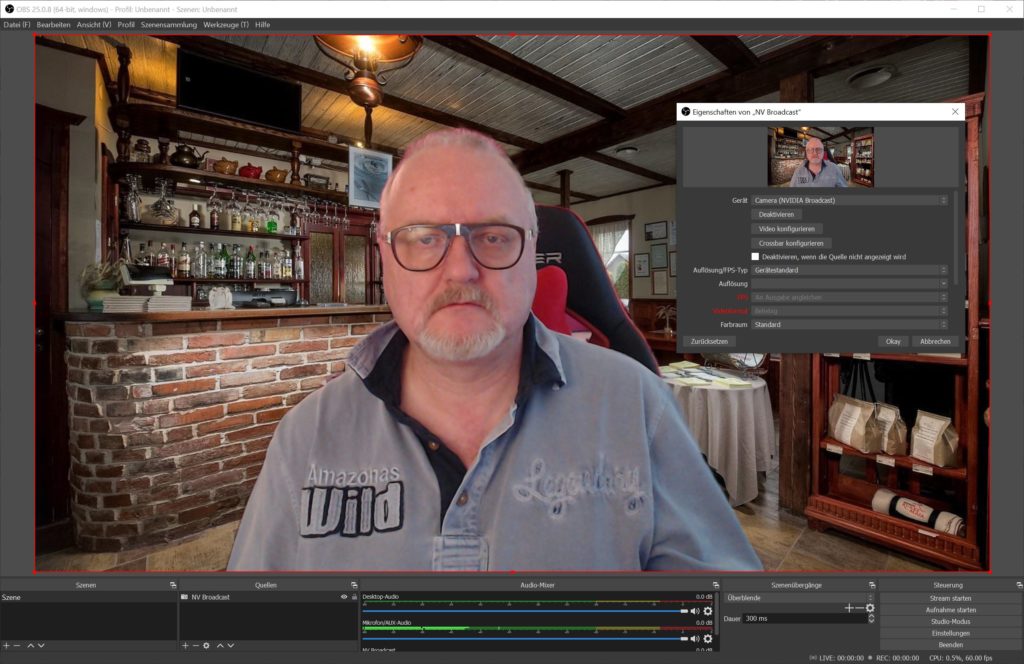

Das alles lässt sich, wie schon bei RTX Voice, in OBS einfach als Aufnahme- oder Ausgabe-Gerät auswählen. Das geht in jeder Software, die einem die Device-Auswahl zulässt. Skype, Teams & Co tun es auch, OBS haben wir ja schon gesehen. Hier kann man sich einfach das Gerät aussuchen und einrichten, egal, ob Video oder Audio. Kompliziert ist definitiv was anderes.

Außerdem nutzen immer mehr Firmen auch die API und die Funktionen von NVIDIAs Broadcast auch direkt in Apps oder Plugins zu implementieren. So bringt VoiceFX z.B. NVIDIA Broadcasts Noise Removal in VST3-kompatible Editing-Apps. Xaymar, der Entwickler des beliebten StreamFX Plugins für OBS Studio, das bereits das AR SDK nutzt, hat mit VoiceFX nun auch Noise Removal zu einem VST3 Filter hinzugefügt. Damit können alle Anwender die NVIDIA-Funktion Noise Removal direkt nutzen, um Hintergrundgeräusche direkt aus Video- und Audiobearbeitungsprogrammen wie Adobe Premiere Pro und Adobe Audition zu entfernen. Auch nachträglich.

- 1 - Einführung und Übersicht

- 2 - KI-basierte Bildverbesserung und Upscaling

- 3 - NVIDIA Broadcast (API) - Nicht nur ein Spielzeug (aber auch)

- 4 - Adobe Premiere Pro 2021

- 5 - Black Magic Design DaVinci Resolve 17

- 6 - Autodesk Maya 2020 + Arnold, Blender

- 7 - 3ds Max und Inventor Pro

- 8 - Windows Oberfläche, Zusammenfassung und Fazit

21 Antworten

Kommentar

Lade neue Kommentare

1

Mitglied

Veteran

Urgestein

Urgestein

Urgestein

Urgestein

Urgestein

Mitglied

Urgestein

Urgestein

Urgestein

Urgestein

Urgestein

Mitglied

Urgestein

1

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →