Nach den bereits ausführlich getesteten Referenzkarten der RX-6000-Serie von AMD hat es auch die XFX RX 6800 XT Merc 319 16 GB als Boardpartnerkarte den Weg zu mir ins Labor gefunden. Die anhaltende Nichtverfügbarkeit aller dieser Karten für die breite Masse ist umso ärgerlicher, als dass es sich bei diesen Produkten um wirklich gute und konkurrenzfähige Grafikkarten handelt, die es verdient hätten, auch die breite Masse der Kaufwilligen zu beglücken. Und so bleibt zu hoffen, dass sich die Lage bald wieder bessert. Doch immer schön der Reihe nach…

Mit der (Achtung! Offiziell vorgeschriebener Name laut AMDs Nomenklatur) “XFX Merc 319 AMD Radeon™ RX 6800 XT Gaming Graphics Card with 16GB GDDR6, AMD RDNA™ 2”, die ich im Artikel der Einfachheit halber wieder XFX RX 6800 XT Merc 319 16 GB nennen werde, da sonst die Charts und Legenden explodieren würden, liegt hier ein besonders schweres und auffälliges RDNA2-Exemplar bereit, bei dem man schon zweimal hinhören muss, um es zu hören.

Diese Grafikkarte kommt, wie alle RX 6000 Modelle, mit dem neuen Videocodec AV1 zurecht, sie unterstützen erstmals auch DirectX 12 Ultimate und damit eben auch DirectX Raytracing (DXR). Mit AMD FidelityFX bieten sie zudem ein Feature, das Entwicklern zudem mehr Spielraum bei der Auswahl der Effekte ermöglichen soll. Ebenfalls dabei ist Variable Rate Shading (VRS), was immens Rechenleistung sparen kann, wenn Bildbereiche, die ohnehin nicht im Auge des Spielers liegen, in der Darstellungsqualität smart reduziert werden. Soviel zum Feature-Set aller neuen Radeon-Karten.

Mit einer UVP von rund 800 USD (Euro-Preise fehlen noch) liegt man nicht soweit über der UVP der Referenzkarten, wie es manch anderer Mitbewerber angekündigt hat, ist aber auch nicht sonderlich günstig. Allerdings steckt hier natürlich auch ein wenig die Knappheit der Produkte mit im Preis, denn wo früher die Straßenpreise als Balsam für die Käuferseele galten, muss man sich mittlerweile geradezu vor ihnen fürchten.

Optik und Haptik

Die XFX RX 6800 XT Merc 319 16 GB wiegt 1787 Gramm und ist damit deutlich schwerer als die Referenzkarte! Sie ist mit ihren satten 34 cm auch länger, stattliche 12,5 cm hoch (12 cm Einbauhöhe ab PEG) und dazu 5.6 cm dick (2.7-Slot-Design), wobei noch eine Backplate und das PCB mit insgesamt fünf weiteren Millimetern dazukommen. Der Korpus ist aus haptisch sehr vorteilhaften Leichtmetall, der XFX-Schriftzug und die Radeon-Bezeichnung auf der Oberseite sind LED-beleuchtet.

Versorgt wird das massive Bollwerk samt Illumination über zwei standesübliche 8-Pin-Buchsen, also alles wie bekannt und gehabt. Wir sehen hier auch die vertikale Ausrichtung der Kühllamellen und die Platinenverstärkung in Form eines umlaufenden Rahmens.

Die Slot-Blende ist geschlossen, trägt 1x HDMI 2.1 und zwei DP-Anschlüsse. Dazu kommt die USB Type C Buchse. Mehr zum Aufbau, dem Kühler und der Bestückung dann auch noch auf der nächsten Seite beim Teardown.

Technik und Dual-BIOS

Mit den 72 Compute Units (CU) besitzt die XFX RX 6800 XT Merc 319 16 GB insgesamt 4608 Shader. Während der Basistakt mit 2090 MHz angegeben wird, liegt der Boost-Takt bei 2340 MHz. Karte setzet auf 16 GB GDDR6 mit 16 Gbps, die sich aus jeweils 8 Modulen mit 2 GB Größe ergeben. Dazu gehört auch das 256-Bit Speicherinterface und der 128 MB große Infinity Cache, der das Bandbreitenproblem lösen soll. Die Karte verfügt über ein umschaltbares Dual-BIOS, allerdings konnte ich keine Unterschiede feststellen, auch nicht beim Auslesen der BIOS-Informationen.

Raytracing / DXR

Spätestens seit der Präsentation der neuen Radeon-Karten ist klar, dass auch AMD Raytracing unterstützen wird. Hier geht man einen zu NVIDIA deutlich abweichenden Weg und implementiert einen sogenannten “Ray Accelerator” pro Compute Unit (CU). Da die Radeon RX 6800 insgesamt 72 CUs besitzt, ergeben sich somit auch 72 solcher Beschleuniger für die Radeon RX 6800XT, bei der kleineren Radeon RX 6800 sind es noch 60. Eine GeForce RTX 3080 kommt auf 68 RT Cores, also nominell erst einmal weniger. Beim Vergleich der kleineren Karten steht es dann 62 für die RX 6800 und 46 für die GeForce RTX 3070. Allerdings sind die RT-Cores anders organisiert und man wird abwarten müssen, was hier Menge gegen Spezialisierung ausrichten kann. Es ist am Ende also erst einmal ein Äpfel und Birnen Vergleich.

Doch was hat sich AMD hier ausgedacht? Jeder dieser Beschleuniger ist erst einmal in der Lage, gleichzeitig bis zu 4 Strahl-/Box-Schnittpunkte oder einen einzigen Strahl-/Dreieckschnitt pro Takt zu berechnen. So berechnet man die Schnittpunkte der Strahlen mit der Szenengeometrie (analog zur Bounding Volume Hierarchy), sortiert sie zunächst vor und gibt diese Informationen dann an die Shader zur weiteren Bearbeitung innerhalb der Szene zurück bzw. gibt das finale Shading-Resultat aus. NVIDIAs RT-Cores scheinen da allerdings deutlich komplexer vorzugehen, wie ich es beim Turing-Launch bereits ausführlich erläutert habe. Was zählt, ist allein das Ergebnis und genau dafür haben wir auch passende Benchmarks.

Smart Access Memory (SAM)

AMD zeigte auf der Präsentation der neuen Radeon-Karten bereits SAM, also Smart Access Memory – ein Feature, das ich heute zusätzlich auch zu den normalen Benchmarks aktiviert habe, womit auch ein direkter Vergleich möglich wird. Doch eigentlich ist SAM nicht Neuers, nur verbal schöner verpackt. Dahinter verbirgt sich nämlich nichts anderes als der clevere Umgang mit dem Base Address Register (BAR) und genau dieser Support muss zwingend auch im Unterbau aktiviert sein. Bei moderner AMD-Grafikhardware spielen größenveränderbare PCI-Bars (siehe auch PCI SIG vom 24.0.4.2008) schon länger eine wichtige Rolle, da die eigentlichen PCI BARs normalerweise ja nur auf 256 MB begrenzt sind, während man bei den neuen Radeon Grafikkarten nun bis zu 16 GB VRAM vorfindet.

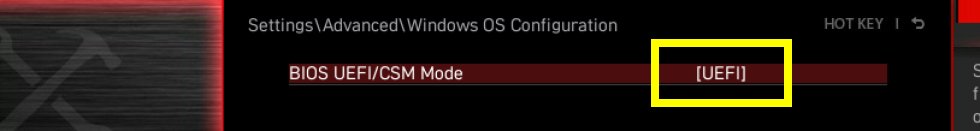

Die Folge ist, dass nur ein Bruchteil des VRAM für die CPU direkt zugänglich ist, was ohne SAM eine ganze Reihe von Umgehungslösungen im sogenannten Treiber-Stack erfordert. Das kostet natürlich stets Performance und sollte demzufolge vermieden werden. AMD setzt bei SAM also genau dort an. Neu ist das nicht, muss aber sauber im UEFI implementiert und später auch aktiviert werden. Das wiederum geht nur, wenn das System im UEFI Modus läuft und CSM/Legacy deaktiviert sind.

CSM steht dabei für das Compatibility Support Module. Das Compatibility Support Module gibt es ausschließlich unter UEFI und es sorgt dafür, dass ältere Hardware und Software auch mit UEFI funktioniert. Das CSM ist immer dann hilfreich, wenn nicht alle Hardware-Komponenten zu UEFI kompatibel sind. Einige ältere Betriebssysteme sowie die 32-Bit-Versionen von Windows lassen sich auch nicht auf UEFI-Hardware installieren. Genau diese Kompatibilitätseinstellung verhindert jedoch die saubere und für die neuen AMD-Komponenten benötigte Windows-Variante oft schon bei der Installation.

Benchmarks, Testsystem und Auswertungssoftware

Für die Benchmarks habe ich, analog zum Launchartikel, die gleichen 10 Spiele gewählt und dabei zwischen alt und neu, sowie AMD- oder NVIDIA-speziell gewichtet. Da sich alles sehr ähnlich zum Launchartikel der Radeon-Karten verhält, gibt es diesmal nur leine kumulierte Zusammenfassung aller Spiele mit einer ausführlichen Erklärung für jede Auflösung. Die Leistungsaufnahme gibt es ebenfalls sehr ausführlich, so wie Ihr es ja auch gewohnt seid.

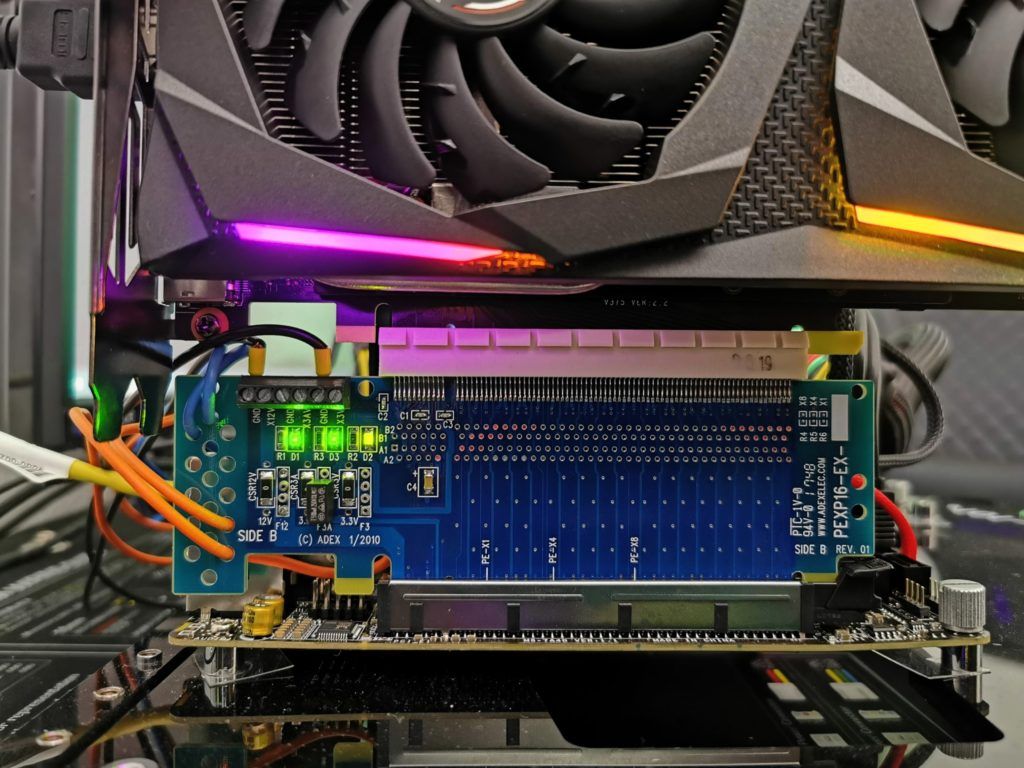

Das Benchmarksystem ist neu und ich setze nunmehr auch auf PCIe 4.0, passende X570 Motherboards in Form der MSI MEG X570 Godlike und einen selektierten Ryzen 9 5950X, der wassergekühlt übertaktet wurde (PBO + 500 MHz). Dazu kommen der passende DDR4 4000 RAM von Corsair, sowie mehrere schnelle NVMe SSDs. Für das direkte Loggen während aller Spiele und Anwendungen nutze ich meine eigene Messstation mit Shunts und Riser-Karte, sowie NVIDIAs PCAT in Spielen, was den Komfort ungemein erhöht.

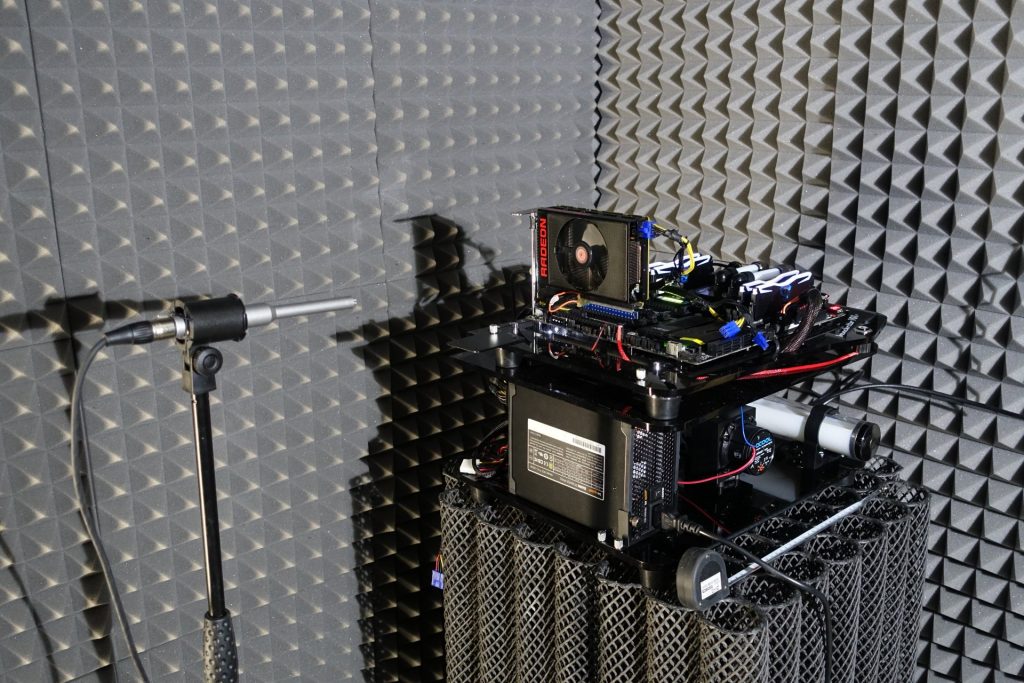

Die Messung der detaillierten Leistungsaufnahme und anderer, tiefergehender Dinge erfolgt hier im Speziallabor auf einem redundanten und bis ins Detail identischem Testsystem dann zweigleisig mittels hochauflösender Oszillographen-Technik…

…und dem selbst erschaffenen, MCU-basierten Messaufbau für Motherboards und Grafikkarten (Bilder unten), wo am Ende im klimatisierten Raum auch die thermografischen Infrarot-Aufnahmen mit einer hochauflösenden Industrie-Kamera erstellt werden. Die Audio-Messungen erfolgen außerhalb in meiner Chamber (Raum im Raum).

Die einzelnen Komponenten des Testsystems habe ich auch noch einmal tabellarisch zusammengefasst:

| Test System and Equipment |

|

|---|---|

| Hardware: |

AMD Ryzen 9 5950X OC MSI MEG X570 Godlike 2x 16 GB Corsair DDR4 4000 Vengeance RGB Pro 1x 2 TByte Aorus (NVMe System SSD, PCIe Gen. 4) 1x 2 TB Corsair MP400 (Data) 1x Seagate FastSSD Portable USB-C Be Quiet! Dark Power Pro 12 1200 Watt |

| Cooling: |

Alphacool Eisblock XPX Pro Alphacool Eiswolf (modified) Thermal Grizzly Kryonaut |

| Case: |

Raijintek Paean |

| Monitor: | BenQ PD3220U |

| Power Consumption: |

Oscilloscope-based system: Non-contact direct current measurement on PCIe slot (riser card) Non-contact direct current measurement at the external PCIe power supply Direct voltage measurement at the respective connectors and at the power supply unit 2x Rohde & Schwarz HMO 3054, 500 MHz multichannel oscilloscope with memory function 4x Rohde & Schwarz HZO50, current clamp adapter (1 mA to 30 A, 100 KHz, DC) 4x Rohde & Schwarz HZ355, probe (10:1, 500 MHz) 1x Rohde & Schwarz HMC 8012, HiRes digital multimeter with memory function MCU-based shunt measuring (own build, Powenetics software) NVIDIA PCAT and FrameView 1.1 |

| Thermal Imager: |

1x Optris PI640 + 2x Xi400 Thermal Imagers Pix Connect Software Type K Class 1 thermal sensors (up to 4 channels) |

| Acoustics: |

NTI Audio M2211 (with calibration file) Steinberg UR12 (with phantom power for the microphones) Creative X7, Smaart v.7 Own anechoic chamber, 3.5 x 1.8 x 2.2 m (LxTxH) Axial measurements, perpendicular to the centre of the sound source(s), measuring distance 50 cm Noise emission in dBA (slow) as RTA measurement Frequency spectrum as graphic |

| OS: | Windows 10 Pro (all updates, current certified or press drivers) |

- 1 - Einführung und technische Details

- 2 - Teardown: Platine, Spannunsversorgung, Kühler

- 3 - Gaming Performance

- 4 - Leistungsaufnahme beim Gaming und Effizienzanalyse

- 5 - Leistungsaufnahme, Spannungen und Normeinhaltung

- 6 - Lastspitzen und Netzteil-Empfehlung

- 7 - Taktraten und Temperaturen

- 8 - Lüfter und Geräuschemission ('Lautsärke')

- 9 - Übersicht, Zusammenfassung und Fazit

90 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Urgestein

Urgestein

1

Urgestein

Mitglied

Urgestein

Mitglied

Veteran

Urgestein

Urgestein

Urgestein

Mitglied

Veteran

Veteran

Mitglied

Urgestein

Mitglied

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →