Kommen wir nun zum neuen ATX-Standard 3.0 und dem, was da gerade im Spezifikations-Hinterzimmer unter Einbeziehung der CPU- und GPU-Hersteller heimlich ausgeknobelt wird. Das Ganze hat es wirklich in sich und genau hier setzt auch mein Kritikpunkt an. Zum Einen können derart konstruierte Netzteile durchaus Probleme mit ältere Systemen verursachen (was z.B. aus Sicht eines bestimmten CPU-Herstellers ein zu duldender Kollateralschaden wäre) und zum Anderen verkompliziert es die Herstellung (und Kosten) wirklich effizienter Netzteile und Gesamtsysteme nur unnötig. Womit ich danach auch noch ein Wort zum von Intel propagierten ATX12VO v2.0 loswerden muss, der gegen jegliche Logik der Nachhaltigkeit und Sinnhaftigkeit verstößt und damit nur dem Interesse des Protagonisten dient. Doch dazu gleich mehr.

Leistungsaufnahme und Lastspitzen als extremer Mix

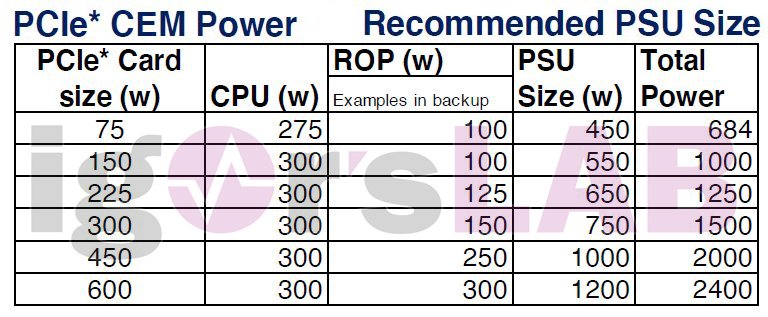

Kommen wir nun zu dem, was Intel den Herstellern für 2022 mit auf den Weg gegeben hat und staunen erst einmal über die Zahlen. Wer es nicht weiß: Mit CEM meint die PCI SIG Card Electromechanical, also die eingesteckten Add-In Karten. Der CPU-Hersteller veranschlagt für die CPU zwischen 275 und 300 Watt, was allerdings reichlich großzügig ist. Allerdings ist es auch mir schon gelungen, in einen Core i9-12900KF weit über 300 Watt hineinzupressen, was dann die großzügige Bemessung schnell wieder relativiert.

Die Leistungsaufnahmewerte der Grafikkarten sind auch alles andere als utopisch, denn auch ohne OC kolportiert man für AMDs und NVIDIAs neue Flaggschiffe um die 500 bis 550 Watt echte Board-Power. Wehe, wenn dann noch Übertaktungsspielraum besteht. Die Veranschlagung für den Rest des Systems ist ziemlich inkonsequent, denn der Ansatz mit 100 Watt ist bei Mainboard-Leistungsaufnahmen von bis zu 50 Watt auch im unteren Bereich schon etwas eng, während die 300 Watt beim größten System etwas übertrieben sind. In der Summe dürfte das aber trotz allem irgendwie hinkommen.

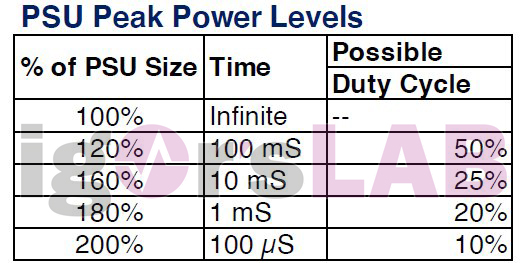

Die veranschlagten Werte für die PSU-Bemessung (“PSU Size”) sind damit geklärt, doch was hat es bitte schön mit der Total Power auf sich? Genau darüber müssen wir jetzt einmal reden, denn es ist genau der Part, der mir (und den Netzteilherstellern) die meisten Sorgen bereitet! Auch dafür gibt es von Intel eine definierte Vorstellung und gleichzeitige Ansage an die Produzenten der Stromversorger. Schauen wir uns das jetzt einmal an und bekommen große Augen. Auch wenn die Länge der höchsten Lastspitzen-Intervalle auf jeweils 100 μS begrenzt ist, ist der zulässige Gesamtanteil von bis zu 10% am Gesamtaufkommen geradezu abstrus. Das heißt, das Netzteil muss über 10% der Betriebsdauer eigentlich 200% der Leistung abliefern.

Damit wird aus dem 1,2 kW-Netzteil eigentlich ein verkapptes 2,4 kW-Netzteil. Denn man definiert so auch, dass der Normalbetrieb ohne Aufschlag bei gerade mal 50% liegen kann und die restliche Zeit munter überlastet werden darf. Natürlich wird dies alles mehr oder weniger auch auf eine reine Single-Rail-Lösung hinauslaufen, aber rein elektrotechnisch ist dies glatter Wahnsinn. Welche Supervisor-Chip soll hier noch in einem fest definierten Intervall eine zuverlässige Schutzschaltung für OCP/OPP realisieren können? Was ist dann noch eine zulässige Last und wo beginnt der Notfall?

ATX v3.0 – Grenzwerte aufweichen, Augen zu und irgendwie durch!

Und als wäre das alles noch nicht genug ökologischer und schaltungstechnischer Unsinn, setzt man gleich noch einen drauf. Denn auch wenn vielleicht einige der Hersteller mit entsprechend aufzubringenden Kosten in der Lage wären, solche Netzteile auch unter den aktuell geltenden ATX-Spezifikationen zu realisieren, liegt die Messlatte an die Qualität der Netzteile und die einzuhaltenden Grenzwerte für die meisten der Billigproduzenten doch viel zu hoch. Oder die Produkte wären dann zumindest wieder so teuer, dass die Akzeptanz komplett gegen null ginge. Also biegt man sich das Ganze etwas zurecht und riskiert damit sogar noch die Abwärtskompatibilität. Beginnen wir aber wieder bei der PCI SIG und schauen, was man dort vorgibt:

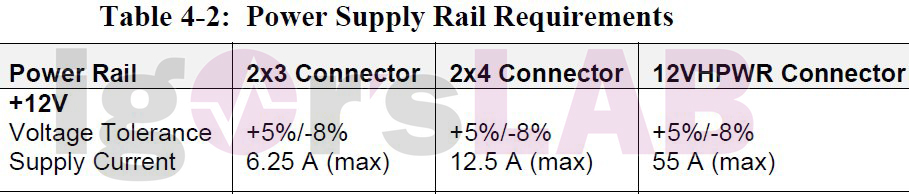

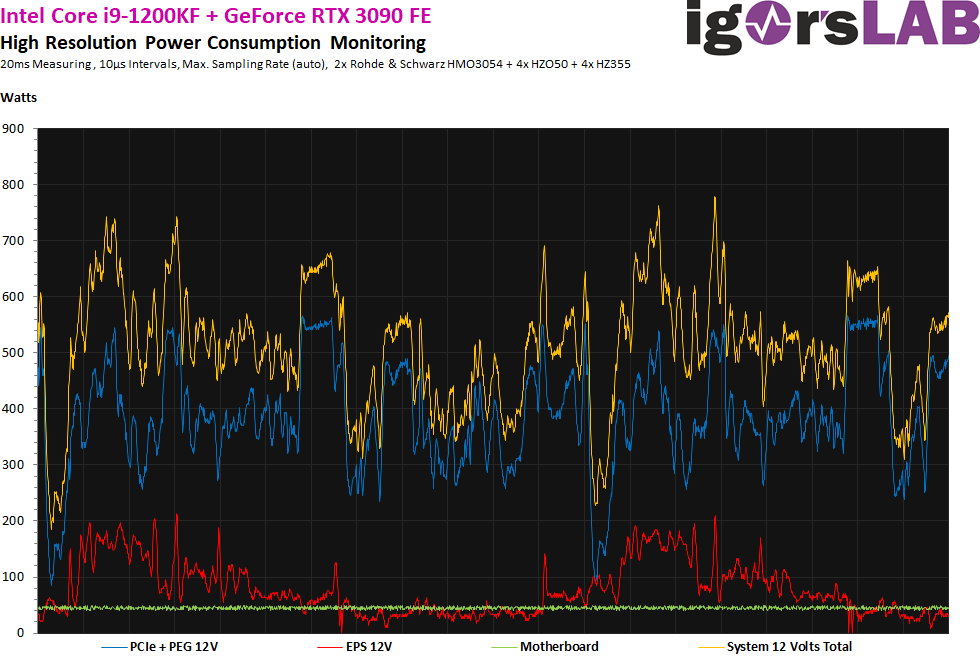

Soweit, so klar. Und nun kommen die Lastspitzen (“Transienten”) ins Spiel. Das wiederum betrifft das Netzteil und die sogenannte DC-Ausgangsspannungsregelung, die man zur Bewältigung von Leistungsschwankungen benötigt. Ihr kennt ja mein Hobby mit dem Aufspüren und Dokumentieren solcher Transienten und glaubt man dem, was aus den R&D der Grafikkartenhersteller an Informationen so herauströpfelt, dann wird es in nicht allzu weiter Zukunft recht ordentlich zur Sache gehen.

Den aktuellen Stand mit einer GeForce RTX 3090 FE, dem Core i9-12900KF und einem MSI MAG Z690 Unify habe ich einmal gegengetestet und es sind bereits jetzt und ohne OC, sowie ohne weitere Komponenten (außer den beiden SSDs) fast 800 Watt, die hier als Lastspitzen zuschlagen können. Mit einer gut gekühlten GeForce RTX 3090 und einem 450 Watt BIOS lägen wir dann heute schon mit etwas Pech bei 1000 Watt und darüber, denn die Spikes steigen ja nicht linear, sondern fast schon exponentiell.

Wir sehen ja, dass die Vorgaben mit den Toleranzwerten für die Grafikkarten von +5% bzw. -8 Prozent von den 12 Volt Nominalspannung durch die PCI SIG zwar bereits jetzt nicht sonderlich eng gesetzt wurde, aber die Gefahr einer Unterspannung durch noch schnellere und häufiger auftretende Lastwechsel (wir erinnern uns jetzt bitte an die bis zu 50% der Betriebsdauer) damit leider noch realer geworden ist. Wir rechnen einmal: Die -8% von 12 Volt sind -0,96 Volt und damit 11.04 Volt. die nicht unterschritten werden dürfen. Das ist deutlich großzügiger ausgelegt als die aktuellen ATX-Spezifikationen, die lediglich 11.4 Volt gestatten.

Dieser untere Wert soll bei ATX 3.0 aber nun auf 11.2 Volt abgesenkt werden, um die Lastspitzen großzügiger behandeln zu können. Da das in der Realität allein aber sicher immer noch nicht reicht und man ja auch den Spagat der Abwärtskompatibilität hinbekommen muss, will man bei ATX 3.0 bzw. ATX12VO v2.0 die 12 Volt Nominalspannung zusätzlich moderat auf 12.2 Volt anheben. So dass aus den 0.6 Volt der alten Spezifikation ein sattes Volt würde, das man nun als Schwankung zulässt. Das klingt erst einmal smart, ist aber gefährlich für andere Hardware, die empfindlich gegen Übervoltung ist. Dazu gehören auch Verbraucher mit diversen Kleinspannungen, die durch mehrere kaskadierte Step-Down-Konverter gewonnen wird und deren Endprodukt dann bereits deutlich vom geplanten und benötigten Spannungsfenster abweichen kann.

ATX12VO v2.0

Die von Intel propagierte Reduzierung der Netzteile auf pure 12,2-Volt-Lieferanten ist nicht nur schaltungstechnisch höchst unsinnig, sondern auch reichlich ineffizient. Ich kenne mehrere diesbezügliche Motherboard-Layouts, wo das Erzeugen der weiteren Teilspannungen bis hin zu den leistungshungrigen 5-Volt-Anschlüssen (USB 4 / TB 4) eine echte Herausforderung darstellt. Würde man das wirklich konsequent umsetzen wollen, dann gäbe es kein Motherboard ohne aktive Kühlung mehr und bereits das Micro-ATX Format wäre obsolet. Was man im ITX-Bereich aktuell mit den Kleinstplatinen und niedriger Leistungsaufnahme noch einigermaßen effizient hinbekommt, wird in den Leistungsbereichen aktueller PCs dann schnell zur Farce.

Gute Netzteile halten über mehrere Jahre und Garantiezeiten von 5 bis 10 Jahren sind auch keine Seltenheit. Statistisch gesehen werden aber jetzt schon Motherboards deutlich häufiger ersetzt als Netzteile. Verfrachtet man dann noch die ganzen DC-DC-Regler mit aufs Motherboard, würde dieses nicht nur signifikant teurer, sondern es würden bei jedem Ausfall oder Austausch auch wertvolle Ressourcen sinnlos verschwendet. Dann wird schnell mit entsorgt, was vielleicht noch funktioniert. Und dann sind ja auch noch die Schutzschaltungen, die es zu implementieren gilt.

Die Fehlerquote eines Motherboards würde zudem ebenfalls steigen, das haben erste statistische Erhebungen und MTBF-Tests an den Platinen ergeben. Auch das ist einer der Gründe, warum die komplette Netzteil- und Motherboard-Industrie gegen diesen überflüssigen Anschluss ist und lautstark rebelliert. Es ist zumindest erstaunlich, dass es Intel im Gegensatz zu anderen Normierungsversuchen nicht geschafft hat, sich trotz erdrückender Marktpräsenz und Einflussmöglichkeiten irgendwie damit durchzusetzen. Das will schon etwas heißen. Nichtsdestotrotz wird auch der ATX12VO v2.0 mit auf 12.2 Volt angehoben.

Zusammenfassung und Fazit

Ich halte den Ansatz, immer mehr an Leistung zuzuführen, nur um immer mehr Performance zu generieren, für den komplett falschen Weg, zumindest im Consumer-Bereich. Diese Spirale zu durchbrechen und das Know-How samt technischem Fertigungsfortschritt stattdessen für mehr Umweltverträglichkeit und Nachhaltigkeit einzusetzen, wäre mit Sicherheit das eigentliche Gebot der Stunde. Nur sind AMD, Intel und NVIDIA leider Firmen, an deren Hauptsitz elektrische Energie keine Rolle zu spielen scheint, weil auch alles, das wenig kostet, nicht die nötige Wertschätzung erfährt.

Aktuell muss man zwar an keinen explizit appellieren, derartige Produkte zu meiden, da es sie eh nicht zu kaufen gibt (bzw. die Verfügbarkeit der Nachfolger noch komplett in den Sternen steht), aber es wäre durchaus an der Zeit, darüber nachzudenken, wo das alles noch hinführen soll und ob man sich diesem Konsumzwang widerstandlos unterwerfen möchte. Das möchte ich den Lesern mal mit auf den Weg geben, wobei es ja am Ende jeder selbst in der Hand hat. Mit dem unsäglichen Mining will ich hier gar nicht erst anfangen, das ist aus meiner Position heraus eh sinnlos.

109 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Mitglied

Urgestein

Urgestein

Urgestein

1

Urgestein

Urgestein

Urgestein

1

Urgestein

Urgestein

Veteran

Veteran

Urgestein

Urgestein

Veteran

Urgestein

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →