Sicher, der Vollausbau des GA102 ist, vor allem übertaktet und gut gekühlt, ein gewaltiges Brett. Es ist eine Karte, die einer normalen GeForce RTX 3090 auch bei der Gaming-Performance in nichts nachsteht, dafür aber deutlich effizienter zu Werke geht. Doch für CPU-Tests im CPU-Bound (“Flaschenhals”) mit Auflösungen ab 1080p abwärts sind nicht nur der Chip und die theoretische Leistung zu betrachten, sondern alle Umstände bis hin zum Treiber. Falls Intels Alder Lake CPUs, vor allem das Flaggschiff in Form des Core i9-12900K(F), wirklich so schnell sein sollten, wie es kolportiert wird (ich stelle mich hier mal bewusst dumm, obwohl ich es nicht müsste), dann wäre die in der Summe aus Hard- und Software absolut schnellste Grafikkarte gerade mal gut genug.

Über den Praxiswert von Tests mit einer Bildschirmauflösung von 1280 x 720 Pixel (“720p”) ließe es sich zwar trefflich streiten, aber es gibt durchaus auch plausible Argumente, dies doch zu tun, selbst wenn wohl niemand mit High-End- oder Enthusiasten-Hardware jemals solche Briefmarken-Auflösungen ernsthaft nutzen wird. Nur ist es mittlerweile ja so, dass die CPU in höheren Auflösungen und besseren Settings fast immer von der Grafikkarte (GPU-Bound) limitiert wird und daher nicht die wichtigste Rolle spielt. Aber die meisten Anwender hängen auch heute noch bei 1440p und 1080p, auch wegen der so wichtigen hohen FPS-Zahlen in den üblichen Shootern. Und außerdem ist ja das 720p von heute vielleicht auch die CPU-Messlatte für das 1080p von morgen.

Intel hat sich in den eigenen Herstellerfolien genau deshalb natürlich auch die kleinste, noch Sinn ergebende Auflösung von 1920 x 1080 Pixeln (“1080p”) herausgesucht, was der Logik des zu überprüfenden CPU-Bounds durchaus entspricht. Im Gegensatz dazu werde ich allerdings 10 gegeneinander gut abgewogene Spiele in insgesamt vier Auflösungen von Ultra-HD (“2160p”) bis hinab zu 720p sehr ausführlich testen, denn es geht ja letztendlich darum, beide Teile der Leserschaft zu befriedigen, auch diejenigen, die mit 720p erst einmal nichts anfangen können. Dass es nicht 11 Spiele (wie angedacht) waren, liegt am leidigen Problem der DRM-Mechanismen, die mit der neuen CPU so ihre Probleme haben. Da wird Intel möglichst schnell nachbessern müssen (was sie aktuell ja auch hektisch tun). Denuvo entpuppt sich hier einmal mehr als Seuche, die mit der Trennung in E- und P-Cores nicht klarkommt.

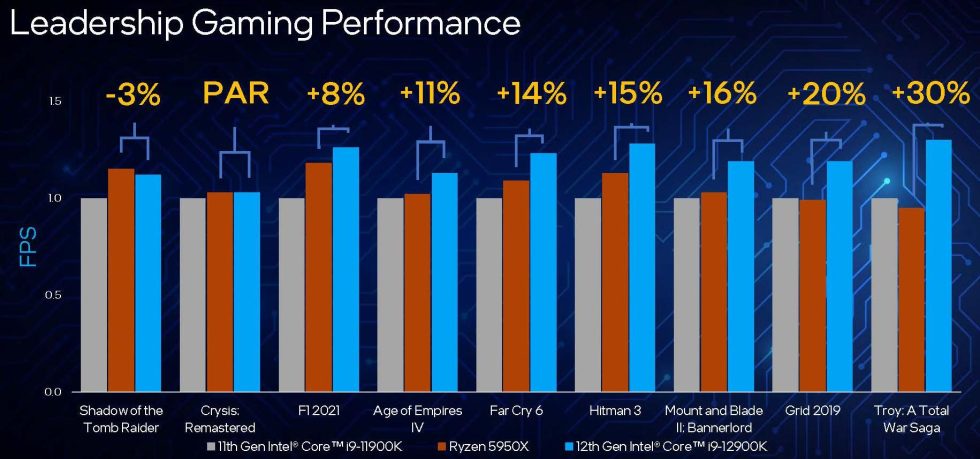

Apropos Intel-Folien, man muss auch hier noch eine wichtige Randbemerkung zur Testmethodik einfügen, die mir etwas sauer aufgestoßen ist. Ja, auch ich werde aus guten Gründen ausschließlich unter Windows 11 testen, denn der Einsatz von ADL macht unter Windows 10 weder Spaß, noch könnte man das Potential der CPUs voll ausnutzen. Nur wenn man als Kunde Intel schon soweit entgegen kommen soll und will, sich neben der CPU auch noch ein neues Betriebssystem zu besorgen, dann sollten auch die verglichenen CPUs nicht mit stumpfen Waffen kämpfen müssen.

Es ist aus meiner Sicht zwar nicht unverantwortlich, solche Benchmarks in einem sehr frühen Stadium zu erstellen und auch als internen Vergleich und zur Orientierung zu nutzen, nur ist es ja bekannt, dass die Ryzen-CPUs unter Windows 11 im Vergleich zu Windows 10 bis zu 15% Performance-Einbußen hinnehmen mussten. Dann aber ist eine bewusste Veröffentlichung falscher Benchmarkergebnisse umso bedenklicher. Ich habe manche Dinge mit einem komplett aktualisieren System (Windows Patches, AMD Chipsatz-Treiber, Motherboard-BIOS) nachgemessen und kann eigentlich nur mit dem Kopf schütteln.

Zahlen werde ich hier jetzt aus Gründen zwar keine nennen, aber es ist durchaus so, dass sich das Bild zum Teil doch sichtbar verändert hat. Um so eine alberne Folie einigermaßen aktuell zu produzieren braucht man noch nicht einmal einen ganzen Arbeitstag fürs Benchmarken einer einzelnen CPU und die notwenige Korrektur im PowerPoint. Das alles ist für ein Unternehmen mit den Ressourcen Intels eigentlich ein Klacks, aber ganz offensichtlich vom Marketing so nicht gewollt.

NVIDIA oder AMD – Auf der Suche nach der richtigen Karte

Doch ich will nicht zu weit abschweifen, sondern komme nun auf das Testsystem und die zweckmäßigste Grafikkarte zurück. Dass Intel im Kampf gegen AMDs Ryzen lieber eine Grafikkarte von NVIDIA in Form der GeForce RTX 3090 nutzt, ist durchaus verständlich, wenn auch nicht zu 100% zielführend. Während ich alle Tests im professionellen Bereich (auch im Hinblick auf die zertifizierte Hardware) mit einer sehr schnellen RTX A6000 erstellt habe, sieht es beim Gaming in den niedrigeren Auflösungen stellenweise nicht ganz so rosig aus, weil hier der Overhead aus NVIDIAs Treibern stellenweise gnadenlos zuschlägt. Wie stark und in welchem Spiel, das werde ich gleich noch zeigen, denn es ist ja auch nicht permanent.

Die RTX A6000 lässt sich mit etwas OC als Vollausbau des GA102 durchaus auf das Level der RTX 3090 bringen, nur nützt einem das Ganze eigentlich nur in Ultra-HD, wo die Radeon-Karte ihre bekannten Schwächen zeigt. Nur ist in diesem Fall sogar auf der GeForce ein absolutes GPU-Bound zu verzeíchnen, was den vermeintlichen Nachteil eher relativiert. Ja, es sind teilweise bis zu 12% Performanceunterschied zwischen beiden Karten zu verzeichnen, nur spielt dieser keine Rolle mehr. Der größte Performance-Unterschied lag hier bei weniger als 2% zwischen der langsamsten und der schnellsten CPU, also waren die Ergebnisse, wenn wann sie pro Karte verglich, wieder nahezu identisch.

Wichtiger ist hingegen, die echten Unterschiede im CPU-Bound herauszufinden, was uns in die niedrigen Auflösungen zwingt. Genau da aber deklassiert die von mir verwendete MSI RX 6900XT Gaming X die große RTX A6000 zum Teil erschreckend deutlich. Und genau so, wie bei Intel einige Spiele extrem aus dem Raster fallen, ist es auch bei meinem Test, wo es im Durchschnitt aller Spiele zwar “nur” reichlich 9 Prozentpunkte Unterschied sind, aber manche Spiele bis zu 20 Prozentpunkte schneller agieren. Ich habe diese Benchmarks sehr bewusst auch nur mit der zweitschnellsten Intel-CPU erstellt, werde aber vor dem Launch natürlich nur die Prozente und nicht die realen Messwerte in FPS nutzen.

Das Ganze sieht in Full-HD übrigens kaum anders aus, wenn auch nicht mehr ganz so krass. Aber Nachteile hat die RX 6900XT definitiv keine und nur darauf kam es mir an. Hier spielen also weder die Vorlieben für Hersteller noch irgendwelche Emotionen eine Rolle, sondern der gesunde Menschenverstand. Sicher, es ist ein Mehraufwand, Gaming- und Workstation-Benchmarks getrennt vorzunehmen, aber damit lässt sich die Arbeit sogar etwas parallelisieren, wenn man sich den Aufwand redundanter Hardware antun kann. Und um es abschließend klarzustellen: Natürlich sind auch Benchmarks mit der GeForce RTX 3090 (oder der RTX A6000) definitiv nicht falsch, im Gegenteil, aber Nuancen werden bei dem Test mit der Radeon sicher eher sichtbar und deutlicher. Und nur darum ging es mir.

Womit wir auch schon wieder durch wären. Die 720p sind bei meinen Tests also gesetzt, die hohen Auflösungen auch. Denn selbst wenn in diesen die FPS-Balken für alle CPUs leider sehr ähnlich ausfallen, biete ich Euch ja weitere Details wie Leistungsaufnahme für jedes Spiel, die Frame Times und Varianzen und damit letztendlich auch eine sehr gut aufgeschlüsselte Effizienzbetrachtung. Dann ergeben auch solche Benchmarks wieder einen praktischen Mehrwert bis hin zur Überlegung, ob man ab WQHD (“1440p”) überhaupt eine neue Plattform samt CPU braucht oder ob man vielleicht doch lieber erst einmal bei Windows 10 bleibt. Alder Lake gibts nur mit Zwangsheirat als WIntel-Couple, das muss man natürlich am Ende auch bedenken.

42 Antworten

Kommentar

Lade neue Kommentare

Veteran

Veteran

Veteran

Urgestein

1

Urgestein

1

Veteran

Veteran

Veteran

1

Veteran

1

Mitglied

1

Mitglied

Urgestein

Mitglied

1

Alle Kommentare lesen unter igor´sLAB Community →