Sind die 600 Watt wirklich das obere Ende oder wo liegen die Toleranzbereiche für die kurzzeitige Überschreitung der Normen? Und warum zeigt die GeForce RTX 3090 Ti plötzlich ein völlig anderes Verhalten unter Volllast? Genau diese Fragen werde ich heute beantworten, denn spätestens der Test der GeForce RTX 3090 Ti hat (wohl nicht nur) mich neugierig gemacht und nein, es ist KEIN Aprilscherz. Um das Ganze samt der internen Informationen überhaupt zu zu verstehen, benötigen wir natürlich auch hochauflösende Messungen im Mikrosekundenbereich und den passenden Vorher-Nachher-Vergleich. Erst danach werden wir auch die neuen Normen für die Erweiterungskarten zwischen 300 und 600 Watt Leistungsaufnahme verstehen, bei denen sich beide GPU-Hersteller bereits vor einem Jahr sehr intensiv eingebracht haben. Interessanterweise ist bei der Normierung des 12VHPWR-Anschlusses von Intel nichts zu lesen.

Vergleich der hochauflösenden Messungen und NVIDIAs Boost

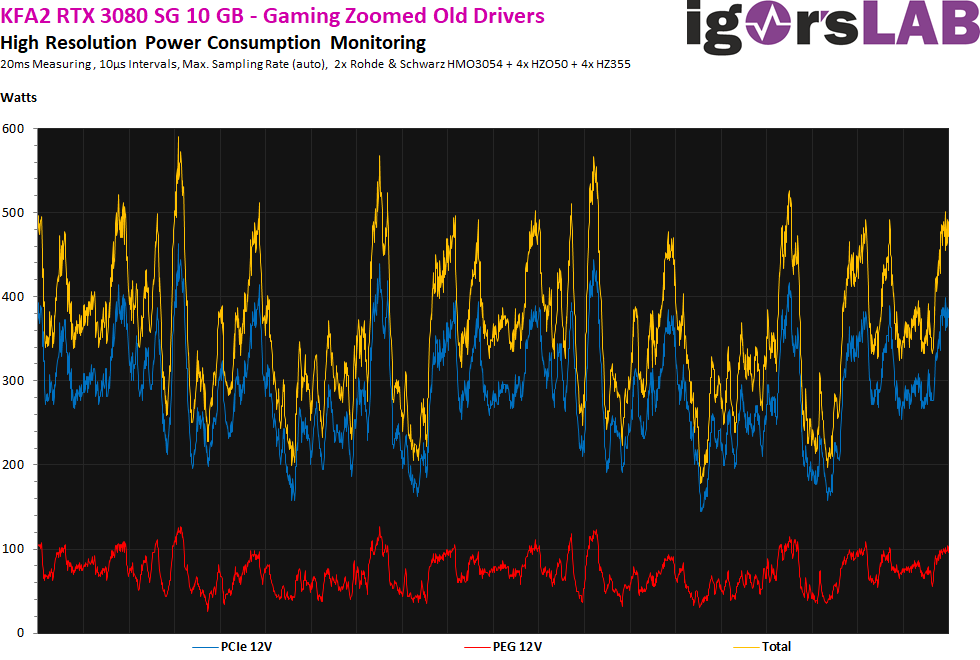

Beginnen wir zunächst mit einer typischen 320-Watt-Karte in Form der GeForce RTX 3080. Und wir erinnern uns, dass auch meine Untersuchungen und technischen Einlassungen dazu geführt hatten, dass NVIDIA den Treiber de facto “entschärft” hat, um wenigstens die größten Lastspitzen zu beseitigen. Mit anfänglich bis zu knapp 600 Watt war diese Karte natürlich schon eine echte Belastung für das System und auch das Netzteil, die größte Ratio zwischen der gemessenen Durchschnittsleistung von 320 Watt (2 Minuten) und den relevanten Intervallen um die 100 µs lag bei maximal 1.875. Zur Ratio schreibe ich auf der nächsten Seite noch etwas, denn die benötigen wir für die Normeinhaltung.

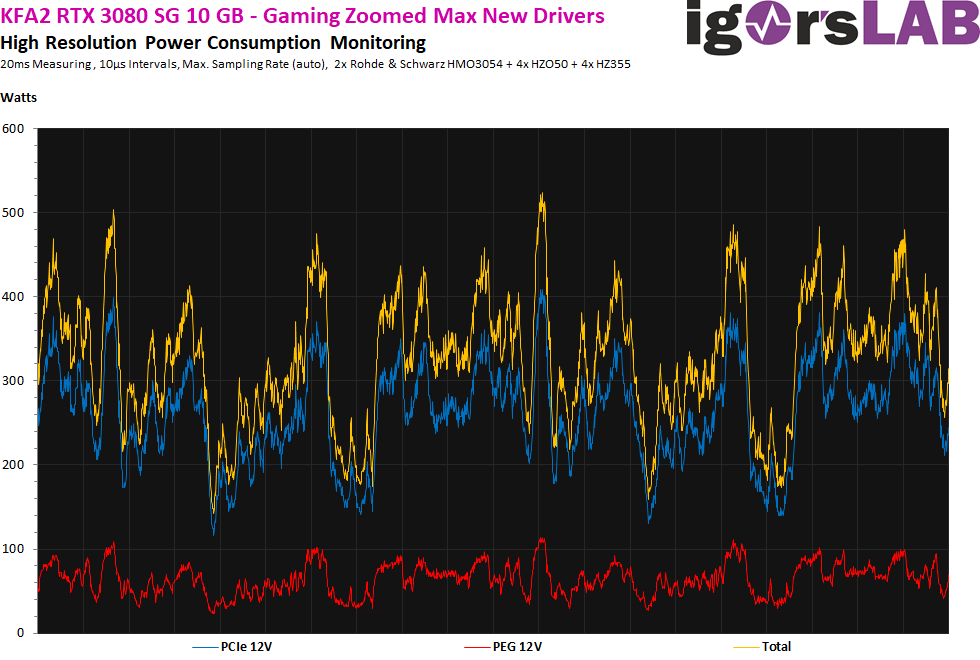

Dann hatte NVIDIA mit einem “Wundertreiber” gegengesteuert, musst aber auch etwas an Performance liegen lassen. Aber auch hier sind wir in der Spitze noch bei bis zu 520 Watt. Die Ratio zwischen der durchschnittlichen Board-Power den größten Spikes (100 µs) lag nun bei maximal 1.625. Aber auch hier sieht man keine Kappung durch die Firmware, sondern nur eine Reduzierung der Lastunterschiede (“Glättung”), die man höchstwahrscheinlich durch eine etwas geringere Spannungswechsel-Kurve erreicht.

Und dann kam die GeForce RTX 3090 Ti. Das, was ich im Vorfeld immer als “Spielwiese” für NVIDIAs neue Karten mit dem Ada-Chip ab Herbst bezeichnet habe, ist durchaus interessant, wobei es sich ja nicht nur auf NVIDIA beschränkt, sondern auch AMD mit einbezieht, die beide im Gremium der PCI SIG sitzen und ihre eigenen Forderungen und Vorschläge einbringen können. Die GeForce RTX 3090 Ti ist also eigentlich die erste Grafikkarte überhaupt, die sich in Bezug auf die Leistungsaufnahme und Versorgung den neuen Normen der PCIe 5.0 Spezifikation unterwerfen muss.

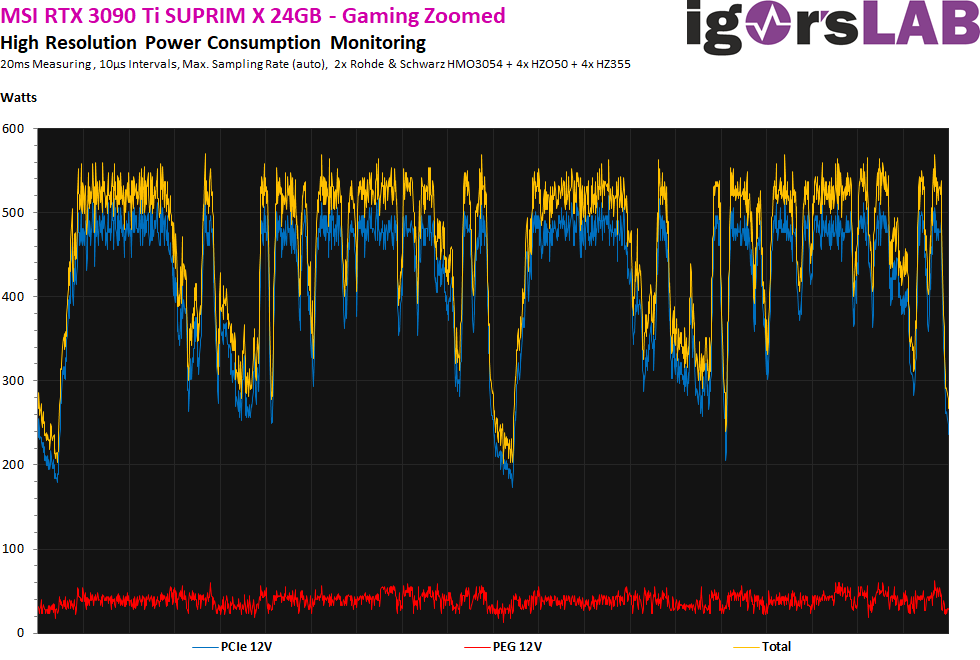

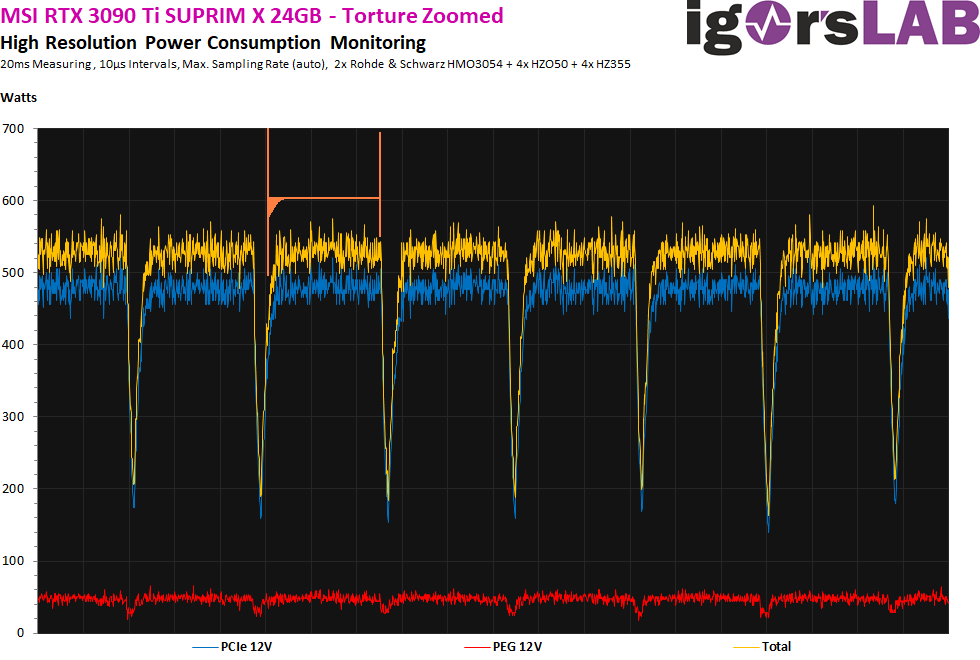

Werfen wir nun noch einen Blick auf die Messung bei knapp 480 Watt im Durchschnitt, wo die Lastspitzen meist nur bei maximal 580 Watt liegen. Die Ratio der relevanten Lastspitzen im 100 µs Intervall liegt nur noch bei 1.2, obwohl die Karte deutlich durstiger ist! Wir sehen auch einen deutlich ausgeglicheneren Kurvenverlauf und viel weniger Spannungseinbrüche.

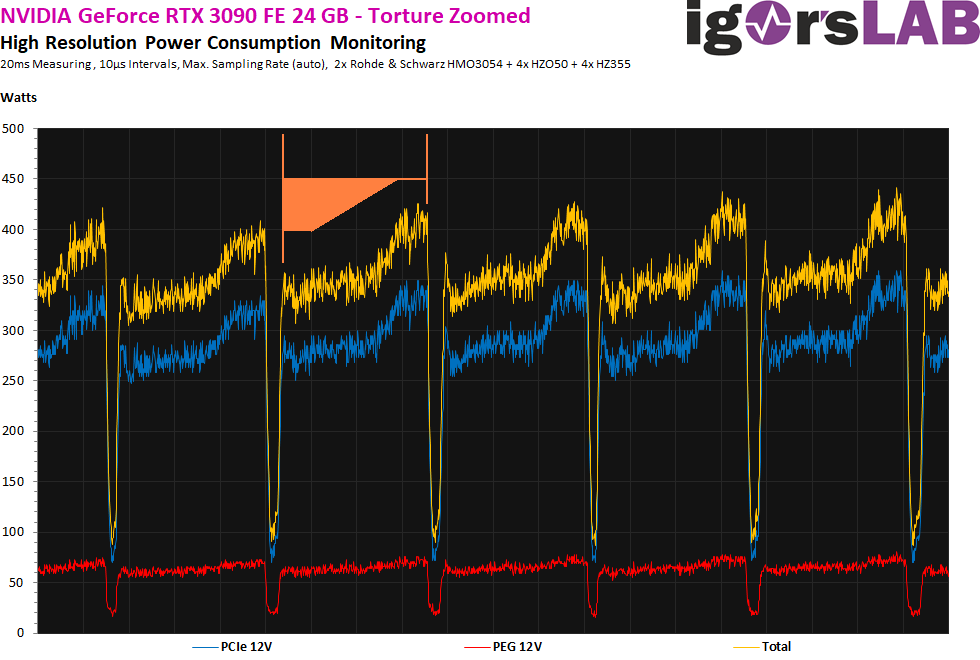

Vergleicht man nun noch die Volllast-Szenarien wie z.B. einen Stresstest, dann erkennt man das komplett geänderte Regelverhalten der Karte. Hier hat NVIDIA am Boost in der gesamten Spannungsversorgung ordentlich gefeilt. Zunächst habe ich das bisherige Verhalten anhand der GeForce RTX 3090 FE unter konstanter Dauerlast analysiert. Wir sehen nach einer kurzen “Einschwingphase” einen längeren Anstieg bis zu einer Kappungsgrenze, nach deren Erreichen und zeitlichen Überschreitung ein kompletter Leistungseinbruch erfolgt, bevor sich das Ganze immer und immer wieder identisch wiederholt:

Bei der neuen Karte sehen wir, auf einem sehr kurzen Zeitabschnitt, erst einmal einen etwas langsameren Anstieg (auch beim GPU-Takt) und danach jedoch einen sehr ausgeglichenen, geraden Lastverlauf bis zum üblichen Heruntertakten. Auch die Intervalle zwischen den einzelnen Lastabschnitten sind etwas kürzer geworden, einschließlich der “Pausen”. Wir sehen also sehr gut, dass NVIDIAs Regelung unter Einbeziehung aller Sensoren und der Eingangsüberwachung aller 12-Volt-Rails deutlich anders reagiert.

Die geringere “Regelwut” wird sich unter Umständen etwas negativ auf die erreichbare Performance auswirken, schafft aber im Umfeld dafür auch weniger Stabilitätsprobleme. Das ist wiederum für den sicheren Betrieb solcher Boliden mit bis zu 600 Watt Board-Power auch zwingend notwendig. Was das jetzt mit der PCI SIG und den Normen für den erstmals auch benutzten 12VHPWR-Stecker zu tun hat und welchen Einfluss AMD und NVIDIA gleichermaßen auf diese Normierung genommen haben, das lesen wir auf der nächsten Seite.

15 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Urgestein

Urgestein

Urgestein

Urgestein

Urgestein

Urgestein

Urgestein

Urgestein

Urgestein

Mitglied

Urgestein

Veteran

Urgestein

Veteran

Alle Kommentare lesen unter igor´sLAB Community →