Die NVIDIA RTX 3090 Ti FE hatte sich seinerzeit zum Launch als Sample leider recht rar gemacht und schaffte es erst viel später in mein gut sortiertes Archiv. Aber aufgeschoben ist nicht aufgehoben und da ich damals eher keinen Sinn darin sah, eine noch höher getaktete (und energetisch deutlich aufgeblasenere) Boardpartnerkarte in meiner Workstation zu testen, ist genau dieser Part seit längerer Zeit noch offen. Da es in letzter Zeit einige ähnliche Reviews mit mehr oder weniger knappem Inhalt gab, habe ich für heute einfach einmal einen GeForce-Showdown vorbereitet, bevor die nächste Generation scheibchenweise ab dem Herbst ins Rennen geschickt wird.

Und so treffen heute insgesamt 11 Karten aufeinander, wobei vor allem das Duell der GeForce RTX 3090 Ti FE gegen den anderen Vollausbau in Form der RTX A6000 interessant sein dürfte. Und weil mich immer wieder Zuschriften erreichten, dass ich das dann auch bitte mit der 300-Watt-Kappung für den Studio- und Workstation-Bereich machen möge, war es am Ende sogar noch ein gemeinsamer Aufwasch. Zur RTX 3090 Ti FE muss ich nicht mehr viel schreiben, diese ganzen Informationen hatte ich ja im Launchartikel genüsslich durchgekaut.

Die Test-Karte wurde mir vor einiger Zeit von NVIDIA zur Verfügung gestellt, um sie mit zu testen und man hat dort dem heutigen Vorhaben natürlich nicht negativ gegenüber gestanden, auch wenn man den Einsatz der RTX A6000 als Gegenpart wohl eher mit einem weinenden Auge gesehen haben dürfte. Es bestand somit keine Verpflichtung zur Veröffentlichung des heutigen Artikels, allerdings stelle ich mich der Herausforderung dieses Tests mehr als nur freiwillig, denn die Neugier verleiht ja bekanntlich Flügel und ich packe einfach mehrere Dinge zusammen in einen Artikel. Um hier jedoch objektiv zu bleiben, habe ich bewusst auf die Assets aus den Reviewer-Guides von NVIDIA verzichtet, sondern eigene Settings und Workloads bzw. bewährte Standard-Benchmarks aus der Industrie verwendet.

Betrachtet man die aktuellen Preise, dann hat das aktuelle Spitzenmodell nämlich ordentlich nachgegeben. Mit Straßenpreisen von reichlich 1400 bis knapp 1500 Euro sind einige der nicht so hoch übertakteten Boardpartnerkarten zwar immer noch keine Schnäppchen geworden, liegen aber mittlerweile schon wieder einigermaßen im Rahmen des Bezahlbaren. Im Gegensatz zur RTX A6000, die als zertifizierte Workstation-Karte natürlich eine völlig andere Klientel bedient. Wobei ja auch im Studio-Bereich die Grenzen immer mehr verschwimmen.

Leistungsbremse, Testsystem und Auswertungssoftware

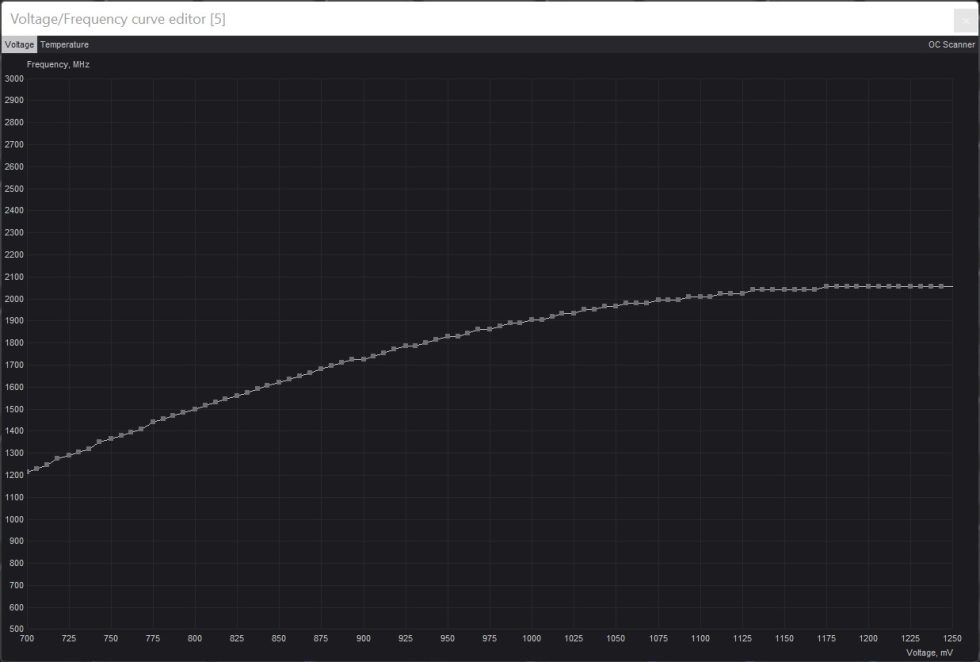

Zur Spar-Variante als 12. Setting sollte ich doch noch kurz etwas schreiben. Ich habe auch diesmal wieder das Power Limit der Founders Edition eingegrenzt, sowie auch die VF-Kurve angepasst. Als Blaupause diente mir die Kurve der NVIDIA RTX A6000 aus dem heutigen Test, die ebenfalls mit einem Power Limit von 300 Watt eingebremst wird und über den gleichen, unbeschnittenen GA102 verfügt. Dass ich mir die Mühe gemacht habe, die Consumer-Karte und die RTX A6000 zu testen liegt auch daran, dass die RTX A6000 nur über den deutlich langsameren GDDR6 RAM verfügt.

Das kostet, je nach Spiel, zwar zwischen 3 und rund 10% Performance, aber dafür ist der Speicherausbau mit 48 GB dann auch doppelt so groß. Und da es heute überwiegend um Studio-Anwendungen geht, ist auch dieser Vergleich durchaus interessant. Die GeForce RTX 3090 Ti FE hat übrigens auch den leistungsstärkeren Kühler, so dass der Nachteil der etwas höheren RAM-Leistungsaufnahme durch niedrigere Temperaturen (und damit auch höhere Booststeps) wieder kompensiert werden sollte.

Das mit der Frequenzvorgabe war übrigens diesmal einfacher, denn der Chip war nicht ganz so zickig wie der auf der MSI-Karte. Die Kurve ließ sich diesmal 1:1 übernehmen, was ordentlich Zeit gespart hat.

Das Benchmarksystem ist bekannt und steht redundant im Labor und im Redaktionsraum. Ich setze auf PCIe 4.0, das passende X570 Motherboard in Form eines MSI MEG X570 Godlike und einen selektierten Ryzen 9 5950 X. Dazu kommt schneller RAM in Workstation-Konfiguration auf 4 Bänken, sowie mehrere schnelle NVMe SSDs. Für das direkte Loggen während aller Spiele und Anwendungen nutze ich sowohl NVIDIAs PCAT als auch einen eigenen, Shunt-basierten Messaufbau, der alle Leitungen zu Grafikkarte und Motherboard überwachen kann (10-Kanäle), was den Komfort ungemein erhöht. Die einzelnen Komponenten des Testsystems habe ich auch noch einmal tabellarisch zusammengefasst:

| Test System and Equipment |

|

|---|---|

| Hardware: |

Ryzen 9 5950X 1x 2 TB MSI Spatium M480 |

| Cooling: |

Alphacool XPX Pro, Custom Loop Water Cooling / Chiller Alphacool Apex |

| Case: |

Raijintek Paean |

| Monitor: | LG OLED55 G19LA |

| Power Consumption: |

MCU-based shunt measuring (own build, Powenetics software) Up to 10 channels (max. 100 values per second) Special riser card with shunts for the PCIe x16 Slot (PEG) NVIDIA PCAT and FrameView 1.1 |

| OS: | Windows 11 Pro (all updates/patches, NVIDIA Studio drivers 516.93 WHQL, AMD Software Pro 22.Q2) |

MSI GeForce RTX 3090 Ti Gaming X Trio 24G, 24GB GDDR6X, HDMI, 3x DP (V509-014R)

Palit GeForce RTX 3090 Ti GameRock, 24GB GDDR6X, HDMI, 3x DP (NED309T019SB-1022G)

29 Antworten

Kommentar

Lade neue Kommentare

Veteran

1

Urgestein

Urgestein

1

1

Urgestein

Urgestein

1

Urgestein

Urgestein

1

Neuling

Urgestein

1

Mitglied

Alle Kommentare lesen unter igor´sLAB Community →