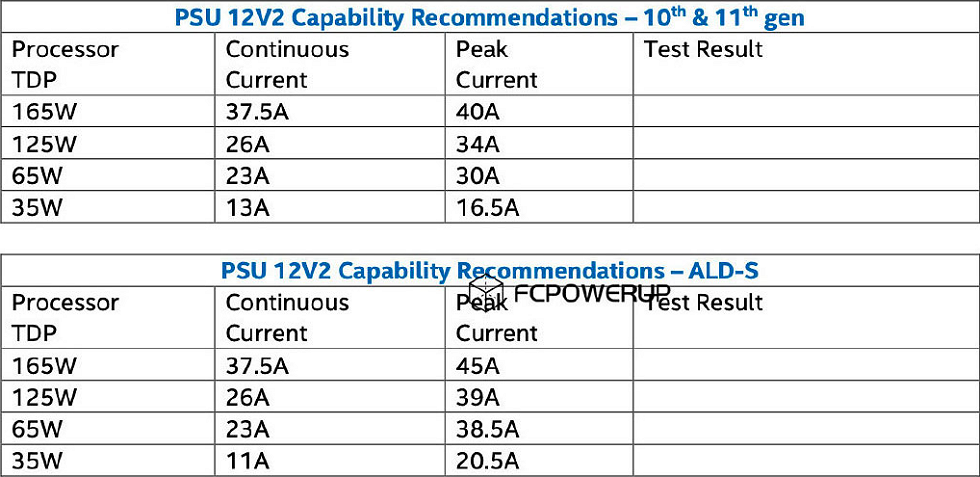

Ich fand unlängst auf FCPOWERUP eine Tabelle, die Intels kommenden Alder Lake S CPUs ein deutlich verschärftes Lastspitzenverhalten bescheinigte. Allerdings ist dies nur die Hälfte der Geschichte, denn Intel ändert ja auch die IMPV (Intel Mobile Voltage Positioning) noch einmal deutlich, so dass man hier stärker differenzieren muss. Doch dazu gleich mehr. Trotzdem möchte ich zunächst auf die bereits veröffentlichten Daten eingehen, die allerdings nur ein reichlich unscharfes Bild bieten, jedoch zumindest erst einmal die Richtung andeuten. Was in Wirklichkeit auf die Motherboards und die PSU zukommen wird, habe ich heute exklusiv im Artikel erfasst.

Lastspitzen am EPS

Falls die Grafik von FCPOWERUP stimmt (wobei ich sie als sehr großzügig bemessen erachte), dann zeigt die Empfehlung für die Netzteilhersteller, dass vor allem die Stromstärke am 12-Volt Spannungsversorgungs-Anschluss (EPS) in den Spitzen deutlich zulegen könnte. Die TDP-Klasse mit 165 Watt ist hier allerdings eher eine Art Platzhalter, denn es wird diese CPUs mit Sicherheit auch in der 12. Generation so nicht geben, wie sie auch in der aktuellen 11. Generation nicht existierten. Die kolportierten Einflüsse auf die Netzteile halten sich jedoch meiner Meinung nach erst einmal im Rahmen, denn der Anstieg in den Peaks von 34 auf maximal 39 Ampere ist nichts, was ein ordentliches Netzteil gleich in die Knie zwingen wird, wenn es zweckmäßig designt wurde.

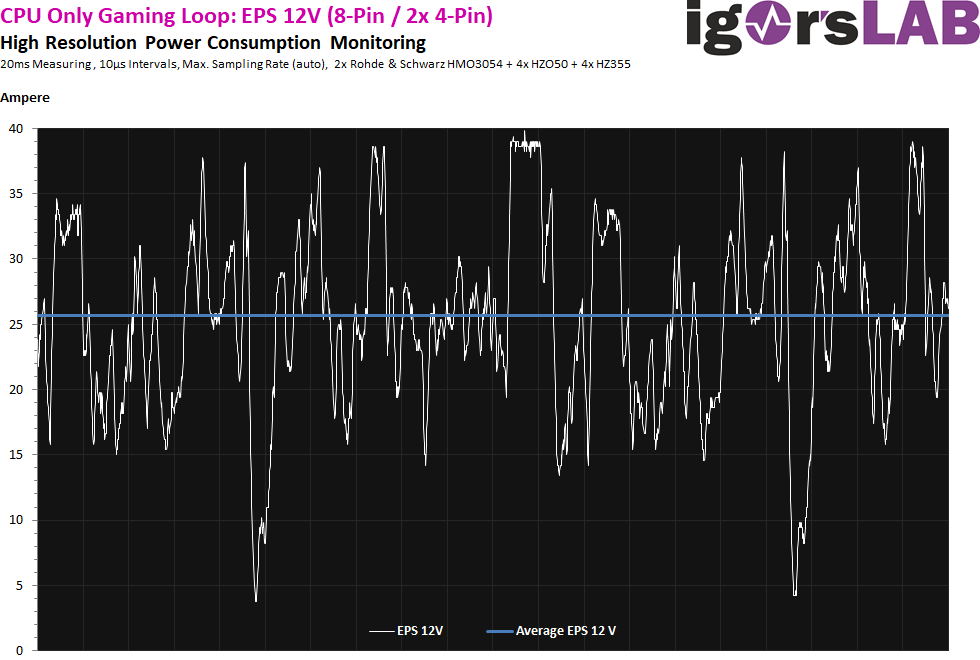

Doch wie lang diese Spitzen in der Realität auftreten können, verrät die Folie leider nicht, zumal die Liste generell recht ungenau ist. Man hat in dieser Tabelle zudem auch die Spannungswandlerverluste mit einbezogen, die jedoch von Board zu Board noch sehr unterschiedlich ausfallen können. Nehmen wir einmal den aktuellen Core i9-11900K mit seinen 125 Watt TDP und der Angabe von 26 Ampere als Dauerlast, sowie 34 Ampere für die Peaks. Die eigene Messung am EPS mit den BIOS-Defaults ohne erhöhtes Power Limit zeigt hier nämlich, dass die tatsächlich gemessene Dauerlast (hier als Durchschnitt mit der blauen Kurve dargestellt) mit 25.7 Ampere genau auf dem Punkt liegt.

Die messbaren Peaks gehen zwar stellenweise sogar bis 40 Ampere, aber es nichts, was eine gut konzipierte OCP/OPP für größere Rätsel stellen sollte. Denn wir wissen ja, dass nur Peak-Intervalle von 10 bis 20 ms in der Lage sind, eine gut eingestellte OCP überhaupt auszulösen. Alles, was zeitlich darunter liegt, wird normalerweise durch die Kondensatoren der Sekundärseite weggepuffert. Um die aufgelisteten 34 Ampere überhaupt zu schaffen, muss man schon einigermaßen zaubern. Im normalen Szenario wird das sowieso nicht auftreten.

Wir bewegen uns immer noch auf der Primärseite der CPU-Spannungsversorgung, also dem Part vor den Spannungswandlern auf dem Motherboard und letztendlich auch der CPU. Doch es ist anhand der geleakten Liste immer noch nicht geklärt, wo diese Lastspitzen eigentlich herkommen sollen und welche Grenzwerte Intel zugrunde legt. Denn Intel kontrolliert alle Ströme und damit auch aufgenommenen Leistungen reaktiv und proaktiv, je nach betreffendem Wert. Doch auch dazu komme ich gleich noch.

Zu den oben genannten Werten von FCPOWERUP für Alder Lake S aus Sicht des Netzteilherstellers habe ich noch die VR-Design-Werte aus den eigenen Unterlagen für die Motherboardhersteller zu ergänzen, was sicher erst einmal verwirrt, aber der Vollständigkeit halber an dieser Stelle doch mit erwähnt werden muss, obwohl es leicht abweicht. Interessant ist hier auch der 10-ms-Intervall, auf den ich später noch genauer eingehen werde.

VR

20 Antworten

Kommentar

Lade neue Kommentare

Veteran

1

Mitglied

Veteran

Mitglied

Urgestein

Urgestein

Mitglied

Urgestein

Mitglied

Veteran

Urgestein

Veteran

Mitglied

Urgestein

Urgestein

Urgestein

Mitglied

Alle Kommentare lesen unter igor´sLAB Community →