Der API-Overhead-Test des 3DMark ist nicht mehr taufrisch, aber zumindest lässt er recht konsistente Tests über verschiedene Renderplattformen zu. Das ist insofern interessant, als dass ja in der Vergangenheit auch NVIDIA-Grafikkarten schon einmal diverse Auffälligkeiten gezeigt hatten. Ich erinnere in diesem Zusammenhang an meinen eigenen „Launch-Artikel“ zu Intel Arc A380 und die erste Seite dieses Artikels, wo die Performance in der 720p-Auflösung (1280 x 720 Pixel) geradezu unterirdisch schlecht war und ist. Natürlich könnte man auch Spiele wie Shadow of the Tomb Raider nutzen, die sich zumindest zwischen DirectX11 und DirectX12 umstellen lassen, aber dann wäre Vulkan wieder außen vor. Deshalb habe ich mich heute als Abschluss auf den etwas älteren API-Overhead-Test beschränkt, der zudem sogar Intel etwas in die Hand spielen könnte (weil man sich dort wohl am 3DMark bereits sehr gründlich abgearbeitet hat). Zu Verwendung kommt ausschließlich der neue Treiber 3220.

Doch was ist an diesem Test jetzt anders? Er benchmarkt nicht die Grafikkarte als Gesamtkunstwert aller Rechenwerke, sondern er prüft die Geschwindigkeit eines Prozessors in Kombination mit einer Grafikschnittstelle. indem man die sogenannten Draw-Calls pro Sekunde ermittelt, die eine GPU durch die Schicht des API erreichen. Es geht also, im übertragenen Sinne, um die Effizienz der Befehlskette zwischen CPU und GPU (und vise versa als Ausführung). Die grafische Darstellung fällt im Test eigentlich recht einfach aus, da der Sinn des Tests ja darin besteht, möglichst viele Render-Aufrufe (also die berüchtigten Draw-Calls) von der CPU an die Grafikkarte zu schicken.

Man generiert eine Art Stadt-Szene, deren Gebäude den Boden und den Himmel bedecken und die permanent durch eine steigende Anzahl an Gebäude wächst. Das geht dann solange, bis die Bildrate auf unter 30 FPS gesunken ist. Genau das ist dann auch der Messpunkt für die Anzahl der Draw-Calls, die noch von der CPU an die GPU geschickt werden können. Dazwischen liegen eine Menge Schichten / Ebenen für die Informationsverarbeitung, die über das Resultat entscheiden. Wer erinnern uns hier auch an Intels Aussagen, dass man den Fokus nur noch auf neue Schnittstellen (API) wie DirectX12 und Vulkan gelegt haben will, doch am Ende zählen ja alle aktuell gängigen Schnittstellen, wo auch DirectX11 noch auf Grund der massig vorhandenen Spiele (und Applikationen) eine große Rolle spielt.

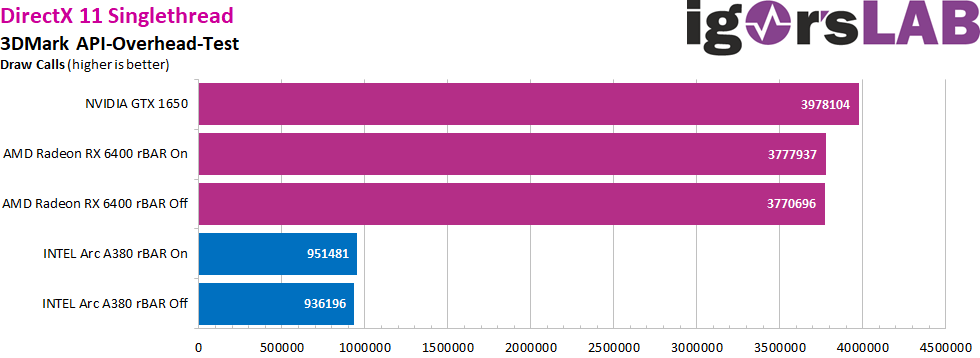

Der erste DirektX11-Test (Singelthread) fällt desaströs aus, da kann man auch nichts beschönigen oder relativieren, denn die GeForce GTX 1650 ist über 4 Mal so schnell wie die Arc A380 mit rBAR On, wobei das Feature insgesamt kaum einen Vorteil bringt. Hier hat Intel noch eine riesige Baustelle vor sich, denn dieser Rückstand ist kein Einzelfall, sondern setzt sich leider weiter fort.

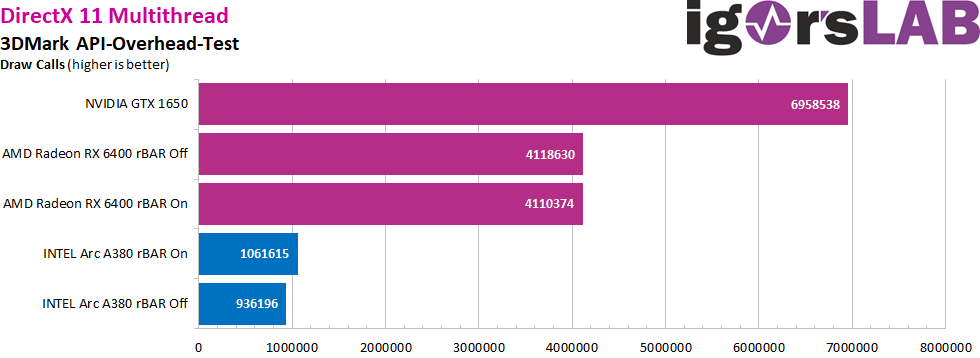

Nimmt man DirectX11 Multithread als Maßstab, wo NVIDIA alle Karten geradezu dominiert, dann vergrößert sich dieser Rückstand im besten Fall mit rBAR On auf den Faktor 6.6, um den die NVIDIA-Karte schneller rendert! Auch die Radeon RX 6400 sieht hier kein Land und es zeigt sich einmal mehr, wo die DirectX11-Performance der NVIDIA-Karten herkommt.

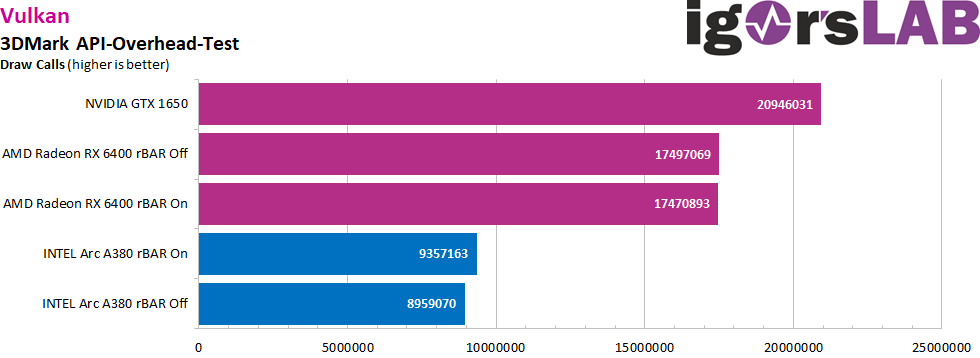

Doch auch Vulkan, obwohl es zu den erklärten Themen von Intel gehört, bietet nur schwache Besserung, aber zumindest verkleinert sich der Rückstand jetzt etwas. Die GeForce GTX 1650 rendert „nur“ noch 2,2 mal schneller. Das ist insofern enttäuschend, als die moderne Low-Level-API ja mit im Fokus liegen soll. Doch auch die Radeon RX 6400 bekleckert sich nicht gerade mit Ruhm.

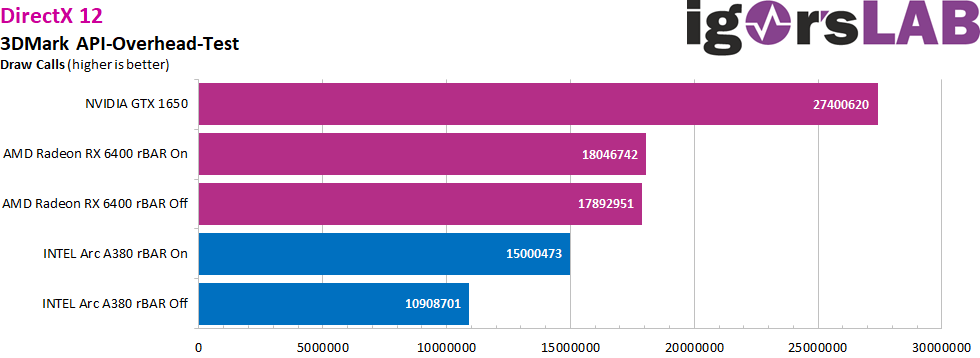

Kommen wir nun abschließend zu DirectX12. Während rBAR bisher kaum oder keine Rolle spielte (und es bei der Radeon RX 6400 auch hier nicht tut), profitiert die Arc A380 plötzlich erstmals von diesem Feature, obwohl dieser Benchmark gar keine rBAR-Optimierung bzw. -Implementierung besitzt!

Es ist mir auch in anderen Tests aufgefallen, dass auch DirectX12-Spiele, in denen AMD- und NVIDIA-Karten von rBAR nicht profitieren, bei der Arc A380 zu einem Leistungsschub führen, den man so nicht vermutet hätte.

Zusammenfassung und Fazit

Das mit dem Reifen alten Weines können wir erst einmal vergessen, aber zumindest hat Intel mit dem Beta-Treiber 3220 die gelagerte Fässer so stabilisiert, dass sie nicht wehr wegrollen und der Inhalt verloren geht. Benutzerfreundlich ist die Oberfläche aber immer noch nicht (oder nur bedingt) und die angebotenen Features sind in der Vielfalt eher mau. Das wird noch eine mammut-Aufgabe und man fragt sich schon, was in den vergangenen 3 Jahren so alles (nicht) passiert ist. Aber man hat sich zumindest jetzt mit der Stabilität auseinandergesetzt, was man auch einmal lobend erwähnen sollte, trotz aller (berechtigter) Kritik.

Der erhoffte Performance-Schub ist allerdings (vorerst) ausgeblieben, da hat sich nicht sehr viel geändert. Die Problemstellen sind fast alle noch da und der Overhead in 720p ist geradezu ernüchternd. Trotzdem sieht man einen gewissen Fortschritt, den man auch anerkennen sollte. Wenn man den Unterschied zwischen spielbar und unspielbar an der Anzahl der Crashs festmachen würde, hat Intel jetzt immerhin schon einmal die Fronten wechseln können. Nun muss nur noch die Performance stimmen und auch die Geschichte mit dem Durst angegangen werden. Etwas mehr Zurückhaltung wäre durchaus gemessen. Oder man behält diese Gewohnheit bei, rennt dafür aber auch etwas schneller. Futterverwertung FTW.

57 Antworten

Kommentar

Lade neue Kommentare

Veteran

1

1

Veteran

Urgestein

Urgestein

Mitglied

Veteran

1

Veteran

Urgestein

Veteran

Urgestein

Mitglied

Urgestein

Mitglied

Urgestein

Mitglied

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →