Can you really work efficiently and productively with an Intel Core i5-12400? And will DDR4 suffice instead of the expensive and unavailable DDR5 memory? Even if some questions remain unanswered and a “It depends” would be the most diplomatic answer, Intel’s small Core i5 isn’t that bad either. But is that enough against an AMD Ryzen 5 5600X? We already had the first gaming test with many benchmarks online. Today, however, we want to take a closer look at where the two gaming variants with the Core i5-12400 can still score to some extent away from colorful gaming worlds and whether it remains just as frugal and efficient.

Can you really work efficiently and productively with an Intel Core i5-12400? And will DDR4 suffice instead of the expensive and unavailable DDR5 memory? Even if some questions remain unanswered and a “It depends” would be the most diplomatic answer, Intel’s small Core i5 isn’t that bad either. But is that enough against an AMD Ryzen 5 5600X? We already had the first gaming test with many benchmarks online. Today, however, we want to take a closer look at where the two gaming variants with the Core i5-12400 can still score to some extent away from colorful gaming worlds and whether it remains just as frugal and efficient.

Gaming is actually overrated when you take a closer look at the benchmarks from 1440p. Thus, the true strengths of the new architecture will hardly be seen while gaming, but I wonder if it will still look like that in the workstation test and without the small E-cores. And that’s exactly what it’s all about today, especially since it’s very application-dependent whether you go for DDR4 or DDR5. But that’s exactly why I do such tests with real full programs and not just the pure synthetics that nobody uses anyway. Cinebench is abundantly pointless for practical use, regardless of revision.

A word in advance about the memory choice between DDR4 and DDR5. I decided to make a direct comparison due to the poor portability and the contradiction between the low-priced platform and the current memory prices. The Kingston Fury Beast DDR5-5333 is definitely up to the mark, even though faster DDR4 memory is hardly slower. But that is exactly what we want to find out in detail in the test.

For today’s test, I deliberately use the same platform as the day before yesterday for gaming, also with identical settings. This also makes it easier to compare where your preferences are better: gaming or working. Or maybe even both, who knows? For today’s test I used a current Core i5-12400 as retail version according to the motherboard specifications for the “boxed” cooler at the power limits. Thus, the PL1 is 65 watts (long duration) and the PL2 is 169 watts (short duration, 28 seconds). But I can already spoil that this maximum value will never be reached, no matter how high you set it. The current limit (short duration) is 175 amps.

In gaming, it’s usually the graphics card that slows things down, in productive use and especially in design and construction, it’s almost always the CPU. I’m using an NVIDIA RTX A6000 for testing, which also wants a snappy underbelly when outputting real-time 3D views, whether it’s using OpenGL or DirectX. Many a CAD program is even worse than the nastiest 720p gaming test in this regard, cue AutoCAD. But I’ll get to that in a minute. Solidworks and Inventor Pro are also demanding, but they contain very different workloads, from light to heavy, which can occur at the same time. This is where Alder Lake S should be able to play to its strengths, which will have to be proven even without helping E-cores.

And I also have to preface this review with the fact that the current Ryzen CPUs, first and foremost the comparable Ryzen 5 5600X, are not degraded to silicon waste with today’s release and you also don’t have to have any reason to panic about suddenly not being able to work with them from one day to the next. Only the efficiency has to be practiced again with AMD, because Intel has really delivered a benchmark with the Core i5-12400. But let’s be surprised, I won’t spoil anything yet.

Benchmarks, Test system and evaluation software

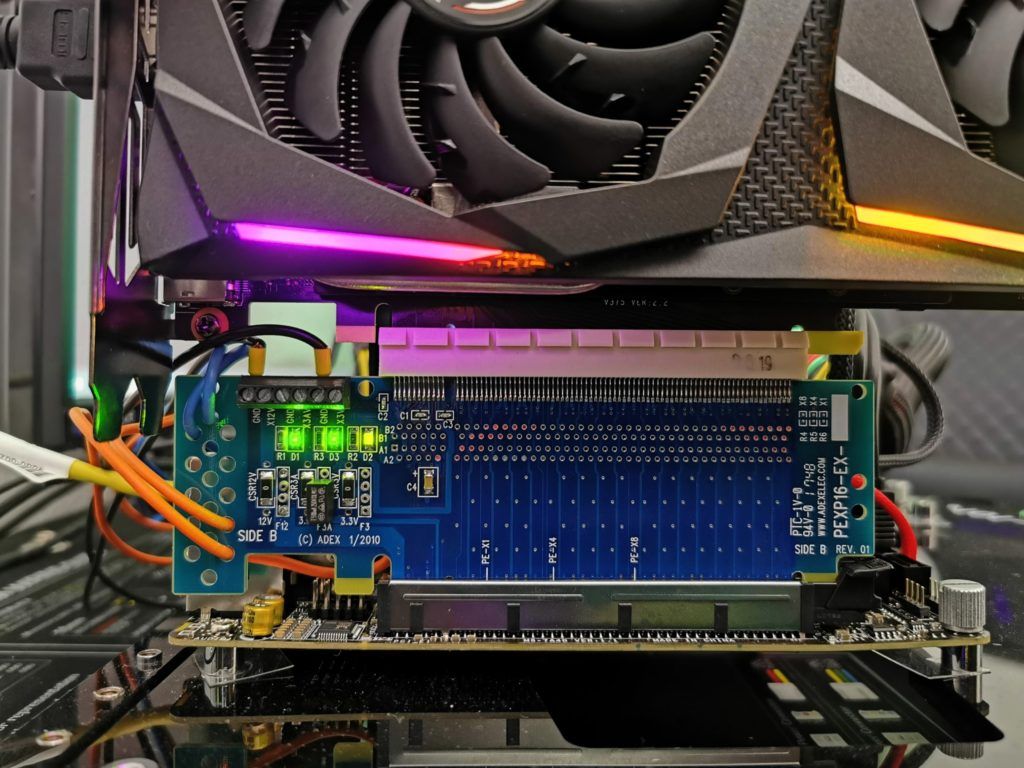

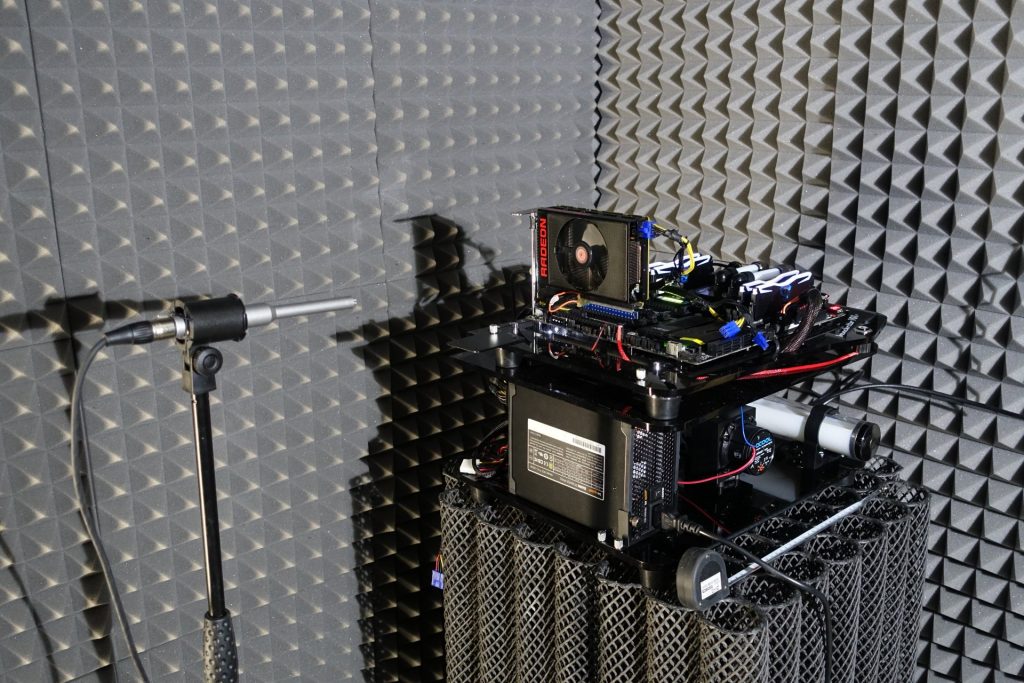

The measurement of the detailed power consumption and other, more profound things is done here in the special laboratory (where at the end in the air-conditioned room also the thermographic infrared recordings are made with a high-resolution industrial camera) on two tracks by means of high-resolution oscillograph technology (follow-ups!) and the self-created, MCU-based measurement setup for motherboards and graphics cards (pictures below).

The audio measurements are done outside in my Chamber (room within a room). But all in good time, because today it’s all about gaming (for now).

I have also summarized the individual components of the test system in a table:

| Test System and Equipment |

|

|---|---|

| Hardware: |

Intel LGA 1700 Core i5-12400 (PL1 65W, PL2 169 W) Core i5-12400 (PL1 65W, PL2 169 W) Intel LGA 1200 AMD AM4 NVIDIA RTX A6000 1x 2 TB MSI Spatium M480 |

| Cooling: |

Aqua Computer Cuplex Kryos Next, Custom LGA 1200/1700 Backplate (hand-made) Custom Loop Water Cooling / Chiller Alphacool Subzero |

| Case: |

Cooler Master Benchtable |

| Monitor: | LG OLED55 G19LA |

| Power Consumption: |

Oscilloscope-based system: Non-contact direct current measurement on PCIe slot (riser card) Non-contact direct current measurement at the external PCIe power supply Direct voltage measurement at the respective connectors and at the power supply unit 2x Rohde & Schwarz HMO 3054, 500 MHz multichannel oscilloscope with memory function 4x Rohde & Schwarz HZO50, current clamp adapter (1 mA to 30 A, 100 KHz, DC) 4x Rohde & Schwarz HZ355, probe (10:1, 500 MHz) 1x Rohde & Schwarz HMC 8012, HiRes digital multimeter with memory function MCU-based shunt measuring (own build, Powenetics software) |

| Thermal Imager: |

1x Optris PI640 + 2x Xi400 Thermal Imagers Pix Connect Software Type K Class 1 thermal sensors (up to 4 channels) |

| OS: | Windows 11 Pro (all updates/patches, current certified or press VGA drivers) |

- 1 - Introduction and test systems

- 2 - Autodesk AutoCAD 2021

- 3 - Autodesk Inventor 2021 Pro

- 4 - Solidworks 2021

- 5 - Various CAD benchmarks - SPECvieperf 2020

- 6 - Rendering, Financial, Programming

- 7 - Science and math (1)

- 8 - Science and math (2)

- 9 - Power consumption and efficiency

- 10 - Summary and conclusion

52 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Urgestein

Mitglied

Mitglied

1

Urgestein

Urgestein

Mitglied

1

Mitglied

1

Urgestein

Urgestein

Urgestein

1

Urgestein

Urgestein

Veteran

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →