Youtuber buildzoid, on his Actually Hardcore Overclocking channel, investigated a Twitter follower’s broken graphics card that had allegedly fallen victim to the new Amazon MMO New World. After a few hours with the graphics card, the experienced hardware guru was already able to diagnose the problem and actually bring it back to life!

Already during the beta phases of Amazon’s new MMO New World, there were various reports in forums and social networks that pixel accelerators were increasingly falling victim to this game. Mainly the phenomenon was limited to high-end Nvidia Ampere cards like RTX 3080 and RTX 3090 models, although there were also occasional reports of other models, also with AMD GPUs.

At first, a quality problem with graphics cards from the manufacturer EVGA was suspected as the sole cause, as we had already covered. A faulty chip for fan control was initially the main candidate here. Later this was denied by EVGA and instead a faulty solder joint of a mosfet of the power delivery was named as the cause, for which the manufacturer also promptly sent replacement hardware to affected users.

Please read this message regarding recent concerns with graphics cards hardware. pic.twitter.com/L1gNeBBPQS

— New World (@playnewworld) July 21, 2021

Amazon had at the same time completely denied the connection between dying graphics cards and their new MMO, assuring the game was “safe to play”, but still implemented an FPS limit in the menu as an additional safeguard. We had already suspected at the time that there might be a second cause for the spontaneous silicon die-off in the voltage regulation area, and questioned Amazon’s response. The beta was over, the problem was not investigated further and forgotten.

A few weeks later the official launch of the game followed and promptly new reports of dead RTX 3080 and RTX 3090 graphics cards resurfaced, not only from EVGA. Youtuber buildzoid was able to borrow an affected RTX 3090 Vision OC model from manufacturer Gigabyte from one of his Twitter followers, to be one of the first to actually go in search of the actual cause of the silicon diying.

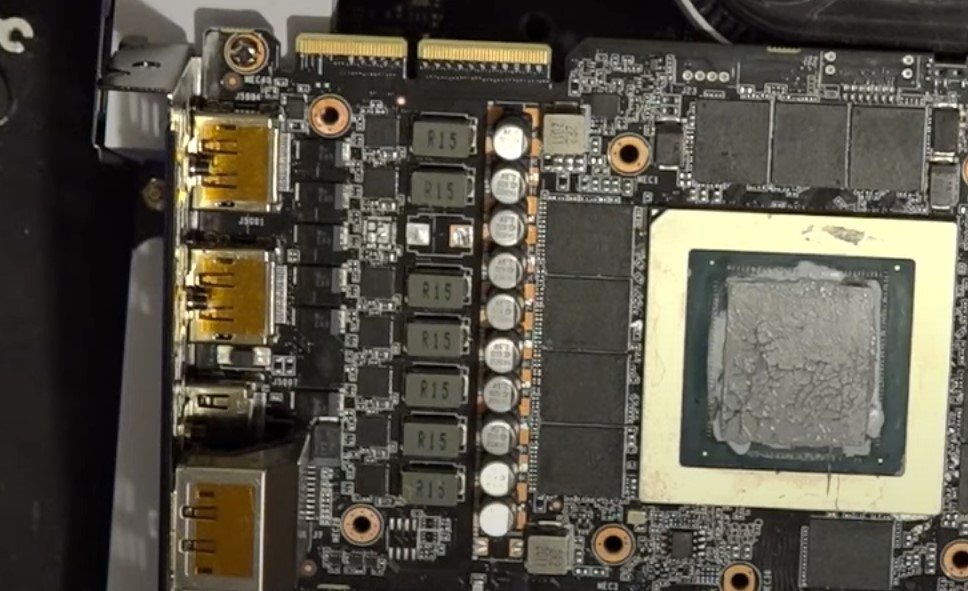

In the first video, he analyzes the PCB and can already identify the first defective components or circuits with a multimeter. One of the fuses of the 12V connections had blown, but also several phases of the GPU power supply have a suspiciously low ground resistance, which points to the defect of a power stage.

A little later there was already an update video, in which the graphics card could actually be brought back to life. All that had to be done was to remove the blown fuse and a defective power stage and the card could be put back into operation. A complete fix this was not, but at least the system boots, the card is fully recognized by the Nvidia driver and can even run the GPU-Z render test.

What is now definitely the cause for the failed Power Stage, buildzoid could not determine yet. However, possible theories include a quality problem with OnSemi’s widely used Smart Power Stage components or a possible design flaw in the VRM configuration related to the current balancing and parallel power stages installed in a single phase. In both cases, a repair would probably not be a sustainable solution and he would have to expect the card to fail again in New World or similarly demanding games.

We’re excited to see what new findings there will be, and grateful that someone is finally taking a deep look at the problem and getting to the bottom of the real technical cause of the error with an autopsy on the silicon corpse. And even though the phenomenon was first brought on by New World, an application that merely issues documented DirectX API commands through the driver should never be able to trigger a hardware failure. So neutrally speaking we have to cut Amazon some slack here.

The manufacturers of the graphics cards or Nvidia have not yet commented on the problem, not to mention a transparent investigation. So the actual cause and solution remains unclear and the mass death of hardware with a respective street value of several thousand Euros in times of an unprecedented chip shortage will continue for the time being. It should also be mentioned that a single graphics card is of course not necessarily representative of all New World victims. GPU manufacturers, on the other hand, would have far greater numbers of test objects at their disposal to determine the cause beyond doubt.

21 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Veteran

Urgestein

Veteran

Mitglied

Mitglied

Veteran

Urgestein

Urgestein

Urgestein

Urgestein

Veteran

Mitglied

Mitglied

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →