Now the cat, or Ada Lovelace, is out of the bag. In yesterday’s live event (was linked on the home page), the long-awaited new generation was finally unveiled. Nvidia’s CEO Jensen Huang also mentioned quite impressive numbers in this context in the recorded keynote of the GTC. The large AD102 GPU, which now uses TSMC’s new N4 process, offers 76 billion transistors, more than twice as many as its direct predecessor.

Of course, a lot of information and technical specifications are still missing for a first verdict, but if you look at the full configuration, the enormous number of 18,000 FP32 ALUs represents an increase of about 70 percent compared to the GA102. In addition, the higher clock rate and it remains to be seen what the end customers can still put on it themselves if. But even so, the performance boost should be quite brutal. According to Huang, Rasterizer games should run up to twice as fast with the new cards as on the (still) current GeForce generation, and for games with real ray tracing, they promise up to four times as much performance, although that should probably be an “up to” in the end.

The feed conversion, i.e. the energy efficiency, is also twice as high. If you take the announced TDP as a basis here, then that also comes close. Since a boost of more than 3 GHz is said to have been achieved in the labs, the rumored up to 600 watts also make sense and it remains to be seen which board partner will add something here.

But how do you actually achieve the performance increase? With the help of SER (Shader Execution Reordering), the ALUs are supposed to be faster than Ampere’s even with the same theoretical computing power, since pending work orders are first reordered in real time and only then passed on to the execution units in optimized order. Ray tracing is also supposed to work two to three times faster as a result. The bottom line is that this feature alone is expected to generate a net increase of up to 25%. In addition, there are more features up to DLSS 3.0, but I will write about them separately.

The table below shows the initial data comparing the three newly introduced cards. Since the SM have not been officially named and also some other features can only be extrapolated, the listing is not yet complete, but that can be supplemented with provable information later:

| RTX 4090 | RTX 4080 16 GB | RTX 4080 12 GB | |

|---|---|---|---|

| Architecture | Ada | Ada | Ada |

| Node | TSMC N4 | TSMC N4 | TSMC N4 |

| GPU | AD102 | AD103 | AD104 |

| CUDA Cores | 16.384 | 9.728 | 7.680 |

| Base Clock | 2.230 MHz | 2.210 MHz | 2.310 MHz |

| Max. boost | 2.520 MHz | 2.510 MHz | 2.610 MHz |

| FP32 Compute | 82.6 TFLOPS | 48.8 TFLOPS | 40.1 TFLOPS |

| Memory expansion | 24 GB GDDR6X | 16 GB GDDR6X | 12 GB GDDR6X |

| Interface | 384 bit | 256 bit | 192 bit |

| TDP | 450 watt | 320 watt | 285 watt |

| Price | 1.949 Euro | 1.469 euros | 1.099 Euro |

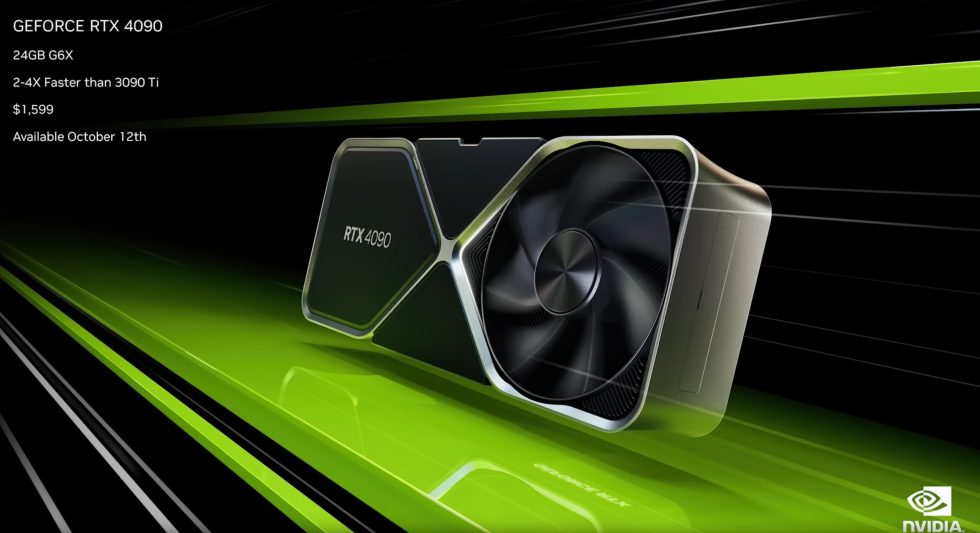

NVIDIA only presented the new graphics cards today, the rest will probably only be released next year. And the prices? Well… The upcoming top model Force RTX 4090 will be sold including VAT. will probably be available from 1,949 euros, market launch is 12.10.2022. The GeForce RTX 4080 is sold in two different variants, one with a memory expansion of 16 GB and one with only 12 GB. It is not yet known exactly where further differences lurk, but the price differences are enormous. The 16 GB card should be available from 1,469 Euros, the 12 GB card from 1,099 Euros.

Of course, this will also tempt some buyers to buy one of the (still) current models of the RTX 3000 series, whose prices are currently dropping. Even an RTX 3080 with only 10 GB of memory could become interesting again when the price is right. NVIDIA is probably also following this calculation when it comes to the so-called “overstock”, i.e. the cards of the (still) current generation that have not been sold yet. I don’t like to write it in the context of a launch, but: The old cards suddenly look less wrinkled.

With the prices, I think you achieve two things at the same time:

(1) You can pick up and siphon off those who really want something new and are not looking at the price, and

(2) You can make the older cards appear in a more desirable light and sell them.

You simply push the smaller cards to 2023 and watch how the 3xxxs still sell off properly. This is somehow understandable, even if it is a bit unattractive. But that is called market and is not reprehensible. If you want to watch the event again, here is the corresponding video:

Translated with www.DeepL.com/Translator (free version)

441 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Veteran

Urgestein

Veteran

Veteran

Mitglied

Veteran

Mitglied

Veteran

Moderator

Mitglied

Neuling

1

Urgestein

Urgestein

Veteran

Veteran

Veteran

Alle Kommentare lesen unter igor´sLAB Community →