New information from Kopite7kimi suggests that NVIDIA is preparing its Blackwell GPUs, which will later be used in the GeForce RTX 50 gaming series. The next generation of GeForce RTX 50 “Blackwell” GPUs from NVIDIA is expected to use the latest 3nm manufacturing process from TSMC and adopt the DisplayPort 2.1 standard.

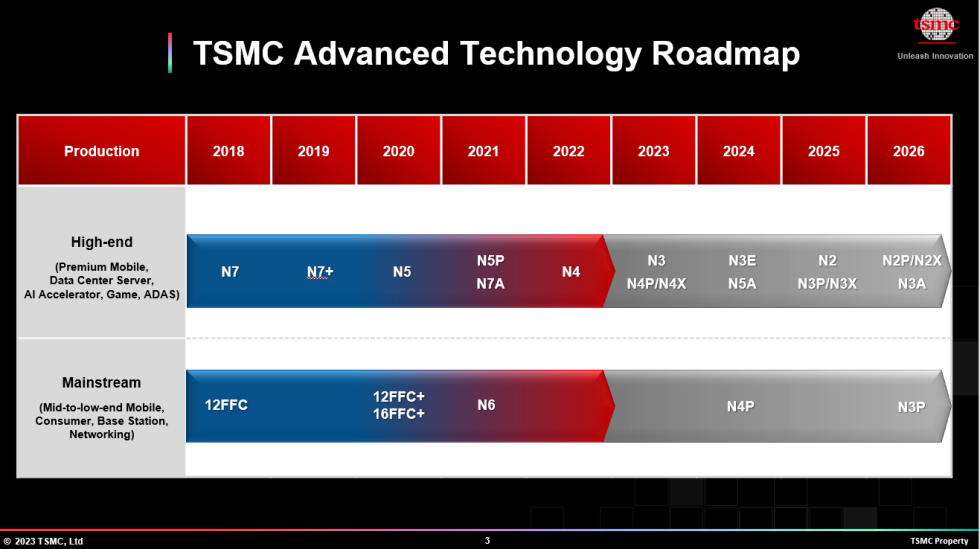

TSMC’s latest 3nm process technology offers a further 25-30% reduction in power consumption, a 10-15% increase in power per transistor, a 42% reduction in area and a 1.7x increase in density compared to the 5nm variant. These significant improvements over the current 5nm node could lead to a further increase in NVIDIA’s efficiency lead over its competitors, as the existing GeForce RTX 40 “Ada Lovelace” series already offers impressive performance per watt.

TSMC3

— kopite7kimi (@kopite7kimi) November 15, 2023

However, it’s too early to tell which specific 3nm variant will be used by the Blackwell gaming GPUs, as the technology will be available in at least four different flavors – from the standard N3 to the more efficient and performance-oriented designs such as N3E, N3P and N3A.

NVIDIA plans to use the “Blackwell” GPUs, which are specifically designed for HPC/AI, together with the latest HBM3e memory solutions in TSMC’s 3nm manufacturing process node. At the same time, NVIDIA’s gaming cards will be equipped with the GDDR7 memory solution, as recently speculated. This would mean that both the HPC and gaming sides of the product families would feature an architecture under the same naming convention – a first after several years. It is also worth noting that the HPC side is expected to benefit from a chiplet-based design, while the gaming side is likely to continue with monolithic dies.

The next generation of GeForce graphics cards are expected to feature DisplayPort 2.1 technology, which puts them on par with AMD’s Radeon RX 7000 GPUs. The disappointment of DP 2.1 not being available on the GeForce RTX 40 GPUs will hopefully soon be a thing of the past. NVIDIA will thus support the latest technologies in its upcoming graphics architecture. In addition to the process node technology, DisplayPort 2.1 technology will also be used.

√

— kopite7kimi (@kopite7kimi) November 15, 2023

Source: Kopite7kimi

37 Antworten

Kommentar

Lade neue Kommentare

Urgestein

1

Veteran

Veteran

Urgestein

Urgestein

Veteran

Urgestein

Veteran

Mitglied

Urgestein

Veteran

Urgestein

Veteran

Urgestein

Veteran

Urgestein

Urgestein

Mitglied

Alle Kommentare lesen unter igor´sLAB Community →