MSI also has not only one GeForce RTX 3050 in its portfolio but with the Gaming X MSI places this particular card as the top model in this class. There is no question that the extra effort is worth it, because it has become a really convincing card within the scope of the possibilities. However, this also demands a non-negligible additional price compared to the so-called budget models. And that is then unfortunately less beautiful. However, in the meantime I have gotten out of the habit of asking about the price, because the discussions about it are useless anyway. Unfortunately, I cannot change it, only test whether it is worthwhile.

But let’s get to the general things first. The 8 GB memory is sufficient for this card, and the memory expansion also allows the card to perform quite passably in WQHD with a balanced and well-considered mixture of medium settings in picture and DLSS quality. Of course, this presupposes a certain willingness to compromise visually, so you have to be honest about that. Once again, there was no Founders Edition, which is why I wrote the launch article with a retail card from Palit. So now we can compare every now and then what the Gaming X from MSI does better compared to a deliberately simple “butter-and-bread” card from Palit.

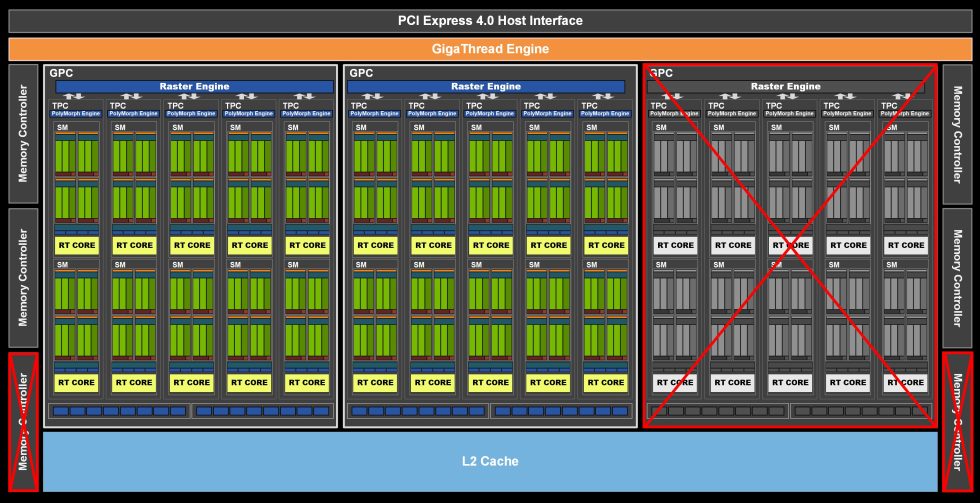

The trimmed GA106-150 on the GeForce RTX 3050

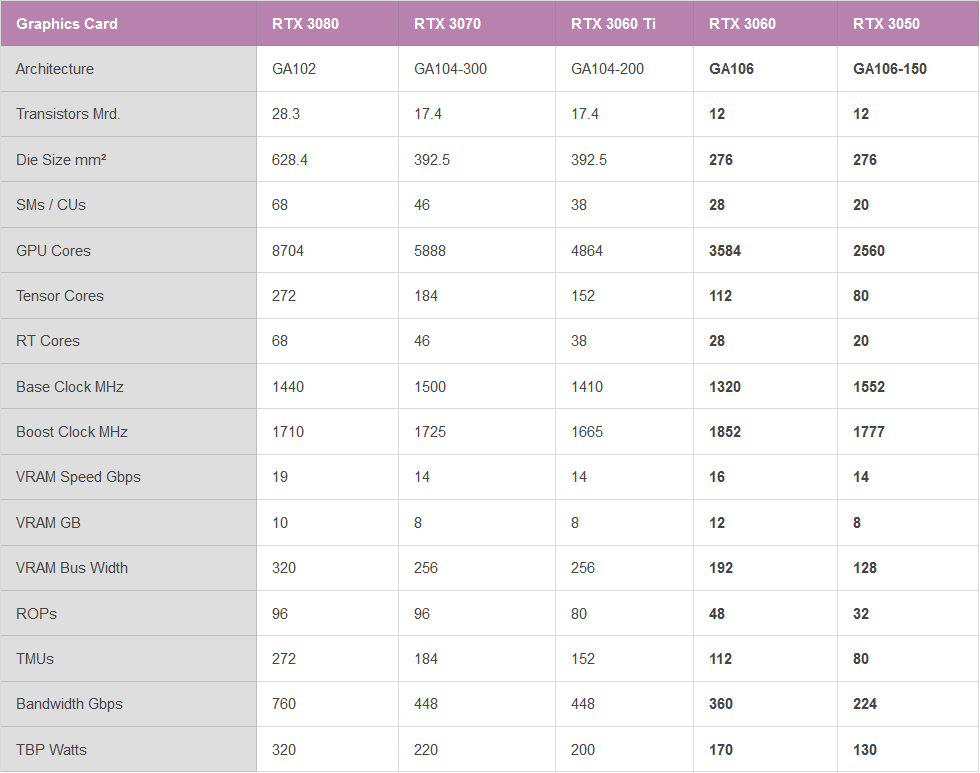

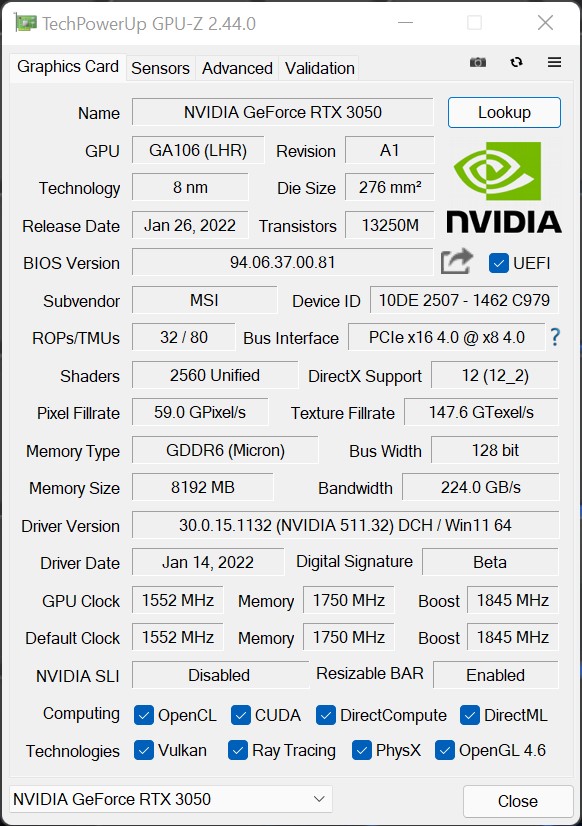

The chip of the NVIDIA GeForce RTX 3050 is also based on the GA106 and has been shortened a bit more. For the GeForce RTX 3050, NVIDIA uses a total of 20 SM (28 for the RTX 3060) of the maximum 30 units of the GA106 (see schematic below), resulting in a total of 2560 (3584 for the RTX 3060) CUDA cores when all units are allowed to work with FP32. In addition to the CUDA cores, NVIDIA’s GeForce RTX 3060 is also equipped with 20 next-generation RT (ray tracing) cores, 80 Tensor cores, 32 ROPs, and 80 TMUs.

As for memory, the GeForce RTX 3050 still has 8 GB of GDDR6 memory with a speed of 14 Gbps, which has a cumulative bandwidth of 224 Gbps on the 128-bit interface of the 4 memory controllers. The total of 8 lanes on the PCIe 4.0 are more than sufficient for this. Incidentally, even with PCIe 3.0, these are still sufficient to not put the card at a disadvantage. But for the chip yield, this pruning seems to have really brought something.

The gap to the GeForce RTX 3060 is of course predictable and less than 2/3 of the full configuration with 30 SM would probably not make sense in the end. At the end of the day, this allows NVIDIA to increase the yield of the GA106, which is not such a bad decision considering the extremely hungry market. Of course, the missing 10 SM (8 less than the RTX 3060) will be noticed, but you simply clock a bit higher and that’s it.

Resizeable BAR is already implemented on the hardware side, but this implementation currently works rather so-so. So it is really exciting to see what NVIDIA now offers as a new entry-level RTX package, because cards are generally scarce at the moment and the target group of less well-heeled Full HD gamers really exists. It is exactly this suitability that I will examine in more detail today and this test of course still includes the electrical implementation, the PCB, the power consumption and the cooling.  The case of the card follows the familiar design language of the Gaming X series and thus also relies on a decent fissuring of the surface. Anthracite as the color of choice (how exciting!) and ABS as the main component – that’s all there is to the radiator cover. It is not luxurious, haptically it is rather average and visually it at least fits well with the familiar design language. Real highlights certainly look different, but we are still in the entry-level segment (even if not in terms of price).

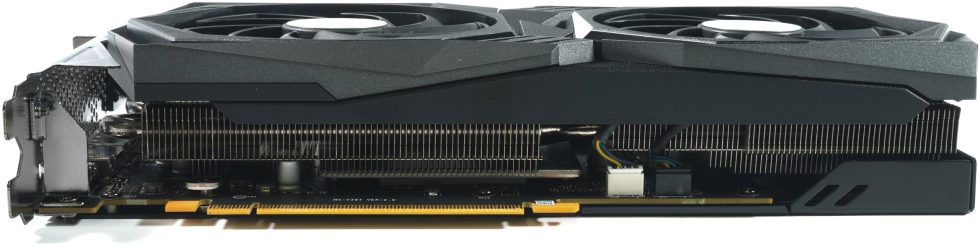

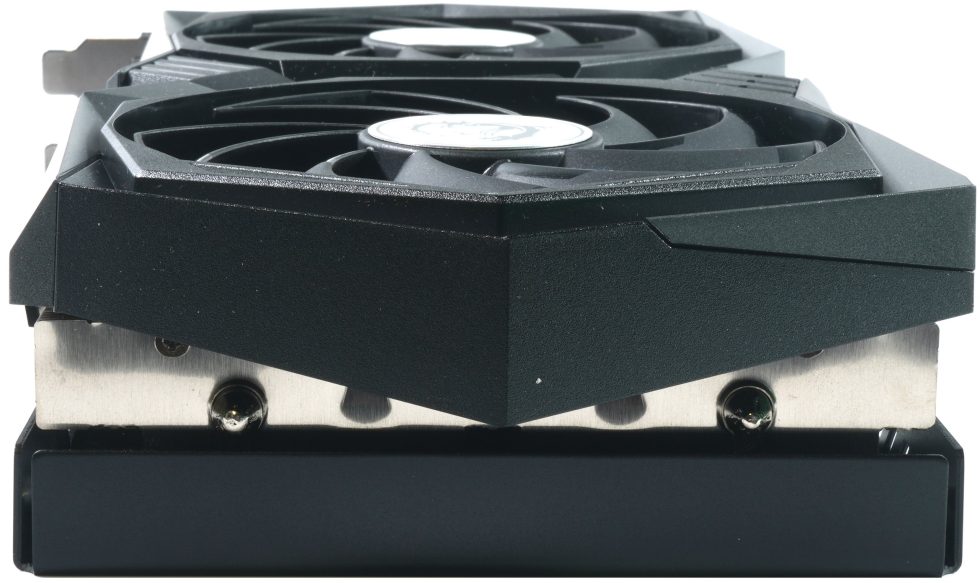

The case of the card follows the familiar design language of the Gaming X series and thus also relies on a decent fissuring of the surface. Anthracite as the color of choice (how exciting!) and ABS as the main component – that’s all there is to the radiator cover. It is not luxurious, haptically it is rather average and visually it at least fits well with the familiar design language. Real highlights certainly look different, but we are still in the entry-level segment (even if not in terms of price).

The overall construction with the 4.5 cm installation depth plus the 5 mm for the backplate made of light metal (a little luxury is necessary) makes this card a 2.5 slot design with all the known advantages and disadvantages. The somewhat smaller radiator overhang is at least somewhat trimmed for clearance in the backplate with openings.

At 936 grams, the card is almost twice as heavy as the tested counterpart from Palit, which is somewhat surprising. The length of 27.9 cm is longer and thus rather average. The installation height of 12 cm from the upper edge of the PCIe slot with the card installed to the top of the cover is also a bit more lush, although still not too high.

The single 8-pin connector on the top is completely sufficient and it also visually marks the end of the hidden, with 21 cm also somewhat longer PCB. There are more details about the cooler and fan design in a moment. The NVLINK port has logically been left out, because SLI is dead anyway and not desired here. RGB is found on the upper side as backlight for the MSI lettering including logo.

The obligatory HDMI 2.1 port should not be missing, and of course the three current DisplayPorts. The round holes still release some waste heat from inside the case, but have nothing to do with direct cooling since the fins look vertical. With that, we are once again completely done with the outward appearances and more can be found later in the teardown.

The opposite end of the card shows us only one more closed event.

The current GPU-Z screenshot shows us the MSI graphics card’s data once again, the rest I already listed above. The 1552 MHz base clock corresponds to NVIDIA’s reference specification and MSI raises the reference’s 1777 MHz boost clock to 1845 MHz ex-factory. The 1750 MHz memory clock was to be expected and the memory expansion with 8 GB on the 128 bit interface logically as well, when you think of the 4 memory controllers from the schematic shown above.

Again, I have a table for all statisticians among you, before it really gets going from the next page on.

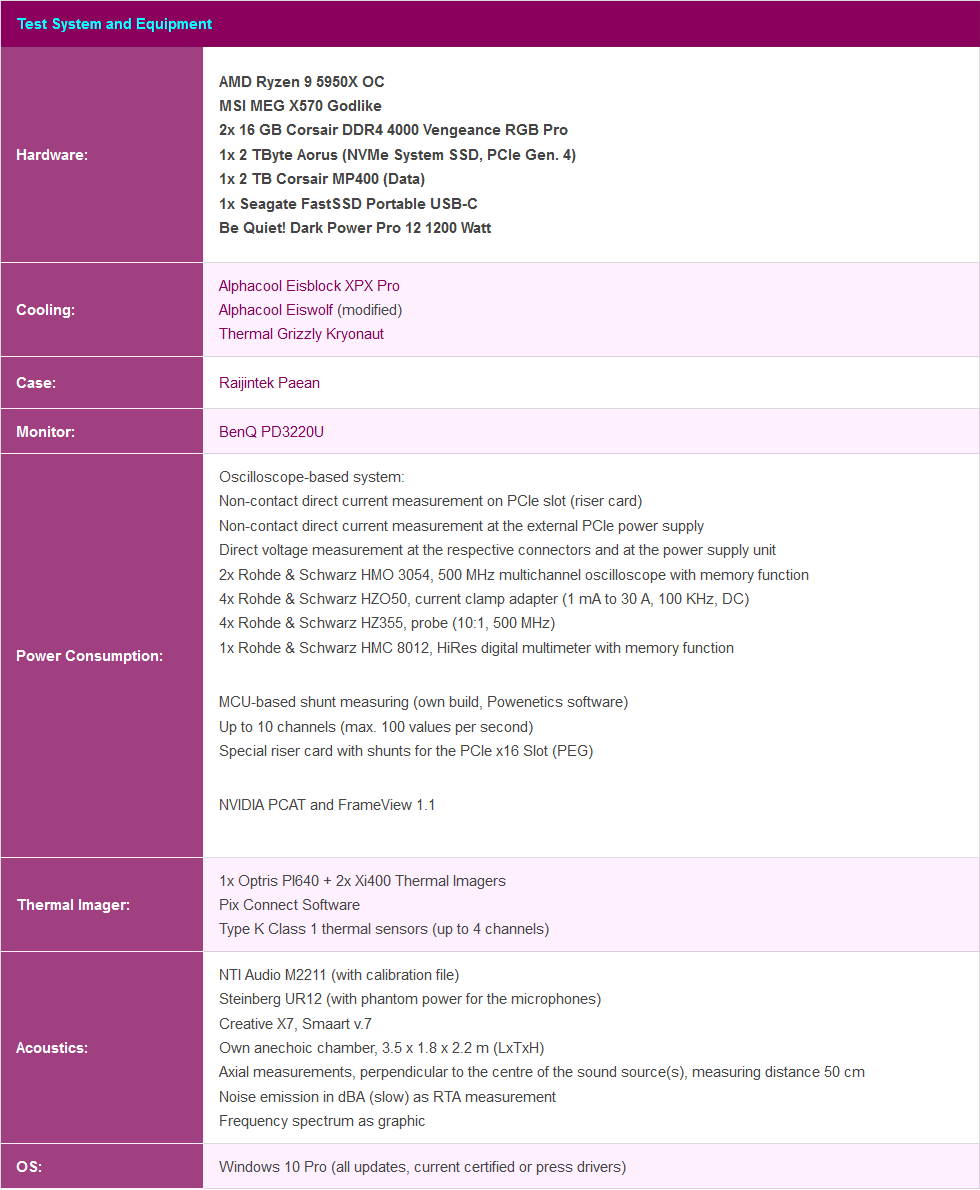

Test system and evaluation software

The benchmark system is new and is no longer in the lab, but in the editorial room again. I now also rely on PCIe 4.0, the matching X570 motherboard in the form of an MSI MEG X570 Godlike, and a select Ryzen 9 5950 X that has been heavily overclocked water-cooled. In addition, there is fast RAM as well as several fast NVMe SSDs. For direct logging during all games and applications, I use NVIDIA’s PCAD, which increases the comfort immensely.

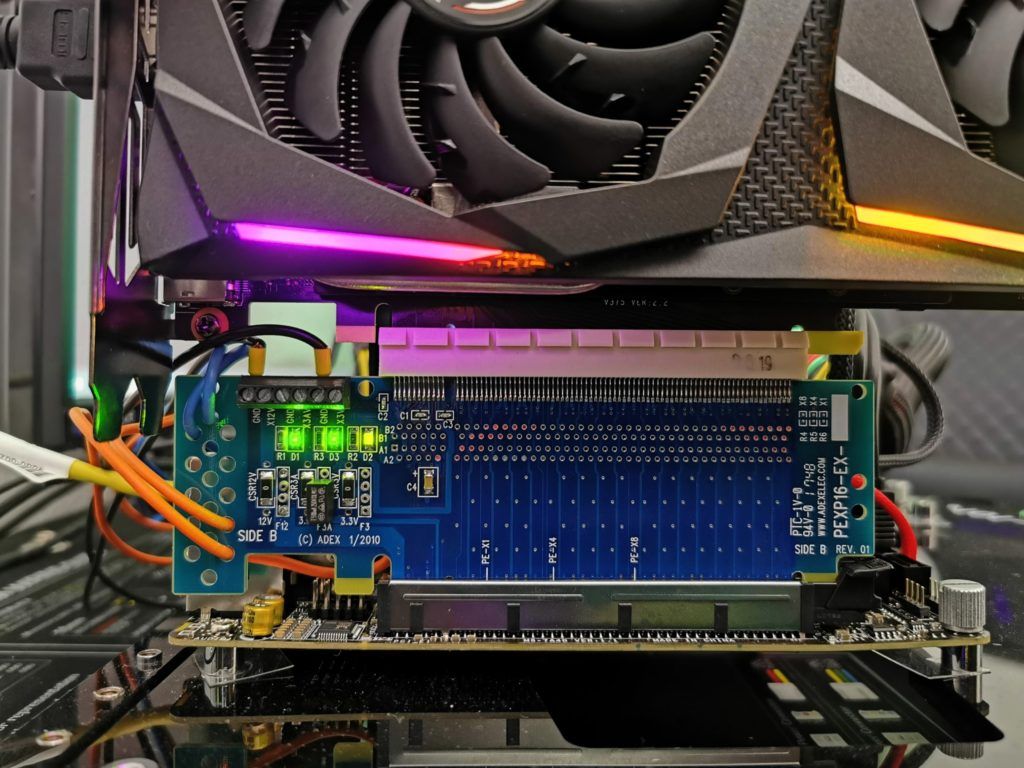

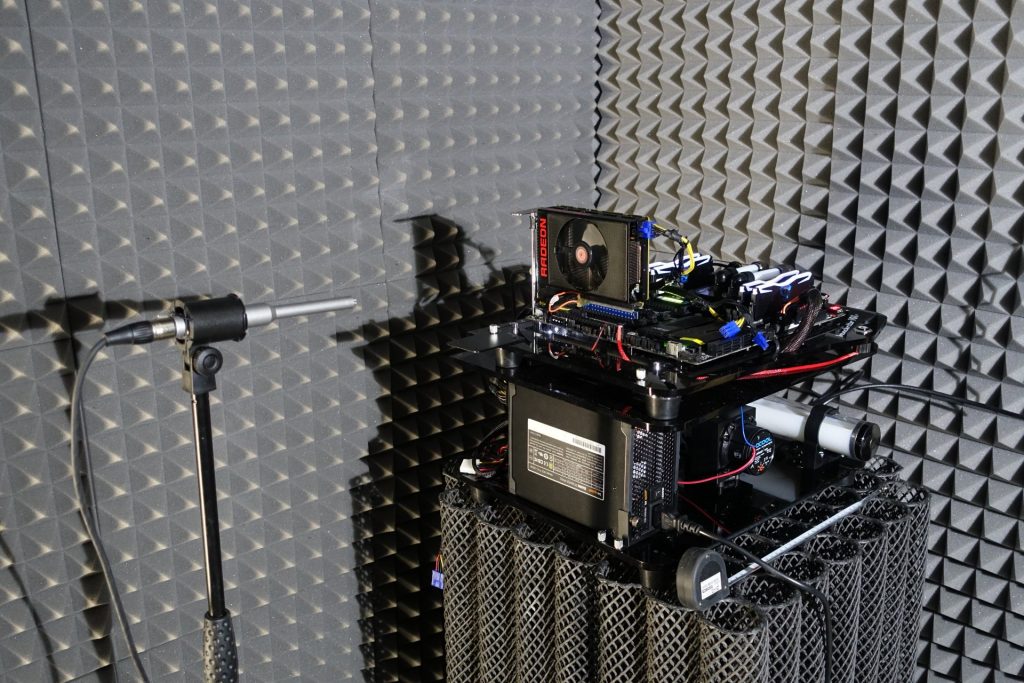

The measurement of power consumption and other things is carried out here in the special laboratory on a redundant test system that is identical down to the last detail, then on two tracks using high-resolution oscillograph technology…

…and the self-created MCU-based measurement setup for motherboards graphics cards (pictures below), where at the end in the air-conditioned room also the thermographic infrared images are created with a high-resolution industrial camera. The audio measurements are done outside in my Chamber.

I have also summarized the individual components of the test system in a table:

MSI GeForce RTX 3050 Gaming X 8G, 8GB GDDR6, HDMI, 3x DP (V397-421R)

| ca. 2 Wochen | 513,88 €*Stand: 27.07.24 03:05 |

- 1 - Intro, Data, Unboxing and Test System

- 2 - Teardown: PCB Analysis and Cooler

- 3 - Gaming Performance Full-HD and WQHD

- 4 - Power Consumption and PCI SIG Standards

- 5 - Transients and PSU Reccommendation

- 6 - Temperatures and Thermal Images

- 7 - Fans, Noise and Requency Analysis

- 8 - Summary and Conclusion

13 Antworten

Kommentar

Lade neue Kommentare

Veteran

Veteran

1

Mitglied

Mitglied

Urgestein

Urgestein

1

Urgestein

Urgestein

Urgestein

1

Veteran

Alle Kommentare lesen unter igor´sLAB Community →