In the third quarter of 2023, the research company Omdia gained detailed insights into Team Green’s activities and discovered astonishing results. NVIDIA sold an almost unbelievable “half a million” AI GPUs in the quarter, mainly consisting of the Hopper H100 and the Ampere A100. These sales figures are impressive and have put NVIDIA in a dominant position in the markets. The company plans to sell millions of GPUs in 2024, which seems quite achievable given the quarterly performance and underlines NVIDIA’s commitment. The results achieved are a real surprise and will certainly cause a stir in the industry.

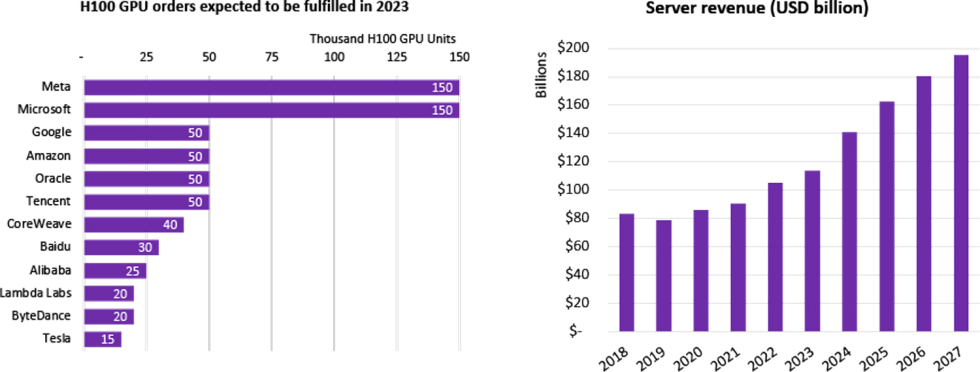

Omdia also analyzed which companies actually purchased NVIDIA’s AI GPUs during the specified period. It turns out that Meta and Microsoft are at the top of the list, having purchased a total of 150,000 units of NVIDIA’s current AI GPU models. Both companies are heavily involved in the competition to develop generative AI technologies, especially when it comes to integrating AI functions into mainstream applications. Therefore, they have a high demand for computing power, which NVIDIA can fulfill with its GPUs. Other notable companies using NVIDIA’s AI GPUs in their CSP departments include Google, Oracle and Tencent.

NVIDIA is also seeing a significant share of orders from the Chinese market, accounting for approximately 30% of the company’s orders in the third quarter of 2023. This underlines the importance of satisfying the customer base in the region. However, the new US regulations may make it difficult for NVIDIA to fulfill orders, especially as the company is subject to new export restrictions. Although NVIDIA is looking for solutions, it is predicted that the company may see a decline in revenue from Chinese markets, which could present an opportunity for emerging competitors such as Huawei.

Omdia’s analysis states that NVIDIA is off to a strong start in 2024 and that quarterly sales could even continue to rise as demand for H100/A100 is rapidly increasing. Orders have already exceeded a 52-week lead time. Even TSMC has stated that NVIDIA is on track to become the world’s largest company in the industry in 2024.

NVIDIA seems to be well equipped to take full advantage of the growing markets. By 2027, sales in the server industry are expected to reach around 200 billion US dollars. The company has already announced plans to make its AI offerings more competitive by adopting the latest standards for semiconductors and memory as well as significant improvements in software resources.

Source: Omdia

2 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Veteran

Alle Kommentare lesen unter igor´sLAB Community →