Blubbie

Urgestein

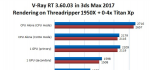

Dumme Frage, wieso sind die CPUs für diese Arbeit so ineffizient?

War ja beim bitcoin und Co auch so. Ich weiß das eine Grafikkarte oder "ASICS miner" viele parallele stupide Berechnungen machen kann, während die CPU dafür super flexibel "ALLES" berechnen kann. Aber könnte eine CPU dann nicht per Software 2, 3, oder 4 "ältere" grafikkarten emulieren? Oder zumindest deren "Cuda" Cores?

Wir haben ja mittlerweile 6, 8 und mehr Kerne (+kern-Verdoppelung) und Taktraten bei den CPUs die mehr als das doppelte einer Grafikkarte haben.

Kann jemand dazu etwas background wissen einstreuen?

War ja beim bitcoin und Co auch so. Ich weiß das eine Grafikkarte oder "ASICS miner" viele parallele stupide Berechnungen machen kann, während die CPU dafür super flexibel "ALLES" berechnen kann. Aber könnte eine CPU dann nicht per Software 2, 3, oder 4 "ältere" grafikkarten emulieren? Oder zumindest deren "Cuda" Cores?

Wir haben ja mittlerweile 6, 8 und mehr Kerne (+kern-Verdoppelung) und Taktraten bei den CPUs die mehr als das doppelte einer Grafikkarte haben.

Kann jemand dazu etwas background wissen einstreuen?