Du verwendest einen veralteten Browser. Es ist möglich, dass diese oder andere Internetseiten nicht korrekt angezeigt werden.

Du solltest ein Update durchführen oder einen alternativen Browser verwenden.

Du solltest ein Update durchführen oder einen alternativen Browser verwenden.

Radeon RX 7800XT und RX 7700XT im Test - AMD, XFX und Sapphire gegen NVIDIA mit Vernunft oder energetischer Brechstange

- Themenstarter Redaktion

- Beginndatum

na ja das die 7er Gen keinen ausreichenden Mehrwert für 6er Gen Besitzer hat - das brauchen wir doch jetzt nicht weiter zu vertiefen.Also meine Rx 6800 hat 499.- Euro gekostet!

Ich denke die meisten hätten auf einen richtigen Leistungssprung gehofft.

Vor lauter Erwartung habe ich für mich den Moment verstreichen lassen, als es 6900lc oder 6950lc für < 700.- € gab.

Und eine grünrotblauebrille habe ICH ganz bestimmt nicht, wenn auch wie viele andere ein grundsätzliches pro Underdog.

Das hätte die 4er Gen NV gegenüber der 3er eigentlich auch nicht [Ausnahme die 90er] wenn NV bei der Software nicht künstlich beschneiden würde...

Aus Kundensicht ist das doch das schlimmere... Als AMD 6er Kunde kannst du doch beruhigt die 7er Gen verstreichen lassen.

Casi030

Urgestein

- Mitglied seit

- Sep 9, 2019

- Beiträge

- 11.923

- Bewertungspunkte

- 2.339

- Punkte

- 113

Mit Ausnahme der 7900XTX......na ja das die 7er Gen keinen ausreichenden Mehrwert für 6er Gen Besitzer hat - das brauchen wir doch jetzt nicht weiter zu vertiefen.

Das hätte die 4er Gen NV gegenüber der 3er eigentlich auch nicht [Ausnahme die 90er] wenn NV bei der Software nicht künstlich beschneiden würde...

Aus Kundensicht ist das doch das schlimmere... Als AMD 6er Kunde kannst du doch beruhigt die 7er Gen verstreichen lassen.

Sorry, eigentlich war nur der erste Satz eien direkte Antwort auf deinen Post.Mich wundert das mein Post dich so triggert, ich habe keinerlei Partei ergriffen, nur gesagt das mir eine niedrigere Boardpower lieber gewesen wäre.

Der Rest war nur ein allgemeiner Rant, warum Effizenz nur dann interessiert wenn AMD für irgendwas mehr Strom als Intel oder Nvidia verbraucht. Und die - für mich - Unart gpus/cpus direkt mit Brechstangeneinstellungen zu vermarkten: ich dachte dafür seien OC Versionen und der ganze OC Sekundärmarkt da. Wie gesagt kommt das in den Balkendiagrammen "X ist schneller als Y" nicht vor, die alle Leute interessieren. Aber ei generelles "Effizienz" Dual-Bios wäre schon nett.

Casi030

Urgestein

- Mitglied seit

- Sep 9, 2019

- Beiträge

- 11.923

- Bewertungspunkte

- 2.339

- Punkte

- 113

Das stimmt und vermisse Ich auch,die XFX RX7900XTX hat auch nur zwei OC Versionen mit ein paar Watt Unterschied. Wenn die Rev.7900XTX ein PL von 300Watt hat kann man doch her gehen und eins mit 275Watt und eins mit 325Watt machen und nicht eins mit 320 und 335 z.b.Aber ei generelles "Effizienz" Dual-Bios wäre schon nett.

RX480

Urgestein

- Mitglied seit

- Feb 13, 2020

- Beiträge

- 1.885

- Bewertungspunkte

- 874

- Punkte

- 114

Natürlich ist die Sekundärseite gemeint. (die auch eigene Kondensatoren hat)Meinst du die großen HochspannungsKondensatoren auf der Primärseite? Die sind an den LastwechselSpikes auf der Sekundärseite nur zweitrangig beteiligt.

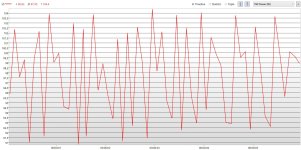

als Bsp. mit vielen Spikes>Nennleistung:Fazit aus nem älteren Test

Die ganz kurzen Lastspitzen kann man getrost beiseitelegen und man sollte sich wirklich nur über Werte Gedanken machen, die überein bis zwei10 Millisekunden liegen. Übrigens nicht nur wegen der möglichen Abschaltung des Netzteils durch einen Schutzmechanismus, sondern auch wegen der Haltbarkeit. Je hektischer so ein Grafikbeschleuniger am Netzteil saugt, umso schneller kommen die Sekundärkondensatoren in den Bereich der Pflegeversicherung. Wer dann am Ende spart, ist falsch beraten.

Reichen 500 Watt? AMD Radeon RX 6800 und NVIDIA GeForce RTX 3070 gegen ein be quiet! Pure Power 11 500 W | Praxis | Seite 3 | igor´sLAB

Man hat ja schon Vieles gesehen, auch auf YouTube. Da überlebt z.B. ein 500-Watt-Netzteil auf wundersame Weise schon einmal eine GeForce RTX 3080, während genau diese Karte hier im Labor vor dem…

ansonsten

Lass bitte gut sein, das wird zuviel OT.

beim nächsten NT-Review wäre dann genug Platz für Deine Fragen

Zuletzt bearbeitet

:

Ich kaufe seit diversen Jahren immer Karten mit AMD-Chip, vorzugsweise Sapphire! Wenn ich die Benchmarks der 7000er Generation so lese (auch die der großen Karten!), bin ich froh, dass ich mir zum letzten Black Friday noch die Sapphire 6950xt Nitro+Pure geschossen habe. So richtig überzeugend finde ich den Leistungs- "Sprung" nicht. Einzig ein bissi effizienter scheinen sie geworden zu sein. Dafür sieht meine "weiße Schönheit" um Welten besser aus- is ja auch was!!!

Die 7800XT Nitro+ sieht in den Tests momentan nach der "besten" Karte mit der GPU aus (kostet aber 550$ statt 500$) - hervorragende Kühlung und leise. Es wird auch von gutem OC Potential geschrieben, aber das liegt ja auch immer an der Silicon Lottery.Ich kaufe seit diversen Jahren immer Karten mit AMD-Chip, vorzugsweise Sapphire! Wenn ich die Benchmarks der 7000er Generation so lese (auch die der großen Karten!), bin ich froh, dass ich mir zum letzten Black Friday noch die Sapphire 6950xt Nitro+Pure geschossen habe. So richtig überzeugend finde ich den Leistungs- "Sprung" nicht. Einzig ein bissi effizienter scheinen sie geworden zu sein. Dafür sieht meine "weiße Schönheit" um Welten besser aus- is ja auch was!!!

Cerebral_Amoebe

Veteran

- Mitglied seit

- Aug 2, 2018

- Beiträge

- 118

- Bewertungspunkte

- 57

- Punkte

- 29

Casi030

Urgestein

- Mitglied seit

- Sep 9, 2019

- Beiträge

- 11.923

- Bewertungspunkte

- 2.339

- Punkte

- 113

Das ist halt die Frage wie groß der Unterschied sein muss.Ich kaufe seit diversen Jahren immer Karten mit AMD-Chip, vorzugsweise Sapphire! Wenn ich die Benchmarks der 7000er Generation so lese (auch die der großen Karten!), bin ich froh, dass ich mir zum letzten Black Friday noch die Sapphire 6950xt Nitro+Pure geschossen habe. So richtig überzeugend finde ich den Leistungs- "Sprung" nicht. Einzig ein bissi effizienter scheinen sie geworden zu sein. Dafür sieht meine "weiße Schönheit" um Welten besser aus- is ja auch was!!!

Ich finde bei gleicher Leistungsaufnahme 20-35%+ schon ordentlich.

Casi030

Urgestein

- Mitglied seit

- Sep 9, 2019

- Beiträge

- 11.923

- Bewertungspunkte

- 2.339

- Punkte

- 113

Wird durch das FSR auch ehr besser.@Casi030

So schlecht wie viele meinen ist die Grafik von Starfield ja gar nicht in deinem Video.

Heute Mittag ist mein Key gekommen, ich bin gespannt wie es in Full HD ausschaut.

S.nase

Urgestein

Natürlich ist die Sekundärseite gemeint. (die auch eigene Kondensatoren hat)

als Bsp. mit vielen Spikes>Nennleistung:

Reichen 500 Watt? AMD Radeon RX 6800 und NVIDIA GeForce RTX 3070 gegen ein be quiet! Pure Power 11 500 W | Praxis | Seite 3 | igor´sLAB

Man hat ja schon Vieles gesehen, auch auf YouTube. Da überlebt z.B. ein 500-Watt-Netzteil auf wundersame Weise schon einmal eine GeForce RTX 3080, während genau diese Karte hier im Labor vor dem…www.igorslab.de

ansonsten

Lass bitte gut sein, das wird zuviel OT.

beim nächsten NT-Review wäre dann genug Platz für Deine Fragen

Es ging am Anfang darum, wie man mit boardeigenen Mitteln, möglichst aussagekräftige "Messwerte" erhalten kann(egal ob nun Takt, Spannung, Strom...usw.).

Deiner Empfehlung nach reicht ein HWinfo Log mit 2sec Intervall aus. Das wiederspricht sich mMn schon rein logisch. Ein Log mit 2000msec Intervall hat ne 20mal geringere Auflösung als ein Log mit 100msec Intervall. Somit ist die Wahrscheinlichkeit bei 2sec Intervall 20mal geringer ein paar Spikes auf zu zeichnen, als bei 0.1sec Log Intervall.

Zuletzt bearbeitet

:

RX480

Urgestein

- Mitglied seit

- Feb 13, 2020

- Beiträge

- 1.885

- Bewertungspunkte

- 874

- Punkte

- 114

Auch mit 50ms kann ich in HWinfo net so genau messen wie Igor. Einen bigSpike zu erwischen wäre reiner Zufall.

(nur ein ganz einfacher Versuch im Treiber-Stresstest siehe Anhang)

Inwiefern sich die anderen Reviewer mit neuerdings 20ms an die Werte von Igor annähern, müsst man mal vgl., z.Bsp.

CB hat dahingehend das Messgerät gewechselt.(andere Reviewer nutzen meist noch das ältere PCAT-Gerät von NV)

btw.

Ich habs übrigens bei mir@RX6800 genauso gemacht, wie von Igor empfohlen, statt dem PP11-500W das 600W für 5€ mehr.

Alternativ gänge das Straight-550W, aber kostet mehr. (ähnlich sollte man für die RX7700xt auskommen)

Ein Test mit dem neuen PP12-550W vs. RX7700xt + R5 7500F wäre natürlich hochinteressant.(als Minimalkonfig)

Damit genug OT.

(nur ein ganz einfacher Versuch im Treiber-Stresstest siehe Anhang)

Inwiefern sich die anderen Reviewer mit neuerdings 20ms an die Werte von Igor annähern, müsst man mal vgl., z.Bsp.

CB hat dahingehend das Messgerät gewechselt.(andere Reviewer nutzen meist noch das ältere PCAT-Gerät von NV)

btw.

Ich habs übrigens bei mir@RX6800 genauso gemacht, wie von Igor empfohlen, statt dem PP11-500W das 600W für 5€ mehr.

Alternativ gänge das Straight-550W, aber kostet mehr. (ähnlich sollte man für die RX7700xt auskommen)

Ein Test mit dem neuen PP12-550W vs. RX7700xt + R5 7500F wäre natürlich hochinteressant.(als Minimalkonfig)

Damit genug OT.

Anhänge

Zuletzt bearbeitet

:

echolot

Urgestein

@Alphacool Falls Du mitlesen solltest, ist da irgendetwas von euch geplant hinsichtlich Wasserblock? Wann?

G

Gelöschtes Mitglied 6480

Guest

Wieso(?), zum Ausprobieren von Standbild RT-RT (im bewegten Spiel ist RT-RT sowieso relativ irrelevant bzw. wird kaum bis gar nicht wahrgenommen) leicht über RTX 2080Ti Niveau reicht es bei der RX 6800XT allemal und in FSR3 Genuss kommt man damit auch, nur (noch?) nicht treiberseitig (aber das kann ja irgendwann noch nachgereicht werden für RDNA2).

Die RX 7700XT ist leider noch zu teuer angesetzt im Gegensatz zur RX 7800(XT, welches sich das AMD/RTG Marketing lieber hätte sparen sollen), aber unter 430 Euro irgendwann dann sicherlich interessant, zumal sonst im Leistungsbereich bis hinunter zur neuen diskreten Grafikeinsteigerlösung RX 7600 nur noch ältere RDNA2 Modelle (wie die RX 6800 und die RX 6700XT bspw.) eine passende Option wären für den geneigten AMD/RTG Käufer.

Mit einer RX 7800(XT) dürfte man wenigstens absehbar nicht am Speicher verhungern wie bei der teureren direkten Konkurrenz (RTX 4070), die zudem im Gegensatz zur RDNA3 Karte von nVidia deutlich teurer als das Vorgängermodell zum Marktstart angesetzt wurde und neben der RX 7900XT wohl bisher die stimmigste Karte im RDNA3 Poertfolio (auch weil die RX 7700XT leider zwecks Upselling - welches man sich bei nVidia abgeguckt haben dürfte - wie zuvor erwähnt zu teuer platziert wurde).

Insgesamt bleibe ich aber beim gleichen Fazit für die RDNA3 wie für die Ada Lovelace dGPU-Generationen (mit Ausnahme einer RTX 4090 vielleicht, wenn man denn soviel vordergründig nur zum spielen investieren möchte), beide (bisher) nicht lohnend/rund genug und definitiv wert, übersprungen zu werden.

RT (nicht RR sry

FSR 3 könnte exklusive Features bei den neuen Karten haben. Also quasi, dass es bei diesen Karten treiberseitig bei jedem Spiel aktivierbar ist.

AMD wird vermutlich versuchen irgendwelche Alleinstellungsmerkmale gegenüber DLSS bringen....

Zuletzt bearbeitet von einem Moderator

:

echolot

Urgestein

Diese Befürchtung habe ich auch angesichts der Nvidiastrategie. Da muss man sich dan irgendwann entscheiden. Hopp oder top!FSR 3 könnte exklusive Features bei den neuen Karten haben. Also quasi, dass es bei diesen Karten treiberseitig bei jedem Spiel aktivierbar ist.

AMD wird vermutlich versuchen irgendwelche Alleinstellungsmerkmale gegenüber DLSS bringen....

G

Gelöschtes Mitglied 6480

Guest

Diese Befürchtung habe ich auch angesichts der Nvidiastrategie. Da muss man sich dan irgendwann entscheiden. Hopp oder top!

FSR ist ja eine reine SW Lösung. Vermutlich dann bei ausgewählten Spielen auf allen Karten von R-G-B und generell immer in den Treibern einschaltbar dann exklusiv halt.

Es gab da so Gerüchte... mal schauen was dran ist...

echolot

Urgestein

Wir warten jetzt erst einmal FSR3 ab und wie es auch auf den Nvidia-Karten läuft. Dann sehen wir weiter. Alles Glaskugel bisweilen.FSR ist ja eine reine SW Lösung. Vermutlich dann bei ausgewählten Spielen auf allen Karten von R-G-B und generell immer in den Treibern einschaltbar dann exklusiv halt.

Es gab da so Gerüchte... mal schauen was dran ist...