Eragoss

Urgestein

- Mitglied seit

- Jul 23, 2018

- Beiträge

- 1.096

- Bewertungspunkte

- 314

- Punkte

- 84

- Alter

- 42

- Standort

- Deutschland

Nachdem mir Alternate jetzt geschrieben hat das ihr Lieferant den Liefertermin nicht einhalten kann, hab ich jetzt storniert. Wenn das jetzt eh noch 3-4 Wochen dauert, kann ich wegen meines TV's mit FreeSnyc gleich auf Nummer sicher gehen und direkt BigNavi ordern. Die Gerüchte erhärten sich ja auch, das es eine 12 und 16GB Version geben wird - gibt mir dann auch ein besseres Gefühl wie die knapp bemessenen 10GB.

Bei Computerbase gab es auch eine Umfrage, wo es ziemlich klar ersichtlich ist, das das ganze ein 99%tiger Paperlunch ist. Von AMD erwarte ich nach Igors Einschätzungen auch keine Wunder und tollen Lieferzeiten, aber irgendwie ist mir das jetzt Symphatischer.

Die RX 5700XT von XFX hatte wegen der Speichertemperaturen bei mir Minuspunkte gesammelt. (was durch ergänzende Wärmeleitpads/Paste aber nun passt) aber zumindest ist hier AMD ehrlich und zeigt einem die Tjunction an. Nvidia verschweigt es für den Ottonormaluser, was meiner Meinung nach noch schwerer wiegt - danke hier an die Aufklärung von Igor.

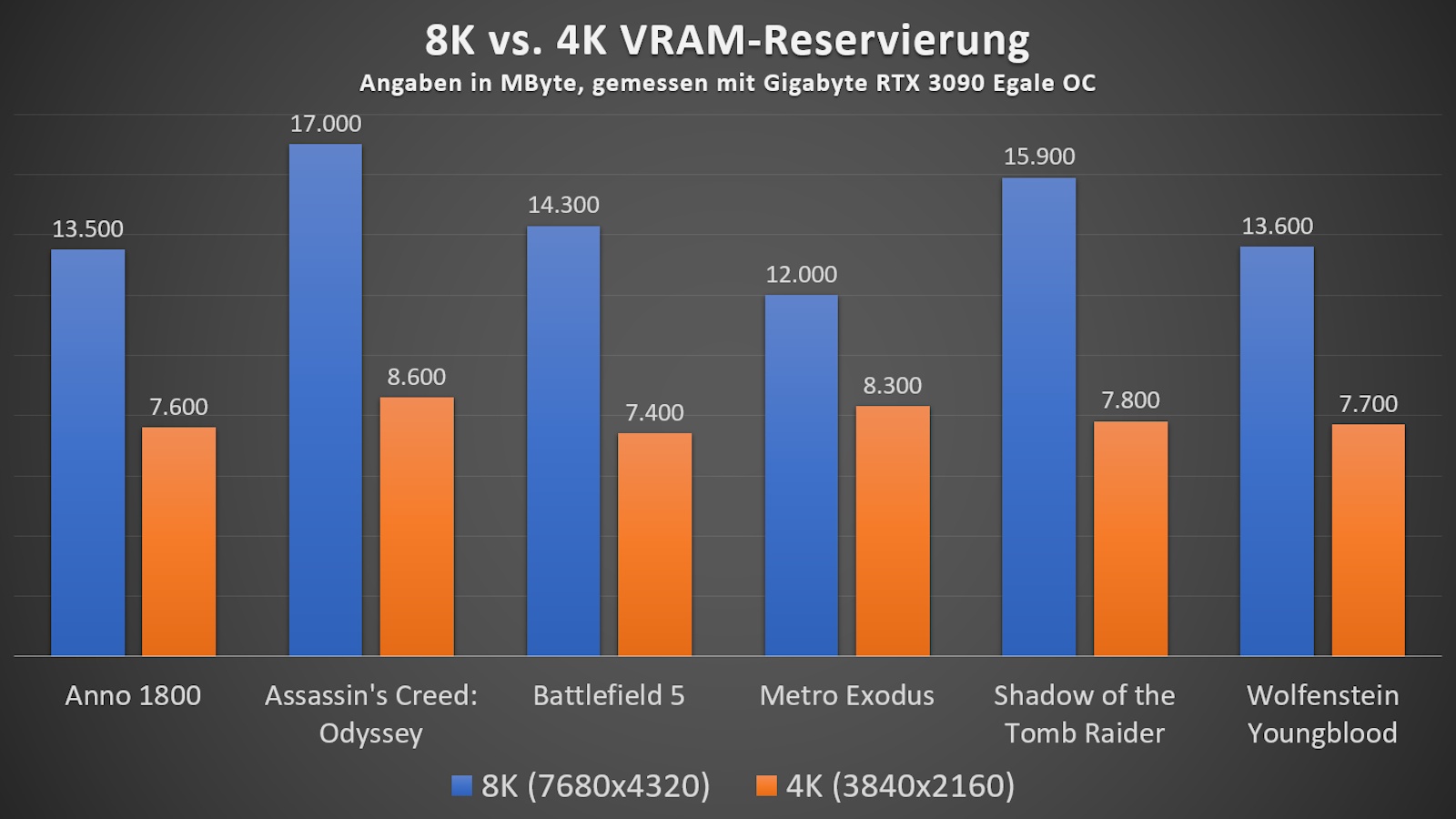

Bin mal auf das Review der RTX 3090 gespannt, zumindest für Gamer die auch nur im entferntesten ein wenig auf das Preis-/Leistungsverhältnis achten, dürfte die Karte wohl durchfallen. Für Nutzer von Anwendungssoftware aber sicher eine sehr interessante Karte (gerade in Hinblick auf Speichermenge vs Preise der alten Titan RTX)

Bei Computerbase gab es auch eine Umfrage, wo es ziemlich klar ersichtlich ist, das das ganze ein 99%tiger Paperlunch ist. Von AMD erwarte ich nach Igors Einschätzungen auch keine Wunder und tollen Lieferzeiten, aber irgendwie ist mir das jetzt Symphatischer.

Die RX 5700XT von XFX hatte wegen der Speichertemperaturen bei mir Minuspunkte gesammelt. (was durch ergänzende Wärmeleitpads/Paste aber nun passt) aber zumindest ist hier AMD ehrlich und zeigt einem die Tjunction an. Nvidia verschweigt es für den Ottonormaluser, was meiner Meinung nach noch schwerer wiegt - danke hier an die Aufklärung von Igor.

Bin mal auf das Review der RTX 3090 gespannt, zumindest für Gamer die auch nur im entferntesten ein wenig auf das Preis-/Leistungsverhältnis achten, dürfte die Karte wohl durchfallen. Für Nutzer von Anwendungssoftware aber sicher eine sehr interessante Karte (gerade in Hinblick auf Speichermenge vs Preise der alten Titan RTX)