Von mir jetzt mal sehr sehr sehr grob Beschrieben:

Eigentlich haben alle aktiven Elektrobauteile Lastspitzen beim Einschalten, sogar eine ganz banale 0815 LED. Wenn die LED bis leuchtet ist die Leistung konstant und es gibt keine weiteren Lastspitzen mehr.

Früher hatten GPUs nur einen einzigen Zustand und der war 100% aktiv. Die Karten takteten und verbrauchten in etwa immer das selbe (leichte Schwanken wegen Belastung gab es schon). Turbo, Boost oder im Idle runter Takten war nicht. Also, eine sehr konstante Belastung ohne große Lastspitzen. Aber es wurde auch unnötig Energie verbraten.

Heute wird versucht so viel wie Möglich aus den Chips zu bekommen bei so geringem Verbrauch wie möglich und deshalb haben halt Techniken wie Boost, Turbo oder wie man sie alles nennen soll, Einzug erhalten.

Das bringt dann aber auch "Einschaltströme" mit sich, was wir eben als Lastspitzen sehen. Unter dem Strich bleibt der Verbrauch aber geringer als wenn man die GPU im Dauer 100% Aktiv betreiben würde.

Und würde man die Karten wie früher betreiben, hätten wir auch nicht die Leistung von Heute.

Das ist auch z.b. ein Grund, weshalb eine CPU unter prime95 heute meist Kühler bleibt als im Gamingbetrieb. Auch das hatte

@Igor Wallossek schon in mehreren Artikeln erklärt.

Natürlich gibt es Möglichkeiten hier gegen zu steuern und da tun die Entwickler auch ihr besten.

Zu den Netzteilen, da gab es auch eine Zeit, wo viele "Sicherungen" nicht vorhanden waren und die NTs nicht abgeschaltet haben, nicht weil sie besser waren, nein weil einfach keine Sicherheitsschaltung vorhanden war. Daher alterten die Netzteile auch deutlich schneller und man lies regelmäßig von ausgelaufenen Kondensatoren u.s.w. Auch hier ist es gut dass diese Zeit vorbei ist.

Welch Leistungsklasse sollte man wählen?

Zum einen hat man die Lastspitzen und zum anderen aber auch die Effizienz, mit welcher ich nun mal anfange:

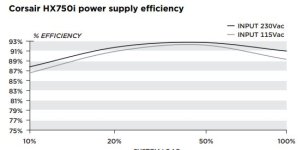

Jedes Netzteil hat seine eigenen Kurven je nach Designe und Qualität, aber man kann schon sagen, dass die beste Effizienz bei etwa 50-60% Nennbelastung besteht (unter 10% sehr schlecht und auch ab 80% fängt die Effizienz an zu leiden).

Früher war es eigentlich normal, dass man sich an denen 50-60% orientiert hat, durch bessere Effizienz Werte spielte dies aber immer weniger eine Rolle, da die Unterschiede bei der Belastungsspanne geringer wurden.

Orientiert man sich aber an diesen 50-60% auch noch heute, wird man keine Probleme mit dem den Lastspitzen haben.

Ich nehme z.b. für eine 4080 (320W@Stock) und einen Intel 14700K (@65W/95W) + Nebenverbraucher eine Belastung von etwa 450W an.

Meine Wahl viel also auf ein 750W Netzteil und bin sicher.

Durch Optimierungen habe ich aber nur einen realen Verbrauch an der Steckdose von 300-350W samt Bildschirm, beim Zocken!