3DMark’s API overhead test is no longer dewy, but at least it allows for fairly consistent tests across different rendering platforms. This is interesting in that NVIDIA graphics cards have also shown various anomalies in the past. In this context, I remind you of my own “launch article” about Intel Arc A380 and the first page of this article, where the performance in 720p resolution (1280 x 720 pixels) was and is downright subterranean. Of course, you could also use games like Shadow of the Tomb Raider, which can at least be switched between DirectX11 and DirectX12, but then Vulkan would be left out again. Therefore, I limited myself to the somewhat older API overhead test as a conclusion today, which could even play into Intel’s hand a bit (because they have probably already worked on 3DMark very thoroughly). Only the new 3220 driver is used.

But what is different about this test now? It does not bench-mark the graphics card as the total art value of all parts, but it tests the speed of a processor in combination with a graphics interface. by determining the so-called draw calls per second that reach a GPU through the layer of the API. So, figuratively speaking, it’s about the efficiency of the instruction chain between CPU and GPU (and vise versa as execution). The graphical representation actually turns out to be quite simple in the test, since the point of the test is to send as many render calls (i.e. the infamous draw calls) from the CPU to the graphics card as possible.

You generate a kind of city-scene with buildings covering the ground and the sky, permanently growing by an increasing number of buildings. This continues until the frame rate has dropped below 30 FPS. This is then exactly the measuring point for the number of draw calls that can still be sent from the CPU to the GPU. In between there are a lot of layers / levels for information processing, which decide about the result. We also remember Intel’s statements here that they only want to focus on new interfaces (API) like DirectX12 and Vulkan, but in the end, all current interfaces count, where DirectX11 also still plays a big role due to the masses of existing games (and applications).

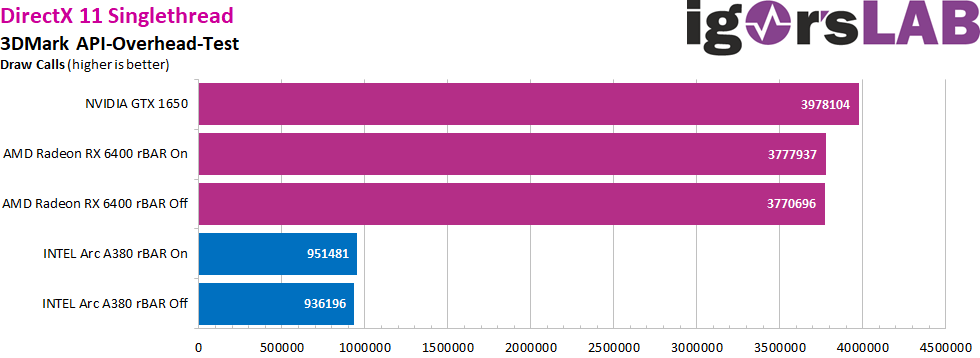

The first DirektX11 test (Singelthread) turns out disastrous, and nothing can be glossed over or put into perspective. The GeForce GTX 1650 is over 4 times faster than the Arc A380 with rBAR On, although the feature hardly brings an advantage overall. Intel still has a huge construction site ahead of it here, because this backlog is not an isolated case, but unfortunately continues.

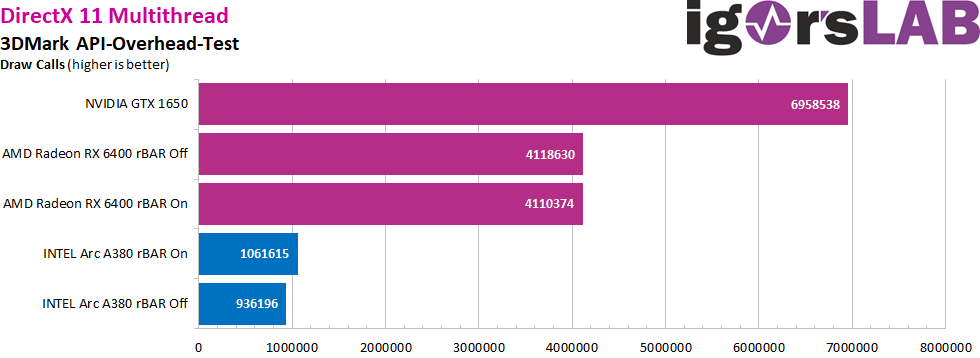

If you take DirectX11 Multithread as a benchmark, where NVIDIA virtually dominates all cards, then this gap increases to a factor of 6.6 in the best case with rBAR On, by which the NVIDIA card renders faster! Even the Radeon RX 6400 doesn’t see any land here and it once again shows where the DirectX11 performance of NVIDIA cards comes from.

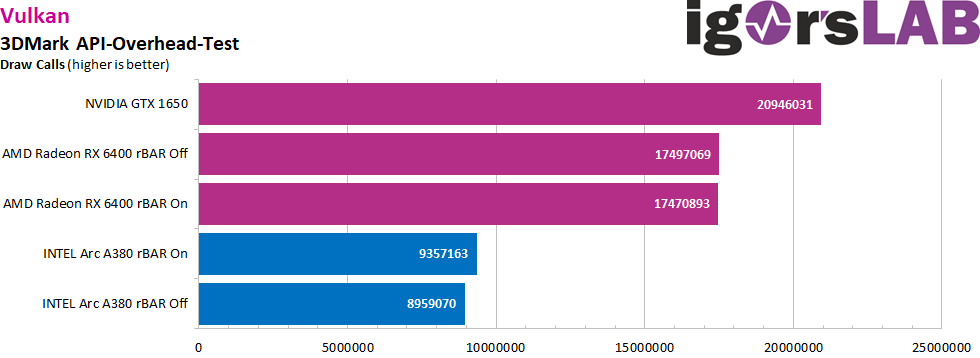

However, even Vulkan, although it is one of Intel’s declared themes, only offers weak improvement, but at least the gap is now narrowing a bit. The GeForce GTX 1650 renders “only” 2.2 times faster. This is disappointing, since the modern low-level API is supposed to be part of the focus. However, the Radeon RX 6400 doesn’t exactly cover itself with glory either.

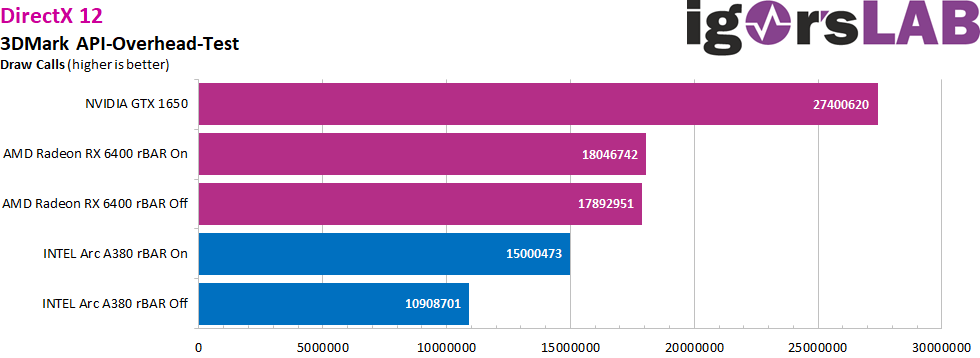

Finally, let’s move on to DirectX12. While rBAR has played little or no role so far (and it doesn’t with the Radeon RX 6400 here either), the Arc A380 suddenly benefits from this feature for the first time, even though this benchmark doesn’t have any rBAR optimization/implementation at all!

I’ve also noticed in other tests that even DirectX12 games, where AMD and NVIDIA cards don’t benefit from rBAR, result in a performance boost on the Arc A380 that you wouldn’t have expected.

Summary and conclusion

We can forget the thing about the old wine for now, but at least Intel has stabilized the barrels with the Beta 3220 driver so that they don’t roll away anymore and the contents are lost. However, the user interface is still not user-friendly (or only to a limited extent) and the features offered are rather meager in variety. This will be a mammoth task and one wonders what has (not) happened in the past 3 years. But at least stability has now been addressed, which is something that should also be praised, despite all the (justified) criticism.

However, the hoped-for performance boost has not materialized (for now), not much has changed. The problem spots are almost all still there and the overhead in 720p is downright sobering. Nevertheless, you can see a certain progress, which should also be acknowledged. If you were to determine the difference between playable and unplayable by the number of crashes, Intel has at least been able to change fronts once now. Now the performance just has to be right and the story with the thirst also has to be addressed. A little more restraint would be quite measured. Or you can keep this habit, but run a little faster.

57 Antworten

Kommentar

Lade neue Kommentare

Veteran

1

1

Veteran

Urgestein

Urgestein

Mitglied

Veteran

1

Veteran

Urgestein

Veteran

Urgestein

Mitglied

Urgestein

Mitglied

Urgestein

Mitglied

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →