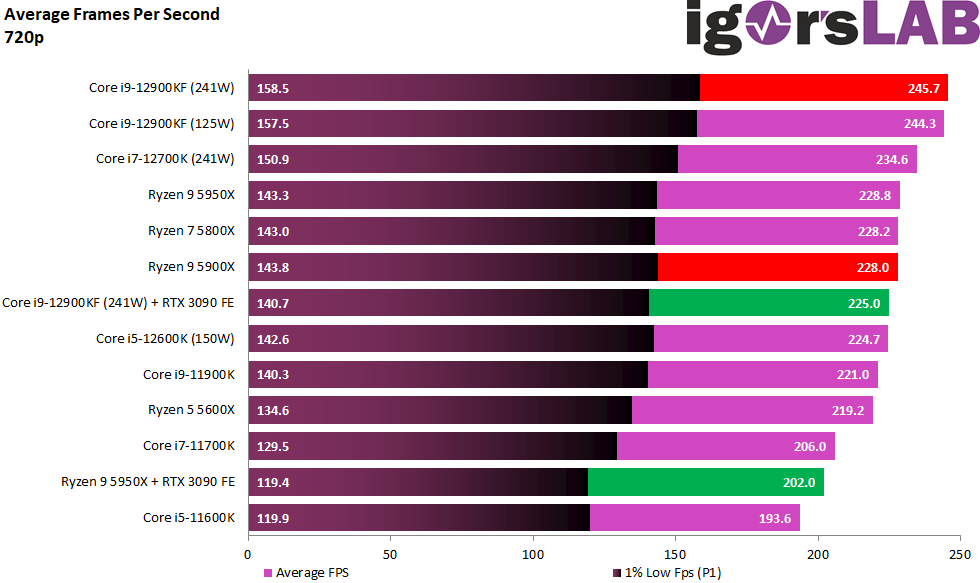

Comparison of gaming performance and percentiles

I really don’t want to over-stress it, but the Radeon RX 6900XT really beats the GeForce RTX 3090 in 720p by a significant margin. I’ve already written about the reasons in detail, and I’d have to pick ten NVIDIA-affiliated games against all reason with a great deal of malice and intent to completely reverse this result yet. Even the Ryzen 9 5950X with the Radeon RX 6900XT in the duo is still just faster than the Core i9-12900KF with the GeForce RTX 3090. The difference between the individual bars, on the other hand, is quite brutal. With up to almost 44 normalized FPS on average between the fastest and slowest combination, it’s really worlds already.

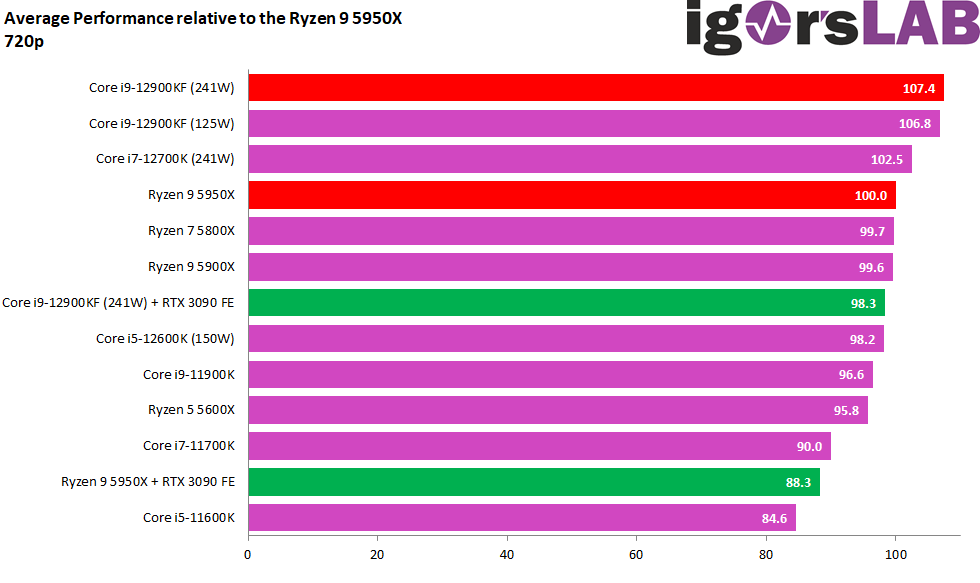

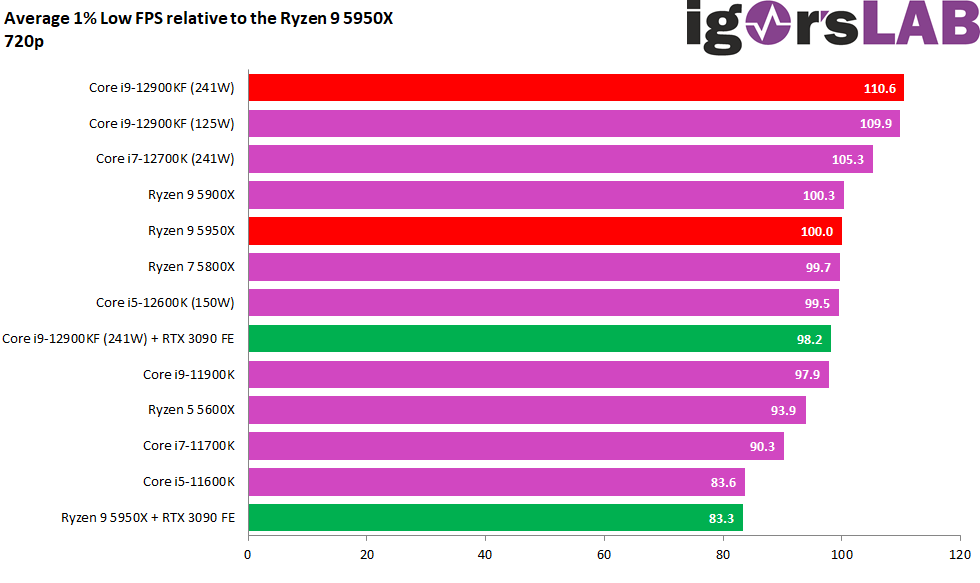

Let’s now look at the whole thing in percentage points, because it becomes much clearer. The gap of 7.4 percentage points between the Core i9-12900KF and the Ryzen 9 5950X remains in both measurements with the Radeon 6900XT. If you compare the (lower) performance of both CPUs in combination with the GeForce RTX 3090, the difference increases to an even 10 percentage points, which is also what many other reviews show as a difference. I saved the resolution with 1080p after the measurements and a short cumulation, because it looks very similar with the GeForce RTX 3090 now.

The P1 (1% low FPS) looks significantly worse with the GeForce RTX 3090 than with the Radeon RX 6900XT and the Core i9-12900KF’s lead increases from 10.6 to almost 15 percentage points! Apart from the fact that the Ryzen performs worse together with the GeForce 3090, the smoothness also suffers considerably.

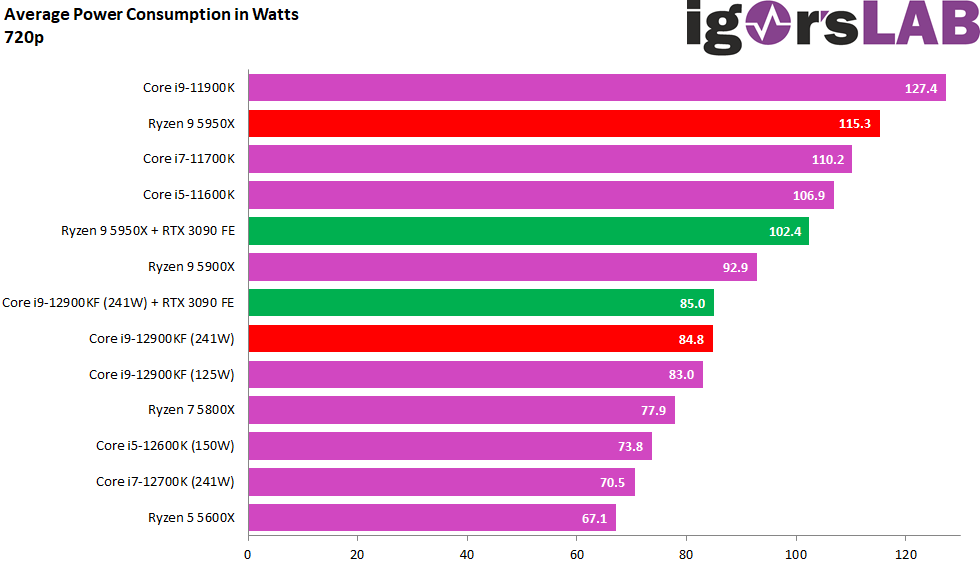

Power consumption and efficiency

Now it’s getting exciting. No matter if the slower GeForce RTX 3090 or the faster Radeon RX 6900XT, the Intel Core i9-12900KF stays almost exactly on the same average power consumption! Less FPS but still the same wattage. And what happens with the Ryzen 9 5950X? The power consumption of the Ryzen 9 5950X drops by a whopping 13 watts across all games. If one adds the up to 10 watts as a result of the other motherboard, a saving of 18 up to the 23 watts would result, which then also rather coincides with the values, which many colleagues had determined.

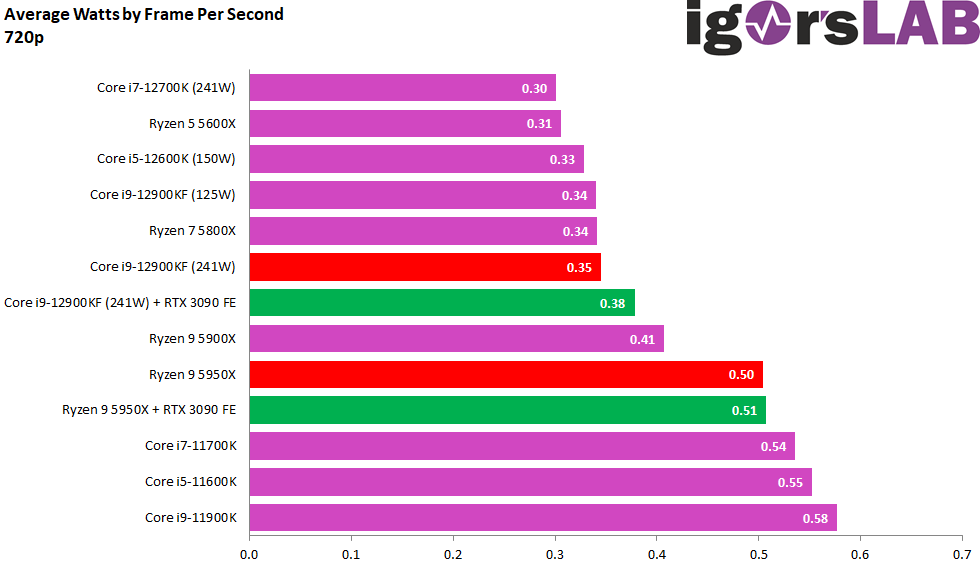

The conclusion is not without a bland aftertaste, because while the Core i9-12900KF cannot benefit from the “slower” graphics card, the power consumption of the Ryzen 9 5950X actually drops significantly with lower graphics performance. That is an important statement, but does it really get to the heart of the matter? Here we have to look at the efficiency of the system!

Which way do you actually look at whole thing? With the power consumption remaining the same for the Core i9-12900K, is the glass now half-empty for Intel or more like half-full for the Ryzen 9 5950X? While the ratio of power consumption to achieved FPS remains the same for the Ryzen when you bench with the GeForce RTX 3090 FE instead of the Radeon RX 6900XT, the efficiency drops for the Core i9-12900KF.

Conclusion and final remarks

With that said, we can also draw the final conclusion that the Ryzen 9 5950X de facto doesn’t care which graphics card is in the system, while the Intel CPU is a bit more fond of Lisa’s Radeon in this regard than Jensen’s green uber-bomber. This is certainly also due to the fact that it tends to show the dreaded driver hiccups at very low resolutions. Today’s measurements in connection with the already preceding motherboard tests prove quite plausibly why my measured values were so deviating from the general average in some respects. Actually, the Core i9-12900KF would add another 5 to 10 watts on top, depending on the manufacturer’s supposed OC or gaming attitude.

If one would also be absolutely correct, you could even consider doing at least the 720p tests with both graphics cards at the same time in the future, or at least use the fastest graphics card in this métier in each case, which also suffers less from negative driver influences. And that’s the Radeon RX 6900XT, although I’m sure I’m repeating myself to the detrement of many. If you were to factor out the extreme cases of both cards in a few games, the result would probably be even clearer.

With that, I’ll close the subject of Alder Lake S and efficiency for now, but only for now. There are some interesting tests to come, I promise, when it comes to the smaller CPUs. Only I have other important products to test at the moment, which don’t happen to have Intel written on them, sympathy or not. Here it is then simply also about balance, which many like to demand. And that is also what is especially important to me.

82 Antworten

Kommentar

Lade neue Kommentare

Mitglied

Urgestein

Veteran

1

1

Veteran

Urgestein

Mitglied

Mitglied

Veteran

Veteran

Urgestein

Urgestein

Mitglied

Veteran

1

Urgestein

1

Mitglied

Alle Kommentare lesen unter igor´sLAB Community →