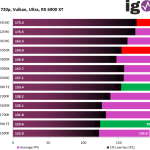

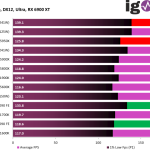

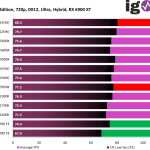

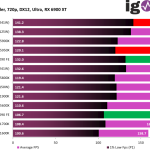

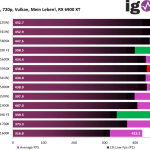

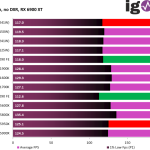

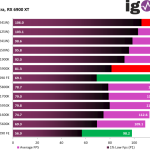

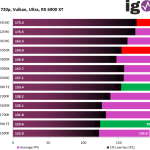

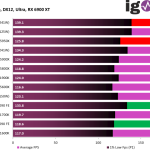

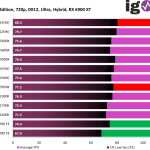

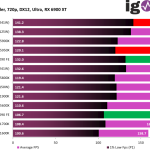

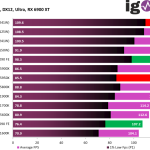

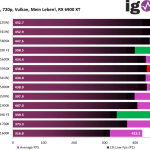

Let’s first return to the measurements in 720p (1280 x 720 pixels). The best option is to limit the graphics card by the CPU and the only chance to work out real differences to now also do various experiments according to the “what if” principle. After all, we want to benchmark the CPUs again and not the two graphics cards. After all the updates and patches, the differences between Alder Lake and Zen3 have become relative again, they are also significantly smaller but it also shows how the CPUs act together with the RTX 3090 FE, because most other reviewers had already benchmarked like that.

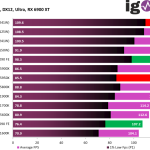

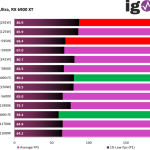

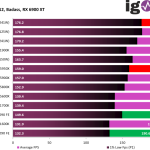

And yes, it shows once again why I preferred the Radeon RX 6900XT over the GeForce RTX 3090, as the results are very much in favor of the Radeon with one exception. Otherwise we would probably never have come up with the results that I will show today on the next few pages and explain in summary at the end. That alone was certainly worth all the effort. Incidentally, it is also worth taking a closer look at the percentiles and variances on this page.

Apart from the fact that the Alder Lake CPUs still deliver the better values at 1% low (P1), the GeForce RTX 3090 also has to admit defeat to the Radeon RX 6900XT in this category. We’ll see in a moment how this whole constellation and sequence will affect the power consumption of the CPU and thus in the end also the sum of CPU and GPU. I also deliberately left the two limiting games (Control and Metro Exodus EE) in the test field, because it’s also interesting to see what happens (or doesn’t happen) to the GeForce here and how Ryzen and Alder Lake react.

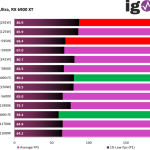

Borderlands 3 - FPS - 720p

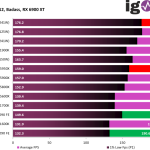

Ghost Recon Breakpoint - FPS - 720p

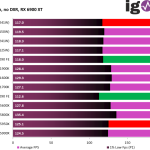

Horizon Zero Dawn - FPS - 720p

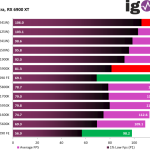

Metro Exodus Enhanced Edition - FPS - 720p

Shadow of the Tomb Raider - FPS - 720p

Watch Dogs Legion - FPS - 720p

Wolfenstein Youngblood - FPS - 720p

Anno 1800 - AvFPSoB - 720p

Borderlands 3 - AvFPSoB - 720p

Far Cry 6 - AvFPSoB - 720p

Ghost Recon Breakpoint - AvFPSoB - 720p

Horizon Zero Dawn - AvFPSoB - 720p

Metro Exodus Enhanced Edition - AvFPSoB - 720p

Shadow of the Tomb Raider - AvFPSoB - 720p

Watch Dogs Legion - AvFPSoB - 720p

Wolfenstein Youngblood - AvFPSoB - 720p

Anno 1800 - FPS99th - 720p

Borderlands 3 - FPS99th - 720p

Far Cry 6 - FPS99th - 720p

Ghost Recon Breakpoint - FPS99th - 720p

Horizon Zero Dawn - FPS99th - 720p

Metro Exodus Enhanced Edition - FPS99th - 720p

Shadow of the Tomb Raider - FPS99th - 720p

Watch Dogs Legion - FPS99th - 720p

Wolfenstein Youngblood - FPS99th - 720p

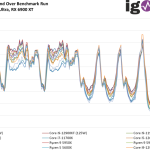

Anno 1800 - FrameTime - 720p

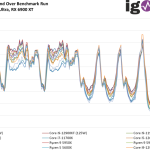

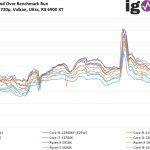

Borderlands 3 - FrameTime - 720p

Control - FrameTime - 720p

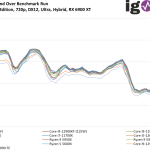

Far Cry 6 - FrameTime - 720p

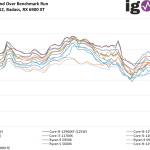

Ghost Recon Breakpoint - FrameTime - 720p

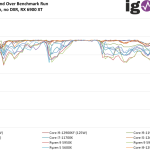

Horizon Zero Dawn - FrameTime - 720p

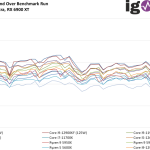

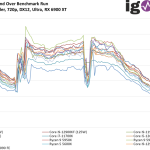

Metro Exodus Enhanced Edition - FrameTime - 720p

Shadow of the Tomb Raider - FrameTime - 720p

Watch Dogs Legion - FrameTime - 720p

Wolfenstein Youngblood - FrameTime - 720p

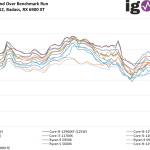

Anno 1800 - FrameTimeVariance - 720p

Borderlands 3 - FrameTimeVariance - 720p

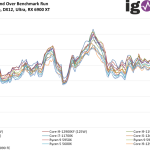

Control - FrameTimeVariance - 720p

Far Cry 6 - FrameTimeVariance - 720p

Ghost Recon Breakpoint - FrameTimeVariance - 720p

Horizon Zero Dawn - FrameTimeVariance - 720p

Metro Exodus Enhanced Edition - FrameTimeVariance - 720p

Shadow of the Tomb Raider - FrameTimeVariance - 720p

Watch Dogs Legion - FrameTimeVariance - 720p

Wolfenstein Youngblood - FrameTimeVariance - 720p

82 Antworten

Kommentar

Lade neue Kommentare

Mitglied

Urgestein

Veteran

1

1

Veteran

Urgestein

Mitglied

Mitglied

Veteran

Veteran

Urgestein

Urgestein

Mitglied

Veteran

1

Urgestein

1

Mitglied

Alle Kommentare lesen unter igor´sLAB Community →