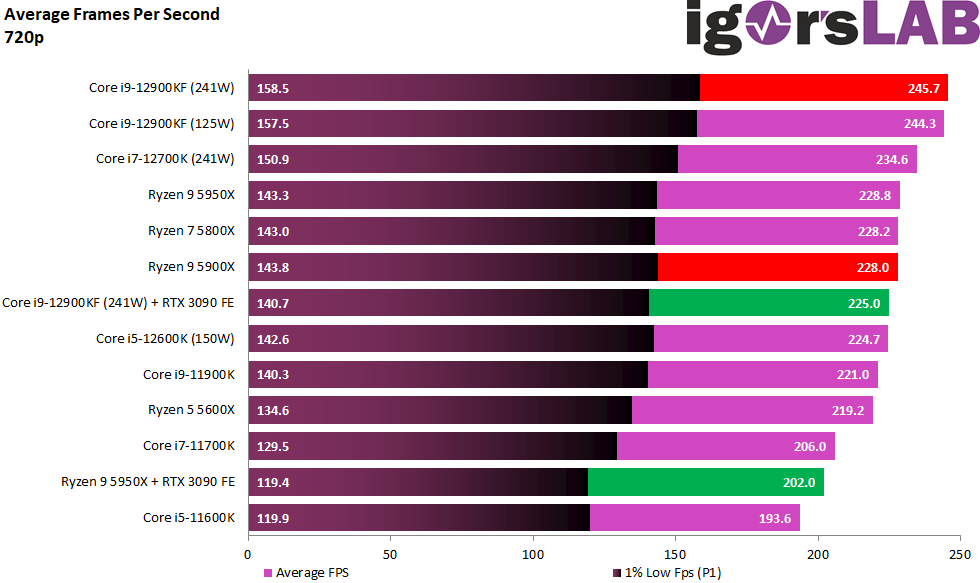

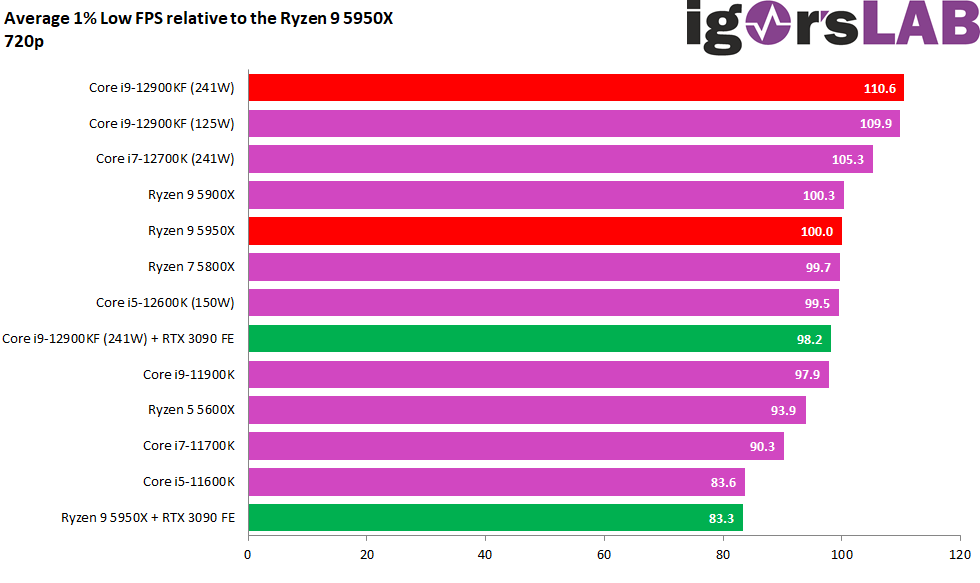

Gaming Performance und Perzentile im Vergleich

Ich will es wirklich nicht überthematisieren, aber die Radeon RX 6900XT schlägt die GeForce RTX 3090 in 720p wirklich deutlich. Über die Gründe hatte ich bereits ausführlich geschrieben und ich müsste schon zehn NVIDIA-affine Spiele gegen jede Vernunft mit sehr viel Boshaftigkeit und Vorsatz herauspicken, um dieses Ergebnis noch komplett umzukehren. Selbst der Ryzen 9 5950X mit der Radeon RX 6900XT im Duo ist noch knapp schneller als der Core i9-12900KF mit der GeForce RTX 3090. Der Unterschied zwischen den einzelnen Balken fällt hingegen schon arg brutal aus. Mit bis zu fast 44 normalisierten FPS im Durchschnitt zwischen der schnellsten und der langsamsten Kombination sind das wirklich bereits Welten.

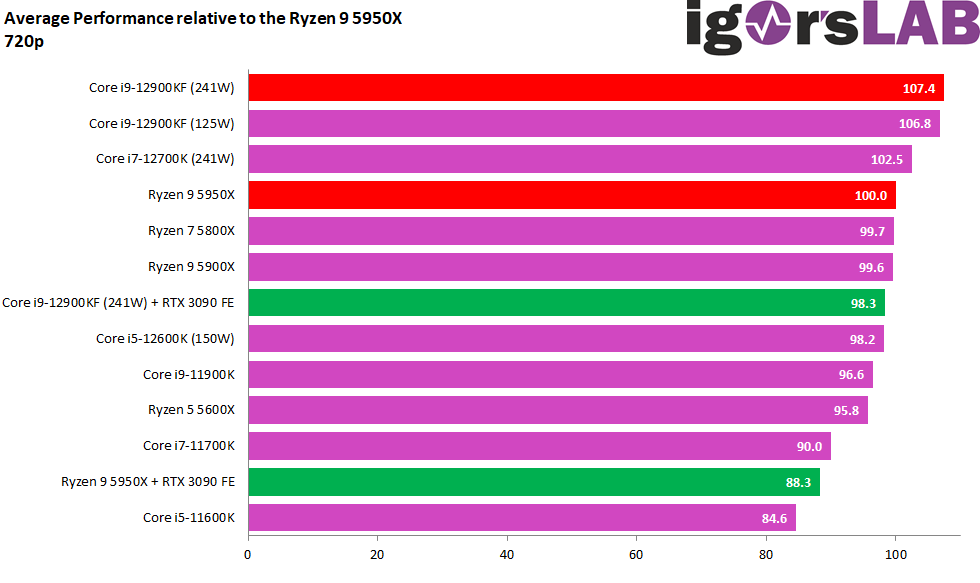

Betrachten wir nun das Ganze einmal in Prozentpunkten, denn es wird deutlich übersichtlicher. Bei den beiden Messungen mit der Radeon 6900XT bleibt es beim Abstand von 7.4 Prozentpunkten zwischen dem Core i9-12900KF und dem Ryzen 9 5950X. Vergleicht man die (niedrigere) Performance beider CPUs im Zusammenspiel mit der GeForce RTX 3090, dann steigt der Unterschied auf glatte 10 Prozentpunkte, also auch das, was viele andere Reviews als Unterschied ausweisen. Die Auflösung mit 1080p habe ich mir nach den Messungen und einer kurzen Kumulation gespart, denn das sieht nun mit der GeForce RTX 3090 doch sehr ähnlich aus.

Das P1 (1% Low FPS) sieht mit der GeForce RTX 3090 deutlich schlechter aus als mit der Radeon RX 6900XT und der Vorsprung des Core i9-12900KF steigt von 10,6 auf knappe 15 Prozentpunkte! Mal abgesehen davon, dass der Ryzen zusammen mit der GeForce 3090 auch so schon schlechter performt, leidet auch der Bildlauf noch einmal ordentlich.

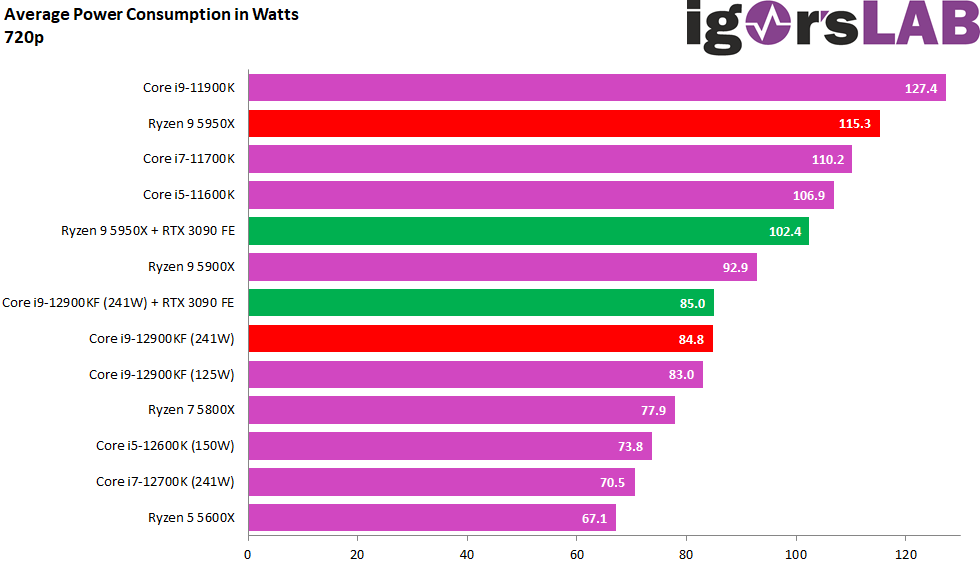

Leistungsaufnahme und Effizienz

Jetzt wird es spannend. Egal ob nun die langsamere GeForce RTX 3090 oder die schnellere Radeon RX 6900XT, der Intel Core i9-12900KF bleibt fast exakt auf dem gleichen Durchschnittswert der Leistungsaufnahme! Weniger FPS aber trotzdem gleiche Watt-Zahlen. Und was passiert beim Ryzen 9 5950X? Die Leistungsaufnahme des Ryzen 9 5950X sinkt in der Summe aller Spiele um satte 13 Watt. Rechnet man noch einmal die bis zu 10 Watt als Folge des anderen Motherboards dazu, ergäbe sich eine Einsparung von 18 bis zu den 23 Watt, was sich dann auch mit den Werten eher deckt, den viele Kollegen ermittelt hatten.

Die Schlussfolgerung ist nicht ohne Beigeschmack, denn während der Core i9-12900KF von der „langsameren“ Grafikkarte nicht profitieren kann, sinkt die Leistungsaufnahme des Ryzen 9 5950X sogar signifikant bei geringerer Grafikleistung. Das ist erst einmal eine wichtige Aussage, doch trifft sie wirklich auch den Kern? Da müssen wir schon einmal die Effizienzbetrachtung bemühen!

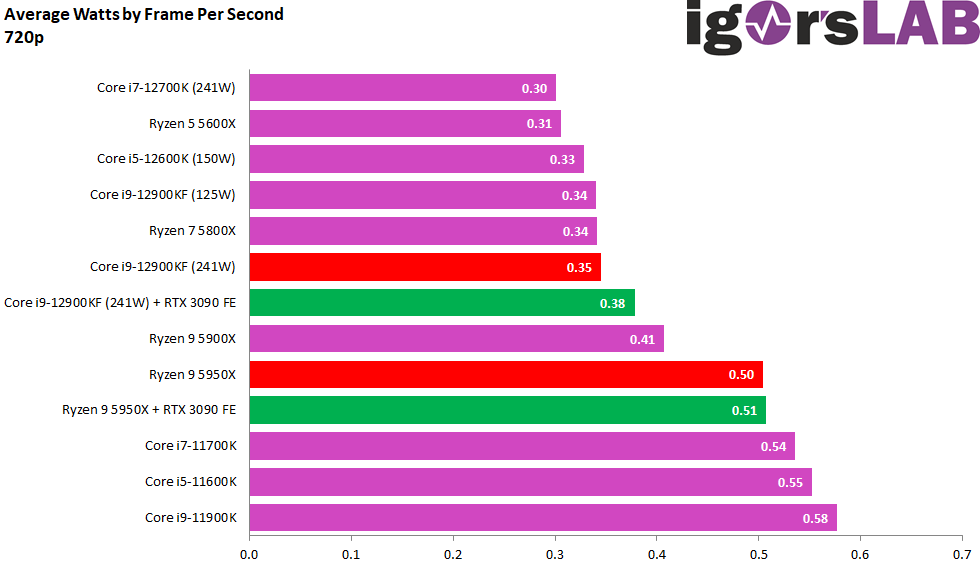

Wie herum sieht man das Ganze denn nun eigentlich? Ist das Glas für Intel mit der gleichbleibenden Leistungsaufnahme beim Core i9-12900K nun halbleer oder für den Ryzen 9 5950X eher halbvoll? Während das Verhältnis aus Leistungsaufnahme zu den erzielten FPS beim Ryzen gleich bleibt, wenn man statt mit der Radeon RX 6900XT mit der GeForce RTX 3090 FE benchmarkt, sinkt die Effizienz beim Core i9-12900KF.

Fazit und Schlussbemerkung

Damit kann man allerdings auch das finale Fazit ziehen, dass es dem Ryzen 9 5950X de facto egal ist, welche Grafikkarte im System steckt, während die Intel-CPU die Radeon von Lisa diesbezüglich etwas mehr lieb hat, als Jensens grünen Über-Bomber. Das liegt sicher auch daran, dass dieser bei den ganz niedrigen Auflösungen gern auch einmal den gefürchteten Treiber-Schluckauf zeigt. Die heutigen Messungen belegen im Zusammenhang mit den bereits vorangegangenen Motherboard-Tests recht plausibel, warum meine Messwerte in manchen Belangen so abweichend vom allgemeinen Durchschnitt waren. Denn eigentlich kämen auf der Seite des Core i9-12900KF sogar noch einmal 5 bis 10 Watt obendrauf, je nach vermeintlicher OC- oder Gaming-Attitüde des Herstellers.

Wäre man zudem absolut korrekt, könnte man sogar überlegen, in Zukunft zumindest die 720p-Tests mit gleich mit beiden Grafikarten machen oder zumindest die jeweils schnellste Grafikkarte in diesem Metier benutzen, die zudem weniger unter negativen Treiber-Einflüssen leidet. Und das ist nun einmal die Radeon RX 6900XT, auch wenn ich mich zum Leidwesen vieler sicher wiederhole. Würde man die Extremfälle beider Karten in einigen wenigen Spielen noch herausrechnen, dann wäre das Ergebnis wohl sogar noch eindeutiger.

Damit schließe ich das Thema Alder Lake S und Effizienz erst einmal ab, aber nur vorerst. Da kommen noch interessante Tests, versprochen, wenn es um die kleineren CPUs geht. Nur habe ich aktuell auch noch andere wichtige Produkte zu testen, wo nicht zufällig Intel draufsteht, Sympathie hin oder her. Hier geht es dann einfach auch um Ausgewogenheit, die viele gern einfordern. Und genau die ist mir nun einmal besonders wichtig.

82 Antworten

Kommentar

Lade neue Kommentare

Mitglied

Urgestein

Veteran

1

1

Veteran

Urgestein

Mitglied

Mitglied

Veteran

Veteran

Urgestein

Urgestein

Mitglied

Veteran

1

Urgestein

1

Mitglied

Alle Kommentare lesen unter igor´sLAB Community →